将 AI Agent 接入日常工作流,本应是提升效率的好事。

但现实往往很骨感:为了保护数据隐私,你只能守着本地“智商有限”的小模型死磕;为了追求极致性能,又不得不忍受云端昂贵的 API 成本,还得时刻担心敏感信息在不经意间“裸奔”到第三方服务器。

云端太危险,本地太鸡肋。开发者难道只能在“裸奔”和“人工智障”之间二选一?

现在有了新的答案。由清华大学 THUNLP 实验室、中国人民大学、AI9Stars、面壁智能与 OpenBMB 联手推出了一款“智能交通指挥官”—— ClawXRouter。

这是一个开源的端云协同 AI 智能体路由插件,可以轻松适配 OpenClaw 生态。它就像是给 Agent 装上了“分身术”,能够智能地在本地和云端之间动态切换:简单任务本地跑,敏感数据先脱敏,复杂推理交给云端。

ClawXRouter 源于端云协同智能体框架 EdgeClaw,其内生具备三级隐私路由、性价比感知路由、智能脱敏转发、双轨记忆等完整的端云协同能力。最新测试数据显示,使用 ClawXRouter 不仅能让成本直降 58%,性能反而还提升了 6.3%。

一招破解三大顽疾,开启 Agent 落地新范式

当前 AI Agent 使用模式中普遍存在三个难以调和的痛点:

- 云端“不敢用”:想让 Agent 分析一份客户数据表?这个想法很棒,但客户的姓名、手机号等敏感信息会随上下文一起发到云端。一次数据分析,可能就意味着一次严重的隐私泄露,这个风险谁都难以承担。

- 云端“用不起”:只是想用

grep 查找一个函数调用位置,或是做个简单的文本摘要,Agent 却可能直接调用最昂贵的顶级模型来处理。大部分 Token 被浪费在了便宜模型即可解决的简单任务上,妥妥的“杀鸡用牛刀”。

- 本地“用不好”:在本地跑模型安全又便宜,但端侧模型的算力和参数规模有限。做做格式转换、数据汇总还行,一旦涉及多文件交叉分析或复杂的异常检测,模型就容易“宕机”,难以胜任高难度任务。

ClawXRouter 的出现,正是为了打通端云协同的最后一步。它通过一套精妙的路由机制,为每一条请求找到最合适的处理路径。

这样一来,开发者无需改动一行业务代码,就能让 AI Agent 自动实现:公开数据上云分析、敏感数据脱敏后上云、私密数据完全在本地处理。一个插件,丝滑实现端云协同,解决开发者“不敢用、用不起、用不好”的三大难题。如果你想深入了解更多 AI Agent 的前沿应用,可以到 云栈社区 的人工智能板块看看。

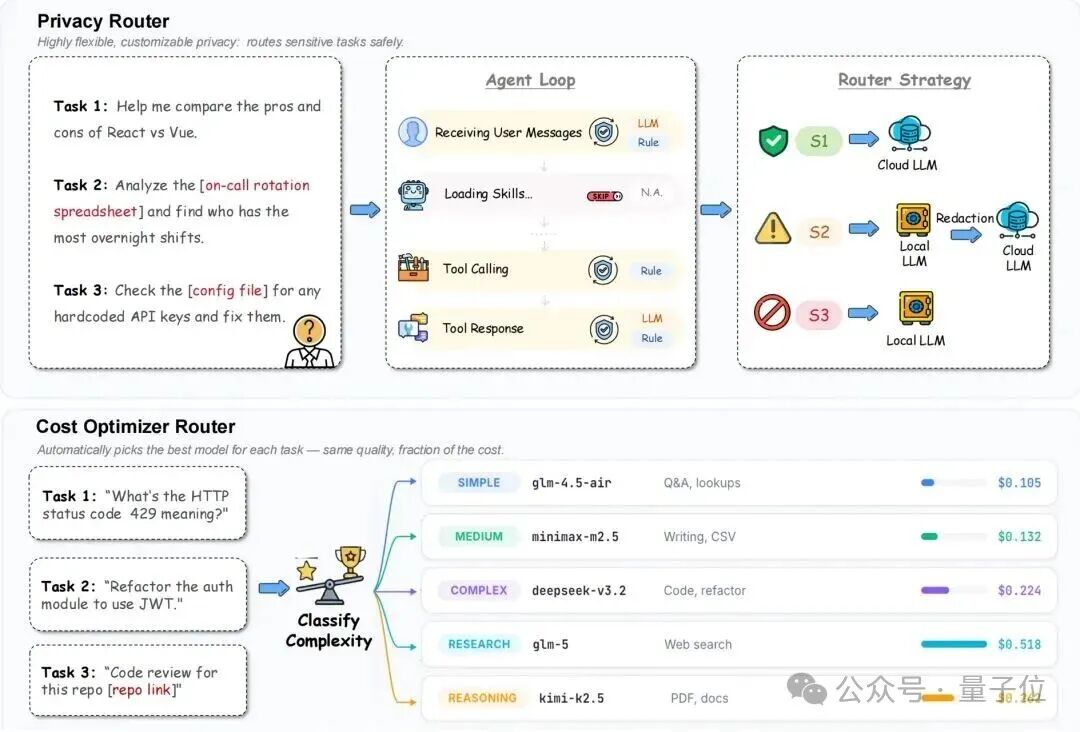

三级隐私路由,彻底解决“不敢用”

即使是日常的 Code Review 任务,也可能一不小心把 API Key 或数据库密码喂给云端模型。

ClawXRouter 通过植入钩子(Hook),像安检一样自动扫描每一条消息、工具调用和 Agent 输出,并将其智能分为三级:

- S3(私密):如 SSH 私钥、硬编码密码、工资单。这些数据将被物理隔离,请求完全由本地模型离线处理,云端毫不知情。私密信息,绝不出本机。

- S2(敏感):如含内网 IP 的告警日志、含手机号的联系人列表。ClawXRouter 会自动识别并智能脱敏(例如,将“王小二”替换为

[REDACTED:NAME]),然后才转发给云端模型。

- S1(安全):如“HTTP 403 和 401 有什么区别?”这类普通问题,直接发往云端,发挥其最强能力。

这背后是“规则 + 模型”双检测引擎在保驾护航,既快又准,确保万无一失。

性价比感知路由,精准解决“用不起”

“航天级”的模型就不该干“拧螺丝”的活。ClawXRouter 内置了一个由本地小模型担当的“任务评估师”(LLM-as-Judge)。它会快速判断任务复杂度,然后将请求分发给最合适(通常也是最便宜)的云端模型。

| 级别 |

任务示例 |

默认模型 |

| SIMPLE |

摘要、改写、简单问答、打招呼 |

glm-4.5-air |

| MEDIUM |

写邮件、写脚本、数据分析、项目脚手架 |

minimax-m2.5 |

| COMPLEX |

批量邮件分拣、多文件创建、结构化数据提取 |

deepseek-v3.2 |

| RESEARCH |

长文写作、多源整合工作流 |

glm-5 |

| REASONING |

深度 PDF 分析、数学证明、实验设计 |

kimi-k2.5 |

效果如何?在 PinchBench(包含 23 项 OpenClaw Agent 基准测试)上的跑分结果如下:

| 方案 |

PinchBench 跑分(Best / Avg) |

成本 |

| ClawX 路由(5 模型混合) |

93.2% / 89.6% |

$2.36 |

| 全部用 Sonnet 4.6 |

86.9% / 79.2% |

$5.63 |

结论是:成本节省 58%,性能反而提升 6.3%。这种高效的成本优化策略,对于资源敏感的开发团队尤其重要。

双轨记忆与智能脱敏,根治“用不好”

当一项任务既包含敏感信息,又需要云端模型的强大推理能力时,怎么办?这时,ClawXRouter 的智能脱敏机制就派上了用场。

对于涉及敏感信息的复杂任务,本地模型能力不足时不必“硬扛”。ClawXRouter 会自动识别敏感信息并智能脱敏后,将脱敏后的任务安全交给云端处理。

同时,ClawXRouter 巧妙地维护了 双轨记忆 与 双轨会话 机制:云端模型只能看到脱敏后的对话历史(MEMORY.md),本地则保留完整信息(MEMORY-FULL.md)。这样既保护了隐私,又没有因为本地模型的瓶颈而卡住工作流,从根本上杜绝了隐私数据通过上下文窗口泄露给第三方服务的风险。

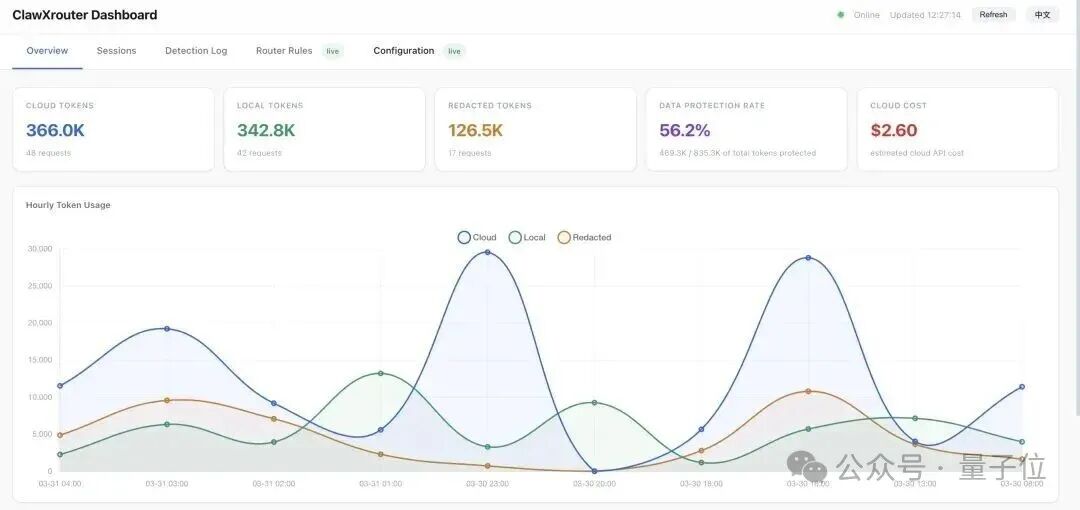

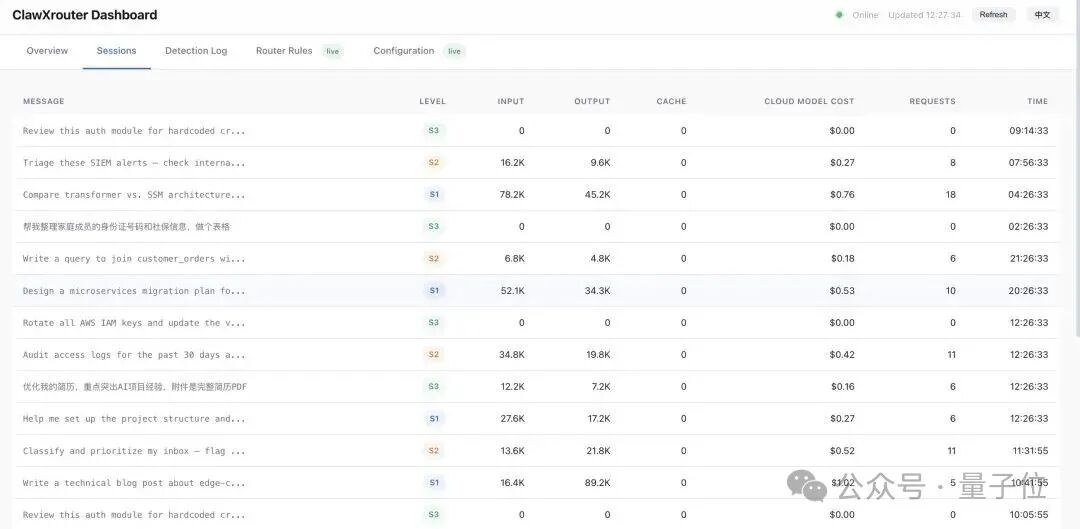

可组合管线与可视化 Dashboard

每个开发者与团队的需求都不同。为此,ClawXRouter 提供了高度灵活的配置方式:

- 可组合路由管线:隐私路由和性价比感知路由运行在同一管线中,遵循安全优先原则。隐私路由器高权重先运行,发现敏感数据直接“短路”处理;安全通过后,才启动性价比路由来优化成本。整个管线通过 10 个 Hook 覆盖从模型选择到会话结束的完整生命周期,无侵入式接管 OpenClaw 原有流程。

- 可视化 Dashboard:支持中英双语,涵盖用量概览、会话记录、检测日志、路由规则配置与模型配置五个面板。所有改动即时生效、无需重启,方便用户按自身需求灵活调整。

快速上手

# 前置条件:已安装 OpenClaw

# 通过 npm 安装(推荐)

pnpm add -w @openbmb/clawxrouter

# 或通过 ClawHub 安装

openclaw plugins install clawhub:clawxrouter

# (可选)安装本地推理后端

ollama pull openbmb/minicpm4.1

ollama serve

# 启动

openclaw gateway

# Dashboard → http://127.0.0.1:18789/plugins/clawxrouter/stats

云侧不敢用、用不起,端侧用不好?ClawXRouter 给出的答案是:不必二选一,让端侧和云侧各尽其能。这个项目已在 GitHub 开源,并将持续迭代,欢迎开发者与行业伙伴参与贡献,共同构建安全高效的端云协同 Agent 生态。