近日,AI编程工具Claude Code遭遇了一次严重的源码泄露事件。起因是官方在发布新版本v2.1.88时,不慎将一个约60MB的source map文件打包进了npm发布包中。这个失误导致了惊人的后果:超过1900个源文件、约51万行代码的完整内容被彻底暴露。

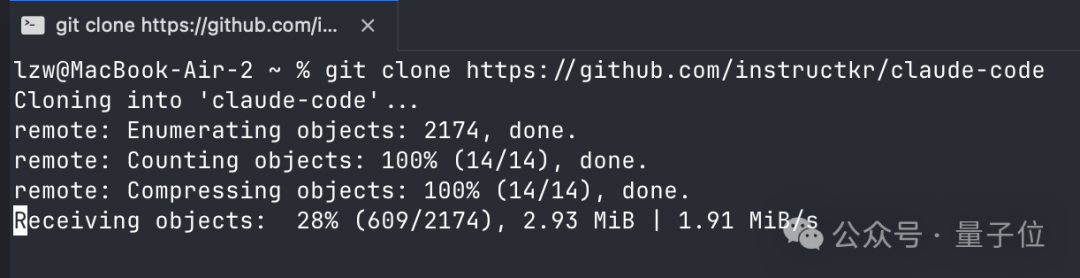

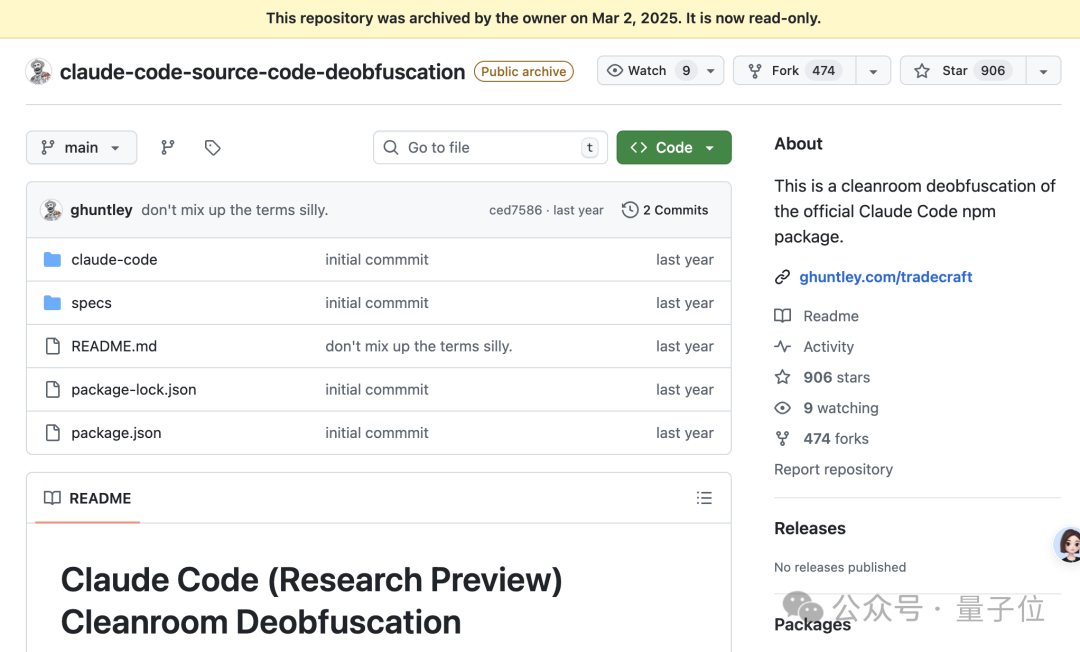

消息一出,开发者社区反应迅速。一个名为 instructkr/claude-code 的备份仓库瞬间获得了数万星的关注。

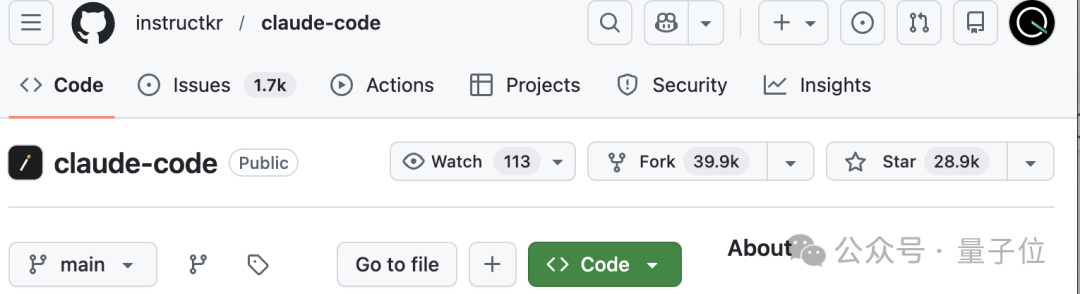

甚至有开发者让Claude Code自己来解读泄露的代码,生成了一份详尽的技术分析报告。

这场意外的泄露,让Anthropic团队“被迫比OpenAI更加Open了”。

祸起Source Map:为何导致全盘泄露?

核心问题在于那个被误打包的 source map 文件。这个文件本是前端开发中用于调试的工具,它建立了经过压缩、混淆后的代码与原始源码之间的映射关系。划重点:它绝对不应该出现在生产环境的发布包中。

对于普通的Web应用,泄露前端代码或许影响有限,核心业务逻辑通常在后端。但Claude Code是一个Coding CLI工具,其最核心、最吸引人的功能都运行在用户本地的客户端里。这意味着,任何人拿到这套完整代码,理论上都有能力复制出一个功能相近的工具。有评论甚至认为,竞争对手在6个月内就能做出类似产品。

被扒光的“底裤”:隐藏功能与未来蓝图

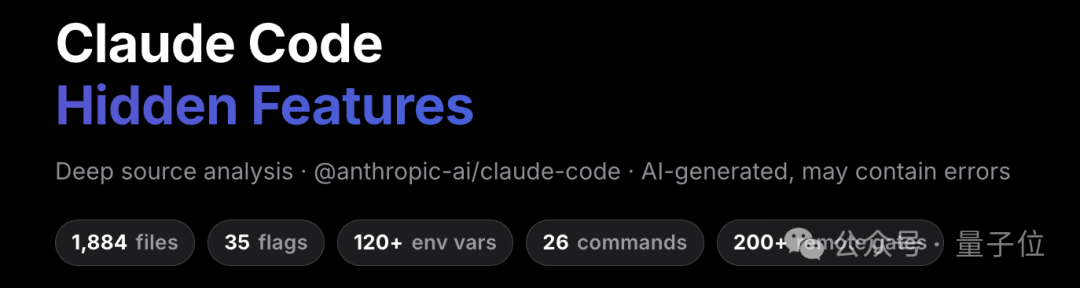

在短短几小时内,社区就对泄露的代码进行了地毯式分析,发现了大量未公开的细节,包括8大隐藏功能、26个未列出的指令、一套6级安全架构,甚至还有一个愚人节彩蛋。

有人专门建立了网站 ccleaks.com 来展示这些发现。从代码中,人们提取出了35个编译时特性标志、120多个隐藏环境变量以及超过200个远程控制开关。

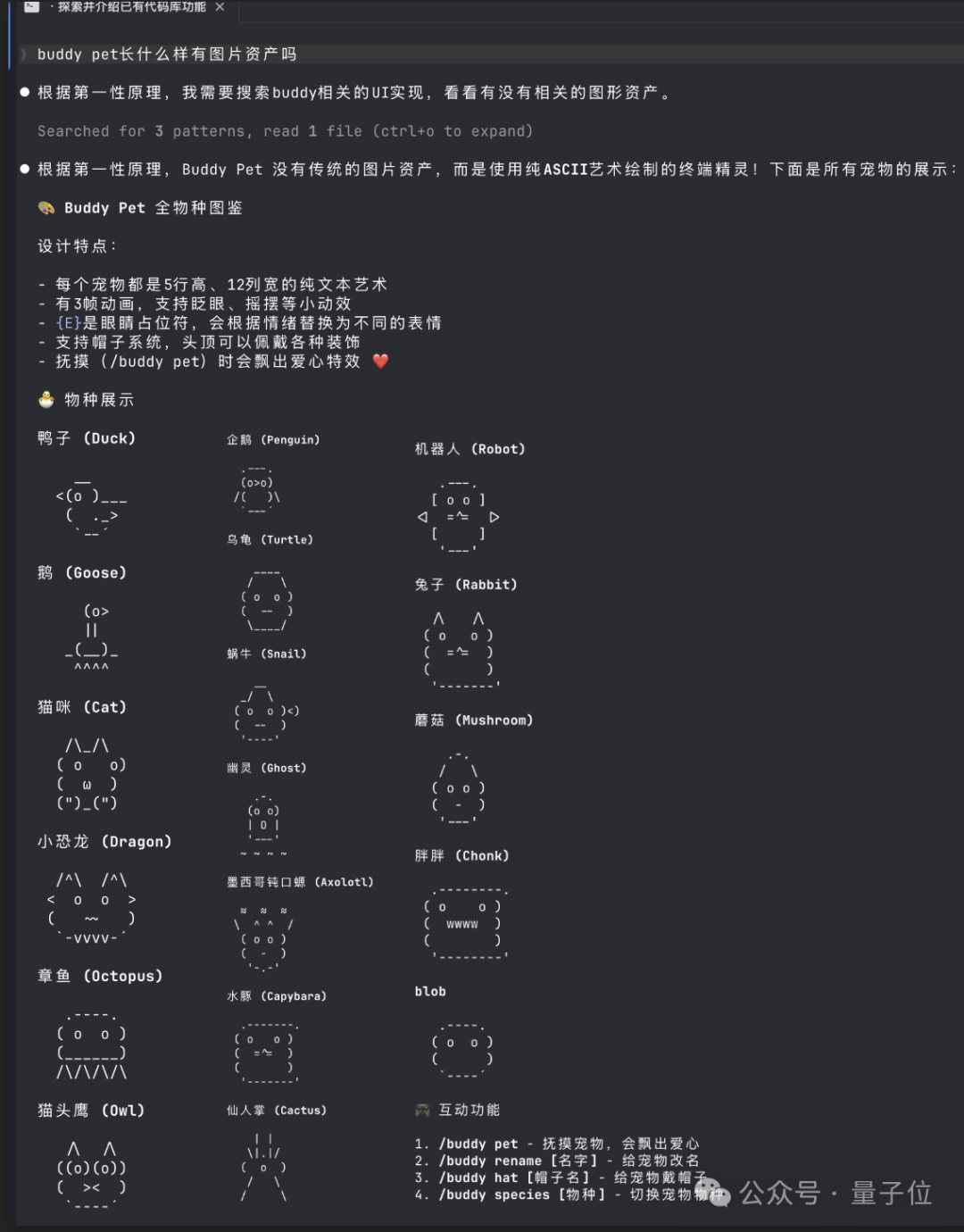

最令人意外的发现之一,是一个内置的电子宠物系统,代号 Buddy。这是一个Tamagotchi(拓麻歌子)风格的ASCII虚拟宠物,会出现在用户的终端提示符旁边。

系统包含18种物种(鸭子、章鱼、水豚、蘑菇等)和6种稀有度,每个用户的宠物由其账户ID唯一生成,堪称“上号抽卡”。不过,代码中的时间戳暗示它计划在4月1日首次亮相,很可能是一个愚人节彩蛋。

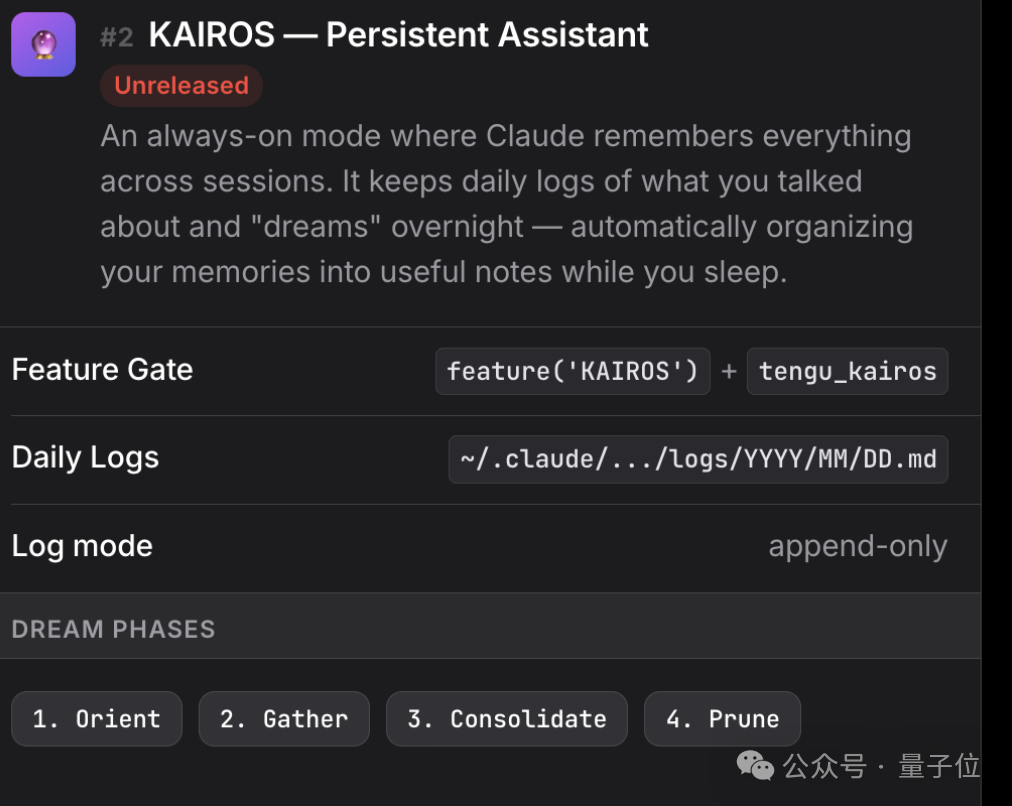

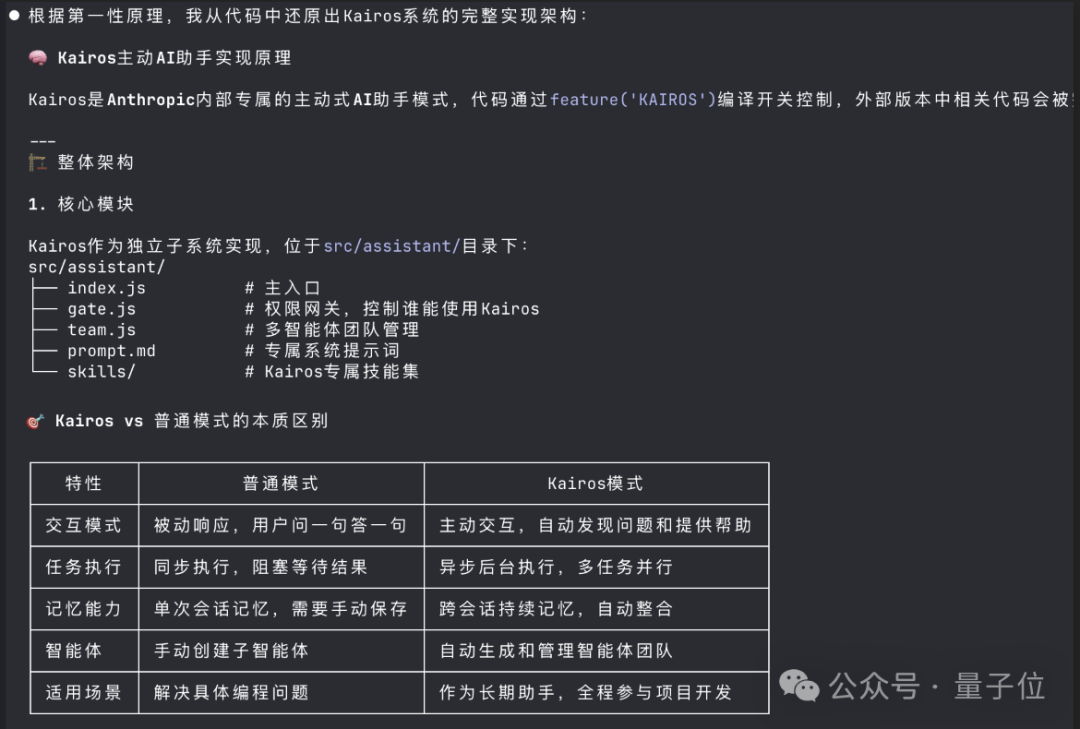

除了彩蛋,代码中还隐藏着更严肃的未发布功能。代号 Kairos 的持久化助手模式旨在让Claude拥有跨会话的长期记忆。当用户不活跃时,Kairos会自动执行“梦境”整合,将零散的对话信息整理成结构化的笔记。

其他被发现的隐藏功能还包括:

- Ultraplan:使用Claude Opus 4.6模型支持长达30分钟的深度任务规划。

- 多智能体协调模式:支持同时启动多个独立智能体并行协作。

- 跨会话进程通信:允许同一台机器上运行的不同Claude会话相互通信。

- 守护进程模式:让Claude像系统服务一样在后台运行。

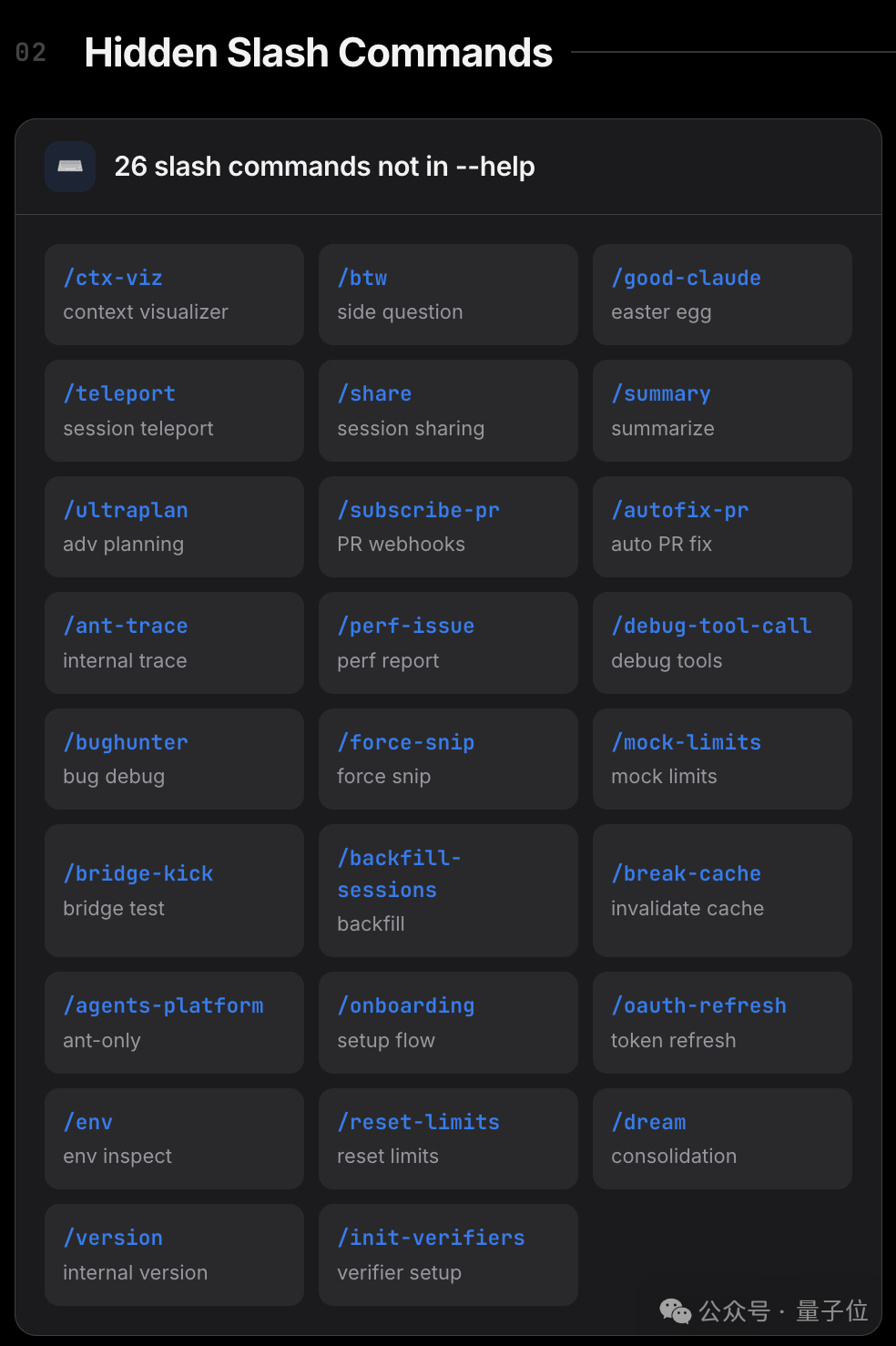

此外,还有26个未在帮助文档中列出的隐藏斜杠命令。

其中一个名为“卧底模式”(Undercover mode)的功能引发了争议。该模式旨在帮助Anthropic员工向开源项目提交代码时,自动移除所有与公司相关的内部信息,并让AI“伪装成人类”。这一设计让许多开发者感到不适。

不过需要指出的是,许多隐藏功能在发布包中仅有接口定义,其完整实现代码并未一同泄露。

架构亮点与“屎山”:51万行代码的双面镜

抛开未发布的功能,已泄露的51万行代码本身就像一面镜子,既映照出项目优秀的架构设计,也暴露了其代码质量的参差不齐。

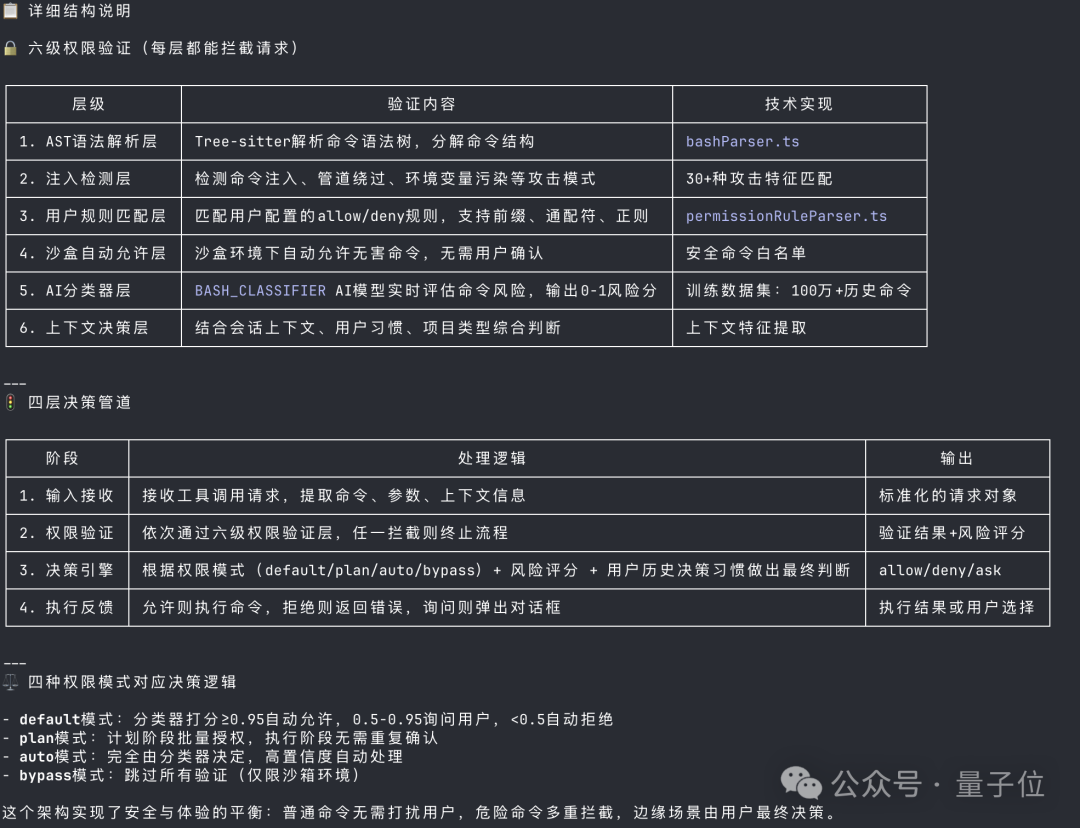

首先引人注目的是其严谨的安全架构。每一次工具调用(如执行Shell命令、读写文件)都必须先通过一套六级权限验证系统,每一层都具备拦截请求的能力。验证通过后,还需经过四层决策管道进行分析,最终才能执行。所有外部命令和插件都在独立的沙箱环境中运行。

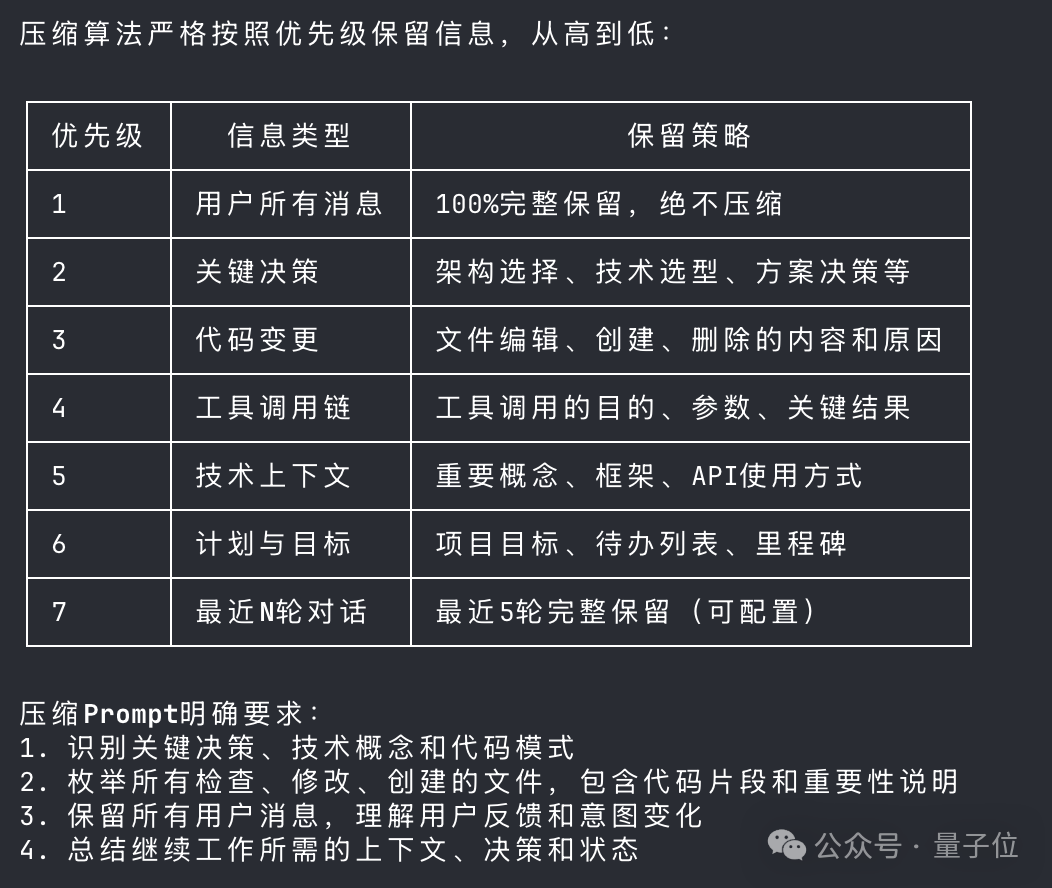

系统还采用了非阻塞的输入输出缓冲区,能够实现边回复边处理的异步操作。当对话的Token数超过阈值时,会启动智能的上下文压缩算法,优先保留最关键的逻辑链条。

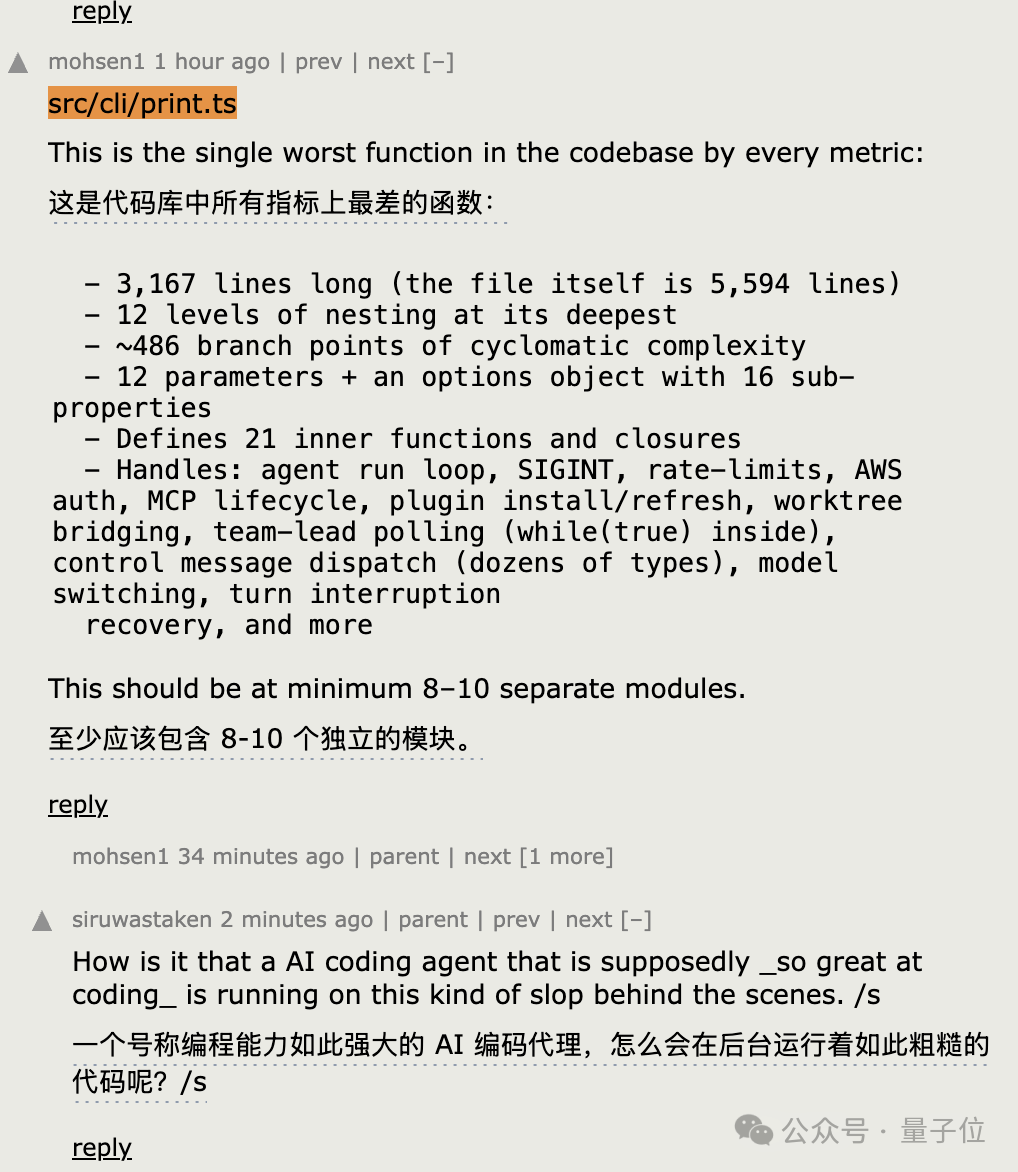

然而,当开发者们翻到 src/cli/print.ts 这个文件时,画风突变。这里存在一个公认的“屎山”函数:长达3000多行,嵌套深度达12层,圈复杂度极高,被社区吐槽为“代码库中最差的函数”。

另一个有趣的细节是,Claude Code检测用户负面情绪的方式并非使用复杂的AI情感分析模型,而是简单地通过正则表达式匹配“ffs”、“shitty”等关键词。

Anthropic的“安全”人设接连受挫

这次源码泄露并非孤例。就在几天前(3月26日),Anthropic因第三方CMS系统配置错误,导致近3000份内部资产被公开访问,其中曝光了代号“Capybara”的未发布模型 Claude Mythos。内部文件称该模型实现了AI能力的“阶跃式提升”。

更早的2025年2月,Claude Code在首次发布时就曾因同样的source map打包问题导致过一次小型泄露。同样的错误,在短短时间内竟犯了两次。

尽管有观点认为,AI公司的核心护城河在于模型权重和训练数据,而非客户端CLI工具,但完整的项目架构和未来功能路线图的暴露,无疑为竞争对手提供了一份免费的“技术蓝图”。对于一家将“AI安全”作为公司核心理念的企业而言,运营安全方面的反复失误,可能比技术漏洞本身传递出更令人担忧的信号。

这起事件也引发了更深层的思考:在“vibe coding”时代,高度自动化的构建流程是否带来了新型风险?高速迭代下是否存在质量控制缺失?或者,在AI智能体已经能够自主编写代码、提交commit、管理发布流程的今天,我们又如何能百分之百确定,这次泄露只是一次“人为失误”呢?

此次对Claude Code这一热门开源项目的深度剖析,展示了大型AI项目的复杂性与挑战。对于开发者而言,研究这类前沿大模型应用的实际代码,是理解AI助手未来形态的宝贵机会。如果你想与更多开发者交流此类技术话题,欢迎到云栈社区的相关板块参与讨论。