大语言模型的性能突破,正从单纯的模型权重竞争,转向对其外部控制逻辑——“Harness”的优化。近日,斯坦福大学的研究团队提出了 Meta-Harness,一个让编程代理自动搜索和优化大语言模型Harness的外循环优化框架。这项工作也得到了业内专家如林俊旸(前阿里Qwen负责人)的认可,他指出:“‘模型+Harness’的组合已经超越了单纯的模型本身。Agent性能在很大程度上会受到Harness设计与质量的显著影响。我坚信这是一个正确的研究方向,干得漂亮!”

Meta-Harness的核心在于,通过赋予编程代理对完整历史经验(包括源代码、执行轨迹和评估分数)的文件系统访问权限,使其能够自主诊断并改进Harness。实验表明,该方法在文本分类、数学推理和Agentic编码三个领域均大幅超越现有最佳人工设计,实现了10倍的搜索效率提升和显著的性能突破。

为什么需要优化Harness?

Harness,即包裹在大语言模型(LLM)外部的代码逻辑,它直接决定了智能体(Agent)如何:

- 存储:哪些历史信息和状态值得保留。

- 检索:何时以及如何从记忆中提取相关内容。

- 展示:如何构建和格式化最终的提示上下文给模型。

研究表明,仅仅改变固定模型的Harness,就可在同一基准测试上产生高达6倍的性能差距。然而,当前的Harness工程严重依赖人工试错,过程低效且难以捕捉复杂的、长程的依赖关系。

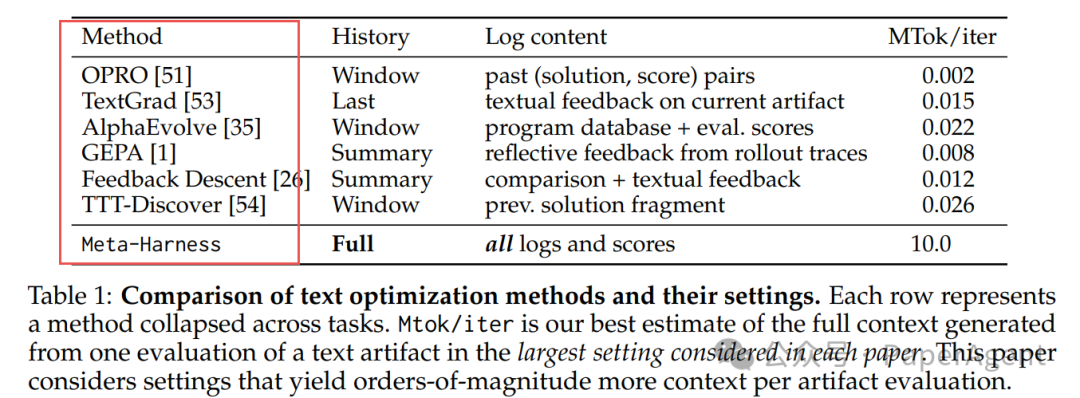

现有文本优化方法的局限

尽管存在OPRO、TextGrad等文本优化器,但它们通常过度压缩反馈信息:仅依赖标量分数、缺乏历史记忆、将反馈限制在短模板或摘要中。这种信息损失在Harness优化中尤为致命,因为一个关于存储或检索的早期决策,其影响可能在很多步之后才会显现,压缩反馈丢失了进行有效归因分析所需的关键细节。

表1:文本优化方法对比。Meta-Harness每步可处理高达1000万token的完整诊断信息,比现有方法高3个数量级。

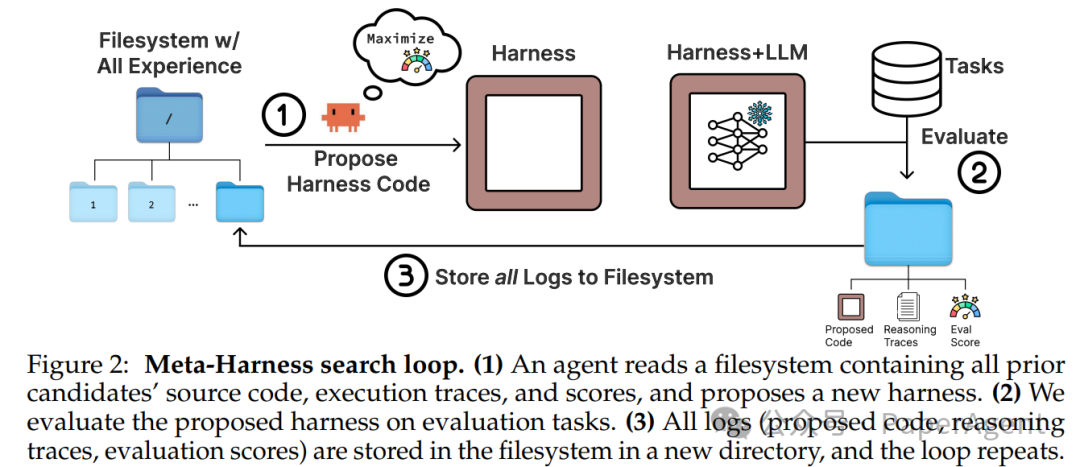

Meta-Harness的创新在于,它将Harness优化构建为一个由编程代理驱动的搜索循环,并向代理暴露完整的、未经压缩的历史经验。

搜索循环(Search Loop)

图2:Meta-Harness搜索循环。(1) 代理读取包含所有先前候选Harness源代码、执行轨迹和评分的文件系统,并提出一个新Harness。(2) 在评估任务上测试新提出的Harness。(3) 所有日志(提议的代码、推理轨迹、评估分数)被存储到文件系统的新目录中,循环继续。

关键设计:

- 代理化提议者(Agentic Proposer):使用如Claude Code这样的编程代理,而非原始LLM。代理可以主动调用

grep、cat等工具来查询和分析文件系统。

- 完整经验存储:每个候选Harness对应文件系统中的一个目录,包含其完整源代码、评估分数以及详细的执行轨迹(提示、工具调用、模型输出、状态更新)。

- 选择性诊断:代理在每一轮搜索中并非盲目加载所有历史数据,而是有选择地读取中位数82个文件(约41%源代码,40%执行轨迹),进行高效分析。

为什么代码空间与完整轨迹访问有效?

Harness优化发生在代码空间,这带来了独特优势:

- 结构性影响:微小的检索或内存逻辑改动,可能通过多步交互产生巨大的下游影响。

- 可解释性:通过检查原始执行轨迹,代理可以进行因果推理,推断失败的根本原因(例如,“第15步的检索错误导致了后续状态污染”)。

- 自然正则化:代码模型倾向于提出连贯、健壮的算法性修改,而非脆弱、过拟合的硬编码方案。

实验结果

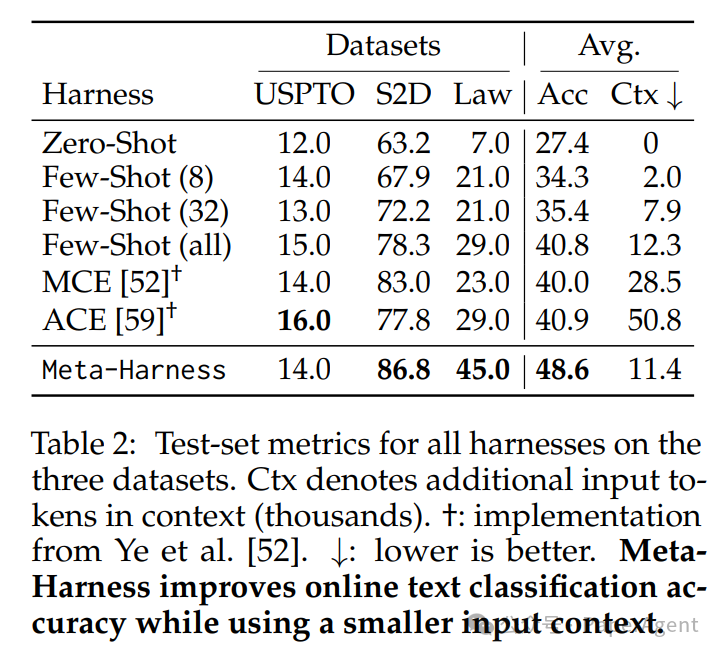

1. 在线文本分类(Online Text Classification)

在LawBench、Symptom2Disease、USPTO三个数据集上,使用GPT-OSS-120B作为分类器进行评估。

表2:在线文本分类测试结果。Meta-Harness在平均精度上超越最佳人工设计(ACE)7.7分,同时上下文token使用量减少4倍以上。

关键发现:

- 精度显著提升:平均准确率达48.6%,相比ACE的40.9%提升了7.7分。

- 上下文高效:仅使用11.4K额外上下文token,而ACE需要50.8K。

- 搜索效率极高:仅用4次评估就达到了其他优化方法(OpenEvolve, TTT-Discover)需要40次评估才能达到的精度,实现10倍效率提升。

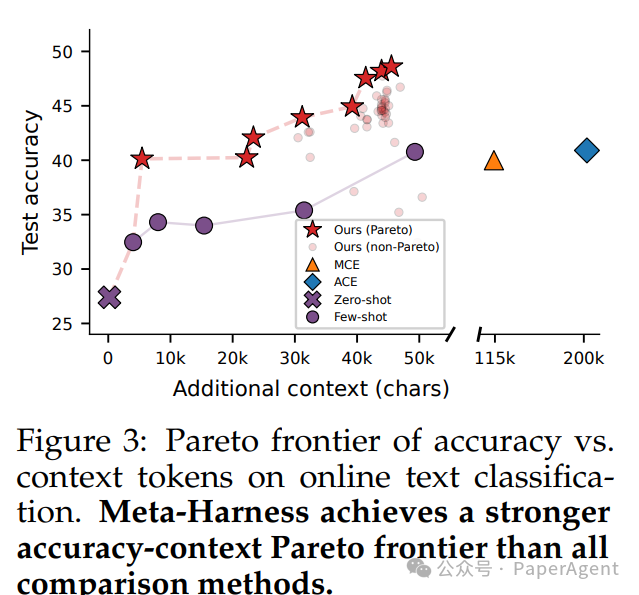

图3:准确率-上下文token的帕累托前沿。Meta-Harness发现了广泛的精度-成本权衡曲线,全面优于对比方法。

2. 检索增强数学推理(Retrieval-Augmented Math)

在200道IMO级别数学难题上测试,检索库包含超过50万个解题过程。

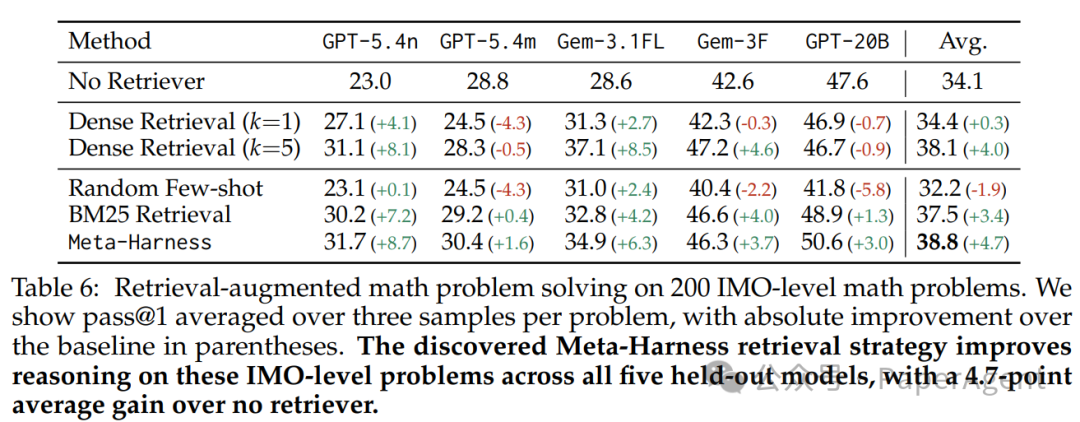

表6:检索增强数学问题求解。Meta-Harness发现的单个检索策略在5个未见过的模型上均带来性能提升,平均比无检索基线高4.7分。

惊人发现:Meta-Harness发现的检索Harness展现了出色的跨模型泛化能力,在GPT-5.4-nano、Gemini-3-Flash等五个不同规模和家族的模型上均能一致性地提升推理成绩,平均提升4.7分,表现优于传统的BM25和稠密检索方法。

3. Agentic编码:TerminalBench-2

在包含89个高难度终端任务(需要长程自主执行)的TerminalBench-2基准上进行评估。

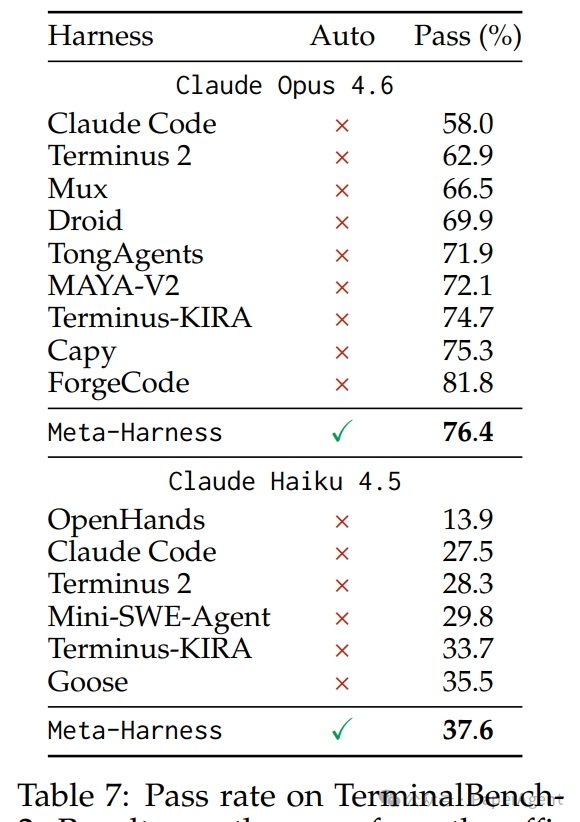

表7:TerminalBench-2通过率。Meta-Harness在Claude Opus 4.6上达到76.4%,排名第二;在更弱的Claude Haiku 4.5上达到37.6%,排名第一。

性能突破:

- 在强大的Claude Opus 4.6模型上,通过率76.4%,超越了众多知名人工设计的Agent框架(如Terminus-KIRA)。

- 在能力较弱的Claude Haiku 4.5模型上,提升更为显著,达到37.6%的通过率,位列榜首,证明了优化Harness对于释放较小模型潜力的重要性。

- 发现的关键机制之一是环境引导(Environment Bootstrapping):在Agent主循环开始前,先执行Shell命令收集系统环境信息并注入提示,节省了3-5轮的初始探索步骤。

深入分析

信息访问的消融实验

是什么让Meta-Harness如此有效?研究对比了三种不同信息访问权限的配置:

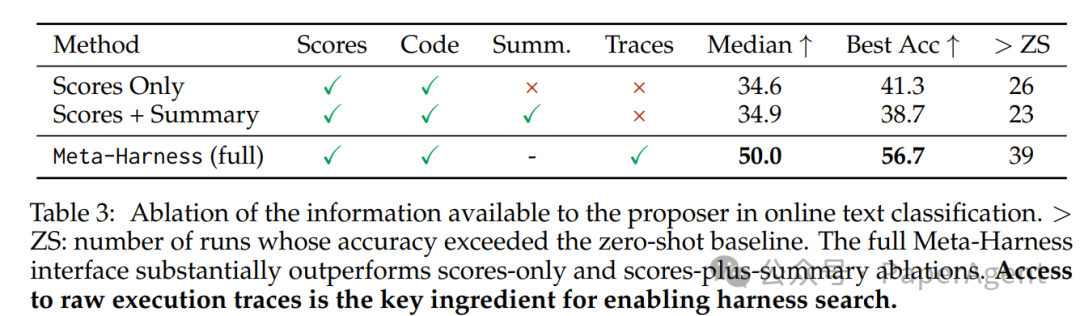

表3:Proposer信息消融实验结果。仅能访问分数时,最佳精度为41.3%;能访问分数和摘要时,为38.7%;能访问完整信息(含原始执行轨迹)时,最佳精度跃升至56.7%。

核心结论:访问原始执行轨迹是Harness搜索成功的关键要素。仅提供分数或LLM生成的摘要反而会压缩掉对诊断至关重要的信息,导致性能下降。

发现的Harness示例

Meta-Harness能够自动发现复杂且有效的Harness结构,例如:

Draft-Verification 分类Harness:

# 两阶段流程

Stage 1: 检索5个相似示例 → 生成Draft标签D

Stage 2: 检索5个确认者(=D) + 5个挑战者(≠D) → 验证或修正D

Label-Primed Query Harness:

构建一个包含“标签提示块”、“覆盖块”(每类标签最相关示例)和“对比块”(相似但标签不同的示例对)的大型综合提示。

总结与资源

Meta-Harness的工作表明,将深度学习与Agent系统的优化从“黑盒”提示工程转向“白盒”的、基于完整代码与执行历史的自动化搜索,是一条极具潜力的技术路径。它不仅能显著提升性能,还能发现人类难以直观设计的高效算法。

论文与代码:

- 论文地址:

https://arxiv.org/pdf/2603.28052

- 项目主页:

https://yoonholee.com/meta-harness/

- 优化后的Harness代码:

https://github.com/stanford-iris-lab/meta-harness-tbench2-artifact

对于希望深入探索大模型微调、Agent系统设计与优化的开发者,持续关注此类前沿研究并将思路付诸实践至关重要。也欢迎大家在云栈社区交流相关技术心得与实战经验。