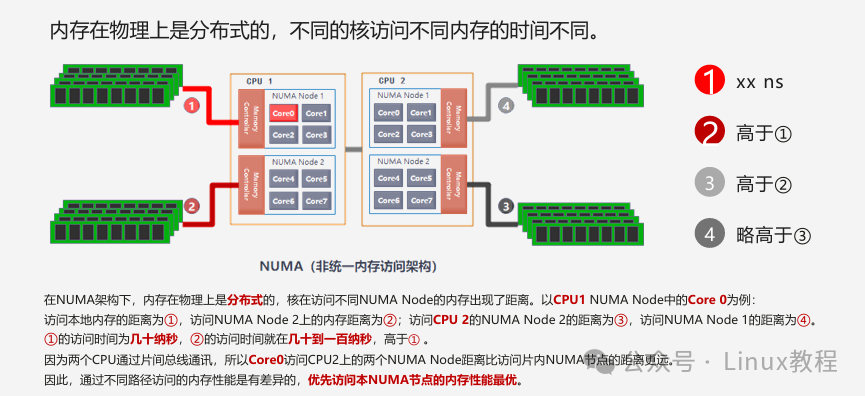

在现代多处理器系统中,NUMA(非一致性内存访问,Non-Uniform Memory Access)架构是优化内存访问性能的关键。它通过将系统划分为多个节点(Node),让每个节点拥有本地CPU和内存,从而解决了传统SMP(对称多处理器)架构中共享总线带来的扩展瓶颈。理解NUMA,对于深入掌握Linux内核的调度与内存管理机制至关重要。

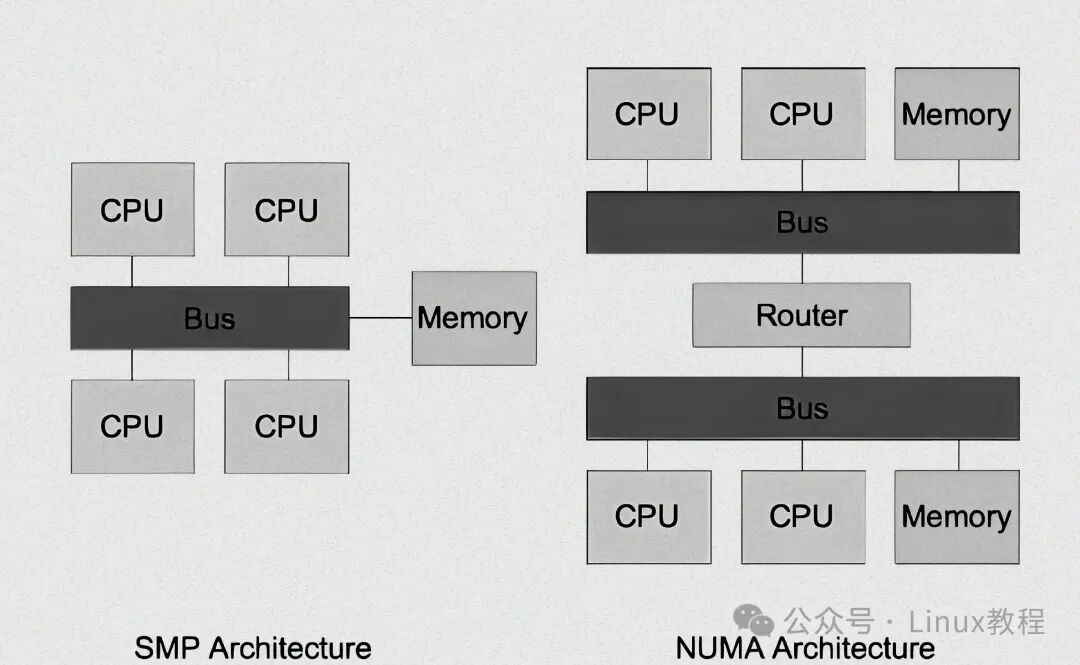

一、NUMA 与 UMA、SMP 架构对比

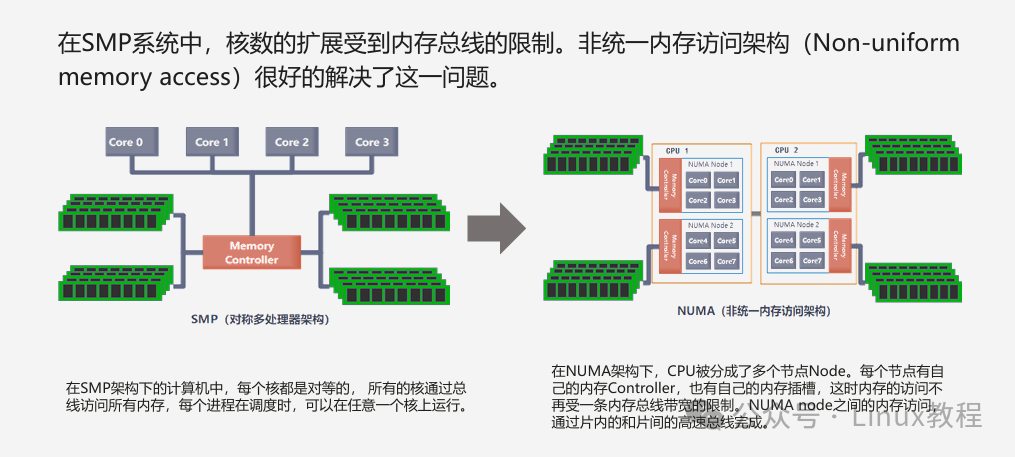

要理解NUMA的优势,对比传统的UMA和SMP架构会更直观。UMA是SMP架构的典型内存模式,所有CPU通过单一总线共享一个内存池,无论哪个CPU访问内存,延迟都一致。这种设计在早期多处理器系统中够用,但随着CPU数量增加,总线很快成为瓶颈,内存访问冲突加剧,性能提升受限。

NUMA则打破了这种“统一访问”的局限,采用分布式内存布局,每个节点拥有独立内存,从根源上解决了SMP架构的扩展瓶颈。比如32核以上的大型服务器,SMP架构会因总线争用导致延迟飙升,而NUMA可将CPU划分到不同节点,节点内CPU访问本地内存的效率不受其他节点影响。不过NUMA也带来了新挑战——如何优化跨节点内存访问,避免高延迟拖慢性能。

| 概念 |

描述 |

| SMP |

称为共享存储型多处理机(Shared Memory mulptiProcessors), 也称为对称型多处理机(Symmetry MultiProcessors) |

| UMA |

称为均匀存储器存取(Uniform-Memory-Access) |

| NUMA |

非均匀存储器存取(Nonuniform-Memory-Access) |

二、NUMA 系统架构详解

2.1 NUMA 架构定义与关键特性

不同于UMA架构的“统一内存访问”,NUMA将系统划分为多个相对独立的节点,每个节点都是一个紧密耦合的计算单元,包含一组CPU核心、本地内存和内存控制器。这种设计的核心,就是最大化利用本地内存的高效性,减少共享总线带来的冲突和延迟。

其核心特点一是本地内存优先访问:CPU就近读写本地内存,低延迟、高带宽,大幅提升多线程与大数据业务(如数据库)性能;

二是cc-NUMA 缓存一致性:依托 MESI 及 MESIF、MOESI 等扩展协议同步多节点缓存状态,保障跨节点数据一致与系统稳定。

2.2 NUMA 系统组成

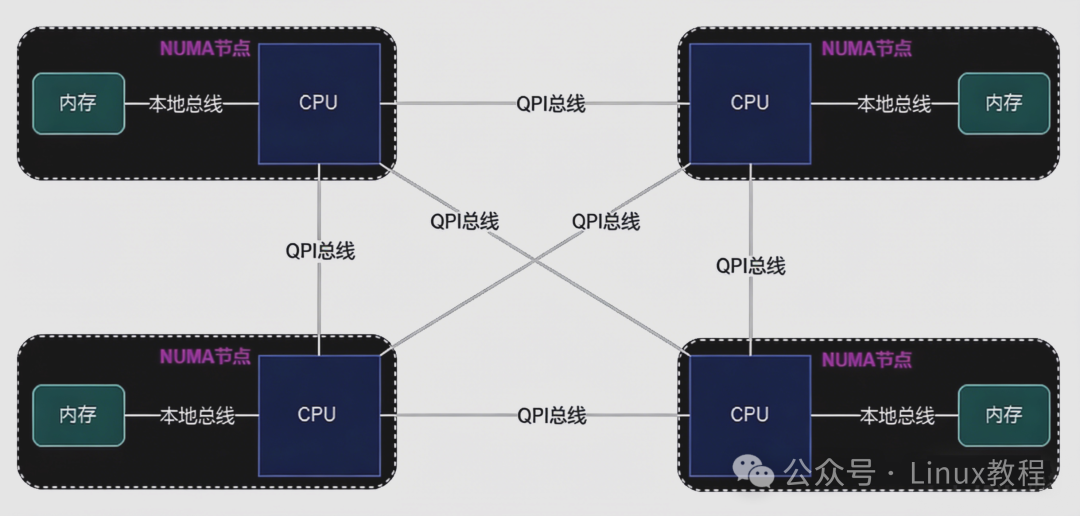

节点是NUMA系统的基本单元,通常对应一个物理CPU插槽,包含多个CPU核心,这些核心共享节点内的L3缓存,能快速访问本地内存。比如一颗16核CPU,其16个核心及对应的内存,就构成一个NUMA节点。

本地内存直接连接节点内的内存控制器,与CPU紧密耦合,是节点性能的关键——本地内存的容量和速度,直接决定节点的计算和数据处理能力,服务器中CPU插槽旁的内存插槽,对应的就是该节点的本地内存。

互联模块是节点间的“桥梁”,负责数据传输和通信,常见的有Intel QPI、UPI和AMD Infinity Fabric,它们提供高带宽、低延迟的通信通道,保障跨节点访问和缓存一致性。在Linux中,用“numactl --hardware”就能查看节点数量、CPU/内存配置及节点间延迟,是运维调优的常用命令。

2.3 NUMA 工作原理

NUMA 架构的工作原理基于其独特的内存访问模型。在 NUMA 系统中,内存访问路径分为本地访问和远程访问两种。

本地访问是指 CPU 访问其所在节点的本地内存,这种访问路径最短,延迟最低,带宽最高。因为本地内存与 CPU 之间通过高速的内部总线连接,数据传输几乎没有额外的开销。例如,在一个数据库查询操作中,如果数据存储在本地内存,CPU 能够迅速读取数据并进行处理,大大提高查询效率。

远程访问则是指 CPU 访问其他节点的内存。这种访问需要通过节点间的互联模块进行数据传输,因此延迟较高,带宽相对较低。当一个节点的 CPU 需要访问远程内存时,数据首先会被发送到互联模块,然后通过互联总线传输到目标节点,再由目标节点的内存控制器将数据传递给请求的 CPU。这一过程涉及多个环节,每个环节都会引入一定的延迟,导致远程访问的效率明显低于本地访问。例如,在分布式计算任务中,如果不同节点的计算任务需要频繁访问对方节点的内存,就会因为远程访问延迟而影响整个任务的执行效率。

为了确保多节点系统中数据的一致性,cc-NUMA 采用了缓存一致性协议。以 MESI 协议为例,它定义了缓存行的四种状态:修改(Modified)、独占(Exclusive)、共享(Shared)和无效(Invalid)。当一个 CPU 读取内存数据时,首先会检查缓存中是否有该数据。如果缓存中有且处于共享或独占状态,CPU 可以直接从缓存中读取数据;如果缓存中没有或者缓存行处于无效状态,CPU 会从内存中读取数据,并将缓存行状态设置为共享或独占。当一个 CPU 修改了缓存中的数据时,缓存行状态会变为修改,此时该 CPU 会通过互联模块向其他节点发送消息,通知它们将对应的缓存行状态设置为无效。这样,当其他节点的 CPU 再次访问该数据时,就会发现缓存行无效,从而从内存中读取最新的数据,保证了数据的一致性。

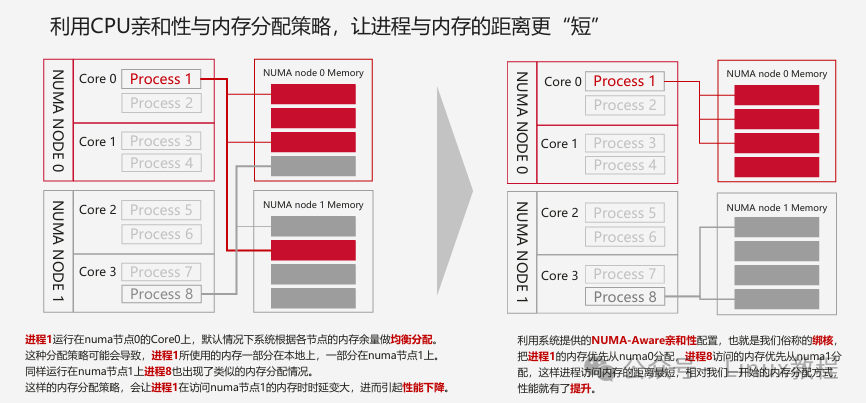

Linux内核的页面分配器,会优先从进程所在节点分配内存,减少远程访问概率;只有本地内存不足时,才会考虑其他节点,这一策略从内核层面优化了内存访问性能。

2.4 NUMA 拓扑结构

NUMA拓扑的核心指标是节点间距离(distance),通过“numactl --hardware”的“node_distance”参数可查看,数值越小,节点间延迟越低——本地节点访问距离通常为10,跨节点则在20以上,直观体现了本地与远程访问的延迟差距。

节点间带宽也存在明显差异,互联技术不同,带宽差距很大。比如Intel UPI总线单向带宽可达25.6GB/s,AMD Infinity Fabric也有出色表现。对于分布式数据库同步等需要大量跨节点传输的场景,高带宽能显著提升效率;反之,低带宽会成为性能瓶颈。

示例输出(双节点服务器):

numactl -H

available: 2 nodes (0-1)

node 0 cpus: 0 1 2 3 4 5 6 7

node 0 size: 32126 MB

node 0 free: 18568 MB

node 1 cpus: 8 9 10 11 12 13 14 15

node 1 size: 32128 MB

node 1 free: 19234 MB

node distances:

node 0 1

0: 10 20

1: 20 10

输出中清晰可见节点数量、各节点CPU核心、内存大小及节点间距离,距离值越大,跨节点访问延迟越高。

假设通过命令查看发现,节点 0 的本地距离值为 10,而访问节点 1 的距离值为 20,这就意味着节点 0 访问节点 1 的远程内存时,延迟是本地访问的 2 倍。这种延迟差异会对应用程序的性能产生显著影响,尤其是在频繁进行跨节点内存访问的场景下。

此外,节点间互联链路的带宽也远低于本地内存总线带宽。本地内存总线带宽通常能够满足节点内 CPU 对内存的高速访问需求,而节点间互联链路在面对大量跨节点数据传输时,容易成为性能瓶颈。因此,在进行应用程序设计和系统调优时,必须充分考虑 NUMA 拓扑结构的差异,合理分配任务和内存,尽量减少跨节点访问,以充分发挥系统性能 。

三、Linux 内核中的 NUMA 实现机制

在 Linux 内核的启动过程中,它会借助 ACPI 规范中的 SRAT(系统资源亲和性表)和 SLIT(系统局部性信息表),来精准识别硬件的 NUMA 拓扑结构 。其中,SRAT 表详细记录了 CPU 核与内存的对应关系,比如每个节点中包含哪些 CPU 逻辑核以及与之关联的内存信息;而 SLIT 表则记录了各个节点之间的距离,这些距离信息对于内核判断内存访问的延迟程度至关重要。

当内核完成对这些信息的读取和解析后,便会在启动阶段调用一系列初始化函数,如 x86_numa_init、numa_init、x86_acpi_numa_init,最终执行到 acpi_numa_init 函数来解析 SRAT 表 。在这个过程中,内核会将内存与节点的关联信息,精心存储在 numa_meminfo 数据结构中,这个数据结构就像是一本详细的 “内存地图”,每一项都是由(起始地址,结束地址,节点编号)组成的三元组,清晰地描述了内存块与 NUMA 节点的对应关系 。

// 解析SRAT表,初始化NUMA节点内存映射

int __init acpi_numa_init(void) {

struct acpi_table_srat *srat;

acpi_status status;

// 获取SRAT表

status = acpi_get_table(ACPI_SIG_SRAT, 0, (struct acpi_table_header **)&srat);

if (ACPI_FAILURE(status)) {

pr_warn("ACPI SRAT table not found, NUMA disabled\n");

return -EINVAL;

}

// 解析SRAT表中的CPU与内存关联信息

acpi_srat_parse_entries(srat);

return 0;

}

3.1 内存管理中的 NUMA 支持

Linux内核通过mempolicy子系统,实现了三种核心NUMA内存分配策略,旨在充分利用 NUMA 架构的优势,提升内存访问性能。核心策略包括 MPOL_BIND、MPOL_INTERLEAVE 和 MPOL_PREFERRED。

MPOL_BIND 是一种强制绑定策略,它要求进程的内存分配严格限定在指定的节点上 。如果指定节点的内存不足,进程将无法分配到足够的内存,进而触发 OOM(Out - Of - Memory)机制,被系统终止。这种策略适用于对内存局部性要求极高的应用场景,如某些实时数据库的核心数据处理模块,确保关键数据始终存储在本地节点,以获得最快的访问速度。

MPOL_INTERLEAVE 则采用跨节点轮询分配的方式,进程的内存页会在指定的多个节点间交替分配。这种策略对于那些需要大量内存且对内存访问延迟不太敏感,但对内存带宽要求较高的应用较为适用,比如大规模数据处理任务中的中间结果存储。通过在多个节点间均匀分配内存,能够充分利用各个节点的内存带宽,避免单个节点带宽成为瓶颈。

MPOL_PREFERRED 是一种较为灵活的策略,它优先尝试在进程指定的首选节点上分配内存。如果首选节点内存不足,进程会自动降级,尝试从其他节点分配内存。这种策略兼顾了内存局部性和分配的灵活性,适用于大多数普通应用,在保证尽量使用本地内存的同时,也能在本地内存不足时维持进程的正常运行。

内核默认采用本地分配策略,进程启动后,优先从所在节点分配内存——这对数据库等内存密集型应用尤为重要,能确保频繁访问的数据留在本地,提升读写效率。

NUMA API 与工具(numactl、libnuma)

numactl是NUMA管理的核心工具,用“numactl --hardware”可查看拓扑信息,用“numactl --cpunodebind=0 --membind=0”能将进程绑定到指定节点的CPU和内存,确保本地访问。不过它生效的前提是BIOS开启SRAT/SLIT表,且内核未禁用NUMA(无numa=off参数)。

libnuma则为开发者提供了细粒度编程接口,比如numa_alloc_local()可直接申请本地内存,比标准malloc更高效。需注意,numactl仅对新进程生效,无法修改已有进程的内存策略,运行中进程需通过特定系统调用调整。

3.2 进程调度中的 NUMA 亲和性

线程绑定是NUMA优化的关键,能避免线程在不同CPU间频繁切换,提升缓存命中率。Linux中,taskset命令可快速绑定进程CPU,比如“taskset -p 0x1 1234”将PID1234绑定到CPU0;多线程应用则可通过pthread_setaffinity_np函数,在代码层面实现线程级绑定。

核心注意点:CPU绑定必须配合内存绑定,否则可能出现“线程在节点1运行、内存从节点0分配”的跨节点访问,反而降低性能。绑定后可通过“cat /proc/PID/status”,查看Cpus_allowed和Mems_allowed验证效果。

Linux内核调度器自带NUMA感知能力,通过numa_balancing机制,实时检测进程内存访问热点,将进程迁移到数据所在节点,实现“计算靠近数据”。

内核调度器会实时统计进程的本地内存命中率,即进程访问本地内存的次数与总内存访问次数的比例。如果一个进程的远程内存访问次数过多,导致本地内存命中率过低,调度器会认为该进程存在内存访问效率问题,进而触发页面迁移或进程迁移操作。在数据库应用中,当一个查询任务频繁访问远程内存中的数据时,内核调度器可能会将该查询任务对应的进程迁移到数据所在的节点,或者将相关的数据页面迁移到进程当前所在的节点,以提高内存访问效率。

对于单节点系统,由于不存在跨节点内存访问的问题,numa_balancing 机制的作用并不明显,反而可能会增加调度开销。因此,在单节点系统中,可以通过修改内核参数 kernel.numa_balancing=0 来禁用 numa_balancing 机制,降低系统的调度负担,提升系统性能。

3.3 系统调用与性能监控

numastat是NUMA监控的核心工具,核心指标numa_hit(本地命中数)和numa_miss(远程访问数),直接反映内存局部性——numa_hit越高、numa_miss占比越低,性能越好;若numa_miss占比超5%,就说明存在跨节点访问瓶颈。

perf工具则可定位NUMA相关热点函数,用“perf record -e mem:trace_mm_page_alloc -g”记录内存分配事件,再通过perf report分析,能精准找到内存分配、页面迁移等耗时操作,为优化提供依据。

正如前面提到的,numa_hit 是衡量内存局部性的重要指标,它直观地反映了进程在本地内存访问方面的成功率。高numa_hit意味着进程数据多在本地内存,能快速访问;numa_miss过高则会拖慢性能。通过“/proc/PID/numa_maps”,可查看单个进程的访问统计,若MPOL_PREFERRED策略下numa_miss不为0,需排查内存碎片化或THP干扰。

四、NUMA 感知的应用程序优化

4.1 内存分配优化

在应用程序层面,充分利用 NUMA 架构的优势,需要对内存分配进行精细控制。通过 libnuma 库提供的 numa_alloc_local() 或 numa_alloc_onnode() 函数,可以直接从进程所在节点或指定节点分配本地内存 。以 numa_alloc_local() 为例,它能够在当前线程所在的 NUMA 节点上分配内存,避免了跨节点内存分配带来的高延迟。与标准的 malloc() 函数相比,numa_alloc_local() 函数在 NUMA 架构下具有明显的性能优势,它显著降低了远程内存访问的概率,使得内存访问更加高效。

在使用这些函数时,需要在编译时链接 libnuma 库,即通过 “-lnuma” 参数将 libnuma 库链接到应用程序中。同时,要确保系统已启用 NUMA 支持,否则这些函数会退化为普通的内存分配函数,无法发挥 NUMA 架构的性能优势。在一个内存密集型的数据分析应用中,使用 numa_alloc_local() 函数分配本地内存,能够大幅提升数据读取和处理的速度,加快分析任务的完成时间。

避免跨节点内存分配的核心策略是实现 “内存与 CPU 的强绑定”。通过 numactl 工具的 --membind 选项,可以强制进程的内存分配限定在指定的节点上,确保内存访问的局部性。例如,使用 “numactl --membind=0 ./app” 命令,可将应用程序 “app” 的内存分配限制在节点 0 上,有效避免跨节点内存分配。

关闭透明大页(THP,Transparent Huge Pages)也是避免跨节点分配的重要措施。THP 旨在提高内存管理效率,通过将多个 4KB 的小页合并成 2MB 或 1GB 的大页来减少页表项数量,降低内存管理开销。然而,在 NUMA 系统中,THP 的大页分配机制可能会因为节点内存不足而触发跨节点分配,导致内存访问延迟增加。因此,在 NUMA 架构下,建议关闭 THP,以保证内存分配策略的有效性。可以通过修改 “/sys/kernel/mm/transparent_hugepage/enabled” 文件,将其值设置为 “never” 来关闭 THP。

在生产环境中,为了进一步减少内存分配失败的风险,还可以结合内存预留机制,提前为关键进程预留足够的本地内存空间。通过合理配置内存预留参数,确保在系统内存紧张时,关键进程仍能从本地节点获取所需内存,避免因内存不足而被迫进行跨节点分配。

4.2 线程绑定与 CPU 亲和性

在 NUMA 架构下,线程绑定和 CPU 亲和性的设置对于优化性能至关重要。taskset 命令是一种简单有效的工具,用于将进程绑定到指定的 CPU 核心。例如,“taskset -c 0-3 ./app” 命令可以将应用程序 “app” 绑定到 CPU 核心 0 到 3 上运行,通过限制进程在特定 CPU 核心上执行,减少了线程在不同核心间迁移带来的上下文切换开销,提高了 CPU 缓存的命中率。

对于多线程应用程序,使用 pthread_setaffinity_np 函数可以在代码层面实现更细粒度的线程绑定。该函数允许将特定线程固定到指定的 CPU 核心上,进一步提升线程执行的效率和稳定性。在一个多线程的网络服务器应用中,通过将负责网络 I/O 处理的线程绑定到特定的 CPU 核心,能够避免线程迁移导致的网络数据包处理延迟,提高服务器的响应速度和吞吐量。

在实践中,遵循 “CPU 节点与内存节点一致” 的原则至关重要。在将线程绑定到特定 CPU 核心之前,需要确保该 CPU 核心所在的节点与线程所需内存分配的节点一致,否则可能会出现 “线程在节点 1 运行,内存从节点 0 分配” 的跨节点访问问题,反而降低性能。在完成线程绑定后,可以通过 “taskset -p” 命令查看线程的 CPU 亲和性设置,以及通过 “numastat” 命令查看内存访问统计信息,验证绑定效果,确保线程与内存的协同工作达到最优状态。

4.3 数据局部性设计

数据局部性是 NUMA 优化的关键 ,需将高频访问数据存储在对应节点的本地内存中 。例如,数据库可采用分表策略,将表数据分片存储到各节点 。假设一个电商数据库,可按商品类别将数据分表存储,将高频访问的热门商品数据存储在节点 0 的本地内存中,而低频访问的商品数据存储在其他节点 。这样,当用户查询热门商品时,数据库能够快速从本地内存中获取数据,大大提高了查询效率 。

在并行计算任务中,可按节点拆分数据 。比如一个大规模的图像识别任务,可将图像数据按区域拆分成多个分片,每个节点负责处理本地分片的数据 。节点 0 处理图像的左上角区域,节点 1 处理右上角区域,以此类推 。这样,每个节点只需访问本地内存中的数据分片,减少了跨节点数据传输,大幅提升了计算效率 。

4.4 性能调优方法论

使用 perf/numastat 定位瓶颈

NUMA 性能调优的首要任务是精准定位性能瓶颈。numastat 工具在这一过程中发挥着关键作用,通过它可以查看 numa_hit 和 numa_miss 的占比情况。如果 numa_miss 占总内存访问次数的比例超过 5%,则表明系统中存在较为严重的跨节点访问问题,需要进一步深入分析。在一个运行着多个服务的服务器中,通过 numastat 发现某个服务的 numa_miss 比例高达 10%,这就提示我们需要检查该服务的内存分配和使用情况,看是否可以通过调整 NUMA 配置来优化性能。

perf 工具则是深入分析热点函数的有力武器。通过 perf record -e mem:trace_mm_page_alloc -g 命令,可以记录内存分配相关的事件,并生成性能数据文件。然后,使用 perf report 命令对数据文件进行分析,能够清晰地识别出内存分配、页面迁移等耗时操作的具体函数和代码位置。在一个复杂的应用程序中,通过 perf 分析发现某个内存分配函数在分配大内存块时存在性能问题,经过优化后,减少了不必要的内存分配和跨节点访问,从而提升了整个应用的性能。

在定位瓶颈时,还可以结合 /sys/kernel/debug/numa/ 拓扑文件,排查内核 NUMA 初始化异常,确保硬件与内核配置正确,从多个维度全面分析性能瓶颈的根源。

动态调优与测试验证

NUMA 调优是一个持续迭代的过程,需要遵循 “测试 - 优化 - 验证” 的流程。针对不同的应用场景,需要灵活调整内存策略。对于数据库应用,由于其对数据一致性和访问延迟要求极高,通常采用 MPOL_BIND 策略,确保数据存储和访问的局部性;而对于批量数据处理任务,更适合采用 MPOL_INTERLEAVE 策略,以充分利用多个节点的内存带宽。

由于 Linux 内核目前不支持动态修改进程内存策略,在需要动态调整内存分配策略时,可通过应用层的 move_pages 系统调用实现页面热迁移。在一个实时数据处理系统中,随着工作负载的变化,通过 move_pages 系统调用将部分内存页面迁移到负载较低的节点,实现内存资源的动态优化。

在完成每一轮调优后,必须对比吞吐量、延迟等关键指标,验证优化效果。通过性能测试工具,如 sysbench、iperf 等,在优化前后分别对系统进行性能测试,对比测试结果,评估调优措施是否达到预期效果。如果性能没有明显提升,甚至出现下降,就需要重新分析问题,调整优化策略,继续进行下一轮的优化和验证,直到系统性能达到最优状态。

五、NUMA 核心应用场景与优化实践

5.1 数据库管理系统(MySQL、Oracle)

InnoDB 存储引擎的 NUMA 优化

在 MySQL 数据库中,InnoDB 存储引擎的 NUMA 优化是提升性能的关键环节,其核心在于实现 “缓冲池本地化”。通过 numactl 工具将 mysqld 进程绑定到指定的 NUMA 节点,能够确保缓冲池内存从本地节点分配,极大地减少了远程内存访问的延迟。例如,在一个具有双 NUMA 节点的服务器上,通过 “numactl --cpunodebind=0 --membind=0 /usr/sbin/mysqld” 命令,可将 MySQL 服务的进程和内存分配都限制在节点 0 上,使得 InnoDB 缓冲池能够高效地利用本地内存资源。

禁用透明大页(THP)也是优化的重要步骤。THP 在某些情况下可能导致内存分配失败,尤其是在 NUMA 架构下,可能引发跨节点内存分配,从而降低性能。通过修改 “/sys/kernel/mm/transparent_hugepage/enabled” 文件,将其值设置为 “never”,可以有效避免 THP 带来的问题。

调整 InnoDB 缓冲池大小不超过节点内存容量,也是确保内存分配在本地节点的重要策略。如果缓冲池设置过大,超过了本地节点的内存容量,就可能导致内存分配到其他节点,增加远程内存访问的概率。因此,需要根据节点内存大小和实际业务需求,合理配置缓冲池大小,如通过修改 my.cnf 配置文件中的 “innodb_buffer_pool_size” 参数,确保缓冲池内存分配在本地节点,提高数据访问的效率。

InnoDB 的 redo 日志写入路径也可以进行优化,将 redo 日志文件存储到节点本地磁盘,减少 I/O 操作的延迟。通过调整 “innodb_log_group_home_dir” 参数,将日志文件路径设置为本地磁盘目录,能够加快日志写入速度,提升事务处理的性能。

避免跨节点数据交互的策略

在数据库管理系统中,避免跨节点数据交互是提升性能的关键策略。通过将网卡中断亲和性绑定到数据库进程所在的 NUMA 节点,可以显著减少数据包跨节点的 DMA 传输,降低数据传输延迟。在一个运行 MySQL 数据库的服务器中,使用 irqbalance 工具将网卡中断绑定到 MySQL 进程所在的节点,能够有效提高网络数据的处理速度,减少因跨节点传输导致的延迟。

对于主从架构的数据库系统,将主节点和从节点分别部署在不同的 NUMA 节点,可以避免资源竞争,提升数据同步的效率。主节点主要负责写操作,从节点负责读操作,通过合理的节点分配,能够减少主从节点之间的资源冲突,确保数据同步的及时性和准确性。

定期监控数据库进程的 numa_hit 和 numa_miss 指标,是及时发现和解决跨节点数据交互问题的重要手段。通过 numastat 工具查看这些指标,若发现 numa_miss 数值过高,就需要检查数据库的配置和数据分布情况,调整绑定策略,优化内存分配,以减少跨节点数据交互,提升数据库的整体性能。

5.2 虚拟化与云计算

KVM/QEMU 的 vNUMA 支持

KVM 虚拟化技术通过 vNUMA(虚拟非统一内存访问)技术,将物理 NUMA 拓扑暴露给虚拟机,为虚拟机提供了更高效的内存访问模式。在 libvirt XML 配置文件中,可以通过设置 “numa” 标签来定义虚拟机的 vNUMA 拓扑结构。例如,以下配置将虚拟机的 vCPU 和内存分别绑定到不同的物理 NUMA 节点:

<domaintype='kvm'>

<numa>

<cellid='0'cpus='0-7'memory='8192'unit='MiB'/>

<cellid='1'cpus='8-15'memory='8192'unit='MiB'/>

</numa>

<vcpuplacement='static'>16</vcpu>

<memoryunit='MiB'>16384</memory>

<!-- 其他配置项 -->

</domain>

在这个配置中,cell 标签定义了两个 NUMA 节点,每个节点包含 8 个 vCPU 和 8GB 内存。通过这种方式,虚拟机的 vCPU 可以优先访问本地内存,避免跨节点内存访问带来的高延迟,从而提升虚拟机的性能。

启用 vNUMA 时,需要注意虚拟机的 vCPU 数量不宜超过单个物理节点的 CPU 核心数。如果 vCPU 数量过多,可能导致部分 vCPU 无法绑定到本地节点,从而增加跨节点调度和内存访问的概率,降低虚拟机的性能。因此,在配置虚拟机时,需要根据物理服务器的 NUMA 拓扑结构和实际业务需求,合理设置 vCPU 数量和内存分配,确保虚拟机能够充分利用 vNUMA 技术的优势。

Kubernetes 的 NUMA 亲和性调度(Volcano 插件)

Kubernetes 作为容器编排的核心工具,默认的调度器在处理 NUMA 拓扑时存在一定的局限性,而 Volcano 插件的出现,有效解决了这一问题。Volcano 通过自定义资源定义(CRD)和插件机制,扩展了 Kubernetes 的调度能力,实现了强大的 NUMA 亲和性调度功能。

在使用 Volcano 插件时,首先需要在 Kubernetes 集群中部署 Volcano 组件。通过 Helm 图表或 YAML 文件进行部署,确保 Volcano 的调度器和控制器能够正常运行。部署完成后,就可以在 Pod 的定义文件中使用 Volcano 提供的调度策略,实现 Pod 与 NUMA 节点的亲和性调度。例如,在 Pod 的 YAML 文件中添加以下注解:

apiVersion: v1

kind: Pod

metadata:

name: numa-aware-pod

annotations:

volcano.sh/numa-policy: "preferred"

spec:

containers:

- name: my-container

image: my-image

resources:

requests:

cpu: "2"

memory: "1Gi"

limits:

cpu: "2"

memory: "1Gi"

在这个示例中,“volcano.sh/numa-policy: "preferred"” 注解表示该 Pod 优先调度到满足其 CPU 和内存需求的 NUMA 节点上,以实现 “Pod 与资源同节点” 的目标,减少跨节点资源访问的延迟。

结合 Kubernetes 的 CPU 管理器的静态策略,Volcano 可以进一步提升调度的精细化程度。通过设置 “cpuManagerPolicy: static”,可以将 Pod 的 CPU 核心绑定到指定的 NUMA 节点,确保 CPU 和内存的访问都在本地节点进行,提高 Pod 的性能稳定性。在运行对 CPU 和内存性能要求较高的应用程序时,这种结合使用的方式能够显著提升应用的运行效率,满足业务对高性能计算的需求。

5.3 高性能计算(HPC)

并行任务的 NUMA 亲和性绑定

在高性能计算领域,并行任务的高效执行离不开 NUMA 亲和性绑定策略。以 MPI(Message Passing Interface)程序为例,采用 “按节点分片” 的调度策略是提升性能的关键。通过 mpirun 命令的 --bind-to 选项,可以将不同的任务进程绑定到不同的 NUMA 节点上,实现计算任务与内存资源的本地匹配,避免跨节点通信带来的高延迟。例如,在一个具有 4 个 NUMA 节点的 HPC 集群中,使用以下命令启动 MPI 程序:

mpirun --bind-to socket --map-by socket:pe=4-np16 ./mpi_app

这个命令将 16 个 MPI 进程按照每 4 个进程一组,分别绑定到 4 个 NUMA 节点上(每个节点对应一个物理插槽),确保每个进程都能在本地节点内高效地访问内存和 CPU 资源,减少跨节点通信开销,提升大规模并行计算的效率。

结合 OpenMP(Open Multi-Processing)线程亲和性设置,可以进一步优化并行任务的执行。在 OpenMP 程序中,通过设置环境变量 KMP_AFFINITY,将线程绑定到特定的 CPU 核心,并且确保这些核心位于同一 NUMA 节点内。例如,设置 “export KMP_AFFINITY=granularity=fine,compact,1,0”,可以使 OpenMP 线程按照细粒度的方式,紧凑地绑定到同一 NUMA 节点的 CPU 核心上,提高 CPU 缓存的命中率,减少线程间的资源竞争,进一步提升并行计算的性能。

大规模集群中的 NUMA 拓扑管理

在大规模 HPC 集群中,统一管理 NUMA 拓扑是确保集群性能的关键。集群管理工具如 Slurm,能够收集各节点的详细信息,包括 CPU 核心数、内存容量、节点间的互联参数(如延迟和带宽),并将这些信息整合到一个拓扑数据库中。通过这个数据库,调度器可以根据任务的需求,精确地匹配最优的节点组合,避免将任务分配到互联延迟高的节点上,从而提高整个集群的运行效率。

在提交一个大规模的分子动力学模拟任务时,任务需要大量的计算资源和高速的内存访问。Slurm 调度器会根据拓扑数据库中的信息,选择一组内存带宽高、节点间延迟低的节点来运行任务,确保任务能够高效地执行。同时,通过实时监控节点间的带宽利用率,当发现某个节点间的带宽接近饱和时,调度器会调整任务分配策略,将部分任务迁移到其他带宽充裕的节点上,防止互联总线成为性能瓶颈,保障集群的稳定运行。

5.4 云原生与容器调度

NUMA-aware 的 Pod 调度策略

在云原生环境中,实现 NUMA-aware 的 Pod 调度策略是充分利用硬件资源、提升应用性能的关键。Kubernetes 通过节点亲和性和 Pod 亲和性规则,为实现这一策略提供了基础。通过设置节点亲和性规则,可将 Pod 调度到具有特定标签的 NUMA 节点上。例如,在 Pod 的 YAML 文件中添加如下配置:

apiVersion: v1

kind: Pod

metadata:

name: numa-aware-pod

spec:

affinity:

nodeAffinity:

requiredDuringSchedulingIgnoredDuringExecution:

nodeSelectorTerms:

- matchExpressions:

- key: numa-node

operator: In

values:

- "0"

containers:

- name: my-container

image: my-image

resources:

requests:

cpu: "2"

memory: "1Gi"

limits:

cpu: "2"

memory: "1Gi"

上述配置表示该 Pod 会被调度到标签为 “numa-node: 0” 的 NUMA 节点上,实现了 Pod 与特定 NUMA 节点的亲和性调度。通过这种方式,Pod 内的容器可以优先访问本地节点的资源,减少跨节点访问的延迟,提升应用的性能。

结合资源配额限制,可进一步确保 Pod 的资源使用符合预期。通过设置 requests 和 limits 字段,限制 Pod 对 CPU 和内存的使用量,避免单个 Pod 占用过多资源,导致其他 Pod 因资源不足而性能下降。在一个多租户的云原生环境中,合理的资源配额限制可以保证每个租户的应用都能获得足够的资源,同时避免资源浪费和性能干扰。

CPU 管理策略与拓扑感知

Kubernetes 的 CPU 管理器提供了多种策略来管理 Pod 的 CPU 资源,其中静态策略在结合 NUMA 拓扑感知时,能够实现 “Pod CPU 与内存同节点” 的高效资源分配。在 kubelet 配置文件中,设置 “cpuManagerPolicy: static” 和 “topologyManagerPolicy: single-numa-node”,可以启用这一功能。启用后,kubelet 会根据节点的 NUMA 拓扑信息,为 Pod 分配本地内存资源,并将 Pod 的 CPU 核心绑定到对应的 NUMA 节点上。在运行一个对内存和 CPU 性能要求都很高的大数据分析应用时,通过这种配置,应用的 Pod 可以在本地节点内高效地进行数据处理,避免了跨节点访问带来的性能损耗。

需要注意的是,静态策略仅适用于 Guaranteed QoS(Quality of Service)类型的 Pod。这类 Pod 在资源请求和限制上具有明确的定义,能够确保在运行过程中获得稳定的资源分配。对于 BestEffort 和 Burstable 类型的 Pod,由于其资源请求和限制的不确定性,静态策略无法有效发挥作用。因此,在实际应用中,需要根据 Pod 的 QoS 类型和业务需求,合理选择 CPU 管理策略,以充分利用 NUMA 架构的优势,提升云原生应用的性能。

六、Linux 实战:NUMA 配置与调优指南

6.1 查看 NUMA 拓扑信息

lscpu、numactl --hardware 命令

在 Linux 系统中,lscpu 和 numactl --hardware 是查看 NUMA 拓扑信息的重要工具。使用 lscpu 命令,能快速获取系统的 CPU 相关信息,其中就包含 NUMA 节点的分布情况。执行该命令后,会输出系统中各个 NUMA 节点的数量,以及每个节点所包含的 CPU 核心分布。这对于了解系统的硬件布局,判断应用程序的 CPU 亲和性和内存分配策略有很大帮助。例如,在一个具有双 NUMA 节点的服务器上,lscpu 命令可能会显示节点 0 包含 CPU 核心 0 - 7,节点 1 包含 CPU 核心 8 - 15,让我们直观地了解到系统的 CPU 分布情况。

numactl --hardware 命令则更为详细,它不仅展示了节点的 CPU 信息,还会输出每个节点的内存容量、空闲内存大小,以及节点间的距离(distance)信息。节点间距离反映了内存访问的相对延迟,数值越小表示节点间的内存访问延迟越低。通过该命令,我们可以清晰地看到系统中各个 NUMA 节点的资源配置和节点间的关系。在排查系统性能问题时,numactl --hardware 命令输出的信息能够帮助我们判断是否存在跨节点内存访问延迟过高的问题。若输出结果中仅显示 1 个节点,这通常表明 NUMA 功能未启用,此时需要检查 BIOS 设置中是否开启了 NUMA 相关选项,以及内核参数中是否存在禁用 NUMA 的配置,如是否包含 numa=off 参数,确保系统能够正确识别和利用 NUMA 架构。

/sys/devices/system/node 目录解析

/sys/devices/system/node 目录是 Linux 系统中存储 NUMA 节点详细信息的关键位置。在这个目录下,每个子目录对应一个 NUMA 节点,例如 node0、node1 等。进入 node0 目录,可以看到一系列与该节点相关的文件。其中,meminfo 文件记录了节点的内存使用情况,包括总内存、已用内存、空闲内存等信息,通过读取这个文件,我们可以了解到节点内存的实时状态,判断是否存在内存不足或内存浪费的情况。cpulist 文件则记录了该节点包含的 CPU 核心列表,明确了节点与 CPU 核心的对应关系。

通过编写脚本来读取这些文件,可以实现对 NUMA 拓扑信息的自动化监控和分析。在一个需要实时监控服务器 NUMA 性能的场景中,编写一个定时执行的脚本,定期读取 /sys/devices/system/node 目录下的文件,获取各个节点的内存使用情况和 CPU 负载信息,当发现某个节点的内存使用率过高或 CPU 负载不均衡时,及时发出警报,提醒管理员进行相应的调整和优化。这种自动化监控方式能够提高系统管理的效率,确保 NUMA 架构下的服务器始终处于最佳运行状态。

6.2 监控 NUMA 性能

numastat 实时分析

numastat 是监控 NUMA 性能的重要工具,它能够实时提供系统内存访问的详细统计信息,帮助我们深入了解系统的内存使用状况,从而发现潜在的性能问题。numastat 默认会输出系统级别的 NUMA 访问统计数据,包括每个 NUMA 节点的 numa_hit(本地内存命中数)、numa_miss(远程内存访问数)、numa_foreign(被其他节点远程访问数)等关键指标。

通过这些指标,我们可以直观地判断系统内存访问的局部性。如果 numa_hit 数值较高,说明大部分内存访问能够在本地节点完成,内存访问的效率较高;而如果 numa_miss 数值持续上升,甚至占总内存访问次数的比例较高,那就表明存在大量的跨节点内存访问,这可能会导致系统性能下降。在一个运行着多个服务的服务器中,如果发现某个服务的 numa_miss 数值异常高,就需要进一步分析该服务的内存分配和使用情况,看是否可以通过调整 NUMA 配置来优化性能。

numastat 还可以通过特定的参数查看单个进程的 NUMA 访问统计数据,这对于定位特定应用程序的内存访问问题非常有帮助。通过结合 watch 命令,如 watch -n 1 numastat,可以实现对 NUMA 性能指标的实时监控,每隔 1 秒更新一次数据,方便我们及时发现性能变化趋势,采取相应的优化措施。

perf top 识别热点函数与内存访问

perf top 是 Linux 系统中强大的性能分析工具,它可以实时显示系统中占用 CPU 时间最多的热点函数,通过筛选与 NUMA 相关的函数,能够帮助我们精准定位 NUMA 内存分配和页面迁移等耗时操作,为优化系统性能提供关键线索。在使用 perf top 时,可以通过添加特定的事件参数,如 perf top -e mem:trace_mm_page_alloc -g,来重点关注内存分配相关的操作。其中,mem:trace_mm_page_alloc 事件用于追踪内存页面分配,-g 参数则用于生成函数调用栈信息,以便更深入地分析函数调用关系。

执行上述命令后,perf top 会列出一系列函数及其占用的 CPU 时间。我们可以重点关注与 NUMA 内存分配和页面迁移相关的函数,如 __alloc_pages_nodemask、migrate*_pages 等。如果发现 __alloc_pages_nodemask 函数占用的 CPU 时间较长,说明内存分配操作可能存在性能瓶颈,需要进一步分析是否存在不合理的内存分配策略,或者是否需要调整内存分配算法,以减少跨节点内存分配,提高内存分配的效率。针对这些热点函数,我们可以深入分析其代码逻辑,尝试优化内存分配策略,减少不必要的跨节点内存访问,或者通过数据局部性优化,将热点数据存储在本地内存,从而提升系统整体性能。

6.3 配置 NUMA 亲和性

进程 / 线程绑定到指定节点

在 NUMA 架构下,将进程 / 线程绑定到指定节点是优化性能的重要手段之一。使用 numactl 工具可以轻松实现这一目标。例如,通过 numactl --cpunodebind=0 --membind=0 命令,可以将某个进程绑定到节点 0 的 CPU 和内存上,确保该进程在运行过程中,其 CPU 计算和内存访问都在节点 0 内进行,极大地减少了跨节点访问的延迟。在运行一个对内存访问延迟要求极高的数据库服务时,使用上述命令将数据库进程绑定到指定节点,能够显著提升数据库的读写性能。

然而,对于已经在运行的进程,numactl 命令无法直接动态修改其内存分配策略。此时,可以通过 taskset 命令来调整进程的 CPU 绑定,将进程固定到指定的 CPU 核心上运行,以减少 CPU 调度带来的开销。应用层也可以通过调用 move_pages 系统调用来迁移进程的内存页面,将其迁移到指定的节点,实现内存的重新分配。在完成进程 / 线程绑定后,可以通过查看 /proc/PID/numa_maps 文件来验证绑定效果,该文件记录了进程的内存映射信息,包括内存所在的节点、页面状态等,通过检查其中的 numa_hit 和 numa_miss 参数,可以判断绑定是否成功,以及内存访问的效率是否得到提升。

内存分配策略配置(numactl --localalloc)

numactl --localalloc 是一种非常实用的内存分配策略配置方式,它强制进程从当前节点分配内存,对于那些对内存访问延迟非常敏感的应用程序来说,这种策略能够显著提升性能。在实时数据分析应用中,数据的快速读取和处理至关重要,使用 numactl --localalloc 策略可以确保应用程序在处理数据时,能够迅速从本地节点获取内存,减少远程内存访问的延迟,从而加快数据分析的速度。

numactl --interleave 选项则提供了另一种内存分配策略,它可以实现内存的跨节点轮询分配。这种策略适合于那些需要大量内存,并且对内存带宽要求较高,但对内存访问延迟不太敏感的批量数据处理任务。在进行大规模数据的并行计算时,通过跨节点轮询分配内存,可以充分利用各个节点的内存带宽,提高数据处理的效率。不过,需要注意的是,numactl --localalloc 策略在节点内存不足时,没有容错能力,进程会直接因为无法分配到内存而触发 OOM(Out - Of - Memory)机制,导致进程崩溃。因此,在生产环境中使用这种策略时,需要谨慎评估节点内存的使用情况,确保有足够的内存可供分配,避免因内存不足而导致的系统故障。

6.4 优化案例:MySQL 性能调优实践

在 MySQL 性能调优中,NUMA 配置起着关键作用。以一个实际的 MySQL 部署为例,首先通过 numactl --hardware 命令确认服务器的 NUMA 节点拓扑结构,了解每个节点的 CPU 和内存配置情况。假设服务器具有双 NUMA 节点,接下来将 mysqld 进程绑定到节点 0 上,使用 numactl --cpunodebind=0 --membind=0 /usr/sbin/mysqld 命令,确保 MySQL 服务的计算和内存访问都在节点 0 内进行,减少跨节点访问的延迟。

关闭透明大页(THP)也是优化的重要步骤,通过修改 /sys/kernel/mm/transparent_hugepage/enabled 文件,将其值设置为 never,避免 THP 对内存分配的干扰,确保内存分配策略的有效性。同时,调整 InnoDB 缓冲池大小,使其不超过节点内存容量的 70%,例如将 innodb_buffer_pool_size 参数设置为节点内存的 70%,以确保缓冲池内存分配在本地节点,提高数据访问的效率。

在完成上述优化后,通过 sysbench 等性能测试工具对 MySQL 进行测试,验证优化效果。在测试结果中,可以看到 numa_miss 占比从优化前的较高水平降低至 1% 以下,这表明跨节点内存访问得到了有效控制;同时,查询延迟相比优化前提升了 20% - 30%,MySQL 的整体性能得到了显著提升,能够更好地满足业务对数据库性能的要求。

七、NUMA 常见问题与误区解析

7.1 性能瓶颈根源

跨节点内存访问延迟

跨节点内存访问延迟是 NUMA 架构中最为核心的性能瓶颈。在 NUMA 系统中,本地内存访问延迟通常在几十纳秒的量级,而跨节点内存访问延迟则可高达百纳秒以上,这种延迟差距在内存密集型应用中表现得尤为明显。在数据库系统中,如 MySQL 或 Oracle,若数据分布不合理,导致频繁的跨节点内存访问,会使查询延迟大幅飙升,系统吞吐量急剧下降。这是因为跨节点访问需要通过高速互联总线进行数据传输,增加了数据传输的时间和开销。

为了解决这一问题,关键在于实现 CPU 与内存的强绑定,确保 “计算与数据同节点”。通过 numactl 工具将进程的 CPU 和内存都绑定到同一节点,能够显著减少跨节点内存访问。在运行数据库服务时,使用 numactl --cpunodebind=0 --membind=0 命令,将数据库进程绑定到节点 0,这样可以确保数据库的计算任务在节点 0 的 CPU 上执行时,所访问的数据也来自节点 0 的本地内存,从而极大地降低内存访问延迟,提升数据库的性能和响应速度。

远程内存访问导致的 SWAP 问题

在 NUMA 架构下,默认的内存分配策略是进程优先从本地节点分配内存。当本地节点内存耗尽时,即使其他节点仍有大量空闲内存,进程也不会自动 fallback 到其他节点,而是触发 SWAP(交换分区)机制,将内存数据交换到磁盘上,这就是所谓的 “NUMA SWAP 陷阱”。在一个具有多个 NUMA 节点的服务器上,若某个节点的内存使用率过高,而其他节点内存利用率较低,运行在高负载节点上的进程可能会因本地内存不足而频繁使用 SWAP,导致系统性能急剧下降。这是因为磁盘的读写速度远远低于内存,数据在内存和磁盘之间频繁交换会增加大量的 I/O 开销。

为了解决这个问题,可以启用 numa_interleave 策略,通过 numactl --interleave=all 命令启动进程,使进程的内存分配在所有节点间均匀交错,避免单个节点内存耗尽。也可以设置内核参数 zone_reclaim_mode=0,允许节点间内存共享,当本地节点内存不足时,进程可以从其他节点分配内存,从而减少 SWAP 的使用,提升系统性能。

7.2 虚拟化环境中的 NUMA 陷阱

虚拟机跨 NUMA 节点调度

在虚拟化环境中,虚拟机的 vCPU 若跨物理 NUMA 节点调度,会导致内存访问延迟翻倍,严重影响虚拟机的性能。这是因为 vCPU 在不同的物理 NUMA 节点间调度时,会出现 “计算与内存分离” 的情况,即 vCPU 在一个节点运行,而访问的内存却在另一个节点,从而增加了跨节点内存访问的开销。这种问题通常源于虚拟化调度器未能充分感知物理 NUMA 拓扑结构,导致 vCPU 的调度与内存分配不匹配。

为了解决这一问题,可以启用 vNUMA 技术,在 libvirt XML 配置文件中明确设置 vNUMA 拓扑,将虚拟机的 vCPU 与内存绑定到同一物理节点,确保 “vCPU 与内存同节点”。还可以通过限制虚拟机的 vCPU 数量,使其不超过单个物理节点的核心数,避免 vCPU 跨节点调度的可能性。在配置虚拟机时,根据物理服务器的 NUMA 节点配置,合理设置 vCPU 和内存的分配,确保虚拟机能够高效地利用物理资源,减少跨节点访问带来的性能损耗。

CPU 热添加与 NUMA 不兼容问题

CPU 热添加是指在虚拟机运行过程中动态增加 CPU 资源的技术,但在 NUMA 架构下,CPU 热添加可能会破坏原有的 NUMA 拓扑结构。当热添加 CPU 时,内核可能无法准确识别新添加 CPU 与原有节点的关系,导致节点 CPU 分布混乱,从而影响内存访问的亲和性。在一个已经配置好 NUMA 拓扑的虚拟机中,若进行 CPU 热添加操作,可能会出现新添加的 CPU 与原有节点的内存访问延迟异常升高的情况,这是因为内核无法正确地将新 CPU 与合适的内存节点进行关联。

为了避免这种问题,对于关键业务系统,应尽量避免在运行时进行 CPU 热添加操作。若确实需要增加 CPU 资源,建议在虚拟机启动前规划好所需的 CPU 数量,并一次性配置到位。如果必须在运行时进行 CPU 热添加,那么在操作完成后,需要重启虚拟机或重新配置 vNUMA 拓扑,确保新添加的 CPU 与内存的亲和性得到正确设置,以维持系统的高性能运行。

7.3 禁用 NUMA 的误区

单节点系统无需启用 numa_balancing

在单节点系统中,由于不存在跨节点内存访问的问题,NUMA 的主要优势无法体现。此时启用 numa_balancing 机制,不仅无法带来性能提升,反而会增加内核调度的开销。numa_balancing 机制需要内核不断地监控进程的内存访问情况,并进行动态调整,这在单节点系统中是不必要的操作,会浪费系统资源。因此,在单节点系统中,可以通过修改内核参数 kernel.numa_balancing=0 来禁用 numa_balancing 机制,降低系统的资源消耗,提高系统的运行效率。

需要注意的是,多节点系统禁用 NUMA 会导致内存访问效率大幅下降,因为禁用 NUMA 后,系统将无法利用本地内存访问的优势,所有内存访问都将按照统一的模式进行,增加了内存访问的延迟和开销。所以,在多节点系统中,除非有特殊需求,否则不应轻易禁用 NUMA。

手动优化场景下的权衡

手动进行 NUMA 绑定可以在一定程度上提升性能,但过度绑定可能会导致资源浪费。将多个进程绑定到同一节点,可能会使该节点的内存和 CPU 资源迅速耗尽,而其他节点却处于闲置状态,造成系统资源的不均衡利用。在一个具有多个 NUMA 节点的服务器上,若将多个大型数据库进程都绑定到同一个节点,可能会导致该节点内存不足,出现频繁的内存交换和性能下降,而其他节点的资源却未得到充分利用。

为了避免这种情况,需要根据应用的负载情况动态调整绑定策略。可以结合集群调度工具,如 Kubernetes 或 Slurm,实现资源的均衡分配。这些工具能够根据节点的资源使用情况和应用的需求,智能地调度进程到合适的节点上运行,提高系统资源的利用率。在进行手动 NUMA 绑定时,不能盲目进行,需要通过监控工具,如 numastat 和 perf,实时监测系统的性能指标,根据实际情况验证优化效果,确保绑定策略能够真正提升系统性能,而不是适得其反。

7.4 其他常见问题

内存碎片化与分配策略

内存碎片化是影响 NUMA 性能的另一个重要因素。当系统中频繁进行内存分配和释放操作时,可能会导致内存空间变得零散,形成大量的小空闲内存块。这些小空闲内存块可能无法满足大内存块的分配需求,导致内存分配失败,即使本地节点有足够的空闲内存总量。这种情况下,内核可能会被迫从其他节点分配内存,从而破坏了本地分配策略,增加了跨节点内存访问的概率。

为了解决内存碎片化问题,可以启用内存规整机制(compact_memory),通过定期扫描内存,将分散的空闲内存块合并成连续的大内存块,提高内存的利用率。关闭透明大页(THP)也是一种有效的方法,因为 THP 在某些情况下会导致内存分配粒度变大,增加内存碎片化的风险。关闭 THP 可以减少大页分配失败的概率,使内存分配更加灵活,有助于维持本地分配策略的有效性。

NUMA 与硬件架构的兼容性(AMD Zen、Intel Sapphire Rapids)

不同的硬件架构在 NUMA 拓扑和性能表现上存在显著差异。AMD Zen 架构采用了多 CCD(Core Complex Die)设计,每个 CCD 对应一个 NUMA 节点,这种设计使得节点间的互联延迟相对较低,与 Intel 架构相比,在某些场景下具有更好的性能表现。而 Intel Sapphire Rapids 则支持 UPI 2.0 总线,提供了更高的带宽,能够在节点间实现更快速的数据传输。

在进行 NUMA 调优时,需要根据具体的硬件架构进行针对性的调整。对于 AMD Zen 架构的系统,可以采用更细粒度的 CCD 绑定策略,充分利用其多 CCD 设计的优势,将进程和内存更精准地绑定到对应的 CCD 上,进一步降低内存访问延迟。而对于 Intel Sapphire Rapids 架构的系统,则需要关注 UPI 2.0 总线的带宽利用情况,合理分配任务和内存,确保能够充分发挥其高带宽的优势。在实际应用中,需要参考硬件手册和相关技术文档,了解不同硬件架构的 NUMA 特性,制定合适的调优策略,以实现最佳的系统性能。

八、总结

NUMA 是多核 Linux 系统性能调优的核心密钥,其本质是通过 “本地内存优先访问” 的设计,突破 SMP 架构的总线瓶颈。从内核的拓扑识别、调度策略,到应用的亲和性配置、数据局部性设计,再到实战中的工具使用、案例优化,掌握 NUMA 的每一个环节,都是深入理解 Linux内核 内存管理机制的必经之路。对于希望进一步提升系统性能的开发者与运维工程师而言,持续在实践中探索和优化 NUMA 配置,是通往高效系统架构的必修课。如果你想与更多同行交流相关经验,欢迎访问 云栈社区 参与讨论。