还在为AI聊天的Token消耗速度太快而烦恼吗?每次对话都小心翼翼,生怕额度瞬间见底?如果你正在寻找一种经济实惠的方式来持续使用大语言模型,那么OpenRouter提供的免费模型服务值得你关注。

简单来说,OpenRouter是一个AI模型聚合平台,它汇集了来自多个提供商的数百个模型,并提供了统一的API接口。最关键的是,其中包含一系列完全免费、无需绑卡的模型,足以满足日常对话、学习实验等需求。

免费模型与付费模型如何选择?

在使用前,了解免费服务的定位很重要。与付费模型相比,免费模型在资源分配上通常有所限制,这直接影响了其性能表现和使用场景。

| 对比项 |

免费模型 💚 |

付费模型 💳 |

| 价格 |

完全免费! $0/百万Tokens |

按量计费 |

| 质量 |

日常聊天、文本处理足够用 |

更强、更稳定 |

| 速度 |

可能较慢,存在波动 |

快速且稳定 |

| 限制 |

有速率限制(RPM/TPM) |

基本无限制 |

| 适合场景 |

日常聊天、学习、原型实验 |

重要任务、商业应用、生产环境 |

一个合理的策略是:日常使用免费模型,遇到关键任务时再切换至付费模型。这样既能大幅降低成本,又能保证重要工作的完成质量。

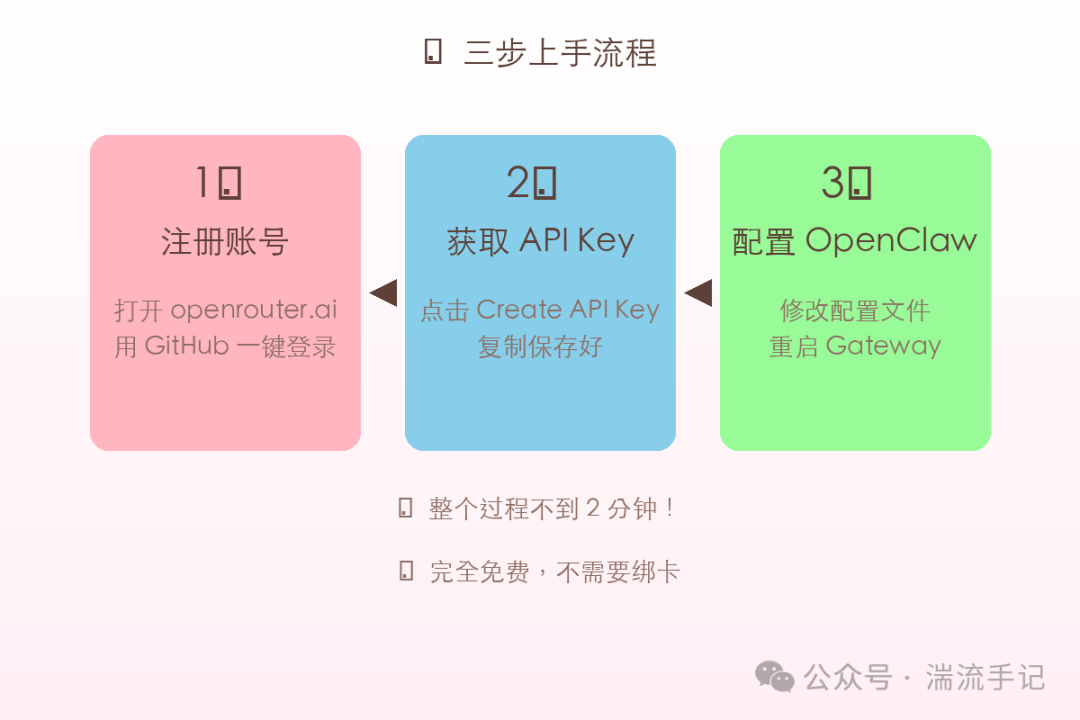

三步上手,快速开始

整个过程非常简单,只需几分钟即可完成设置。

第一步:注册账号

- 访问 OpenRouter 官网。

- 点击右上角的 “Sign In”。

- 选择登录方式,推荐使用 GitHub 一键授权登录。

第二步:获取 API Key

这是调用API的凭证,务必妥善保管。

- 登录后,点击右上角头像。

- 在下拉菜单中选择 “API Keys”。

- 点击 “Create API Key” 按钮。

- 为密钥起一个名字(例如

my-free-key),然后点击创建。

- 重要:系统生成的API Key(格式如

sk-or-v1-xxxxxxxxxxxxxxxxxxxxxxxx)只会显示一次,请立即复制并保存到安全的地方。

第三步:配置到你的应用或工具

你有两种主要的使用方式。

方式一:在支持自定义API的客户端中使用

许多开源的AI聊天前端,如 ChatGPT-Next-Web、LobeChat 等,都支持配置自定义后端。

- API 地址:

https://openrouter.ai/api/v1

- API Key:填入你上一步获取的密钥。

- 模型:选择下方推荐的免费模型,或者直接填写

openrouter/free 让系统自动选择。

方式二:通过代码直接调用

如果你是开发者,可以使用与OpenAI兼容的SDK进行调用,以下是一个Python示例:

from openai import OpenAI

client = OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key="你的API Key", # 请替换为你的实际Key

)

response = client.chat.completions.create(

model="openrouter/free", # 自动选择免费模型

messages=[{"role": "user", "content": "你好!"}]

)

print(response.choices[0].message.content)

这段代码的结构与调用官方OpenAI API完全一致,仅需修改base_url和api_key即可。更多参数和调用方式可以参考其技术文档。

有哪些值得推荐的免费模型?

平台上的免费模型选择不少,这里推荐几个综合表现不错的:

| 模型 |

上下文长度 |

特点 |

适合场景 |

| Qwen 3.6 Plus |

1M |

综合能力强,支持代码 |

日常聊天、编程辅助、推理 |

| Step 3.5 Flash |

256K |

响应速度快 |

快速问答、长文本摘要 |

| NVIDIA Nemotron |

262K |

NVIDIA出品,多任务处理 |

复杂指令理解 |

| DeepSeek R1 |

- |

推理能力强 |

数学计算、逻辑分析 |

懒人技巧:如果你不想费心挑选,可以直接使用模型ID openrouter/free。这是一个路由模型,会自动为你选择一个可用的免费模型,非常方便。

常见问题解答

Q1:真的是完全免费吗?会有隐藏费用吗?

A:目前,这些模型对输入和输出Token的计费均为 $0 / 百万Tokens,是真正的免费。但需要注意,所有免费模型都有速率限制,不适合做高并发的商业应用。

Q2:免费模型的质量如何?

A:质量因模型而异。像 Qwen、Step 这类由知名公司开源的大模型,其能力已经非常接近一些中等水平的付费模型,对于日常使用绰绰有余。建议先从 openrouter/free 或上述推荐模型开始尝试。

Q3:使用免费模型时,为什么有时响应很慢?

A:免费资源通常是共享的,在用户使用高峰期(例如北美白天),可能会遇到排队或响应缓慢的情况。如果遇到此问题,可以尝试切换到另一个免费模型,或者避开高峰时段使用。

Q4:这些免费模型会一直存在吗?

A:OpenRouter 官方表示会尽力维持免费服务的提供,但这无法成为长期保证。模型提供商的政策也可能发生变化。因此,“且用且珍惜” 是目前的最佳心态。

Q5:除了用免费模型,还有什么节省Token的技巧?

A:当然有:

- 优化提示词:提问尽量清晰、简洁,避免不必要的上下文。

- 混合使用策略:简单查询用免费模型,复杂、重要的任务再用付费模型。

- 关注使用情况:定期在OpenRouter仪表板查看Token消耗情况。

使用建议与注意事项

✅ 推荐做法

- 将免费模型用于日常交流、学习测试和项目原型开发。

- 妥善保管你的API Key,避免泄露。

- 多用

openrouter/free 自动选择功能,简单省心。

❌ 避免事项

- 切勿将API Key提交到公开的GitHub仓库中。

- 不要试图用免费模型支撑高并发或商业生产服务。

- 对免费模型的性能和稳定性保持合理预期。

总结

通过OpenRouter调用免费大语言模型,是开发者和个人用户控制AI使用成本的实用方案。它降低了体验和实验的门槛,让你可以更自由地探索AI的可能性。记住“日常用免费,重要用付费”的原则,就能让手中的Token发挥最大效用。

如果你想了解更多关于模型微调、开源项目实践或其他AI技术,欢迎访问云栈社区进行交流探讨。OpenRouter的免费模型列表可能会更新,获取最新信息请访问其官网或相关开源实战项目页面。

相关链接