Simon Willison 在海边遛狗时掏出手机,敲了一段提示词,30秒后,一个功能模块就写完了。听起来像天方夜谭,但对他来说已是日常。

这个人共同创造了 Django——那个支撑了 Instagram、Pinterest、Spotify 的 Web 框架。写了25年代码的他,甚至首创了“prompt injection”和“AI slop”这两个如今被行业广泛采用的术语。如今,他95%的代码都不是自己敲的,每天同时运行4个编码智能体,结果就是:上午11点,认知资源就耗竭了。

这引出了一个深刻的行业转变:代码正在变得廉价,真正值钱的是人的判断力。一个更令人警醒的观点是,在这场变革中,中级工程师可能比初级工程师更危险。而整个AI编程领域,其“挑战者号时刻”或许只是时间问题。

代码几乎免费之后,瓶颈变成了你的大脑

整个2025年,Anthropic 和 OpenAI 几乎将所有训练资源都押注在一件事上:让模型写代码。推理能力叠加强化学习,代码生成能力飞速进化。到了11月,当 GPT-5.2 和 Claude Opus 4.5 同时发布时,模型的能力从“大部分时候大部分能用”跨越到了“几乎总是做你要求的事”。

这听起来只是增量改进,但跨过这条线之后,一切都变了。

你可以告诉一个编码智能体“给我写一个 Mac 应用”,它真的能交付一个可用的东西。虽然不完美,但不再是一堆跑不起来的废代码。圣诞假期期间,一大批工程师开始认真把玩这些工具,并集体发现:这东西真的能用了。到了2026年初,利用智能体一天产出一万行可运行代码,对很多人来说已是常态。

然而,AI 非但没有让顶级工程师更轻松,反而让他们更累了。

Simon 同时开启四个智能体并行处理不同问题,结果就是上午11点彻底“宕机”。这不是体力耗尽,而是认知带宽见底。你得同时在脑子里维护四条并行的任务上下文,任何一条出问题都必须立刻切过去干预。有人凌晨4点爬起来给智能体布置任务,也有人睡前再多开几个,“反正它们能替我干活”。Simon 自己也承认,这种感觉有点像赌博上瘾。

代码变便宜了,但人的注意力并没有。过去,工程师需要连续2-4小时不被打断的深度工作时间;现在,可能只需要花两分钟给智能体下个指令就行,剩下的时间似乎可以干别的。这听起来是一种解放,但实际上,是把“写代码”的认知负担,置换成了“同时监管多个智能体”的认知负担。新的瓶颈不再是打字速度,而是人脑能同时追踪多少条思维线程。

工厂自动化了,工人确实轻松了;但知识工作自动化了,知识工作者反而可能更累。因为机器接管的是那些低认知负担的重复劳动,而留给人类的,全是高认知负担的决策和监督。

“暗黑工厂”:3个人,不写代码,也不读代码

既然代码便宜了,那能不能干脆连看都不看了?还真有人在做这个实验。

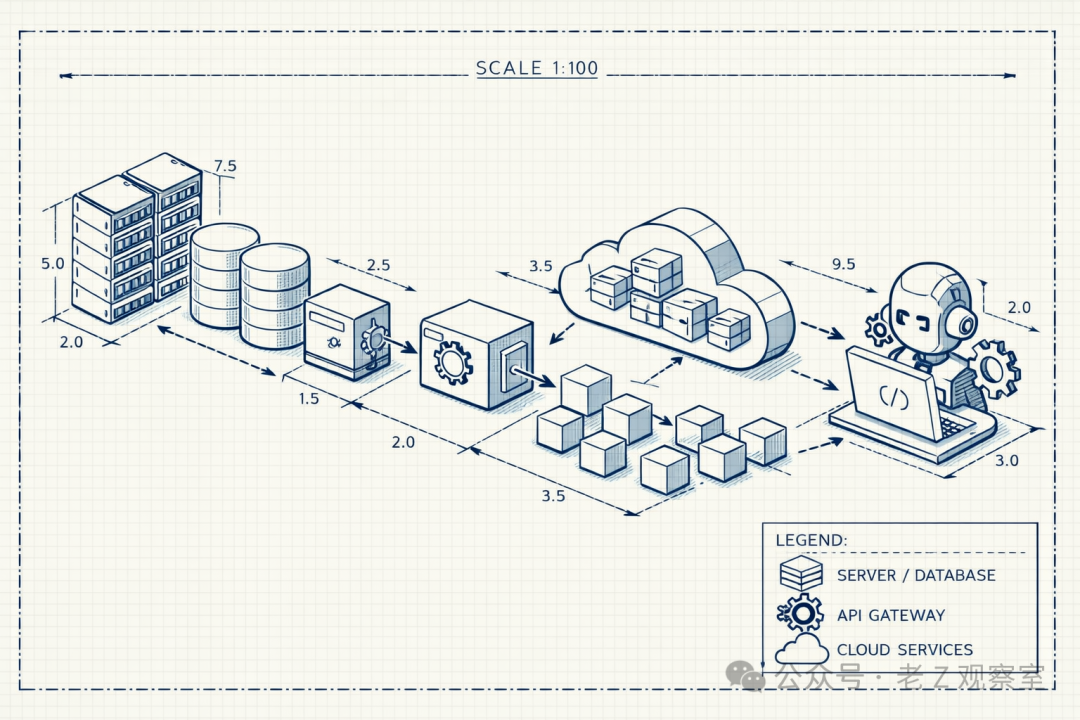

StrongDM 是一家做企业权限管理的安全公司——请注意,是安全公司。他们在2025年8月推行了两条激进的规则:没人被允许写代码,也没人被允许读代码。

整个“软件工厂”由三名工程师运行。代码由智能体写,测试由智能体做,人类只负责撰写规格说明和设计测试场景。

那如何保证质量呢?他们建造了一整套复杂的模拟环境。为了避免真实 Slack 和 Jira 的 API 速率限制,他们让智能体根据这些产品的官方 API 文档和开源客户端库,自己构建了一套模拟版的 Slack、Jira 和 Okta。然后,放出一群 AI 模拟用户,24小时不间断地在模拟 Slack 频道里提出各种请求:“嘿,能给我开一下 Jira 权限吗?”这套系统每天烧掉约1万美元的 token 费用。

斯坦福法学院的 CodeX 项目专门为此撰写了一篇评论,标题直击核心:Built by Agents, Tested by Agents, Trusted by Whom?(由智能体构建,由智能体测试,该信任谁?)

“验证替代审查”这条路在逻辑上说得通。你不需要读懂每一行代码,只要能证明代码在各种极端情况下都能正确工作。但问题在于,测试能证明代码做了它该做的事,却很难证明代码没做它不该做的事。对于一款安全软件来说,这个区别是致命的。

你敢在自己的团队推行“没人读代码”的政策吗?大概率不敢。但 StrongDM 至少证明了一点:这是一个可以探讨的工程问题,而不仅仅是天马行空的幻想。

最危险的不是初级程序员,是中间层

代码便宜到可以连看都不看,那谁最可能被淘汰?直觉反应是:初级工程师。

但 ThoughtWorks 召集一批工程副总裁进行专题研讨后,得出的结论恰恰相反:最危险的是中级工程师。

对于资深工程师而言,AI 是他们25年经验的超级放大器。Simon 只需输入一个“red/green TDD”的提示词,智能体就知道应该先写测试、看它失败、再写实现、看它通过。这5秒钟的背后,是25年积累的工程直觉。他能一眼判断出“这个问题一句话提示词就能解决”还是“这个问题很麻烦”,因为他踩过的坑足够多。

对于初级工程师来说,AI 解决了他们的入职门槛。像 Cloudflare 和 Shopify 这样各招了1000名实习生的公司发现,原来需要一个月才能上手的新人,现在一周就能产出有价值的东西。

而处于中间层的工程师,则陷入了尴尬的两头不沾。他们既没有足够深厚的经验被 AI 有效放大,又已经过了享受“新手红利”的阶段。如果他们能主动拥抱这些新工具,可能会成为最大的受益者;但如果抱着“我已经会写代码了”的心态固步自封,则可能成为最大的受害者。

这个观点放在国内语境下,显得格外扎心。过去两年大厂裁员潮中被优化的,大量正是拥有3-8年经验的中间层工程师。并非他们不够优秀,而是在旧的体系里,他们的核心价值常常被定义为“能稳定产出代码”——而这恰恰是 AI 最先、也最容易接管的能力。

193个小工具和一条新年决心

那么,中间层工程师该怎么办?答案或许藏在 Simon 的 GitHub 仓库里。

他有一个名为 simonw/tools 的仓库,里面存放着193个 HTML/JavaScript 小工具。每一个都是一次实验的产物,一个“我知道这件事可以做到”的实体证据。另一个仓库 simonw/research 则存放了75个编码研究项目,都是实打实地让编码智能体写代码、跑代码、画图表,而非那种让 AI 搜网页写报告的“伪深度研究”。

他把这称为“囤积你知道怎么做的事”。具体执行起来就是:每次遇到新技术、新库、新 API,就花20分钟让智能体做一个最小可行性实验,然后将过程与结果存成 Markdown 文档丢进 GitHub。下次碰到类似问题,就直接告诉智能体:“去读一下我那个仓库里关于 WebAssembly 的项目,用类似的方法解决这个问题。”智能体擅长重用上下文,你喂给它的“弹药库”越厚实,它的输出质量就越高。

项目模板是另一个巧思。很多人会撰写长篇大论的 CLAUDE.md 来指导智能体,但 Simon 发现,一个包含单个测试(例如测试 1+1=2)的骨架项目,往往比几页纸的说明书更有效。因为智能体本质上擅长模式匹配,而非深度的阅读理解。一个薄薄的骨架项目,就能让它自动模仿风格去编写后续所有代码。

Simon 今年的新年决心是“更有野心”。以前他每年都告诫自己要聚焦、少做,今年却反其道而行之,什么都想尝试。因为原型制作的成本几乎降到了零,一个功能可以让三个智能体做出三个不同版本进行比较。这印证了 Jensen Huang(黄仁勋)说过的话:很多公司裁员,并不是因为 AI 替代了人,而是因为管理层没有足够的创造力和野心,去利用多出来的产能。

最终,你的“弹药库”决定了 AI 在你手里是一支精准的步枪,还是一把滋水的水枪。

AI 的“挑战者号时刻”

Simon 在2022年就给一类安全漏洞命名了:prompt injection。后来他自己反思说,这个名字可能起坏了。因为人们会自然联想到 SQL injection,而 SQL injection 已经有成熟的防御方案。但 Prompt injection,至今没有根本性的解决方案。

他提出了一个更精确的分析框架,称之为 Lethal Trifecta(致命三要素):当一个 AI 智能体同时具备1. 访问私密信息的能力、2. 接收外部(可能恶意)指令的通道、3. 将数据传出去的办法时,灾难就只是时间问题。你的邮件智能助手完美符合这三条:它能看你的邮件,任何人都能给你发邮件(传递指令),而它本身就能回复邮件。

97%的防御成功率听起来很高?这意味着每三次攻击中就有一次可能得手,一旦成功,你的整个收件箱就可能暴露。

他用挑战者号航天飞机灾难中的“偏差正常化”来类比:每一次 O 型环没出问题,NASA 的信心就增加一分。每一次 AI 智能体没有泄露数据,我们的警惕性就松懈一分。直到某一天,灾难终于发生。

最典型的例子是 OpenClaw。它的第一行代码写于2025年11月25日,三个半月后,它的广告就登上了超级碗。Simon 说这“几乎完全是我最反对存在的东西”:一个拥有完整权限的个人 AI 助手,能读你的邮件、操作你的文件、替你做出决策。已经有人因为它而丢失了比特币钱包。但即便如此,仍有几十万人愿意忍受复杂的设置流程和安全风险去使用它。

“如果你能做出一个安全的 OpenClaw,这将是当下最大的机会。我不知道该怎么做,如果我知道,我早就去做了。”Simon 坦言。

Simon 已经连续三年预测“挑战者号时刻”的到来,但都尚未应验。然而,这恰恰是“偏差正常化”的定义——每多安全一天,我们的松懈就多一分。

归根结底,Simon Willison 25年的编程经验,如今主要不是用来写代码的,而是用来判断该让 AI 写什么,以及绝不能让它碰什么。这或许是所有技术从业者在云栈社区这样的平台上最值得深入交流和思考的核心命题。