用户提问:“机器学习模型如何训练?”但RAG系统返回的检索结果却是“...习模型如何训练”,关键词被拦腰斩断,系统表现如同“人工智障”。

如何避免这种尴尬局面?本文将深入解析文本分块的核心策略与生产环境的最佳实践。如果你也在为RAG系统的检索质量头疼,不妨来看看。

一、关键词切断:RAG系统的核心痛点

某企业的RAG系统上线后,用户反馈检索质量非常糟糕:

- 查询“Transformer架构原理”,结果返回“...ransformer架构原理”。

- 查询“分布式事务解决方案”,却得到“...布式事务解决方案”。

- 核心实体名词被分割到不同的文本块中,直接导致检索失败。

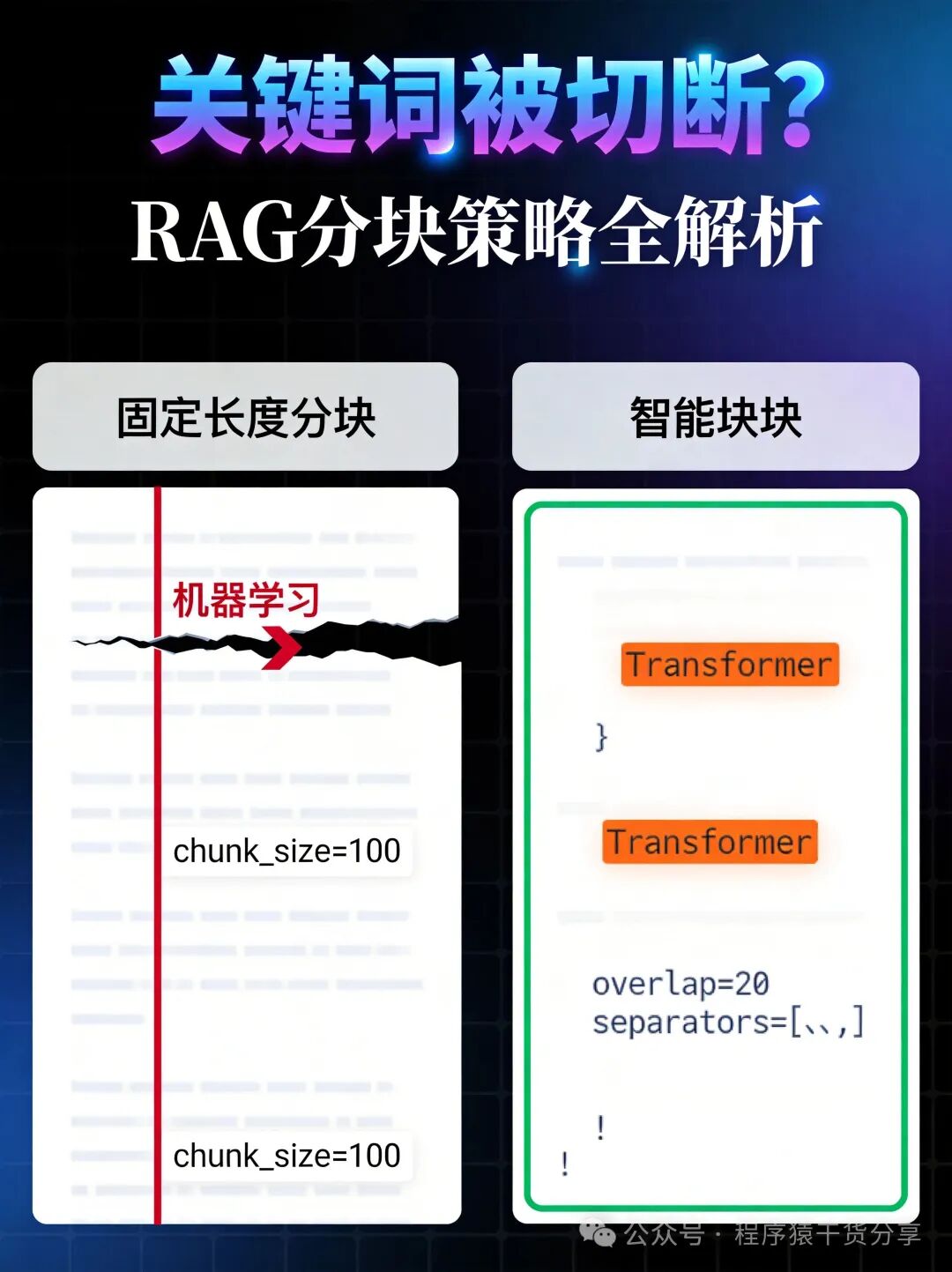

其根本原因在于,早期常用的固定长度分块策略无视了语义边界,直接在字符或token位置进行“硬切割”。研究表明,不合理的分块策略可能导致检索准确率下降30-40%。

二、为什么固定长度分块会“翻车”?

固定长度分块是最简单的实现方案,但它存在几个致命缺陷:

问题1:语义断裂

完整句子被截断,主谓宾分离;逻辑关系(如因果、递进)被破坏;大语言模型难以理解这些碎片化的内容。

问题2:关键词切断

专业术语(如“Trans-for-mer”)、人名、地名、技术名词被拆分到不同的块中,检索时无法匹配到完整的关键词。

问题3:上下文缺失

技术文档中的公式缺少了推导过程;引用信息(如“如前文所述”)失去了上下文依托;模型的跨块推理能力因此下降。

三、六大解决方案深度解析

方案1:递归字符分割(推荐)

核心思路是按层级结构分割,优先保留语义完整性。这是目前最通用且效果不错的方案。

from langchain.text_splitter import RecursiveCharacterTextSplitter

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=400,

chunk_overlap=50,

separators=["\n\n", "\n", "。", "!", "?", " ", ""],

length_function=len

)

chunks = text_splitter.split_text(text)

为什么有效?

- 它优先在段落边界(

\n\n)分割,其次是句子(。),最后才按字符切割。

- 多项实验表明,200-400 token的递归分割在各项指标上表现最优。

- 实现简单,无需依赖额外的模型。

- 适用场景:技术文档、API文档等结构化文本。

方案2:语义感知分块

核心思路是基于句子嵌入的语义相似度动态确定分割点。

实现逻辑:

- 将文档切分为单个句子。

- 计算相邻句子的语义相似度。

- 当相似度低于预设阈值时,就在此处进行分割。

性能表现:

- 在Chroma的测试中,

ClusterSemanticChunker的召回率达到了91.3%。

- 相比固定分块,检索准确率提升可达40%。

- 权衡:计算成本较高,适合对精度要求极高的场景,如法律、医疗文档处理。

方案3:智能重叠策略

一个常见误区是认为重叠比例越大越好。实际上,需要根据场景动态调整。

最佳实践:

chunk_size = 512

overlap_ratio = 0.15 if is_technical_doc else 0.10

chunk_overlap = int(chunk_size * overlap_ratio)

推荐参数:

- 短文本块(200-400 token):重叠比例建议10-15%。

- 长文本块(512-1024 token):重叠比例建议5-10%。

- 特殊场景(如代码函数调用):可提升至25%。

方案4:文档结构感知分块

针对问题:PDF、Markdown、HTML等富格式文档的结构性信息在分块时丢失。

from langchain.text_splitter import MarkdownHeaderTextSplitter

headers_to_split_on = [

("#", "Header 1"),

("##", "Header 2"),

("###", "Header 3"),

]

splitter = MarkdownHeaderTextSplitter(headers_to_split_on)

chunks = splitter.split_text(markdown_text)

关键收益:

- 保留标题层级等元数据,支持后续按层级过滤。

- 保持表格完整性,避免行被切断。

- 代码块可按函数或类进行分割,保持语法完整。

方案5:领域词典增强

核心思路是预先收集专业术语,在分块时强制合并这些不可拆分的词汇。

domain_terms = [

"Transformer架构",

"分布式事务",

"机器学习",

"深度学习",

"神经网络"

]

- 分块时优先保护这些领域术语不被切割。

- 适用场景:医疗、法律、金融等专业领域文档。

方案6:分层分块

这是一种更高级的架构设计。

- 父节点:大粒度(如整个章节),用于保留宏观上下文。

- 子节点:小粒度(如段落),用于精准检索。

- 检索时:先召回相关的子节点,再提取其对应的父节点以补充上下文。

- 实现工具:可借助LlamaIndex的

HierarchicalNodeParser。

- 适用场景:教科书、法律合同、复杂的技术手册。

四、方案选型对比

| 方案 |

性能 |

精度 |

复杂度 |

适用场景 |

| 递归分割 |

⭐⭐⭐⭐⭐ |

⭐⭐⭐⭐ |

⭐⭐ |

通用场景 |

| 语义感知 |

⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

⭐⭐⭐⭐ |

法律/医疗 |

| 智能重叠 |

⭐⭐⭐⭐ |

⭐⭐⭐⭐ |

⭐⭐ |

防止切断 |

| 结构感知 |

⭐⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

⭐⭐⭐ |

技术文档 |

| 领域词典 |

⭐⭐⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

⭐⭐⭐ |

专业领域 |

| 分层分块 |

⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

⭐⭐⭐⭐⭐ |

复杂文档 |

五、生产环境最佳实践

参数调优路线图

阶段一:建立基线

- 使用

RecursiveCharacterTextSplitter,设置chunk_size=512, overlap=100。

- 确保使用与后续Embedding模型相匹配的tokenizer进行长度计算。

- 保留完整的元数据(如文档标题、章节、页码)。

阶段二:系统评估

- 构建专属评估集,测试关键指标:

- Context Relevancy:召回的文本块与查询的相关度。

- Precision@K:前K个结果中相关文本块的比例。

- Recall:所有相关文本块中被成功召回的比例。

阶段三:精细优化

- A/B测试不同的

chunk_size(256/512/1024)。

- 对比固定分块与语义分块的效果差异。

- 测试不同

overlap比例(0% vs 10% vs 20%)的影响。

避坑指南

- Chunk过大(>1000 token) → 导致Embedding信息稀释,检索精度下降。建议:控制在512 token以内。

- Overlap过高(>50%) → 存储成本激增,且容易造成重复召回。建议:保持10-20%的重叠比例。

- 忽视tokenizer差异 → 实际token数超出模型限制。建议:使用目标Embedding或LLM模型的tokenizer进行计算。

- 一刀切策略 → 代码被当作普通文本分割,导致语法断裂。建议:对代码使用基于AST(抽象语法树)的分割方式。

- 缺少元数据 → 无法进行过滤或结果溯源。建议:保留标题、层级、时间戳等关键信息。

六、高频面试问题解析

Q1:为什么推荐递归分割而不是固定长度分块?

递归分割优先在语义边界(段落、句子)进行切分,能最大程度保留语义的完整性。而固定长度分块无视这些边界,极易切断关键词和逻辑。

Q2:如何避免专业术语被切断?

一是构建领域词典,在分块时优先保护这些专业术语;二是设置合理的重叠比例(10-20%),确保信息在跨越边界时仍然完整。

Q3:语义分块和递归分割如何选择?

通用场景优先选择递归分割,性价比高。在对精度要求极高的特定场景(如法律、医疗合同解析),则可以考虑使用精度更高的语义分块。

Q4:分块大小如何确定?

这取决于Embedding模型的上下文长度限制和具体业务场景。一般建议在300-800 token之间。问答场景适合较短的块(300-512),摘要生成等场景则可使用较长的块(1024-2048)。

Q5:如何评估分块效果?

需要构建评估数据集,综合测试检索准确率(Precision)、召回率(Recall)、上下文相关性(Context Relevancy)等核心指标。

总结

关键词切断是RAG系统落地过程中的常见痛点,但通过合理的分块策略完全可以有效规避。

选型建议:

- 通用场景:递归分割 + 智能重叠策略。

- 专业领域:领域词典增强 + 结构感知分块。

- 复杂长文档:分层分块 + 元数据过滤。

核心原则:

- 语义优先:优先在自然语义边界处切分,避免简单粗暴的硬切割。

- 合理重叠:设置适当的重叠区域,防止关键信息因恰好处于边界而丢失。

- 保留元数据:丰富的元数据是支撑多维度检索和结果溯源的基础。

- 动态调整:没有“银弹”参数,需根据业务场景和数据特性进行动态调整。

文本分块远不止是简单的“切蛋糕”,它是RAG系统信息架构设计的核心环节。一个优秀的分块策略能直接让检索更精准、生成更准确,从而提升整个系统的智能水平。希望本文的解析能为你构建更健壮的RAG应用提供帮助。更多关于AI和大模型的实战讨论,欢迎在云栈社区交流。