API 作为数字世界的连接纽带,虽推动了开放生态的繁荣,却因协议碎片化、开发高成本陷入“巴别塔困境”。MCP(模型上下文协议)的诞生,标志着 AI 交互范式从“人工编码适配”迈向“机器自主协作”。通过 标准化服务描述 与 上下文感知机制,MCP 成为 AI 时代的“万能适配器”——既消除工具间的协议鸿沟,又支持运行时动态编排,使 AI 应用能像“热插拔硬件”一样自由调用跨领域服务。

本文将从 API 的历史演进入手,探讨 MCP 的设计理念,并以一个“帮我查询周末的天气,如果下雨就推荐附近的电影院”的简单场景为例,展示 MCP 如何实现智能服务编排,助力 AI应用 迈向“所想即所得”的新阶段。

从代码接口到数字生态的基石

标准化、能力复用与开放,是 API(Application Programming Interface,应用程序编程接口)演进的核心关键词。API 定义了软件系统之间交互的规则和协议,从手机 App 到云计算平台,现代数字世界的运行都离不开它。

萌芽:本地化代码接口

上世纪 60 年代,UNIX 操作系统率先使用系统调用(System Call),如文件读写 open()、write() 等,为应用程序提供了访问操作系统资源的接口,这被视为 API 的雏形。随着结构化编程兴起,API 逐渐演变为函数库(Library),例如 C 语言的标准库 stdio.h、stdlib.h,提供了更高级的编程接口。

网络化:跨系统通信协议

计算机网络的发展催生了跨计算机通信的标准化接口需求,于是网络协议应运而生。早期的 CORBA(通用对象请求代理架构)、DCOM(分布式组件对象模型),再到上世纪末的 SOAP(简单对象访问协议),都为跨系统通信奠定了协议基础,它们是早期 Web API 的雏形。

Web:REST 与开放生态

进入新千年,Web 2.0 兴起,互联网应用飞速发展,API 也进入了新阶段。RESTful API 成为主流,它基于 HTTP 协议,使用 URL、HTTP 方法等标准化方式实现对资源的增删改查。随之而来的是开放平台运动,Facebook、Twitter 等平台开放 API,让第三方开发者能够访问平台数据,构建出丰富的应用生态。

成熟:标准化与多样性

现代 Web API 如 OpenAPI、GraphQL、gRPC 等,进一步提升了开发效率和易用性。API 的成熟也催生了“API 即产品”的商业模式,带来了 API 经济的崛起。与此同时,通过标准化 API 解耦 系统架构 组件,实现了基础设施的弹性、可观测性和可扩展性,这构成了云原生技术的核心理念之一。

趋势展望:全域互联与认知革命

随着物联网、5G、边缘计算等技术的发展,我们迎来了超大规模的 API 网络协议 网络。各式各样的设备、传感器、服务都通过 API 连接在一起,构成了庞大的数字化生态系统。而当前势头正盛的大模型,不仅通过 API 对外提供服务,更将通过 API 与其他服务进行交互,实现更高级的认知与决策。

从机械式指令到认知决策

关键词:系统、决策、热插拔

大模型的出现,为 API 的智能化交互开辟了新路径,例如自然语言处理、多模态交互和自主决策。这推动 API 的交互模式完成了从机械式指令、资源化操作,到语义化交互、认知型决策的演进。这一转变,将原本面向机器通信、强调功能和数据调用的 API,转变为面向 AI 的智能交互接口。

“方言”林立:API 的巴别塔困局

假设我们需要将一个外部服务集成到自己的应用中。通常的做法是:阅读该服务的 API 文档,了解其功能、参数和调用方式,然后编写代码调用 API。如果需要集成更多能力,就需要调用更多 API,编写更多代码。

由于 API 生态的多样性,不同 API 在协议、参数、调用方式上往往各不相同。这种“巴别塔困局”迫使开发者花费大量精力去理解和调用不同的 API、处理调用异常,并编写大量的“粘合代码”来实现不同 API 之间的数据转换与流程串联。

更重要的是,这一切集成工作都在应用设计阶段完成,导致应用与 API 之间形成了强耦合关系。任何 API 的扩展、升级或替换,都可能意味着需要重新设计和开发。

LLM 驱动:以智能跨越鸿沟

大语言模型(LLM)能够理解自然语言,自然也能理解结构化的 API 文档并与之交互。这意味着,学习 API 的负担从开发人员转移到了大模型身上,而且这一学习过程甚至可以在运行时动态进行,并持续更新。

这种方式有可能颠覆传统的 API 集成模式,从“人工编码适配”转向“机器自主学习”,成为破解 API 巴别塔困局的关键。

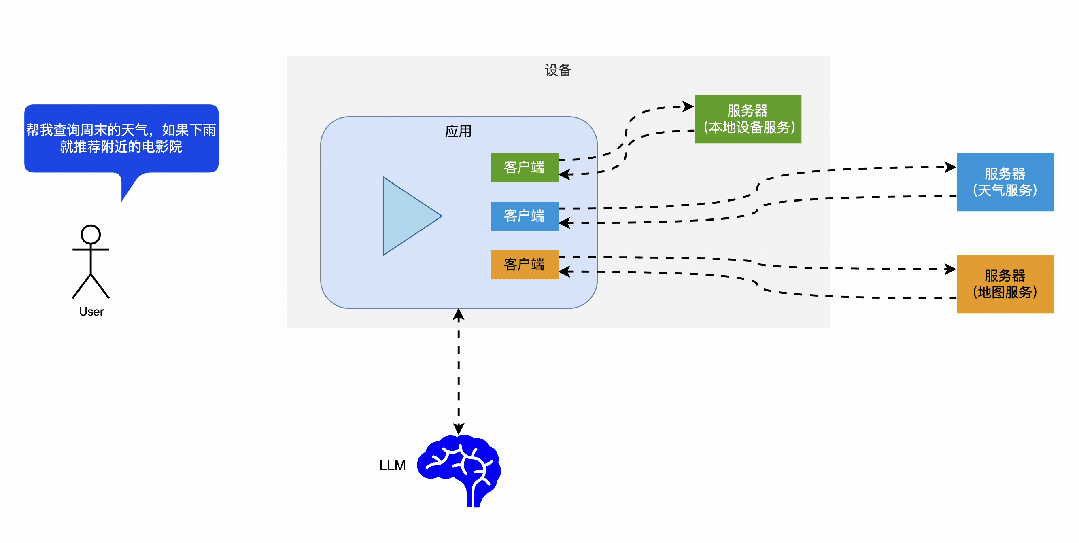

举个例子,用户输入指令“帮我查询周末的天气,如果下雨就推荐附近的电影院”。理想状态下,大模型可以自动识别需求,并依次调用设备 API 获取位置、调用天气 API 获取预报、调用地图 API 查找附近影院,最终将结果返回给用户。这个过程涉及多种 API 的调用、决策逻辑处理以及上下文数据的传递。

但要让这一愿景落地,仅靠大模型的语义理解能力远远不够。当多个 API 调用逻辑嵌套、上下文数据需要跨系统流转时,如何确保不同协议的参数对齐?如何处理调用异常,避免流程中断并提供备选方案?

试想:当用户说“如果下雨就推荐电影院”,大模型首先要理解各个 API 的能力,明确其使用场景和调用方式。执行时,它需要记住“下雨”这个状态,并将其准确地传递给地图 API。同时,还必须确保这一状态信息在设备定位、天气服务与影院推荐服务之间无缝同步——这才是跨越巴别塔的真正桥梁:既让机器听懂人言,又让机器之间说同一种语言。

MCP:语义一致性基座

2024 年 11 月,Anthropic 公司发布了 MCP(Model Context Protocol) 协议。这是一个开放协议,旨在为 AI 应用向大模型提供环境上下文建立标准化的接口。

MCP 如同人工智能领域的 USB-C 接口,通过统一的数据接入标准,使各类 AI 模型能够无缝对接多样化的数据源及功能工具。其核心价值在于构建通用连接规范,实现模型与外部系统的高效互操作性。

MCP 采用典型的客户端-服务器架构。服务器端提供特定功能,应用程序通过客户端来使用这些功能。客户端与服务器维护一对一的关系,通过标准输入输出或 SSE 进行通信,并使用 JSON-RPC 2.0 作为消息格式。

MCP 的目标是建立一套所有机器都能理解的“世界语”,通过标准化上下文传递、协议转换和意图映射,让跨系统协作像单系统内部调用一样自然流畅。这是实现“机器自主协作”而非“人工编码适配”的关键基础设施。

上下文感知的“粘合剂”

在跨服务的调用链中(例如“查天气 → 推荐影院”),MCP 能够自动维护上下文状态(如用户位置、天气状况、影院筛选条件),确保数据在整个流程中无损传递。

通过引入不同的 MCP 服务器,应用程序可以轻松变身为“多面手”。例如,接入天气服务 MCP,应用就能查询天气;接入地图服务 MCP,就能查询地理位置。这样,应用程序可以通过 MCP 与各种服务交互,灵活扩展功能。

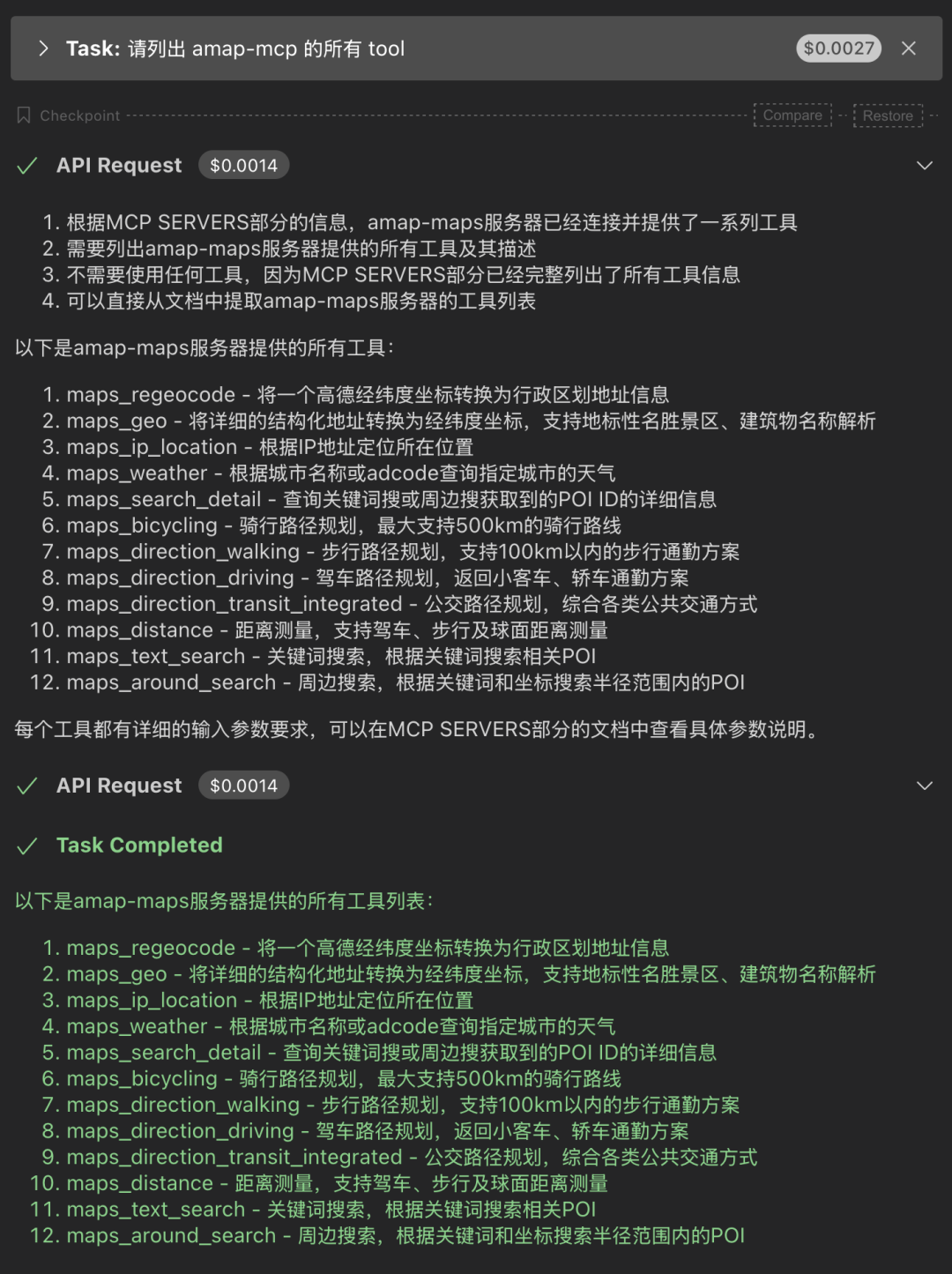

声明式服务

MCP 通过声明式的服务描述,将服务的能力、输入输出、调用方式等信息进行标准化。这使得大模型可以直接获取并理解服务能力,从而自动调用服务,实现智能编排。

以下是一个 MCP 服务器配置示例:

{

"mcpServers": {

"amap-maps": {

"command": "npx",

"args": [

"-y",

"@amap/amap-maps-mcp-server"

],

"env": {

"AMAP_MAPS_API_KEY": "YOUR_KEY_HERE"

}

}

}

}

只需通过上述声明形式描述服务,大模型便能自动获取其能力。当应用连接到 MCP 服务器后,会自动从服务器拉取服务能力列表。因此,当我们询问该服务器具备哪些功能时,它能即刻返回详细列表,而无需实际调用任何工具。

服务智能编排

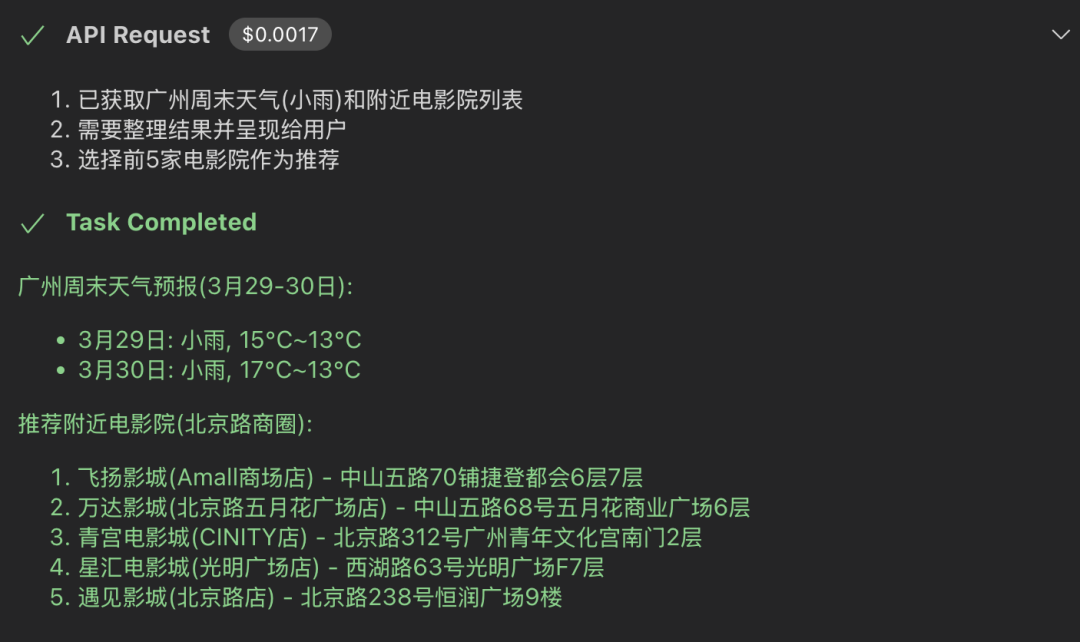

通过 MCP,大模型可以获取服务能力,并自动调用、编排这些服务。以前述的天气影院查询为例,大模型会自动决定功能调用顺序:

- 调用定位服务获取用户位置信息。(示例中因获取 IP 失败,应用提供了交互界面让用户手动选择位置,流程未中断。这里选择了广州。)

- 根据获取的位置和当前时间,调用天气服务获取周末天气预报。

- 如果天气预报显示周末有雨,则调用地图服务获取附近的电影院信息。(示例中广州周末恰好下雨。)

能力热插拔

这让我想起小时候看过的动画片《正义战士》(Centurions)中的装备升级场景。战士们可以根据不同的敌人和战场情况,快速更换由空间站投送的不同装备。

通过 MCP,应用程序可以动态地添加或删除服务,实现能力的“热插拔”。这与传统 API 需要在设计阶段就完成集成的方式截然不同,MCP 允许在运行时动态扩展功能,实现了前所未有的灵活性。

展望

未来,MCP 或将成为 AI 服务生态的“神经系统”:在更多复杂场景中协调多模态设备与服务,在决策链条中串联数据分析与认知模型,甚至可能演进为通用 AI Agent 的底层协作协议。

随着工具生态的不断完善,MCP 将推动 AI 应用从“功能固化的程序”进化为“自主进化的智能体”,最终助力实现“所想即所得”的认知革命。对这类 AI 与系统集成的前沿技术感兴趣?欢迎来 云栈社区 与更多开发者交流探讨。

参考资料