项目由来:一场“被迫开源”引发的社区重构

2026年3月底,AI领域发生了一件颇具戏剧性的事件。Anthropic公司在发布其产品Claude Code的npm包时,由于构建配置出现疏漏,意外将source map文件暴露了出来。这份文件如同一份精密的“施工蓝图”,有人通过解析它,成功还原了约1900个TypeScript文件,总计超过51万行附带完整注释的源代码。Claude Code,这家公司的核心AI编程代理,就此“被迫开源”。这次事件被业内戏称为“AI行业有史以来最详尽的商业AI Agent架构泄露”。

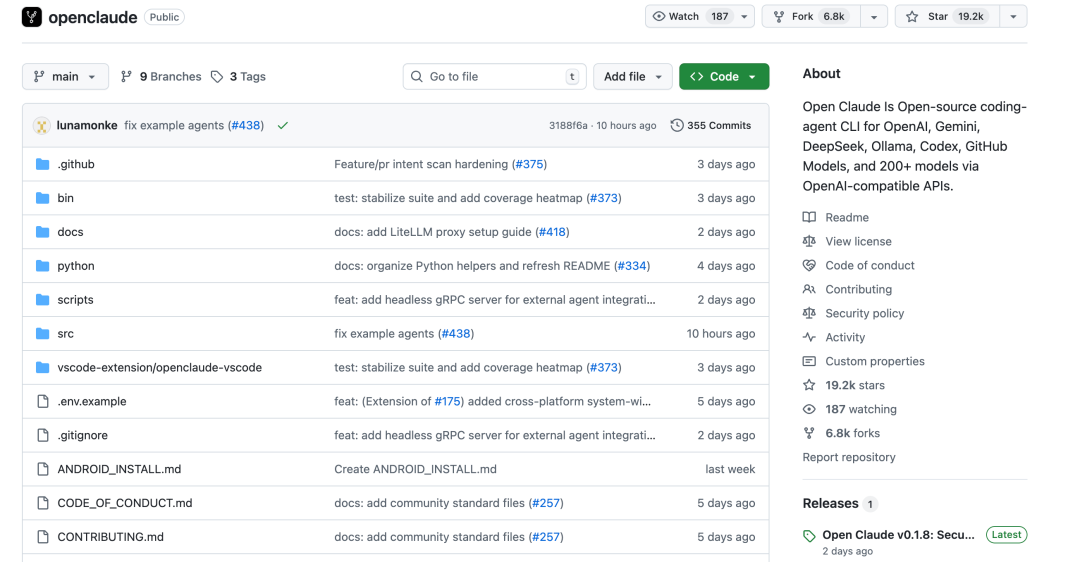

尽管Anthropic随后发起了大规模的DMCA删除行动,试图清理网络上的代码副本,但为时已晚。代码的泄露直接催生了一个异常活跃的开源项目——OpenClaude。这个项目在短短几天内,便在GitHub上吸引了超过1.9万颗星标。更重要的是,它并非简单的代码复制品,而是社区在泄露代码基础上进行的彻底重构与扩展。

OpenClaude将原本仅锁定于Anthropic自家模型的工具层成功解耦,从而演变成了一个真正意义上的通用编程助手。

OpenClaude 是什么?一个模型无关的终端代理

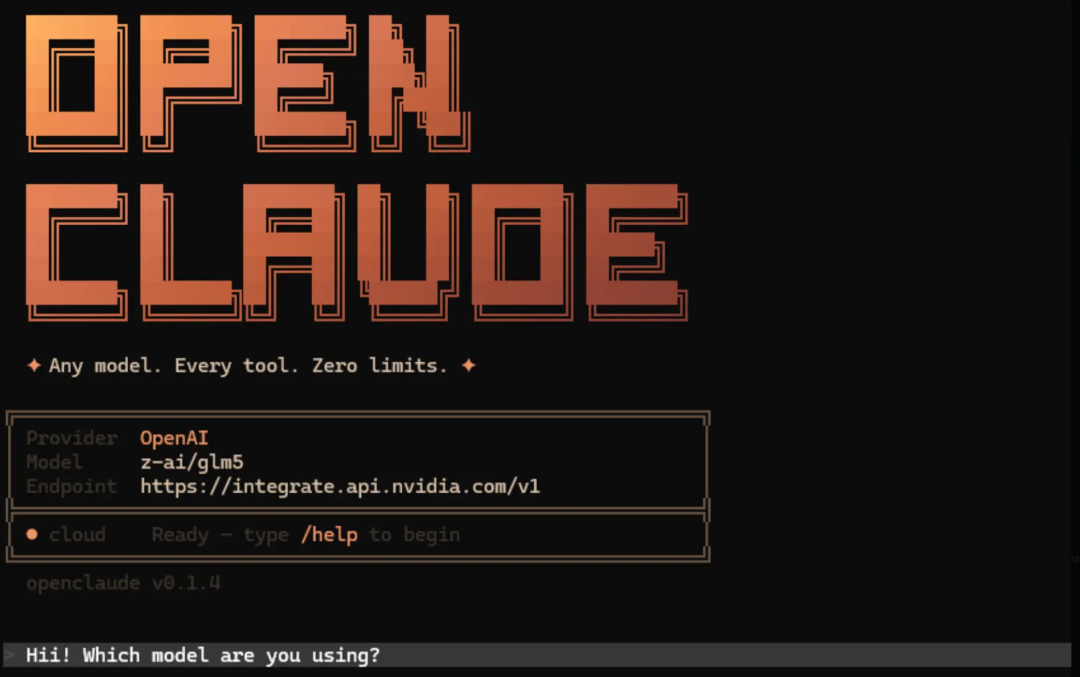

简单来说,OpenClaude是一个 开源的终端编程代理(Coding Agent)和命令行工具(CLI)。它复刻了Claude Code的操作体验,但其核心优势在于 模型不可知性 ——你可以灵活选择不同的AI模型作为后端驱动。

想象一下,你拥有一个强大的编程助手,它能帮你编写代码、调试程序、重构逻辑,甚至自动执行命令行操作。与市面上许多同类工具最大的不同在于,这个助手并不限定于某一家公司的模型。无论是OpenAI的GPT系列、Google的Gemini、国内的DeepSeek,还是在本地通过Ollama运行的开源模型,OpenClaude都能无缝接入。

这种灵活性对开发者而言意义重大。你不再被单一AI服务商绑定,可以根据成本、性能、隐私乃至网络状况等多个维度,自由选择最适合当前任务的模型。关注数据隐私的开发者可以依赖本地模型,避免代码上传云端;追求极致效果的可以选择最新的GPT-4;在意成本的则能以更具性价比的模型开展工作。OpenClaude通过统一的交互界面,支持所有这些选择。

核心特性:不止于代码补全

1. 多模型支持,自由切换

通过内置的 /provider 命令,你可以轻松在不同AI模型供应商之间切换。一次配置,随时调用。这意味着你可以为不同的项目设定不同的模型策略,或在同一项目中快速对比不同模型生成代码的质量与风格。

2. 完整支持MCP协议

MCP(Model Context Protocol)是一套允许AI模型连接外部工具和服务的协议标准。OpenClaude对MCP的完整支持,使其能够接入数据库、文件系统、版本控制系统(如GitHub)、通讯工具(如Slack)等各种外部服务。

例如,当你要求AI助手“查询上个月的订单数据”时,它能自动调用已集成的数据库工具执行查询。这极大地扩展了AI的能力边界,使其从一个单纯的代码生成器,转变为能够与真实世界系统交互的智能代理。

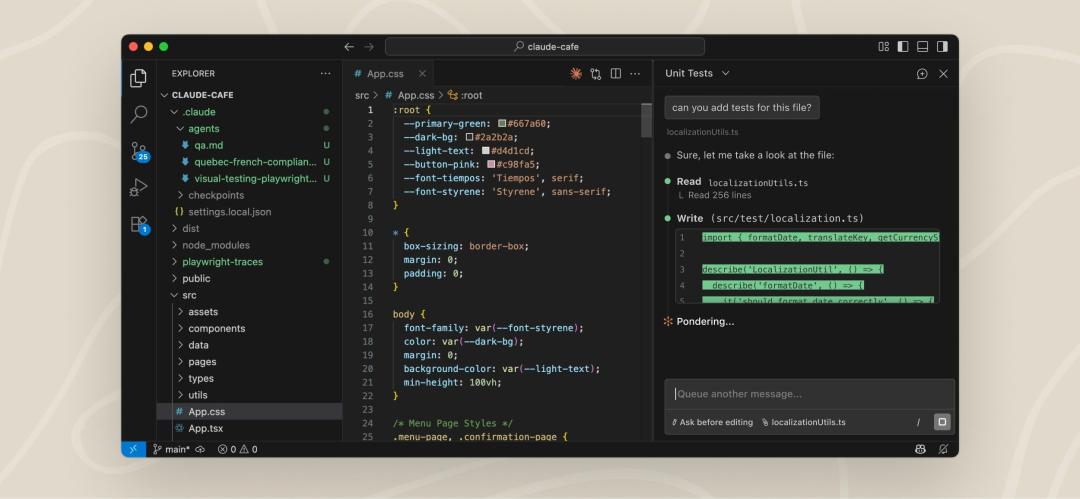

3. VS Code深度集成

项目包含一个官方的VS Code扩展,提供了专属主题和控制中心UI。开发者无需离开熟悉的编辑器环境,即可直接调用OpenClaude的编程助手功能,实现代码解释、生成、重构等一系列操作,显著提升开发效率。

4. 终端优先的工作流

作为一款原生CLI工具,OpenClaude天然契合终端开发者和命令行工作流。它支持:

- 文件操作:直接读取、写入和修改代码文件。

- 系统命令:执行bash命令、进行grep搜索、使用glob模式查询文件。

- 流式输出:实时显示命令执行进度和AI的Token流,交互反馈即时。

- 视觉能力:处理图片URL或base64编码的图片输入,拓展应用场景。

5. 丰富的斜杠命令

OpenClaude继承了高效的对话式交互风格,提供了一系列实用的斜杠命令:

/provider:切换AI供应商与模型配置。/task:定义一个长期或复杂的任务,AI会自动拆解步骤并依次执行。/compact:压缩对话上下文,节省Tokens并加快响应速度。/bug:专门用于分析错误日志、堆栈跟踪,并提供修复建议。/review:审查代码变更(Diff),提出改进意见。

如何开始使用?快速上手指南

安装步骤

OpenClaude基于Node.js开发,安装过程非常直接:

# 全局安装

npm install -g @gitlawb/openclaude

# 启动

openclaude

首次启动后,根据提示输入 /provider 来配置你的API密钥和选择模型。如果在某些操作中提示找不到 rg(即ripgrep,一个高效的代码搜索工具),在macOS上可以通过 brew install ripgrep 命令来安装。

配置MCP服务器(解锁进阶能力)

要充分发挥MCP协议的威力,你可以通过编辑配置文件(通常位于 ~/.openclaude/config.json)来添加各类MCP服务器。例如,配置SQLite和文件系统服务器:

{

"mcpServers": {

"sqlite": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-sqlite", "--db", "./my-database.db"]

},

"filesystem": {

"command": "npx",

"args": ["-y", "@modelcontextprotocol/server-filesystem", "/path/to/your/workspace"]

}

}

}

配置完成后重启OpenClaude,它会自动连接这些服务器。此后,当你向AI提出相关需求时,它便能智能地调用这些工具来完成任务。

实际应用场景

- 高效的代码生成与重构:“帮我把这个Class组件改写成React函数组件并使用Hooks”、“为这个工具函数添加完整的TypeScript类型定义”。OpenClaude能够理解自然语言描述的需求,并生成或修改对应代码。

- 快速问题排查:当程序运行时抛出异常,使用

/bug 命令,将错误信息粘贴进去,AI会分析可能的原因,并给出修复方案甚至直接提供修正后的代码片段。

- 数据库查询与操作:通过MCP集成SQLite或其它数据库后,你可以用自然语言让AI执行数据查询、生成报表,甚至进行复杂的数据迁移操作。

- 自动化复杂编程任务:

/task 命令让AI能够处理多步骤任务。例如:“整理这个项目的目录结构,删除已注释的无用代码,并生成一份项目README”,AI会自行规划步骤并逐一执行。

- 隐私优先的本地开发:对于处理敏感代码或数据的场景,你可以配置本地运行的Ollama模型作为后端。这样,所有代码和交互数据都不会离开你的本地环境。

核心优势:为何选择OpenClaude?

最直接的对比对象无疑是Anthropic官方的Claude Code。两者在基础功能和使用体验上颇为相似。但OpenClaude凭借其开源和开放的架构,展现出几个显著优势:

1. 供应商独立性:摆脱了与单一AI服务商的强绑定。你可以在OpenAI、Google、Anthropic乃至无数开源模型之间自由选择,完全根据需求决定。

2. 完全开源透明:代码库完全公开,社区可以审计、贡献、自定义。即使未来官方停止维护,社区也有能力继续推进项目发展。

3. 成本控制灵活:日常开发使用成本较低的模型,关键或复杂任务切换到性能更强的付费模型,成本控制权完全掌握在开发者手中。

4. 极强的隐私保障:配合本地模型使用时,你的代码和项目数据无需上传至任何第三方云端服务器,为企业级和敏感项目开发提供了安全保障。

5. 强大的可扩展性:对MCP协议的完整支持,意味着你可以通过自定义或社区开发的MCP服务器,将任何外部系统或服务集成到你的AI编程工作流中。

此外,社区中还有一个类似项目叫 OpenClaw,它更偏向于“私人助手框架”,提供了一套Skill技能包体系。相比之下,OpenClaude的定位更加聚焦——它致力于成为Claude Code在终端环境下的开源替代品,核心目标就是提升代码编写、重构和调试的效率。

总结与展望

OpenClaude的故事本身就是一个有趣的缩影:从一场意外的代码泄露事件,到社区积极应对,最终重构出一个更开放、更灵活的开源替代品。这不仅是技术的胜利,也体现了开源文化的强大生命力。

展望未来,OpenClaude有几个值得期待的发展方向:

- 更强的本地模型支持:随着Llama、Mistral、Qwen等开源大模型能力的持续进步,在本地运行一个高效能的专业编程助手将越来越成为现实。

- 企业级功能增强:针对团队协作的代码审查集成、安全合规审计、项目管理看板等功能可能会逐步加入。

- 跨平台深度集成:从终端(CLI)扩展到更多开发环境,如JetBrains全家桶、其他主流IDE以及Web IDE的深度集成。

- MCP生态繁荣:预计会有越来越多的工具和服务通过MCP标准与OpenClaude集成,不断拓宽这个编程助手的能力边界。

对于开发者而言,OpenClaude的出现意味着我们既能够享受到现代AI编程助手带来的巨大效率提升,又能保持对自身技术栈、数据隐私和成本结构的完整控制权。这种“鱼与熊掌兼得”的可能性,正是开源技术最迷人的地方。如果你对如何融合前沿AI能力与经典开发工作流感兴趣,不妨到云栈社区的相关板块,与更多开发者一起探讨和实践。

项目GitHub地址:https://github.com/Gitlawb/openclaude