Anthropic 又因为封号问题成为了争议的焦点。

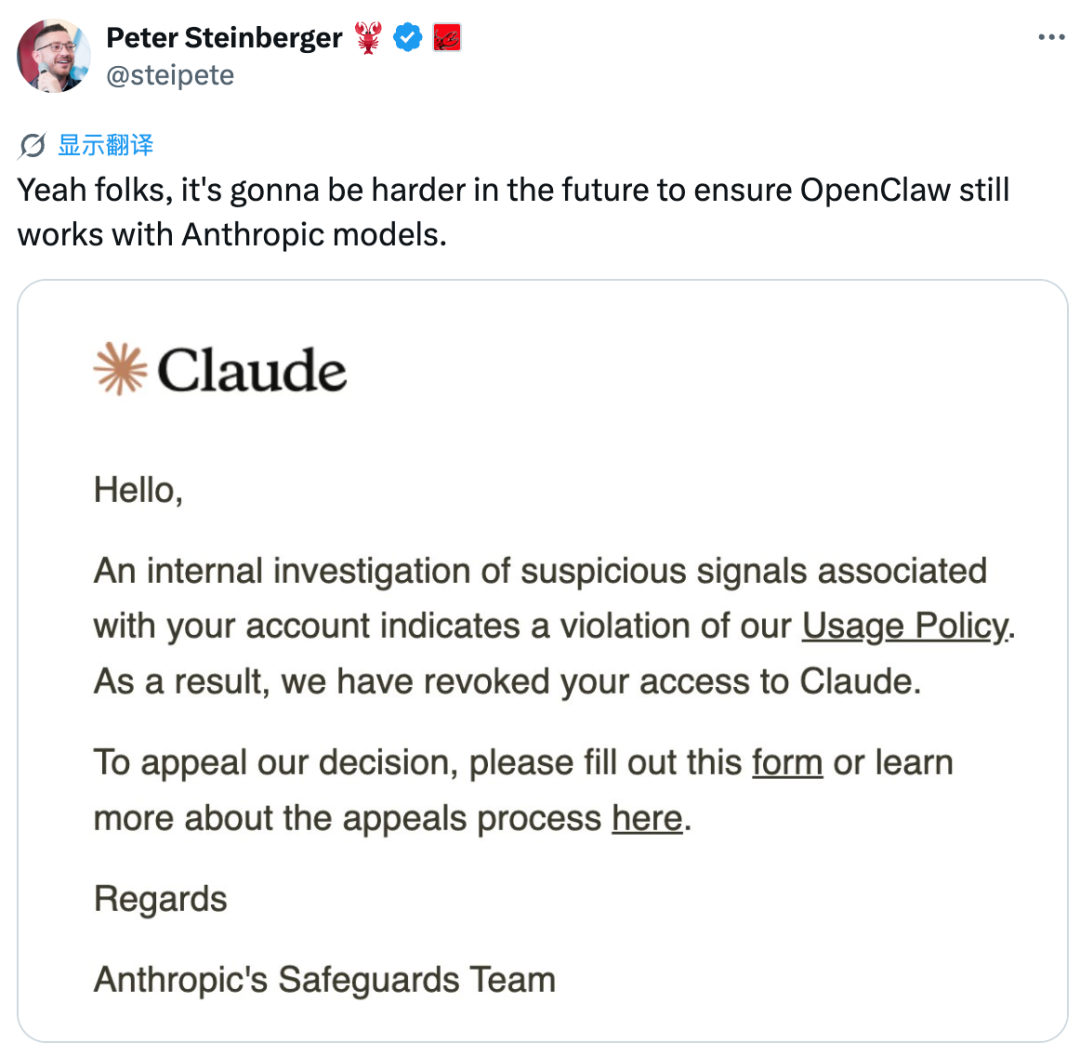

近期,第三方 Claude 客户端 OpenClaw 的创始人 Peter Steinberger 在社交平台抱怨,自己的 Claude 账户一度因“可疑活动”被暂停,随后才得以恢复。Claude “爱封号”这件事几乎所有 AI 玩家都有所了解,但这次事件可能与 Anthropic 几天前调整规则有关——他们收紧了 OpenClaw 这类第三方 Agent 对 Claude 订阅额度的调用方式。

实际上,过去两年 Anthropic 不断陷入此类争议。作为最强调安全的 AI 公司之一,其审核机制和风控逻辑对用户而言却常常不够明确,随意封禁用户账号的情况时有发生。矛盾之处在于,Claude 凭借其出色的代码能力、稳定的长文本处理以及复杂任务表现,依然吸引着大批忠实用户与开发者。

这就形成了一个尴尬的局面:Anthropic 一边靠模型能力不断吸引开发者,一边却没有给出清晰、可预期的风险边界。对于所有用户而言,每一次使用都像站在刀尖上跳舞。

半年狂封145万个账号,Claude的风控“杀疯了”

Anthropic 这次与 OpenClaw 的风波之所以引发广泛讨论,主要是这家公司在账号管理方面的老问题终于触及到了有影响力的“大佬”,这让许多过去只敢私下抱怨的开发者和用户纷纷站出来指责。

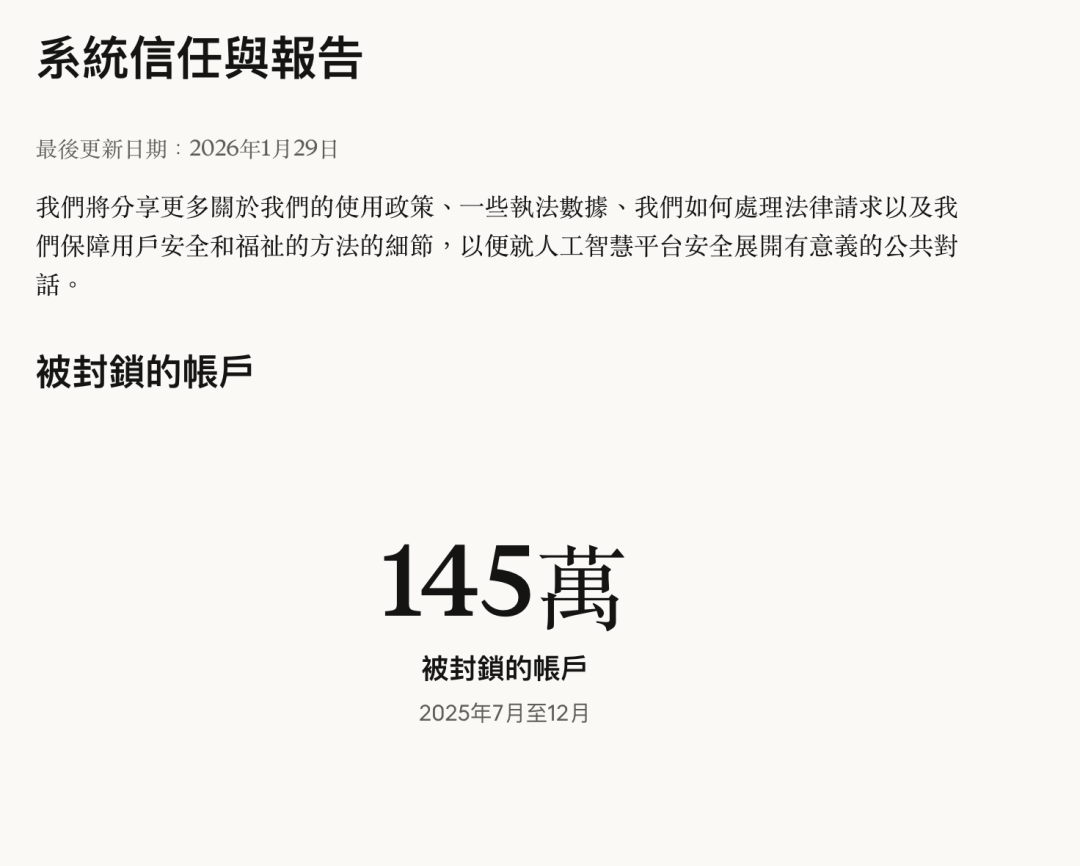

根据 Anthropic 在 2026 年 1 月更新的透明度报告显示,仅在 2025 年 7 月到 12 月这半年间,它就封禁了高达 145 万个账户。 同期,官方收到了 5.2 万次申诉,其中仅有 1700 次申诉被推翻。虽然提交的申诉基本都通过了,但核心问题在于,Anthropic 对于风控管理的解释始终不够清晰透明。

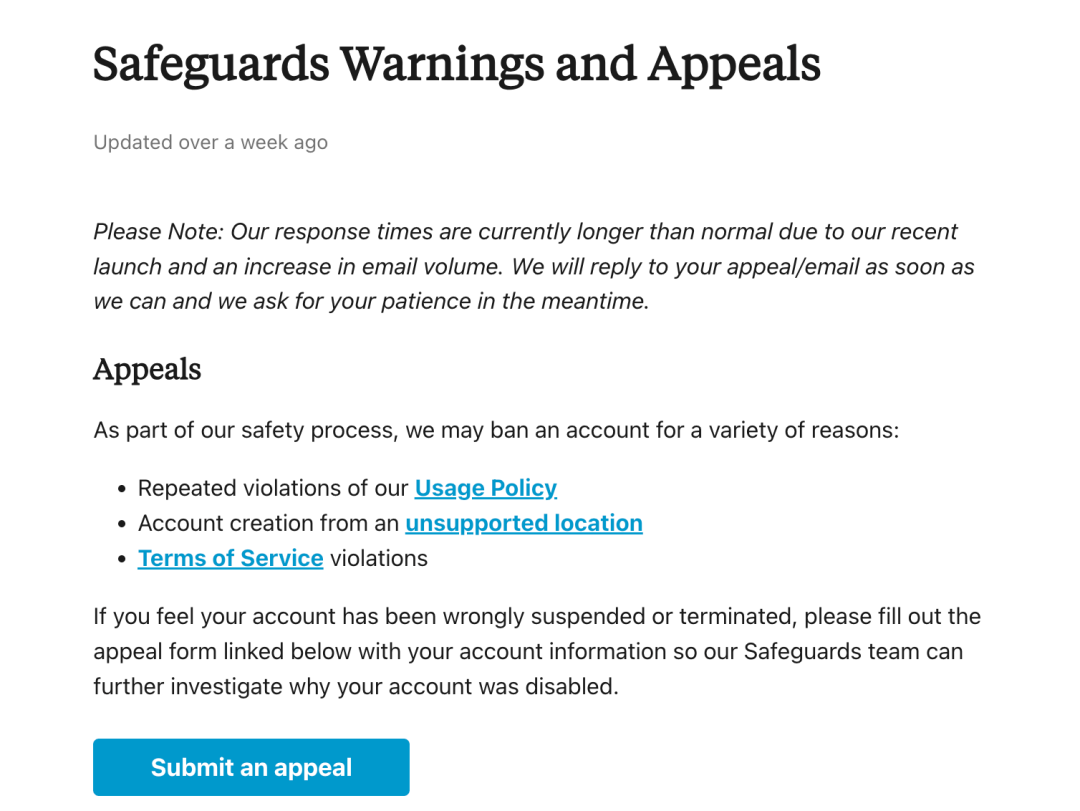

Claude 官方帮助中心目前的表述是,账户可能因“反复违反使用政策”、“来自不支持地区注册”或“违反服务条款”而被停用。用户若认为自己被误封,可以走申诉流程。规则听起来明确,但实际操作起来远非如此。

按照官方的说法,由于产品上线和邮件量增加,回复速度可能慢于平时。试想一下,假如你是一名依赖 Claude 工作的开发者,账号莫名其妙被封禁,申诉还要等上一两天甚至更久,整个工作计划岂不是全被打乱了?

问题远不止于此。去年 8 月,有用户在相关 issue #5088 中表示,自己刚支付了月费 100 美元的 Claude Code Max 5x 套餐,立刻就收到了 “This organization has been disabled” 的报错,之后通过邮件、申诉表和站内支持均未得到有效回应。同年 10 月,又有人发帖求助,自己的 MAX 订阅过期后续费,账号直接被封,最终只收到一句“违反 Usage Policy”的模糊结论。

这意味着,即便是支付了高额费用的高级订阅用户,其合理诉求也可能不被正视,同样面临无故被封的风险。

更令开发者们无奈的是,即便是 Anthropic 自己提供的官方集成方案也并非绝对安全。例如,有用户反馈称,自己在高频使用官方的 GitHub App 或 Claude Code Action 进行 PR 审查时,账号会被系统识别为“脚本化异常行为”,从而导致永久封禁。

Claude 至今仍是许多开发者和用户青睐的大语言模型工具,Anthropic 也一直将“安全”作为核心口号。但其在安全管理上经常性的“一刀切”做法,确实让开发者社群叫苦不迭。

独立开发者亲述:当工作流因封号突然中断

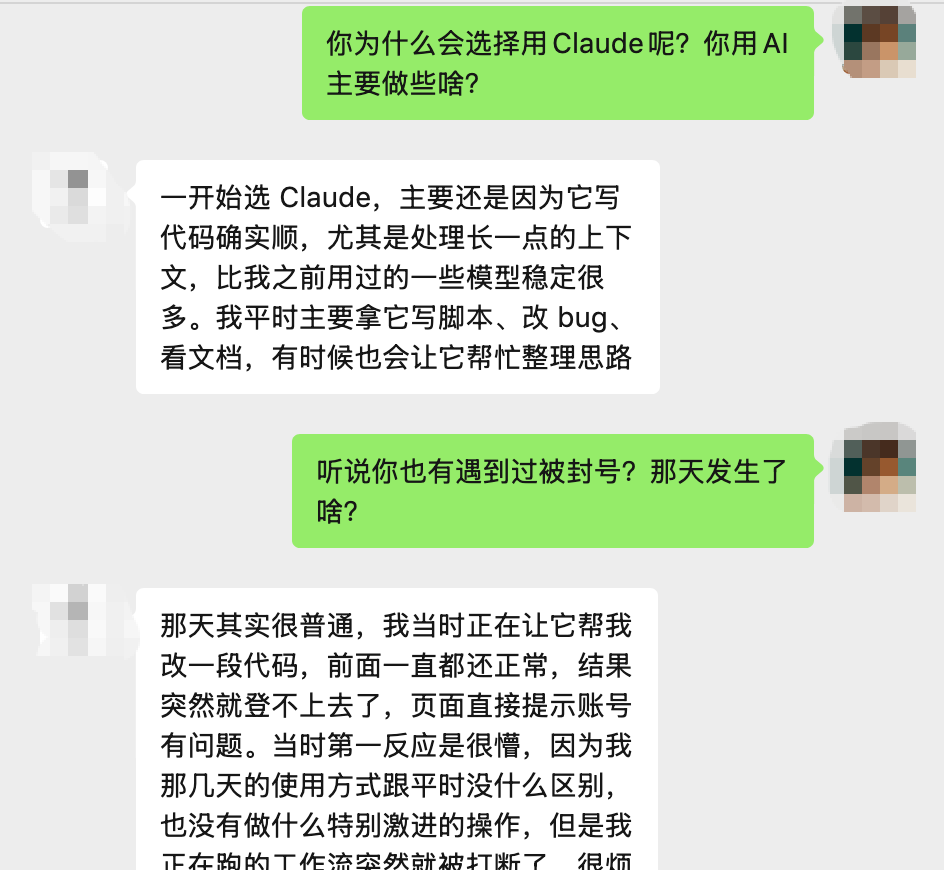

我们认识一位真实的 Claude 用户。他目前定居美国,在 2025 年辞去稳定工作后,开始在家独立开发一款小众应用。由于并非科班出身,他在转向独立开发后,从功能设计、代码编写到文档整理,很多环节都高度依赖 AI 工具的辅助。

起初,他并非直接选择 Claude,而是在尝试了 GPT 和 Gemini 之后,才逐渐将重心转移到 Claude 上,甚至直接订阅了 MAX 套餐。他表示,Claude 的代码生成能力,在他接触过的 AI 工具中,当时确实是“独一档”的存在。

然而意外发生了。那天他正让 Claude 帮忙修改一段代码,前面的对话一切正常,页面却突然跳出了账户停用提示。他的第一反应是彻底懵了——明明刚才还在准备运行代码,怎么突然就被停用了?自己并没有进行任何非法或特别的操作。

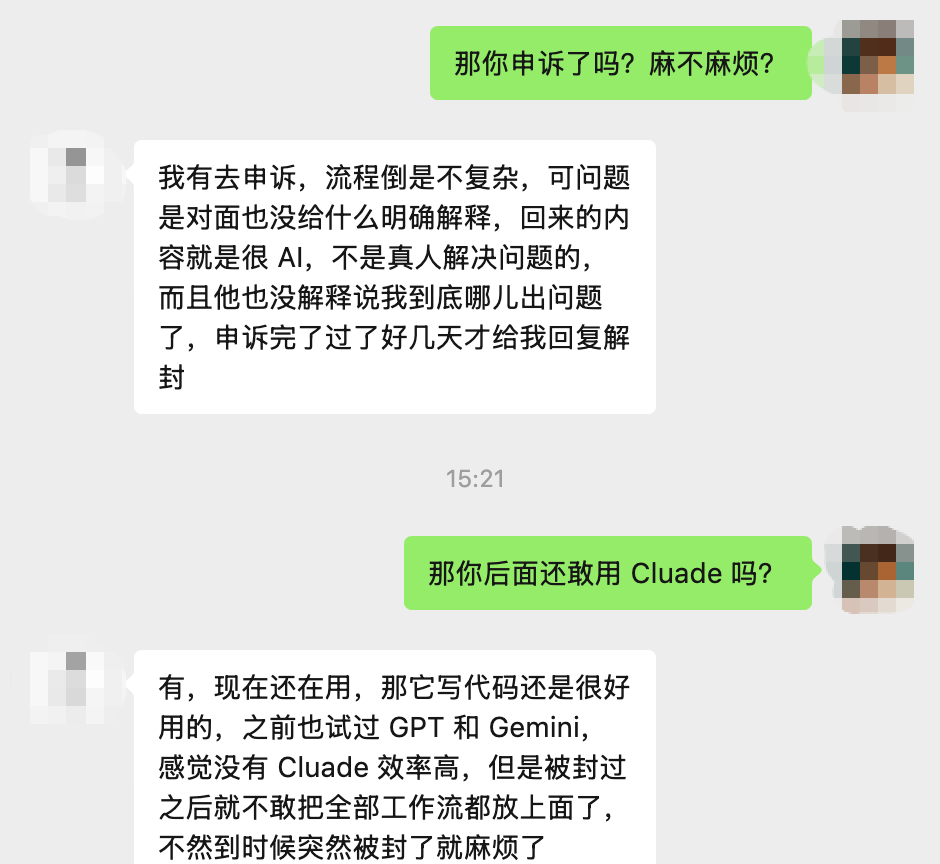

他立刻提交了申诉。虽然申诉入口是开放的,但等来的回复非常模板化,既没有明确解释是哪一步触发了风控,也没有说明未来该如何避免类似情况。

这正是大部分 Claude 用户最担忧的时刻:用户不知道自己为何被拦,不确定这是否是误判,更不知道下一次正常使用时是否会重蹈覆辙。对于已将 Claude 深度融入生产力流程、并愿意为之付费的用户来说,这种不确定性带来了不小的冲击。

Claude 这类工具的一个重要特点是强记忆性。一旦整个账户被停用,之前所有的对话历史、提过的需求、修改过的代码思路将全部丢失。大约三天后,他的账号得以恢复,但部分工作思路已经模糊,需要重新梳理。

尽管经历了这次风波,他最终还是选择继续使用 Claude,因为他认为目前 Claude 用起来仍然比 GPT 和 Gemini 更顺手。不过,他也明确表示,今后不会再将所有核心任务都押注在 Claude 上,因为其不可预知的封号风险实在太大了。

平台“一言堂”与开发者的应对:本地化与开源成趋势

究其根本,Anthropic 之所以在封号、改规则上显得较为“任性”,正是因为它清楚只要 Claude 的核心能力依旧领先,许多用户最终仍会回归。但问题恰恰在于,当前这些闭源的云端 AI 产品,越来越像结合了云服务商和应用商店特质的“超级平台”——模型能力、审核权、解释权、定价与规则制定权都牢牢掌握在平台手中。

一旦账户被封,许多开发者的关键工作流便会瞬间失效。这种依赖性催生了对替代方案的迫切需求,也使得开源模型和本地部署越来越受到重视。

例如,Google 在 2026 年 4 月发布的 Gemma 4 模型,不仅缩小了模型尺寸,还在性能上取得了显著突破。Google 这次提供了多个尺寸的版本,小的可以运行在手机、笔记本等设备上,稍大的版本对算力要求也相对友好,非常适合本地部署。官方测试数据显示,其 31B 和 26B 版本在知识理解和代码能力上已经达到了相当实用的水平。

根据 Google 的介绍,Gemma 4 采用了混合注意力机制,交错使用局部滑动窗口注意力和全局注意力,同时在长上下文中使用统一的 Key/Value 和 p-RoPE 来降低内存压力。这些技术优化使得模型能在更低的显存和功耗条件下,承担起更复杂的推理、编码和智能体任务。

直白地说,过去一提到本地部署,很多人的印象还是“小模型能力不足,大模型硬件门槛高”,真要干正经活还得靠 Claude、GPT 这类云端闭源产品。但现在的趋势表明,功能强大的开源小模型正变得越来越可行。过去严重依赖云端的长代码生成、多轮复杂任务等场景,已经开始有机会被迁移到本地环境运行。这让开发者们看到了摆脱对单一云端服务商依赖的希望。

那么,如果未来越来越多的开发者将关键任务迁移到本地,Anthropic 这种动辄封号的做法会有所收敛吗?从技术角度看,短期内完全替代仍有挑战,但方向无疑是符合大多数开发者预期的。毕竟,只要模型运行在自己的设备上,什么账号被封、平台限流、订阅条款说改就改这类烦心事,几乎就不会发生了。关于 AI 开发工具的选择与生态讨论,也欢迎你来云栈社区的开发者板块一起交流。