昨天,Claude 官方博客发布了一篇引人深思的文章。

标题翻译过来是 “使用 Claude Code:会话管理与 100 万上下文窗口”,副标题则点明了核心:

在 Claude Code 中,你如何管理会话、上下文与上下文压缩,对最终效果的影响远超预期。本文为一份实用指南,帮你在每一步都做出恰当选择。

这直接戳中了许多开发者的痛点:我们常感觉,和 Claude 聊了半小时后,前20分钟它还像个天才,后20分钟却突然“降智”了。

刚确认了三遍的需求,它忘了;反复纠正过的格式,它继续错;甚至连十分钟前刚给的数据,它都能“睁着眼睛说瞎话”。你一度怀疑是自己的 Prompt 没写好。

但现在,Anthropic 的 Claude Code 核心开发者明确指出了问题所在:很大程度上,是你的使用方式有问题。这锅甩得,合着横竖都是用户的错呗?

大部分人的选择有问题

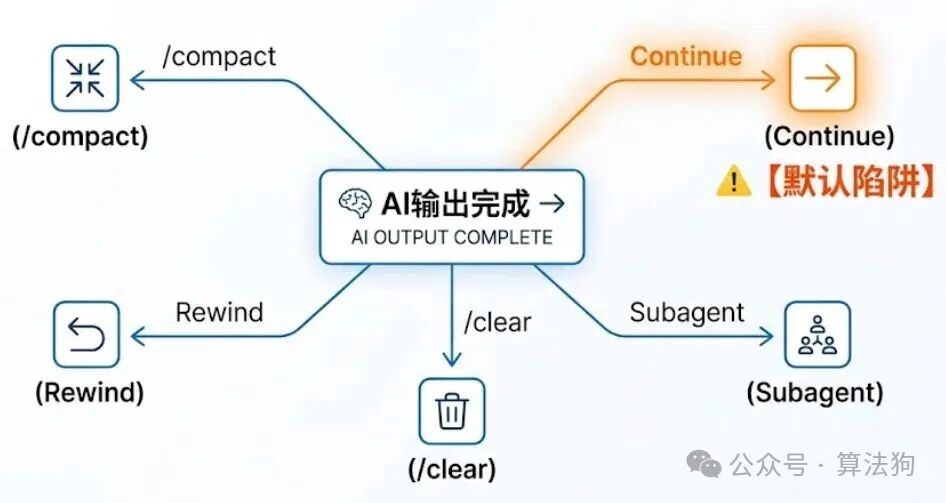

官方直接甩出一张流程图,一句话道破了真相:

他们指出:每一次 AI 输出完毕,都不是对话的终点,而是一个“五选一”的关键决策点。

然而,绝大多数用户只会条件反射般地点击那个默认跳出来、看起来最省事的选项:Continue(继续)。其余四个按钮,很多人甚至从未点击过,也不清楚它们的具体用途。

这就像一个岔路口,摆着五条路:四条分别写着“回头 (Rewind)”、“清空背包 (Clear)”、“轻装前进 (Compact)”、“找人帮忙 (Subagent)”,剩下那条最显眼的路写着“继续往前冲 (Continue)”。大多数人的选择永远是“继续往前冲”,哪怕前面是沼泽,然后回头抱怨路太难走。

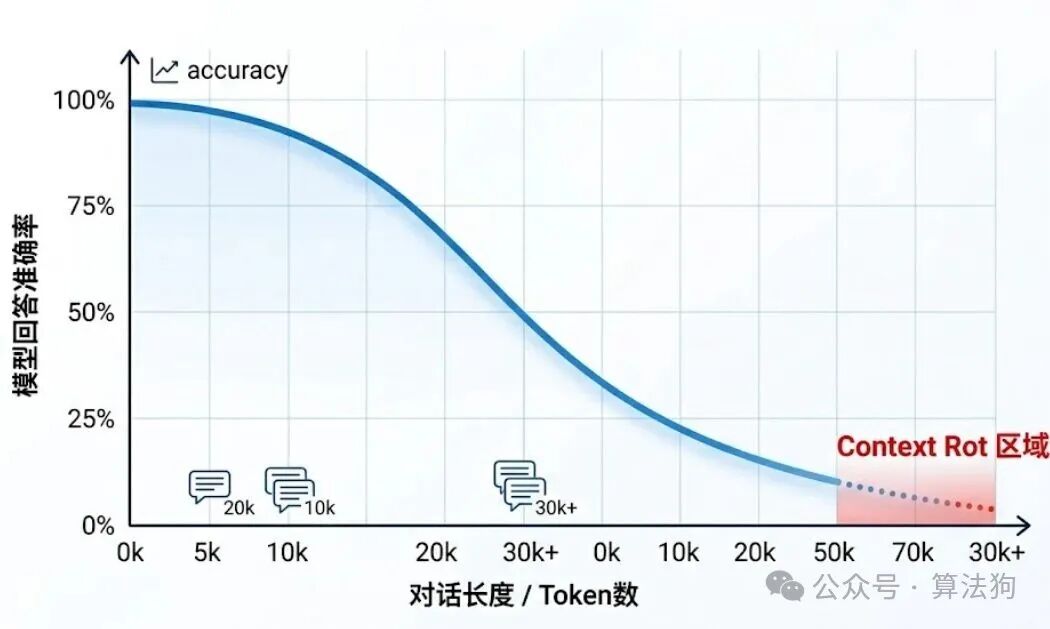

长上下文的真相:越大越笨,越聊越蠢

这次,官方非常坦诚地说了一句可能“打脸”整个行业的话:1M(百万级)的上下文窗口根本解决不了实际问题。

为什么?

因为长上下文的模型性能会随着 Token 数量的增加而线性衰减。说人话就是:对话越长,模型越“笨”。它的注意力越分散,旧内容像垃圾一样堆积,对新输入的干扰越来越严重。最终,模型会进入“失忆”甚至“胡言乱语”的状态,连自己三分钟前刚说过的话都可能不认。

这不是你 Prompt 的问题,是它的“脑子”(注意力机制)已经过载转不动了。从技术角度看,对话越久,有效信息密度越低,模型输出的质量必然下降。过去这只是坊间猜测,如今被官方技术文档实锤了。

五个按钮,将成功率从10%拉到90%

这次官方的动作并非推出了什么黑科技,而是把“上下文管理”的选择权和责任交还给了用户。说白了,就是教用户如何自己“背好这个锅”。

没有高深的技巧,就五个简单的选项,但每一个都在传达同一件事:主动管理,而非被动累积。

- Continue: 继续对话,在当前会话中发送下一条消息。(默认选项,也是“陷阱”所在)

- /rewind (esc esc): 回退指令,跳回到之前某条消息,从该位置重新尝试。(及时止损)

- /clear: 清空当前会话,开启一个全新会话,通常会基于你刚梳理的要点继续。(主动遗忘,轻装上阵)

- Compact: 上下文压缩,对当前会话内容进行智能总结,并在总结的基础上继续对话。(知识提炼,去芜存菁)

- Subagents: 子代理模式,将下一部分工作委派给一个拥有独立、干净上下文的子代理执行,仅将其最终结果回传合并。(分工授权,保持主线清晰)

有用户吐槽:“我不想用 Compact,它删得太多了,我想要它精准删掉那些没用的工具调用输出。” 这确实是当前压缩功能的一个痛点,其“全量压缩”的粒度较粗,可能会丢失重要细节。

一个更精准的替代方案是:使用 /clear 清空会话,然后手动提炼之前的核心结论和需求作为新对话的起点。虽然慢一些,但可控性和精准度极高。

行业的信号:别再只卷窗口大小了

回顾过去一两年,AI 公司们在疯狂比拼什么?没错,就是上下文窗口长度。1M、2M、10M……数字不断刷新,仿佛谁的数字大谁就更强。

如今 Anthropic 的结论无异于泼了一盆冷水:别只卷这个了,单纯扩大窗口治标不治本。

窗口再大,如果你不会管理,上下文质量依然会崩溃,最终效果大打折扣。这场竞赛的重点,正在从 “能装下多少” 转向 “能有效管理和利用多少”。

这不只是AI的事,更关乎个人效率

在我看来,这套“上下文管理”哲学远不止适用于 AI 对话。

它本质上是一套完美的个人认知与工作效率操作系统手册。我们的大脑,本身就是一个有限“上下文”的处理器:

- Context Rot (上下文腐烂) = 认知过载与信息焦虑。任务和杂念越多,思维越混乱,决策质量越差。

- Rewind (回退) = 及时止损。意识到方向错误时,果断回撤,而不是在错误路径上持续投入沉没成本。

- Compact (压缩) = 知识提炼。把厚厚的书籍、冗长的会议记录、复杂的项目经验,压缩成可执行的要点和原则。

- Clear (清空) = 主动遗忘与重启。定期清理大脑缓存,扔掉过时的计划、消耗心力的琐事和无效的“思维草稿”。

- Subagent (子代理) = 分工与授权。不是所有事都必须亲力亲为,善于利用工具、委托他人或分解任务。

效率差距,由此指数级拉开

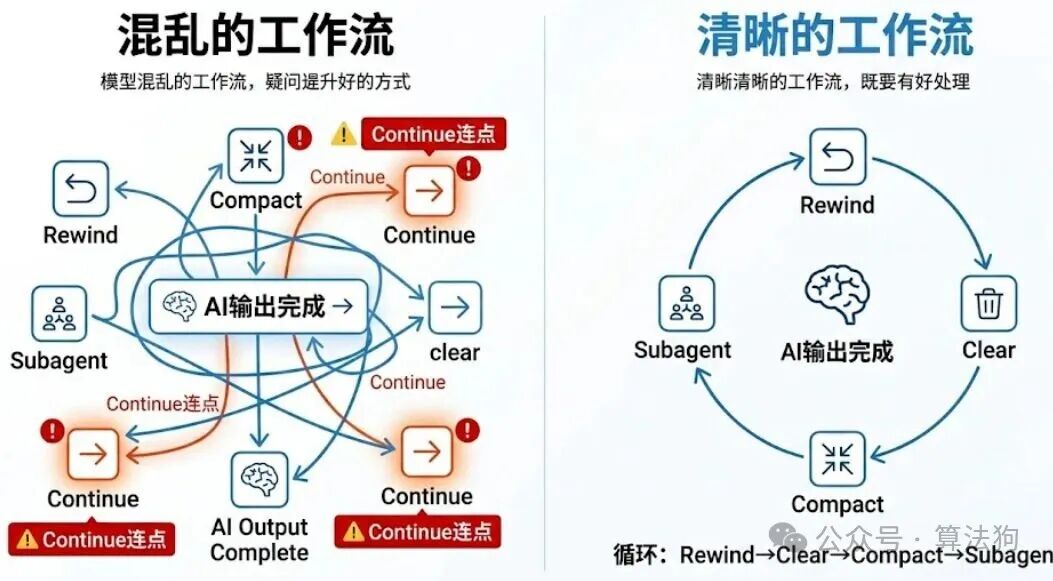

很多人疑惑:同样使用 AI,为什么有人能协作完成复杂项目,有人聊了20句就开始和“失忆”的 AI 反复扯皮?

答案现在很清晰了:

- 低效路径:一条对话聊到底,从不清理、不回退、不压缩。AI 变笨了就抱怨,然后无奈开新对话,从头再来。如此循环,时间在低效拉扯中耗尽。

- 高效路径:在每一个关键节点主动决策——该回退时就回退,该清空时就清空,该压缩时就压缩,该分发任务时就分发。始终保持对话“轻装上阵”,让 AI 始终处于高性能状态。

这两种使用习惯的差距,会随着时间推移和任务复杂度的增加而指数级放大。

给你的实用建议

- 找到你的“临界点”:打开 Claude Code(或其他支持长上下文的应用),输入

/usage 命令,查看你的 Token 使用历史曲线。找到那个“模型开始明显变笨”的 Token 数阈值。例如,有人发现对话长度超过 30 万 Token 后,输出质量就急剧下降。

- 主动管理,而非被动等待:记住这个阈值。以后当对话长度接近它时,就主动使用

/compact 或 /clear,别等模型已经“傻了”再补救,那时信息可能已严重污染。

- 敢于尝试其他按钮:刻意练习使用 Rewind、Clear、Compact 和 Subagents。理解每个动作在当下对话中的意义,形成管理上下文的肌肉记忆。

最后,不妨在开发者广场和大家聊聊:你上一次在 AI 对话中,主动点击“Continue”之外的选项,是什么时候?

如果你的答案是“从来没有”或“记不清了”,那么现在,你至少知道问题出在哪儿,以及该如何改进了。