继续追踪前沿技术动态,本期聚焦两个方向。

一是关于 Harness Agent 的综述文章,图表绘制精良,对各组件间关系的刻画也非常到位,值得收藏学习。二是几项值得关注的基础模型开源进展,包括 Qwen 系列的 Qwen3.6-35B-A3B 模型以及图像生成大模型 ERNIE-Image。

一、Agent 外部化基础设施的综述解析

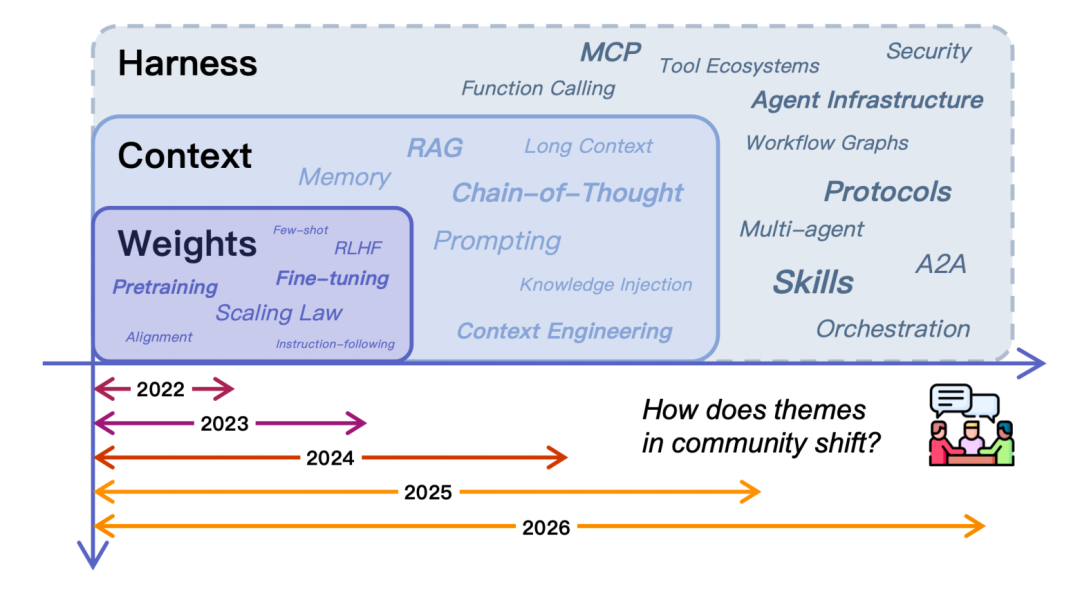

这是一篇关于智能体领域 Memory、Skills、Protocols 与 Harness 等核心概念的系统性总结文章,题为《Externalization in LLM Agents: A Unified Review of Memory, Skills, Protocols and Harness Engineering》(arXiv:2604.08224)。其核心观点在于,当前 LLM Agent 的进步,已经不再主要依赖于模型规模的扩大或参数量的增加。

文章认为,未来真正决定 AI 能力上限的,是“外部化”(Externalization)——将原本需要模型内部承担的认知负担,系统地转移到外部的、可管理的基础设施中。换句话说,就是将记忆、规划、协作、控制等能力,从模型的“内部思考”转变为“外部的、显式的、可复用的组件”。

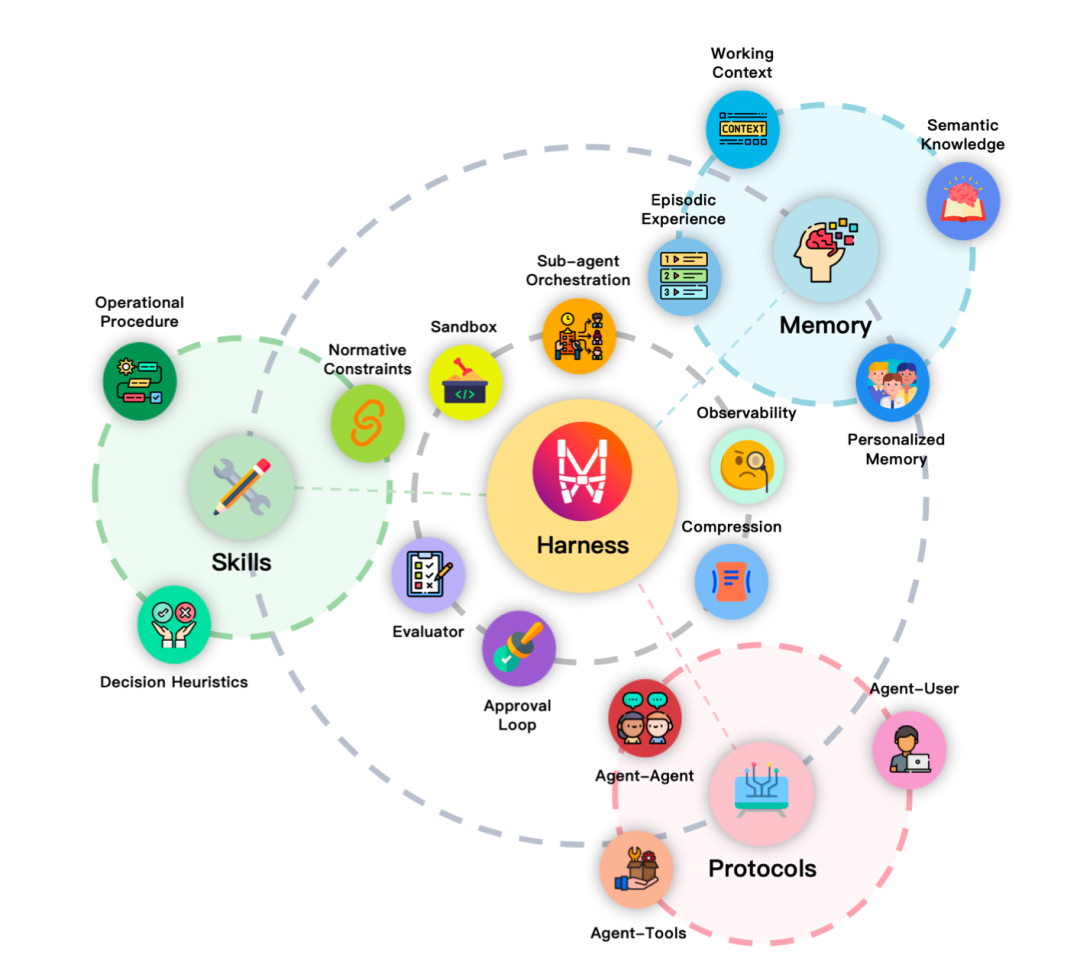

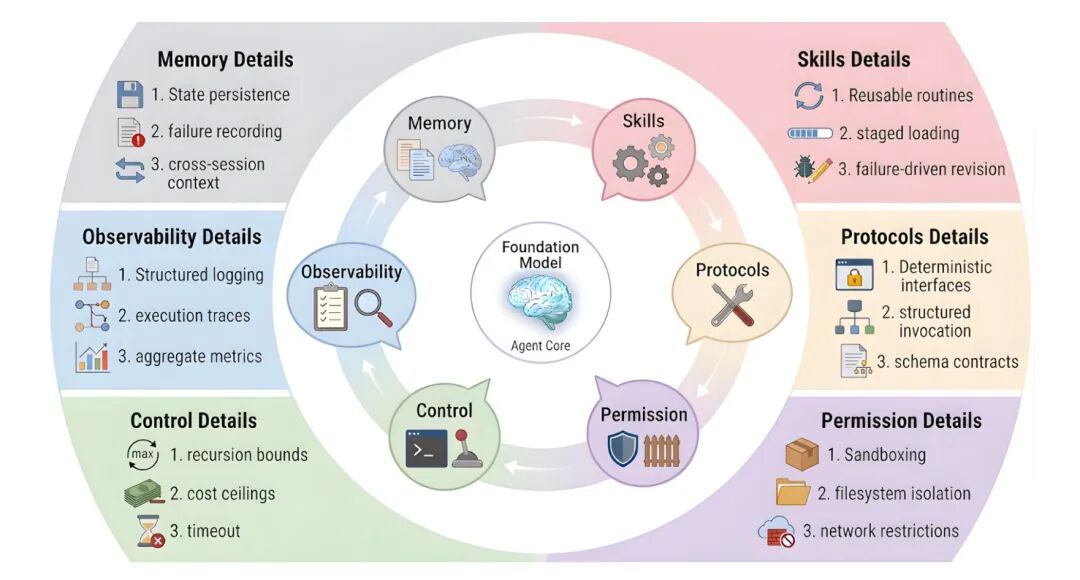

我们可以通过以下总结性图表,直观地理解 Harness 与其外围组件(如 Memory、Skill、Protocols 等)之间的层次与协作关系。

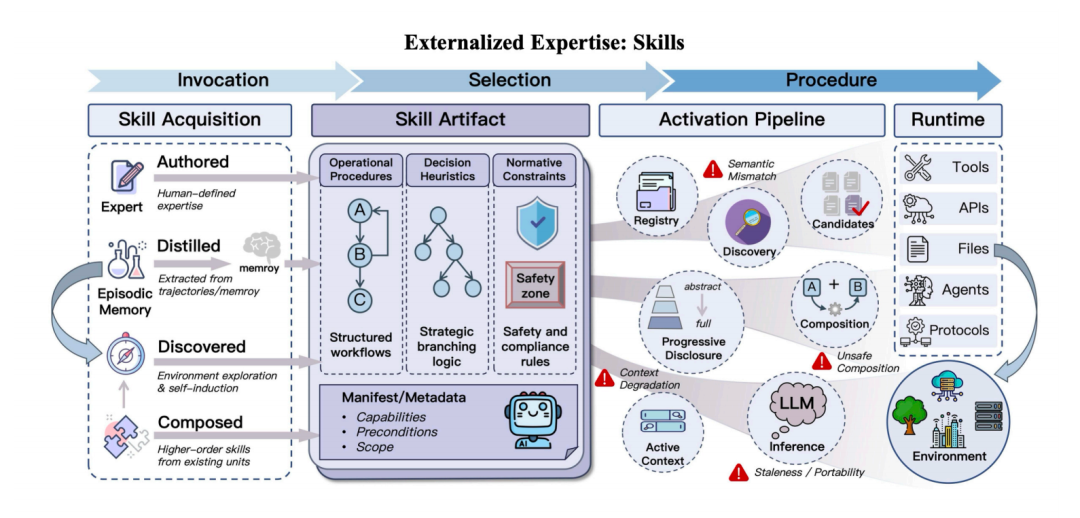

再以 Skill(技能) 为例,文章详细剖析了其合成与运行的完整流程,值得回顾。

技能的来源是多样化的:可以由领域专家直接撰写定义,也可以从真实的执行轨迹或记忆中进行提炼,还能通过智能体自主探索环境、自我推演而发现,亦或是将已有的基础技能模块重新组合而成高阶技能。

最终形成的技能,会被打包成可直接运行的标准化组件,主要包括:结构化的操作流程、基于分支逻辑的决策启发式规则、以及保障安全合规的规范性约束。同时,每个技能都附带有清晰的清单与元数据,明确其能力范围、执行所需的前置条件以及适用的场景边界。

在系统运行时,技能的激活流程依赖于一个中央化的技能注册表来实现动态发现。系统通过语义抽象,将模糊的自然语言任务需求逐步拆解,匹配并组合出完整的可执行方案。整个流程能够灵活地将技能与各类工具、API、文件、其他智能体以及通信协议进行绑定与编排。

二、近期开源模型进展一览

1、图像生成大模型 ERNIE-Image

百度发布了文本生成图像模型 ERNIE-Image。该模型基于 8B 参数的单流 Diffusion Transformer 架构,并内置了一个基于 Ministral 3B 微调而来的轻量级 Prompt Enhancer(提示词增强器),旨在优化用户输入的文本描述,以生成更高质量的图像。

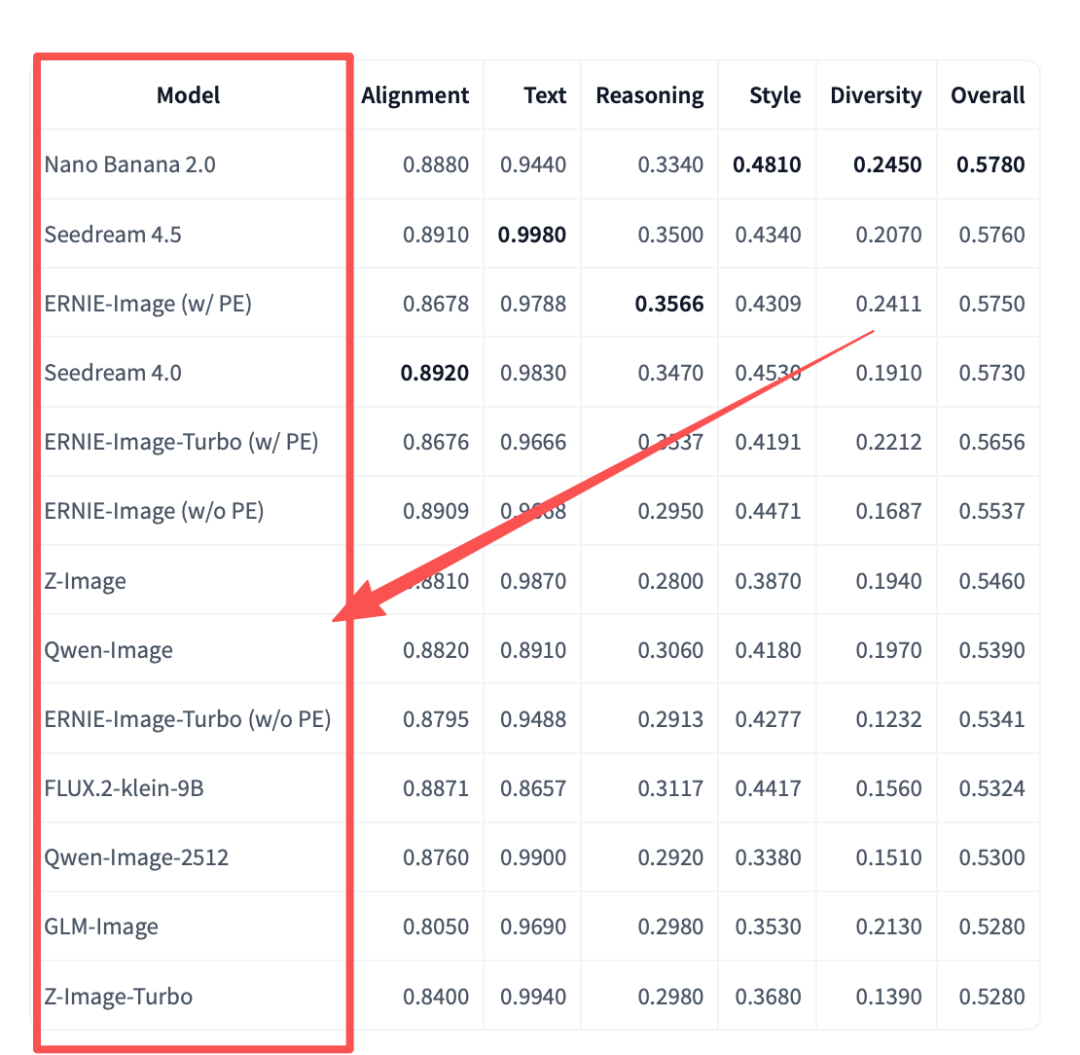

借此机会,我们可以一览当前一些主流文生图模型在多项评测指标上的表现对比。

2、Qwen 系列模型 Qwen3.6-35B-A3B

通义千问开源了 Qwen3.6-35B-A3B,这是一个采用混合专家(MoE)架构的模型。其总参数量为 350 亿,但在推理时每次仅激活约 30 亿参数,在保持强大能力的同时提升了推理效率。该模型支持多模态输入,并提供了“思考”与“非思考”两种推理模式。

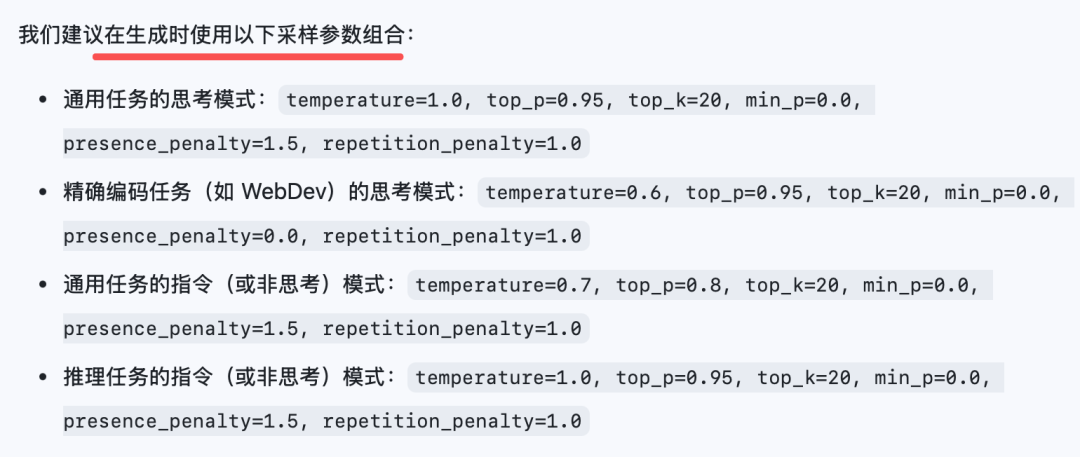

对于这类 开源 大模型,合理的推理参数设置对效果影响显著。官方提供了以下建议的采样参数组合,可供参考。

以上就是近期在 Agent 系统架构探讨与 大模型 开源方面的关键动态。对相关技术感兴趣的开发者,可以深入阅读原文或访问模型主页获取更多信息。欢迎在 云栈社区 继续交流讨论。 |