Meta 近期在其工程博客中分享了一项提升软件质量的新方法:即时(Just-in-Time, JiT)测试。这种方法的核心在于,在代码评审阶段动态生成测试,而非依赖那些需要长期人工维护的传统测试套件。相关研究数据显示,在如今AI辅助开发日益普及的环境下,该方法的缺陷检测能力相比之前提升了约4倍。

这一变革的直接驱动力,是“代理式工作流”的兴起。在这种模式下,AI系统承担了大量代码生成与修改的工作。代码变更的速度和规模激增,使得传统软件测试套件疲于奔命——脆弱的断言和滞后的覆盖率难以跟上快速迭代的步伐,维护成本飙升而效果却在下滑。

对此,ICT系统测试工程师 Ankit K. 观察道:“AI生成代码和测试的速度已经超过了人类的维护能力,JiT测试因此几乎成了必然选择。”

那么,JiT测试如何破局?它选择在拉取请求(Pull Request)环节介入,基于具体的代码差异(diff)来生成针对性测试。与仅做语法检查的静态验证不同,这套系统会尝试推断开发者的真实意图,识别潜在的失效模式,并构建出能在存在回归问题时精准失败的测试用例。它的目标是捕获“回归测试”——即那些在提议的新代码上会失败,但在父版本(修改前)代码上能通过的测试。

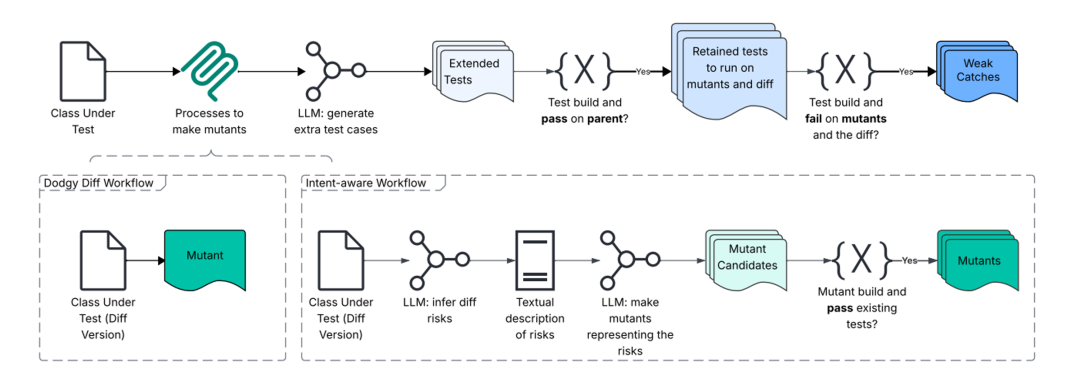

实现这一目标的技术流水线融合了大语言模型(LLM)、程序分析和变异测试。系统会主动向代码中注入合成缺陷(即“变异体”),以此来验证它生成的测试是否真能检测出问题。

Meta的研究科学家 Mark Harman 指出了这项工作的深层意义:“这项工作体现了一种根本性的转变:不再只是让现有测试更稳,而是转向去发现未来可能出现的问题。”

整个系统的关键,在于其“Dodgy Diff与意图感知工作流”架构。它将代码变更从文本差异,重新理解为包含语义的信号。具体来说,系统会分析diff,提取行为意图和潜在的风险区域,进行意图重建和变更风险建模,从而预测哪些部分可能出错。这些风险信号随后被送入变异引擎,生成一系列“可疑”的代码变体来模拟真实的故障场景。最后,一个基于LLM的测试合成层会生成与推断意图相匹配的测试,并经过过滤筛掉噪声或低价值的测试,最终将结果呈现在拉取请求中。

Dodgy diff 和意图感知工作流用于生成即时捕获(Just-in-Time Catches)的架构示意图

Meta表示,该系统已经在超过22,000个生成的测试上进行了评估。结果令人印象深刻:与基线生成测试相比,缺陷检测能力提升了4倍;在与偶然性结果对比时,在检测有意义失败方面甚至取得了最高达20倍的提升。在一个评估子集中,系统共标记了41个潜在问题,其中8个被确认为真实缺陷,包含数个可能影响生产环境的问题。

Mark Harman在另一篇分享中强调:“变异测试在学术圈沉寂了几十年之后,终于开始走向工业界,并正在重塑实用且可扩展的软件测试2.0。”

这种“捕获型”JiT测试是专为AI驱动的开发环境所设计的。它按每次变更生成,无需持续维护,核心目标是检测严重且非预期的缺陷。随着代码演进,测试自动适配,将工作负担从人类转移至机器,从而减少脆弱测试套件的堆积。只有当系统发现有意义的问题时,才需要人工介入审查。这实质上将测试的角色,从静态的正确性验证,重新定义为针对特定变更的、动态的故障检测。

原文链接:https://www.infoq.com/news/2026/04/meta-jit-testing-ai-detection/

对于前沿的软件工程方法与AI结合实践,云栈社区将持续保持关注,为开发者提供最新的技术动态与深度解读。 |