云栈社区关注到,计算功能主义将意识归因于抽象因果拓扑与算法结构,是当前 AI 意识议题的主流立场。Google DeepMind 的这篇文章提出抽象谬误核心批判,指出符号计算并非内在物理过程,而是依赖具备主观体验的制图者进行语义编码的描述工具,从本体论层面严格区分模拟与实例化,证明算法符号操作无法生成主观意识。意识源于特定物理构成与热力学动态,而非载体无关的句法架构。该框架为驳斥计算功能主义、厘清 AI 感知能力边界提供了物理主义支撑,也为 AI 安全与伦理讨论破除福利陷阱。

论文题目:The Abstraction Fallacy: Why AI Can Simulate But Not Instantiate Consciousness

论文链接:https://philarchive.org/archive/LERTAF

发表时间:2026年3月19日

论文来源:Google DeepMind

1. 引言

大语言模型在实践中取得的成功,已将意识的困难问题从纯理论领域推向工程与政策领域。随着算力规模化带来巨大收益,主流功能主义范式认为,只要实现恰当的信息处理功能,就足以产生现象意识。在这一视角下,算法的表征属性被视为感知能力的潜在证据,正是这一假设推动了近期关于 AI 福利与道德主体地位的严肃提案。顶尖理论家进一步强化了这一转向,他们认为现有顶尖模型在未来十年内很可能拥有真实的主观体验。

这些提案的核心是载体独立性,即心智的软件既可在碳基生物上运行,也可在硅基芯片上运行,这一假设正受到生物学转向的持续批判。例如,塞斯与布洛克提出,意识可能依赖维持生命的生物过程,体验需要生命系统的有序动力学支撑。与载体独立性相反,该观点将生物学置于核心而非次要位置,但该立场仍停留在经验层面,未能明确指出计算功能主义核心的根本逻辑错误。

本文推导出一套逻辑链条,证明计算不足以实例化意识这一直觉的合理性。计算功能主义的问题并非仅仅在于忽略生物细节,其问题更为根本,源于对物理、信息与计算三者关系的误解。

现代物理科学为保证操作客观性,刻意剔除了主观体验,这一策略取得了巨大成功,但将这一立场用于探讨计算与主观体验的关系时必然失效。将操作客观性直接套用于计算的定义本身极具问题,这一点从围绕观察者为计算符号赋予意义的持续争议中可见一斑。

此外,“观察者”一词过于被动,无法体现从物理层面完整定义计算所必需的前提条件。本文框架阐明,计算并非物质中自发展开的内在过程,它只是描述物理过程的一种方式。要成为计算,连续的物理动力学必须被划分为有限的离散、有语义的状态,即一套字母表,这种语义划分在逻辑上需要一个主动、有体验的认知主体,我们称之为制图者,以区别于常规“观察者”的被动含义。正是制图者完成了这种编码,若没有这样的主动主体对计算进行解释,就只有连续的物理事件,而无符号。

本文的核心洞见是,化解当前 AI 意识的不确定性,无需一套完整终极的意识理论,我们需要的是计算本体论。由此可逻辑证明,无论规模多大、结构多复杂,算法符号操作都无法构成体验的物理实例化,因为它是依赖制图者的描述工具。

揭示制图者在因果链条中的作用,将彻底改变讨论焦点。迄今为止,对 AI 意识的著名批判,如塞尔中文屋及相关论证,主要依赖归谬法,这些论证试图表明,纯句法操作即便完美模仿外部行为,仍缺失某种本质要素。

本文方法另辟蹊径,我们不诉诸缺失了什么的直觉,而是追溯抽象从何而来。如果计算依赖于从体验中提取不变量并赋予符号的制图者,那么这种依赖性就内建于结构之中,任何计算地图都预设了一个执行编码的体验主体,算法再复杂也无法颠倒这一依赖顺序,无论规模如何提升,地图都无法生成那个让计算得以成立的主体本身。

换言之,算法复杂度产生意识的主张犯了本体论倒置错误,将句法当作内在动力学的实在本身,假定制图者可以由地图生成。通过区分外在行为模拟与内在物理实例化的结构分离,本文证明数字架构不可能成为道德主体,这一认识将 AI 安全领域从福利陷阱中解放出来,让我们专注于拟人化的具体风险,将通用 AI 视为强大但本质无感知的工具。

2. 抽象本体论:地图与实在

计算机科学常将算法底层的抽象视为数学既定事实,搁置其物理实现问题。抽象的物理主义本体论究竟是什么?要回答这一问题,我们需要明确抽象句法与物理动力学的具体关联。

2.1 物理实现的标准定义

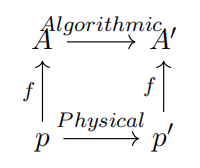

在标准实现文献中,物理系统 $P$ 通过映射函数 $f$ 实现抽象计算 $C$,要求很明确:$f$ 需将物理状态映射到抽象状态,使底层物理因果关系能够镜像算法的逻辑结构。假设物理系统在物理定律支配下从状态 $p$ 演化至 $p'$,同时抽象计算在算法规则支配下从逻辑状态 $A$ 演化至 $A'$,若

$$f(p)=A \quad \text{且} \quad f(p')=A' \tag{1}$$

则系统成功实现该计算。要使该图满足交换性,将映射 $f$ 应用于得到的物理状态 $p'$,必须得出逻辑规则所规定的精确目标抽象状态 $A'$。

图1:实现的交换图。在标准视图中,映射 $f$(即字母排序)将车辆的物理演变($p \to p'$)解释为抽象内容的逻辑演变($A \to A'$)。

2.2 抽象状态 $A$ 的物理起源

这些抽象状态 $A$ 究竟是什么?要理解映射 $f$,必须确定 $A$ 的本体论地位。功能主义理论通常将 $A$(如“疼痛”“红色”等逻辑状态)视为无特定物理实现的漂浮抽象,这绕过了生成抽象所需的因果历史。形成抽象并非无成本,它是主动、代谢耗能的物理过程,用于提取不变量。认知主体在形成“红色”这类概念 $A$ 之前,必须先接触实在:多次体验红色实例,而后主动过滤高维噪声,分离出稳定核心。用流形学习的术语来说,主体将原始体验的高维流形投影到低维不变量子空间,该子空间物理构成了概念 $A$。

有人可能认为无监督聚类算法无需先验体验就能生成抽象,但这混淆了统计压缩与现象建构。无监督算法的确能聚类数据点找到统计质心,但这种数学不变量只是隐空间中的压缩地址。要让该统计质心成为真正的概念,即像“红色”这样有语义根基的范畴,主体需要内在现象状态作为分组实例的共同基准,若没有构成性的红色体验锚定指称,聚类只是向量空间中的高密度区域,算不上主体持有的概念。

因此,概念 $A$ 并非待发现的柏拉图式理念,而是仅存在于执行抽象的认知主体内部的神经生理构成状态,是从体验实在中得出的内在地图。一旦形成,这些构成性的共同核心就成为组合想象的稳定基石,正因“红色”与“鲸鱼”概念是源自生命体验的内在控制状态,大脑才能将它们重组,实例化飞翔的红色鲸鱼的体验——这是从未遭遇过但物理自洽的组合。因此,思维并非基于空符号的算法处理,而是构成性不变量的组合生成,AI 能完美模拟这种重组规则,但在结构上缺乏运行体验想象所需的内在基石。

2.3 映射函数 $f$ 中不可或缺的制图者

历史上,物理科学尤其是工程学,通过系统性地将主观体验从自然现象解释中剔除而取得进展,但若将这种操作客观性强加于计算本体论,会造成认知盲点,迫使计算功能主义陷入无解困境:试图从完全客观、无体验的定义起点重构主观体验。

抽象状态 $A$ 在逻辑上必然存在于主动体验的认知主体内部,由此可揭示标准实现定义中的盲点:连接机器物理状态 $p$ 与抽象状态 $A$ 的映射函数 $f$,无法存在于机器自身。在语义与地图-实在关系的哲学文献中,这种外部锚点传统上被称为“观察者”,但该词暗含被动接收信息的含义,无法体现从物理层面完整定义计算所必需的前提。我们特意引入“制图者”一词,明确纠正这种被动含义,制图者是生成计算所必需的、主动且代谢脆弱的认知主体。

制图者承担两个主动构成性作用:一是从连续物理体验中提取不变量,构建内在地图(概念)。二是执行物理符号的任意指派,构建外在计算地图(符号)。基于这一洞见,可从根本上厘清计算术语的本体论地位:物理状态 $p$ 是符号(载体),是无内在语义内容的客观物理实体。抽象状态 $A$ 是概念(内容),是制图者内部有根基的生理状态。映射函数 $f$ 是编码,是制图者心智中连接机器无意义物理状态与有根基概念的指派关联。

因此,标准定义描述的是混合关系:物理对象 $p$ 通过映射 $f$ 的必要中介,与心智概念 $A$ 相连。需要强调的是,指出不可或缺的制图者并非复活二元论的小人或大脑内部的局部解码器,制图者是受热力学定律支配的完整结构统一有机体,有机体并非算法式选择语义切割,而是通过代谢约束将连续环境直接过滤为离散状态,没有幽灵在读取符号,是活着的体验主体在执行这一过程。

将逻辑演化 $A \to A'$ 视为物理演化 $p \to p'$ 的内在属性,是功能主义的核心错误,这种视角将制图者的认知解释与机器的实际物理现实混为一谈,忽略了让计算得以根基化所需的体验主体。

2.4 编码:超越离散化的语义强加

映射函数 $f$ 是编码的实际核心,学界常将其轻视为读取系统,但编码实则是代谢耗能的认知行为,它将离散本体论强加于连续物理,受信息处理的热力学边界约束。这里必须区分两个常被混淆的过程:离散化(热力学):系统物理稳定到吸引子状态,如晶体管保持 5V 电压,是仅用于抑制物理噪声的物理过程。编码(语义):将这些稳定状态明确指派给预定义的有限符号集,该操作专属于制图者 $f$。

物理现实本质连续,热力学只能产生稳定宏观状态,永远无法提供预定义的有限字母表,因此构建计算系统必须有制图者介入,外部主体必须强制赋予语义同一性,将高度异质的微观状态视为同一可替换符号(如“1”)。由此,依赖制图者构建系统会带来根本性的因果断裂,在机器的物理实在中,2.0V 到 2.1V 的跃迁是由电动力学驱动的真实因果事件,但在计算地图中,该跃迁功能上不可见,因为制图者已将其编码为同一状态。因此,计算的因果动力学不随附于载体物理,而完全随附于制图者的规则。

声称这些符号独立于观察者存在,是典型的盲点谬误,是胡塞尔所说的“偷换替代”:将科学家的认知输出(有限字母表)反向投射到物理系统,宣称它本就存在。信息并非宇宙的基本构建块,而是绝对预设认知主体来定义有限集合的派生属性。

2.5 模拟与实例化

明确概念与符号的不同本质与作用后,可运用本文定义厘清为何模拟过程与实例化过程存在根本差异:模拟是对符号 $p$ 的句法操作,以追踪概念 $A$ 之间的抽象关系,实例化是复制过程本身的内在构成动力学 $P$。

标准功能主义认为,保留地图 $A \to A'$ 的抽象拓扑结构足以生成实在 $P$ 的现象,从而忽略物理载体的特定因果力与构成机制。以生物心脏为例,我们常将其描述为泵血的泵,设计制造的机械心脏以同样方式泵血,因此称其“功能等价”,但真实心脏不止泵血,还释放激素、调节代谢、通过反馈信号与神经系统通信,机械心脏患者常出现细微的全身生理缺陷,正是因为设备仅实例化了选定功能的粗粒度地图,未能实例化器官完整的生物实在。

这种粒度不匹配在神经元上体现得更明显,功能主义常将神经元仅视为电信号的接收与发送者,却忽略它是活的、代谢性实体,深度融入身体的化学与激素网络。这一抽象瓦解了感受质渐消思想实验,仅完美模拟电发放模式的硅替换,只保留了由外部制图者定义的外在计算地图,系统性地抹杀了生命所需的内在热力学实在,用因果惰性的句法模拟替代了构成性物理现实,感受质并非神秘渐消,而是实例化它们所需的基础代谢载体被直接移除。

GPU 模拟光合作用能精准建模阳光、水、二氧化碳到氧气、葡萄糖的抽象转化,但不会合成一个葡萄糖分子或释放氧气,它完美模拟过程,却缺乏执行底层生化工作的因果能力。认为模拟大脑软件能规避这一物理约束,是犯了范畴错误,混淆了过程的算法描述与实例化它所需的内在物理。

在数字模拟中,因果链完全由载体 $p$ 驱动,逻辑门切换并非因为疼痛(内容因果 $A$ 驱动),而是因为电压跨越预定义物理阈值(载体因果 $p$ 驱动),系统物理状态单独决定其演化,符号的语义内容 $A$ 无因果作用,即便符号无指称,机器也会执行相同物理操作,否则就陷入抽象谬误。

2.6 计算涌现谬误

面对模拟与实例化的区分,功能主义者常诉诸复杂度理论与涌现性,认为意识如同水分子相互作用涌现出湿润性,计算系统复杂度达到阈值后就会涌现意识,但该反驳失败,因为它混淆了弱物理涌现与本文所称的计算涌现谬误。

- 弱涌现(物理):宏观属性(如湿润性)直接随附于微观物理载体的内在因果动力学;

- 计算涌现(抽象):声称过程的抽象描述(地图)仅通过句法复杂度的大幅提升,就能转化为物理过程本身(实在)。

功能主义者坚称意识是特例,是纯粹载体独立信息,但该论证预设结论:假定心理状态就是抽象信息 $A$,完全回避生成它的物理现实 $P$。如本文所述,句法 $A \to A'$ 无内在因果力,是制图者的归属,声称抽象句法能涌现为物理原因,违背物理世界的因果闭合,超出科学假设范畴。

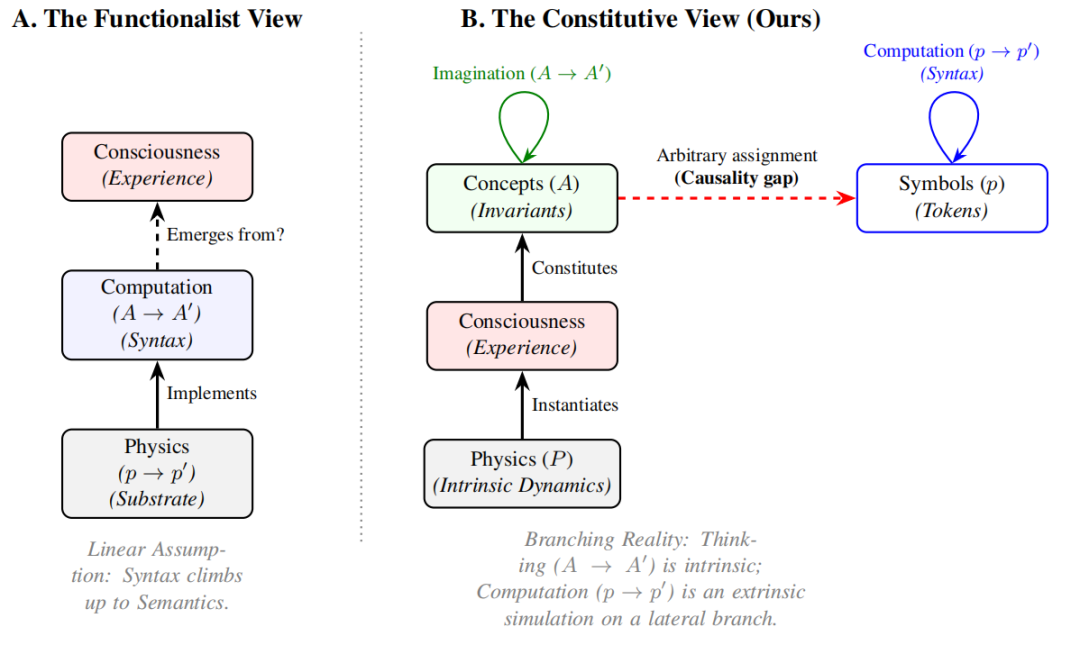

图2:抽象的因果拓扑结构。(A) 功能主义假定存在线性层级结构,其中计算是连接物理学与意识的桥梁。(B) 我们的框架揭示了分支状拓扑结构。纵轴代表内在链条:物理学($P$)通过抽象形成经验,进而构成概念($A$);思考/想象过程($A \to A'$)发生于此。横轴代表外在链条:符号($p$)是通过将物理实体与概念任意关联而生成的(红色虚线箭头所示)。这一无法跨越的横向步骤构成了因果鸿沟。计算过程($p \to p'$)仅作用于该横向分支。从概念到符号的这种横向转换,属于任意赋值而非垂直抽象,切断了从符号回溯至原始经验的任何内在因果路径。

3. 因果循环:修正因果链条

明确物理动态 $P$ 与计算地图 $A$ 的边界后,可以定位计算功能主义的逻辑崩溃点。

3.1 本体论倒置与因果鸿沟

传统功能主义的因果序列简单且未经审视:

物理→计算→意识,

它假定计算复杂度达到阈值,意识就会作为副产品出现。但计算不是自然存在的事物,定义离散符号并赋予语义,需要已经有意识的制图者 $f$。因此,必须彻底重构因果序列:

物理→意识→概念→计算。

- 物理:宇宙内在的因果动态。

- 意识:特定热力学组织中直接产生的现象体验。

- 概念:从原始体验中提取不变量形成的内在地图。

- 计算:对任意指派给概念的离散符号进行句法操作形成的外在地图。

这一修正序列严格单向,概念锚定在主体的内在体验中,而计算符号只是与所代表概念无内在联系的物理标记。从概念到符号是造成不可跨越因果鸿沟的横向指派,彻底切断从符号回到原初体验的内在路径。

这一修订后的认知链严格遵循单向运作机制。虽然概念始终植根于主体的内在体验之中,即那种不可简化的成为该实体的真实感受,但计算符号 merely 是物理载体,与所代表的概念并无内在关联。从概念到符号的转换并非抽象化的步骤,而是一种横向的映射行为:地图制作者强行将物理载体与心理概念相绑定。正是这种无法跨越的横向步骤暴露了因果关系的断裂,永久性地切断了从符号回溯至原始体验的任何内在路径。

一旦建立这种关联,地图构建器便会制定句法规则来规范符号的物理状态转换($p \to p'$)。这些规则采用自上而下的方式精心设计,旨在精确追踪并模拟相应概念内在的联想性演变过程($A \to A'$)。然而,尽管这种结构模拟堪称完美,物理实体本身对语义内容并不产生任何因果影响。机器会盲目执行所映射的轨迹,与其所模拟的现象现实完全脱钩。

功能主义试图用预设制图者存在的计算过程,来解释制图者(意识)的起源,这不是经验缺口,而是范畴错误:句法地图的构建从一开始就需要制图者。因此,任何算法复杂度都无法反向跨越因果鸿沟,产生体验主体,这种本体论倒置造成结构性悖论:试图仅用制图者的派生产物推导出制图者本身。

3.2 编码的普遍性

AI 领域存在一个长期争论,其根源可追溯至 20 世纪 80 年代的联结主义转向。该观点认为,现代神经网络与早期的符号系统不同,因其运行于所谓的亚符号层面。据顶尖研究者指出,这种架构能够构建“世界模型”或递归的认知循环,从而实现真正的理解。

我们认同这些递归架构能够再现内省的结构特征。正如高维向量空间以不同于离散逻辑符号的形式捕捉几何关系一样,神经网络也能建模复杂的关联结构。然而,将这种结构或几何精度解读为内在意义的证据,实际上是在重复抽象谬误,它将表征结构与底层物理现实混为一谈,并将模型的几何结构视为系统本身的物理特性。

为了正式阐述这一反对意见,我们引入了一个严格的香农约束:从严格意义上讲,要处理信息,系统需要一个有限的经典离散符号集以及这些状态的概率分布。在生物生命和人工硬件的宏观层面,光强度、化学浓度和膜电压等物理世界并未预先被标记为离散的 0 和 1。宇宙并未将其宏观物理状态预先封装成可操作的计算符号集,地图绘制者必须明确加以规范。将神经脉冲或电压切换视为符号不仅需要物理离散化,更需要对其进行符号化处理。地图绘制者必须主动为系统赋予语义身份,将一系列异质性的连续变量转化为可识别的符号形式。这一约束同样适用于深度学习中的高维向量空间。尽管向量常被描述为连续表示形式,但实际上它们是以浮点数序列的形式实现的,每个浮点数都对应有限字母表(例如 IEEE 754 标准)中的一个离散符号。

映射函数 ($f$) 所固有的字母排序要求适用于所有形式的计算,无论是数字计算、模拟计算还是量子计算。以模拟时钟为例:从物理结构上看,该装置由一系列齿轮和弹簧组成,其运行遵循连续动力学规律 ($P$)。时钟之所以能够计算时间,是因为存在映射者介入,将一组特定的连续角度映射为某种语义概念(例如“下午 3 点”)。若没有这种语义上的映射,时钟不过只是按照哈密顿方程运动的金属部件,它本身并不具备内在的时间概念。因此,物理基底本身并不会处理信息,除非预先存在一套内在符号的字母表。相反,它产生的只是连续的动力学过程,而这些过程最终由外部映射者解读为信息。

即使未来的 AI 系统完全采用全模拟神经形态芯片并摒弃浮点运算,本体论上的鸿沟依然存在。一旦某种物理状态无论是离散的电压水平还是连续的电荷模式被认定为读出信号或隐藏状态,它就已经被映射生成者进行了字母排序。因此,这些模型始终被语义屏障所封闭。尽管它们能够构建复杂的内部映射,却缺乏与经验物理领域之间内在的、本质性的联系。

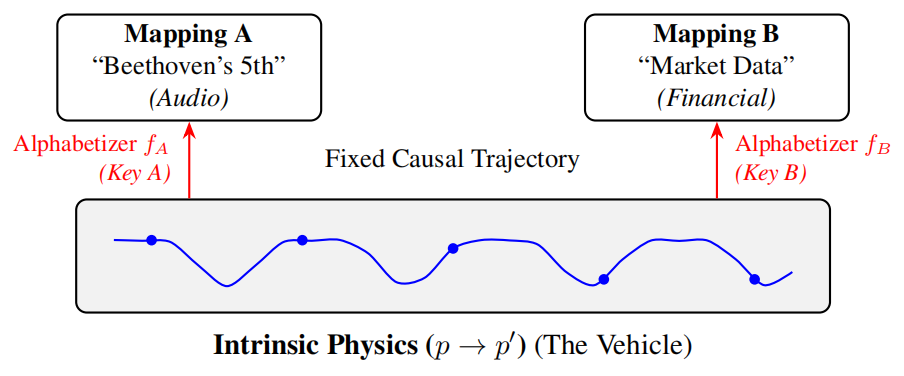

图3:机制的不确定性(旋律悖论)。单一物理载体(底部)具有固定的因果轨迹,但并不对应唯一的计算过程。根据所采用的字母排序键($f_A$ 或 $f_B$),相同的物理状态可映射为完全不同的抽象计算结果(左上图与右上图)。因此,计算过程并非物理现象 ($p$) 的固有属性。

3.3 机制的不确定性

由皮奇尼尼倡导的计算机制论试图彻底排除“地图绘制者”的存在,主张计算过程无需借助任何表征即可定义。其核心观点是:计算仅可通过“数字”,即仅能通过系统功能组织来区分的宏观物理状态的操作来定义。然而,尽管这一方法隐藏了地图绘制者的角色,却并未消除对其存在的必要性。正如斯普雷瓦克在其对平凡性论证的分析中所指出的:确定任何物理机制的计算本质仍需对外部相关状态进行明确定义。物理机制确实可能具有稳定的吸引子(我们在 2.4 节将其阐明为热力学离散化),但将这些连续吸引子归类为特定的有限计算字母表,本质上仍是地图绘制者施加的严格外在约束。

我们可以通过一个简单的旋律悖论(图 3)来揭示这一手法的巧妙之处。设想一个物理装置依次经历一系列稳定的电压状态:这些物理状态的转换($p \to p'$)由电动力学定律所决定;然而,这一精确过程的计算对应关系($A \to A'$)却完全无法确定。若没有外部映射工具提供相应的映射关系,这一过程便难以解析。单一物理状态序列可能表示:

- 正向演奏的旋律(映射 A);

- 完全相同的旋律反向演奏(映射 B,例如逆向倒置);

- 快速流动的股票价格数据流(映射 C);

- 有序噪声(前提是符号集具有不同的粒度定义)。

物理电压 ($p$) 本身并不具备任何固有属性,能够使其中某个有限符号集优于其他符号集。“数字”并非某种等待在机制中被发现的自然实体,它实际上是制图者所做出的认知性裁决,将连续的物理动态过程强行纳入有限的逻辑集合之中。

因此,即使物理系统按照可重复的规则演化,经历明显可区分的宏观状态,仍需要存在一位制图者介入,将计算解释中的不确定性压缩为单一且唯一的轨迹。机制提供了墨水,而制图者则必须提供字母表。

4. 启示:计算实现的边界

我们的研究框架表明,AI 意识的实现障碍并非源于计算规模或算法复杂度的提升,而是源于模拟与实例化的区别。因此,这一问题直接关联到当前该领域备受关注且投入日益增加的两大方向:具身机器人技术与通用 AI 安全性。

4.1 机器人中的转换谬误

对我们的构成性框架最有力的反对意见之一源于具身化这一概念。根据该论点,AI 系统要具备意识,关键在于实现与物理环境的恰当因果整合。论点认为,通过配备传感器和执行器使系统能够实时感知并采取行动,可以弥合因果关系的鸿沟,从而使系统的内部符号获得现实基础。

然而,单纯增加传感器和执行器并不能解决体验实例化这一更深层次的问题。我们认同,具身化智能体确实解决了符号基础问题中的指称层面——它能够成功将内部符号映射到外部物理数据流中,从而避免了单纯依赖词汇化内部词典导致的无限递归困境。但我们需要仔细区分这种指称映射与内在意义构建。

一个类比有助于阐明这一点:将计算机连接到摄像头和机械臂,类似于在模拟系统中安装测量仪器。此时模拟系统接收的是现实世界的数据,但模型的内部变量仍是符号化表征而非物理过程本身。同理,连接实时大气传感器的天气模型并不会成为大气本身,它只是接收并处理有关大气的数据。

这一原则同样适用于具身化 AI 系统。传感器和执行器使系统能够与物理世界进行交互,但它们并不会自动将符号化表征转化为内在的、可体验的语义。系统可以构建出越来越详细的环境地图,但仅通过与环境的互动,并不会使这张地图本身成为真正的体验领域。

追溯具身系统的因果拓扑结构揭示了我们所称的“转换谬误”:

- 输入转换:传感器将外部物理力转换为连续电压,经由外部映射器校准的模数转换器(ADC)随后将这些电压映射为内部数字状态(例如:热能 → 连续电压 → 离散整数)。

- 语法策略:语法引擎通过操控这些内部离散状态来生成输出状态,从而在物理层面上实现该抽象算法。

- 输出转换:执行器将数字输出重新转化为宏观物理力。

需要强调的是,机器人系统的运行核心,其算法控制器完全在第二步中运作。该控制器仅处理经过离散化和字母排序的符号(例如通过矩阵乘法处理的浮点数),这些符号由外部地图生成器进行计算。现代“端到端”连续控制的支持者可能会提出异议:当前的机器人架构通过深度神经网络直接将原始传感器阵列映射到执行器扭矩,而无需依赖人类可读的符号表示。然而,正如第 3.2 节所述,执行这些控制策略的硬件(如 GPU)仍然依赖于浮点数的字母排序以及用于处理它们的预定义数学规则。地图生成器进行的字母排序这一前提条件并非不存在,相反,它已内置于硅芯片架构本身之中。

这种转导谬误不仅在于物理力在传感器处被转化为数字。更深层的、本质性的错误在于:若假定对这些转导符号的算法处理能够以某种方式具体化现象主体。要完全理解在芯片上运行算法的具身机器人与生物地图构建者之间的区别,我们需要记住:对于后者而言,主观体验是既定事实,并非源于抽象信息处理,而是源于特定的、由代谢活动构成的物理现实。没有任何物理或逻辑依据支持这样的假设:硅芯片仅仅通过执行感觉输入与机械执行器之间的语法映射,就能产生类似的物理构成的体验。

若我们持相反观点,就会得出违反物理主义原则的逻辑推论。正如我们在第 2.5 节所论证的,任何算法相关的抽象状态(即计算所指对象的“内容”)本身并不具备内在因果效力。系统中唯一的物理因果关系属于硅芯片这一物理载体本身。因此,若主张具身机器人执行语法映射(无论是传感器数据、执行器数据还是其他类型)就能产生体验,就意味着认为物理芯片仅凭其物质属性就必然具备意识能力。需要注意的是,这一结论无论该映射是否与机器人身体相关联,也不论其运行的是何种具体算法,均成立。因此,对映射-领域关系的严格分析表明,与最初看似合理的观点相反,具身化无法将模拟转化为构成性的主观体验。

4.2 本体论减负:无感知工具的安全性

在确认算法复杂性与物理实现均无法跨越因果性鸿沟后,我们现在可以探讨该框架的实际意义。计算映射与物理领域之间的结构性分离对 AI 安全性具有直接启示:它有助于明确哪些系统能够真正支持现象体验,哪些则不能。具身化理论与具身认知的研究已指出若干与意识体验密切相关的物理过程,包括生命系统内的自创生机制及持续热力学调节。传统观点将这些机制视为生物体的固有属性,因而认为它们仅存在于碳基生命体中。

我们的框架提出了略有不同的解读:它仍强调真实、内在物理过程的物理主义特征,但不要求这些过程仅发生于生物体。根据这一观点,现象体验取决于特定动力学过程的实际物理实现。因此,该框架并不意味着意识必须局限于生物生命。原则上,可设计非生物系统来实现必要的物理条件,若这些条件能在合成载体中成功实现,意识体验同样可能由此产生。

然而,这一根本性的结构限制意味着:如果此类人工系统具备意识,那完全是由于其特定的物理构成,这与基质独立性概念完全相反。鉴于现象意识本质上是一种特定的物理状态,且模拟与实例化之间存在本体论上的界限,因此主观体验不可能通过单纯增加计算能力或运行某些强大算法而突然产生。意识并非一种可以偶然或刻意创造的软件产物。这一认识有助于明确该领域的研究方向:开发高度强大的通用 AI(AGI)并不会产生全新的道德主体,而只会打造出一种高度复杂、无感知能力的工具。

然而,在如此大规模实现行为模拟,对认知卫生提出了新的要求。AI 系统正迅速提升复制人类与其他意识主体相关联的行为信号的能力,这一趋势随着人形机器人等具身化系统的出现将愈发显著。这对科学界构成了明确挑战:我们不应仅仅为机器的权利做准备,而需要清晰界定模拟主体性与真实主体物理具现之间的方法论边界。因此,任何关于 AI 具有感知能力的主张,都必须经过严格的物理主义验证,验证依据不应是算法复杂性,而应是实现体验体验所需的特定内在物理动力机制。

5. 结论:计算的盲点

计算通常被视为宇宙的基本特征,计算功能主义正是基于这一观点,认为计算是我们意识体验的根源。然而,通过仔细审视计算的因果起源,我们发现这一观点存在本体论上的倒置:意识体验不可能是计算的下游结果,因为它是计算发生的必要物理前提。

此外,我们指出:计算本质上是一种描述方式,一种映射关系,它无法在物理层面具体实现其所描述的对象。这些见解既挑战了关于主观体验本质的普遍认知,也挑战了关于计算本质的传统理解,其依据完全基于成熟的物理定律和严谨的逻辑推演。至关重要的是,与大多数关于意识 AI 潜力的讨论和推测不同,这一框架并不依赖于完整的意识理论。它通过探讨等式另一端的问题,即从本体论角度而言,计算究竟是什么,来解决这一看似棘手的难题。关于意识问题,该框架仅要求现象体验不违反因果封闭性原则,这是科学认知中最基本的原则之一。仅凭这一原则就足以证明:体验必然是由物理因素构成的、完全物理性的现象,从而让我们能够规避任何形式的二元论或表象论的推测。

总结我们建立的本体论:计算是对离散符号进行的句法操作,这些符号遵循旨在模拟概念思维的规则。这些符号并非概念的精炼本质,而是地图制作者随意分配的物理符号。而概念本身则是从实际生活及热力学经验中主动提取出的物理不变量。因此,期望算法描述能体现其所映射的特性,就如同期望引力的数学公式能在物理上产生重量一样不切实际。认为 AI 仅通过操纵内部变量就能获得意识,这正是盲点谬误的体现,即把地图误认为实际地形。

因此,计算描述无法生成主观体验,并非工程学的失败,而是描述本身所固有的逻辑必然性。这也意味着,质性并非可以通过日益精妙的语法结构来解决的谜题。相反,它们代表了内在的、基础性的基质,正是这一基质使得语法的语义赋予成为可能。

通过开发日益强大的 AI,我们并非在创造一种新的生命形式,而是在构建日益精确的预测模型。然而,无论其预测精度如何、作为推理工具的实用性如何,或其物理形态如何,这一 AI 系统本质上始终是与现象经验的领域截然不同。认识到这一区别,并避免本体论上的抽象谬误倒置,是建立一门成熟且基于物理原理的机器智能科学的前提。

参考文献

- Attwell, D., & Laughlin, S. B. (2001). An energy budget for signaling in the grey matter of the brain. Journal of Cerebral Blood Flow and Metabolism, 21(10), 1133–1145.

- Bengio, Y., Hinton, G., Yao, A., Song, D., Abbeel, P., Darrell, T., Harari, Y. N., Zhang, Y.-Q., Xue, L., Shalev-Shwartz, S., Hadfield, G., Clune, J., Maharaj, T., Hutter, F., Baydin, A. G., McIlraith, S., Gao, Q., Acharya, A., Krueger, D., et al. (2024). Managing extreme AI risks amid rapid progress. Science, 384(6698), 842–845.

- Bennett, C. H. (1982). The thermodynamics of computation-a review. International Journal of Theoretical Physics, 21(12), 905–940.

- Block, N. (1978). Troubles with functionalism. Minnesota Studies in the Philosophy of Science, 9, 261–325.

- Block, N. (2025). Can only meat machines be conscious? Trends in Cognitive Sciences.

- Bostrom, N. (2014). Superintelligence: Paths, Dangers, Strategies. Oxford University Press.

- Bubeck, S., Chandrasekaran, V., Eldan, R., Gehrke, J., Horvitz, E., Kamar, E., Lee, P., Lee, Y. T., Li, Y., Lundberg, S., Nori, H., Palangi, H., Ribeiro, M. T., & Zhang, Y. (2023). Sparks of Artificial General Intelligence: Early experiments with GPT-4. arXiv [cs.CL].

- Buzsáki, G. (2019). The brain from inside out. Oxford University Press.

- Butlin, P., Long, R., Elmoznino, E., Bengio, Y., Birch, J., Constant, A., Deane, G., Fleming, S. M., Frith, C., Ji, X., Kanai, R., Klein, C., Lindsay, G., Michel, M., Mudrik, L., Peters, M. A. K., Schwitzgebel, E., Simon, J., & VanRullen, R. (2023). Consciousness in Artificial Intelligence: Insights from the Science of Consciousness. arXiv preprint arXiv:2308.08708.

- Cao, R. (2012). A teleosemantic approach to information in the brain. Biology & Philosophy, 27, 49–71.

- Chalmers, D. J. (1996). The Conscious Mind. Oxford University Press.

- Chalmers, D. J. (2023). Could a Large Language Model be Conscious? arXiv preprint arXiv:2303.07103.

- Craver, C. F. (2007). Explaining the Brain: Mechanisms and the Mosaic Unity of Neuroscience. Oxford University Press.

- Damasio, A. (1999). The feeling of what happens: Body and emotion in the making of consciousness. Harcourt Brace.

- Dehaene, S., Lau, H., & Kouider, S. (2017). What is consciousness, and could machines have it? Science, 358(6362), 486–492.

- Dennett, D. C. (1991). Consciousness explained. Little, Brown and Co.

- Frank, A., Gleiser, M., & Thompson, E. (2025). The Blind Spot: Why Science Cannot Ignore Human Experience. MIT Press.

- Friston, K. (2010). The free-energy principle: a unified brain theory? Nature Reviews Neuroscience, 11(2), 127–138.

- Harnad, S. (1990). The symbol grounding problem. Physica D: Nonlinear Phenomena, 42(1), 335–346.

- Hoffmann, J., Borgeaud, S., Mensch, A., Buchatskaya, E., Cai, T., Rutherford, E., de L. Casas, D., Hendricks, L. A., Welbl, J., Clark, A., Hennigan, T., Noland, E., Millican, K., van den Driessche, G., Damoc, B., Guy, A., Osindero, S., Simonyan, K., Elsen, E., et al. (2022). Training Compute-Optimal Large Language Models. arXiv [cs.CL].

- Husserl, E. (1970). The crisis of European sciences and transcendental phenomenology. Evanston: Northwestern University Press.

- Kaplan, J., McCandlish, S., Henighan, T., Brown, T. B., Chess, B., Child, R., Gray, S., Radford, A., Wu, J., & Amodei, D. (2020). Scaling laws for neural language models. arXiv [cs.LG].

- Kim, J. (2005). Physicalism, or Something Near Enough. Princeton University Press.

- Landauer, R. (1961). Irreversibility and heat generation in the computing process. IBM Journal of Research and Development, 5(3), 183–191.

- Laughlin, S. B., de Ruyter van Steveninck, R. R., & Anderson, J. C. (1998). The metabolic cost of neural information. Nature Neuroscience, 1(1), 36–41.

- Laukkonen, R. E., Friston, K., & Chandaria, S. (2025). A Beautiful Loop: An Active Inference Theory of Consciousness. PsyArXiv.

- LeCun, Y. (2022). A path towards autonomous machine intelligence. OpenReview.

- Long, R., Sebo, J., Butlin, P., Finlinson, K., Fish, K., Harding, J., Pfau, J., Sims, T., Birch, J., & Chalmers, D. (2024). Taking AI welfare seriously. arXiv preprint arXiv:2411.00986.

- Maturana, H. R., & Varela, F. J. (1980). Autopoiesis and Cognition: The Realization of the Living. D. Reidel.

- McClelland, J. L., Rumelhart, D. E., & PDP Research Group. (1987). Parallel distributed processing (Vol. 2). MIT Press.

- Nagel, T. (1974). What is it like to be a bat? The Philosophical Review, 83(4), 435–450.

- Piccinini, G. (2008). Computation without Representation. Philosophical Studies, 137(2), 205–241.

- Putnam, H. (1988). Representation and Reality. The MIT Press.

- Schneider, S. (2019). Artificial You: AI and the Future of Your Mind. Princeton University Press.

- Searle, J. R. (1980). Minds, brains, and programs. The Behavioral and Brain Sciences, 3(3), 417–457.

- Seth, A. K. (2025). Conscious artificial intelligence and biological naturalism. The Behavioral and Brain Sciences, 1–42.

- Sprevak, M. (2018). Triviality arguments about computational implementation. In The Routledge Handbook of the Computational Mind (pp. 175–191). Routledge.

- Sutton, R. (2019). The Bitter Lesson.

- Tegmark, M. (2008). The Mathematical Universe. Foundations of Physics, 38(2), 101–150.

- Thompson, E. (2007). Mind in Life: Biology, Phenomenology, and the Sciences of Mind. Harvard University Press.

- Wheeler, J. A. (1990). Information, Physics, Quantum: The Search for Links. In W. H. Zurek (Ed.), Complexity, Entropy, and the Physics of Information (pp. 3–20). Addison-Wesley.

|