4月28日,Google Translate满20岁。Pichai亲自在X上发帖纪念:

谷歌翻译已从二十年前的一个小型实验,发展成为一款全球工具,每月10亿人在用它,超过三分之一的实时翻译会话持续超过5分钟。这个数字意味着,两个母语完全不同的人,如今能够在AI的帮助下完成一次真正意义上的「自然对话」。

Pichai的帖子回顾了Translate的20年技术路线:2006年,Translate靠统计机器学习,在小型词组里找规律;2016年,Google切换到神经网络,翻译第一次跳出「逐字对译」;今天,Gemini模型接管,Translate从文本工具升级成实时对话工具,这让翻译变得更加智能和实用。

如今,借助Gemini模型,戴上耳机,你就可以拥有一个能保留原始语调和节奏的私人翻译。在Pichai看来,这是一种神奇的体验,但他也指出了一个有趣现象:每当技术取得进展,我们就开始把它当作理所当然——“如果你遇到一个能用100种语言翻译、速度还比任何人都快的人,你会觉得不可思议。今天,有一个产品能在近250种语言之间做到这一点,而我们却几乎只是耸耸肩。”

网友Chetan Kumar回应道:「完全同意。当我们不了解创造这些卓越解决方案背后的技术、努力和艰辛时,就很容易把一切视为理所当然。」

另一位网友Xbotter说,Google Translate曾经是自己最爱的翻译应用,但大模型流行之后,自己几乎不再使用它了,很高兴看到它能随着技术的进步有所改进。

从Pichai的帖子和网友回复中可以感觉到:Google Translate的20年,可能是被低估的20年——它被ChatGPT、被各种大模型抢走了风头,被遗忘在很多人手机角落。但它并没停止进化,最近的一次,它又把每一代Google最强的AI模型悄悄塞进自己的翻译引擎里,让翻译第一次开始有了「语调」「节奏」和「呼吸感」。

Google官方发文纪念Translate 20周年。

从「数词频」开始

2006年4月,Google Translate上线。那个时候的翻译,本质是统计学。技术术语叫SMT,Statistical Machine Translation,统计机器翻译。

2006年4月,Google官方研究博客正式宣布统计机器翻译系统上线

当时,Google向计算机输入数十亿字的文本,应用统计学习技术来构建翻译模型。也就是说:模型不懂语言,只会算概率。这种翻译什么风格?生硬、逐词、机械,经常前言不搭后语。比如,中文菜单上的「鸡腿」会被翻成「chicken thigh」,「老婆饼」会被翻成「wife cake」。但这在2006年,它已经是当时最好的方案。当时Google笃定一件事:翻译质量,本质上是数据规模问题。谁手里的双语语料多,谁的统计模型就准,而Google正好坐拥全网最大的多语言文本库。这是Translate,也是后来大部分AI翻译系统的共同起点。

神经网络砍掉一大半错误率

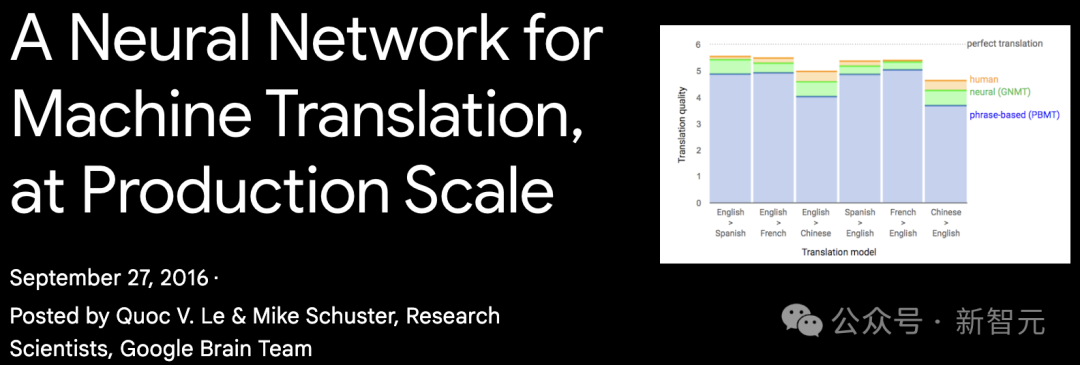

2016年9月27日,Google Research宣布神经机器翻译系统(GNMT)上线,即Google Neural Machine Translation。

参考:https://research.google/blog/a-neural-network-for-machine-translation-at-production-scale/

这是一次彻底的换血。老系统的逻辑是:把一句话拆成短语,各自翻译,再拼回去;而GNMT的逻辑是:把一整句话当成一个单位,送进神经网络,让网络自己学会把它「映射」成另一种语言。

按双语人工评估,GNMT在多个主要语种对上将翻译错误率降低了55%–85%。普通用户的体感是,从「翻出来勉强能猜个大概」一夜之间变成「翻出来基本能直接用」。Google当时给了一组对照数据:在中英、英法等几个主要语种对上,GNMT把翻译错误率压低了55%到85%。中英翻译,Translate在2016年直接100%使用GNMT,每天处理大约1800万次翻译请求。

GNMT背后是两件事:一是Sequence-to-Sequence模型架构;二是当时刚刚部署的TPU张量处理器。前者让神经网络第一次能处理变长输入和变长输出,后者把昂贵的计算压到了产品级响应速度。这两样都不是为翻译单独发明的,但Translate是它们第一个真正的产品级试验场。后来回头看,GNMT是整个深度学习浪潮里,最早被推到10亿用户面前的产品之一。

GNMT还顺便带来一个意外能力:零样本翻译——没有直接训练过的语言对(比如日语→韩语),它也能翻出可读的结果。那是大模型时代到来之前,NLP在工业界最重要的一次落地,比ChatGPT早了6年。

大模型时代:一次新增110种语言

2022年到2024年,大模型登场,这次跳跃不是靠新架构,而是靠零样本学习能力。2022年,Google用Zero-Shot Machine Translation给Translate加了24种新语言。所谓Zero-Shot,就是模型从没见过这种语言的双语对照,但能凭别的语言知识硬翻。这在SMT时代是不可想象的。

到了2024年6月,Google直接用PaLM 2大语言模型,一次性给Translate加了110种语言,覆盖额外6.14亿人口。这是Translate史上最大规模的一次语言扩展。PaLM 2在这件事上扮演的角色是「语言之间的迁移引擎」,使模型能够高效学习相互接近的语言族。比如学会了印地语,Awadhi和Marwadi就能跟着上;学会了法语克里奥尔,塞舌尔克里奥尔和毛里求斯克里奥尔就能跟着上。这次扩张靠的是PaLM 2,不是Gemini。Gemini真正更深度地整合Translate,要等到2025年12月之后。

Gemini原生语音模型:翻译开始有了「呼吸感」

2025年12月12日,Translate的最新一次换血落地。Google官方博客直接挑明:把Gemini的最强翻译能力引入Translate。

参考:https://blog.google/products-and-platforms/products/search/gemini-capabilities-translation-upgrades/

具体落地两件事。第一件,文本翻译升级。Gemini接管后,Translate终于能搞定俚语、习语和地方表达。举个例子:英文俚语“stealing my thunder”,字面是「偷我的雷」,实际意思是「抢我风头」。老Translate会硬翻成字面意思。Gemini接管的Translate,直接给出「抢走了我的所有关注」这种符合语境的翻译。这件事的本质是:Gemini不是在翻字,是在解析上下文。

第二件,也是更重要的一件:耳机实时翻译Beta上线。这是Translate第一次把翻译能力从「文本」推到「实时语音」层。技术底座是一个新模型:Gemini 2.5 Flash Native Audio,这是谷歌的音频原生模型。这里的关键词是原生音频。老的语音翻译走的是三段链条:语音输入→转文本→翻译文本→合成语音,每一段都有损耗——语调没了,情绪没了,只剩一个机器人朗读出来的翻译稿。Gemini 2.5 Flash Native Audio走的是另一条路:Google将其描述为原生speech-to-speech翻译,而不是传统的「语音识别—文本翻译—语音合成」三段式体验。在这种模式下,模型保留说话人的语调(intonation)、节奏(pacing)和音高(pitch),让翻译开始有了「呼吸感」。

20年,换了4代AI

把这几次跳跃放在一起看,会发现一个很有意思的规律:每一代Google最关键的AI路线,最后几乎都会在Translate里找到产品化落点。

- 2006年SMT时代,Translate是Google统计学习的早期落地场。

- 2016年深度学习时代,Translate是Sequence-to-Sequence和TPU走向全球产品的标志性场景。

- 2024年大模型时代,Translate用PaLM 2完成史上最大规模语言扩展。

- 2025年多模态时代,Gemini 2.5 Flash Native Audio把Translate推向原生语音实时翻译。

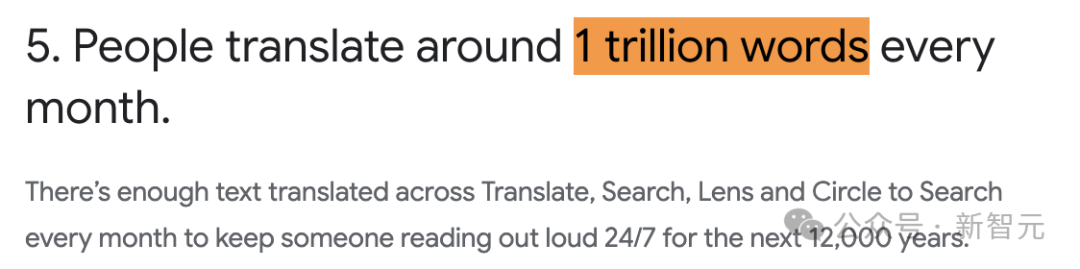

20年,4代AI接力,这才是Translate真正的护城河——背后是一条从来没断过的算法接力链。而一旦能力进入Translate,就有机会沿着Google的全球产品入口,被推向10亿级用户。Google公布过一组数据:每月通过Translate、Search、Lens、Circle to Search这4个入口,合计翻译的文字量大约在1万亿词。

OpenAI、DeepL都在语音交互和专业翻译上给Google带来压力,但短期内,它们很难复制Google这种10亿月活和多入口嵌入式分发。相比Apple方案需要特定AirPods与较新iPhone,Google的耳机实时翻译在支持地区可使用任意耳机。这也是非常典型的Google打法:把能力软件化、平台化,然后跳过硬件的护城河。

Google称,这个月最常被翻译的短语是“Thank you”;过去20年里,很多月份也都是它。Translate贯穿了Google多代AI技术路线:统计机器翻译、神经机器翻译、大语言模型扩语种、原生音频实时翻译。但人最常说的那句话,几乎从来没变过——这件事可能比任何技术参数更值得注意。

参考资料:

https://x.com/sundarpichai/status/2049156908582617440

https://blog.google/products-and-platforms/products/translate/fun-facts-google-translate-20-years/2026