过去两年,整个行业不约而同地在三个方向上完成了收敛——AI渗透到每一个环节、以开发者体验为核心的运行时、能直接交付生产代码的低代码/可视化工具。你的日常工具链,是不是也该升级一下了?

2026年第一季度刚结束,我整理了一下手头正在使用的工具链,发现不知不觉间已经换掉了接近一半。

去年我还在纠结选哪个状态管理库,现在 TanStack 全家桶已经接管了大部分数据逻辑;去年还在吐槽 Node.js 启动慢,今年 Bun 已经成了我开发时的首选;去年还要反复手写各种增删改查,现在 AI Agent 已经能自动完成整个调试闭环。

这不是在盲目追新。过去24个月里,行业确实在三个方向上形成了清晰共识:

- AI everywhere——无论是本地还是云端的LLM,都已经深度嵌入了开发流程。从代码补全助手到 CI 自动化,AI 角色从“锦上添花”变成了“基础配置”。

- DX-first 运行时——新一代运行时和打包工具把开发者体验和启动性能提到了最高优先级。Bun、Vite 这类工具正在重新定义什么叫“快”。

- 可交付的低代码——可视化工具早已不是只能出原型的玩具了,现在它们生成的前端代码和组件,是可以直接上生产环境的。

这三个趋势交汇到一起,意味着你每天的工作将越来越依赖工具之间的组合能力:一个快如闪电的运行时、一套可靠的组件库、能自动同步的文档体系、一个能帮你处理重复劳动的 AI 助手,同时你还得把生产安全和可观测性牢牢握在手里。

下面这15款工具,是我在 2026 年实际项目中反复用过的,每一款都切切实实在某个环节帮我把开发效率往上提了一档。

⚠️ 注意:工具从来不存在什么银弹,选型一定得结合你自身的业务场景和团队状况。下文中我会逐一标出每个工具的适用边界和可能踩到的坑。

1. TanStack 全家桶:React 应用的数据“水管工”

TanStack 是一套高质量的无头(headless)库集合,覆盖了数据获取、表格、路由、表单等高频场景,TypeScript 支持堪称一流。

生活化类比:这就像装修时埋在墙里的水电管线——你看不到它们,但少了它们整个房子根本运转不起来。TanStack 做的就是这套“管线系统”:把数据从后端稳定地输送到前端组件。

正式定义:TanStack 是一个不预设任何样式的无头 UI 库集合,只负责数据逻辑和状态管理。它旗下涵盖 Query(服务端状态管理)、Table(高性能表格)、Router(类型安全路由)、Form(表单状态管理)等多个模块。

核心价值:它提供了一套经过生产环境充分验证的数据工作流(缓存策略、乐观更新、大数据量表格),TypeScript 体验极其出色。在那些需要可预测的服务端状态行为的大型代码库中,拿它来做“数据管线”层是非常可靠的选择。

// 环境:React 18+ / TypeScript 5+

// 复杂度:O(1) 缓存查询,O(n) 表格渲染

// 用 TanStack Query 管理服务端数据

import { useQuery } from '@tanstack/react-query'

function UserList() {

// 自动处理缓存、重试、后台刷新

const { data, isLoading } = useQuery({

queryKey: ['users'],

queryFn: fetchUsers,

// 5分钟内认为数据是“新鲜”的,不会重复请求

staleTime: 5 * 60 * 1000,

})

if (isLoading) return <div>加载中...</div>

return <div>{/* 渲染用户列表 */}</div>

}

什么时候用:大型 SPA、大量服务端状态、复杂数据表格场景。什么时候不用:简单的静态网站,几个 fetch 就够用的情况。

✅ 生产提示:用 TanStack Query 管理服务端状态,用 TanStack Table 处理虚拟滚动和大数据量表,两者共享同一数据模型,配合起来特别默契。

2. Bun:一把“瑞士军刀”搞定全栈 JS 开发

Bun 是一个用 Zig 语言编写的 JavaScript 运行时,把打包器、包管理器和测试运行器都集成到了一起。

生活化类比:别人做一顿饭得分别准备切菜板、菜刀、锅、灶台,Bun 则把所有这些功能都做进了一个“厨房工作站”里,拿起来就能直接用。

正式定义:Bun 是基于 JavaScriptCore 构建的 JavaScript 运行时,目标是成为 Node.js 的直接替代方案,同时提供更快的性能和更好的开发体验。它不需要搭配任何第三方工具,就能完成从项目初始化、依赖安装、代码运行,到打包构建、测试部署的全流程。

// 环境:Bun 1.3+(2026年最新版本)

// 启动速度比Node.js快约4倍

// 内置SQL客户端——无需安装mysql2/pg

import { SQL } from "bun"

// 连接PostgreSQL

const db = new SQL("postgres://localhost/mydb")

// 自动参数化查询,防止SQL注入

const user = await db`

SELECT name, role FROM users

WHERE username = ${username}

`

// 运行:bun run index.ts

// 启动开发服务器(零配置热重载)

// bun --hot index.ts

2026年1月发布的 Bun 1.3 是迄今为止最大的一次版本更新。它引入了零配置的前端开发模式、内置 React Fast Refresh、统一的数据库 API(Bun.SQL 支持 MySQL/PostgreSQL/SQLite),以及比 ioredis 快7.9倍以上的内置 Redis 客户端。此外,Bun 1.3 还新增了 Bun.cron API,支持跨平台的系统级定时任务调度。

⚠️ 注意:生产环境仍需谨慎。Bun 在开发阶段已经相当成熟,但生产环境偶尔还会碰到一些边缘 bug。建议你先在本地开发和 CI 流程中充分试用,验证原生模块兼容性之后再考虑向生产环境迁移。

3. Antigravity IDE:Google 的 Agent 驱动开发平台

Antigravity 是 Google 推出的 Agent 优先 IDE,基于 VS Code 构建,内置 Gemini 3 模型和任务编排能力。

生活化类比:这就像你有一个能自己制定计划、执行任务、验证结果的项目助理。你只需要说一句“帮我把用户登录模块搞定”,它就能自己规划任务、写代码、跑测试、修 bug,最后告诉你完成了。

正式定义:Antigravity 是一个“Agent 优先”的集成开发环境,允许多个 AI Agent 直接访问编辑器、终端和浏览器,完成规划、编写、测试和验证代码的全过程。内置的 Mission Control 面板让你能同时管理多个自主运行的 Agent,它们可以并行处理任务、浏览网页查找 技术文档 、甚至在终端中执行命令。

核心特性:

- 双界面设计:Editor View 用于同步协作(AI 辅助编码),Manager Surface 用于异步任务编排(Agent 后台工作)。

- Gemini 3 驱动:这是专门为代码执行和编程任务优化过的模型,工具调用能力大幅提升。同时也支持 Claude Sonnet 4.5 和 GPT-OSS 等替代模型。

- Artifacts 可视化输出:Agent 返回的结果不再是干巴巴的日志文本,而是任务清单、实施计划、浏览器操作录屏这类直观的内容。

什么时候用:实验性项目、原型开发、对 Agent 驱动工作流接受度较高的团队。什么时候不用:不允许自主执行破坏性操作的关键生产系统,这种场景必须保留严格的人工审批节点。

✅ 安全提示:把 Agent IDE 当成一个强大的自动化工具来管理——锁定权限、使用沙盒仓库、涉及破坏性的操作必须人工确认。

4. LM Studio & Ollama:本地运行大模型的两把“钥匙”

这两款工具能让你在自己的电脑上运行开源 LLM,不用把敏感数据发到云端 API。

生活化类比:就像自己在家做饭和点外卖的区别。自己做饭(本地运行)更私密、更可控,但你得自己准备食材和厨具;点外卖(云端 API)确实省事,但你吃什么的偏好数据会经过别人手里。

正式定义:

- Ollama:命令行优先的本地 LLM 运行工具,提供开发者友好的 CLI 和 API,特别适合脚本化、自动化场景。

- LM Studio:桌面图形化应用,内置模型浏览、下载和聊天功能,适合探索和实验。

# 环境:Ollama 0.5+ / LM Studio 0.3+

# 硬件要求:16GB+ RAM,M系列Mac或NVIDIA GPU更佳

# Ollama命令行方式

ollama pull qwen2.5-coder:7b

ollama run qwen2.5-coder:7b

# 启动API服务(默认端口11434)

ollama serve

# Python调用示例

import requests

response = requests.post('http://localhost:11434/api/generate',

json={'model': 'qwen2.5-coder:7b', 'prompt': '写一个快速排序'})

截至2026年3月,Ollama 在 GitHub 上已获得 166k 星标,成为 GitHub 上规模最大的开源 AI 项目。两者对比来看:Ollama 适合习惯使用终端的开发者,追求可复现的配置和 API 优先的工作流;LM Studio 更适合偏好图形界面的用户,内置模型发现和一键服务功能。

什么时候用:有监管合规要求的场景(金融、医疗)、需要低延迟私有推理的情况。什么时候不用:需要大规模弹性扩展、不想自己管基础设施,那云端 API 显然是更省心的选择。

✅ 生产提示:用 LM Studio 或 Ollama 做概念验证和特定模型服务,务必配置好速率限制和监控。

5. Claude Code:长出“双手”的终端 AI 编程助手

Anthropic 推出的 Claude Code 是一个 Agent 型编码助手,可以在终端或 IDE 中运行,能直接编辑文件、执行命令、协调代码库变更。

生活化类比:以前让 AI 写代码,它只能输出文本,你得自己手动复制粘贴、运行、调试。现在 Claude Code 能自己打开文件、敲命令、点按钮、修 bug,就像一个坐在你旁边的结对编程伙伴,而且这个伙伴是长着“手”的。

正式定义:Claude Code 是一个 Agent 型编码助手,可以自主完成从写代码、编译、启动应用到自动点选测试的完整流程。如果程序崩溃了,它能自己翻找 Bug、修复它并完成验证。2026年3月,Claude Code 正式上线了“计算机使用”能力,可以跨应用交互、在 UI 界面上点击滑动,真正实现了端到端的闭环。

核心能力:

- 多文件重构和测试生成

- 跨应用交互(打开各类 App,操作 UI 界面)

- 自主调试闭环:写代码 → 编译 → 启动 → UI 自动化点击 → 发现 Bug → 修复 → 再次验证

什么时候用:独立开发者或小团队,希望用 Agent 减少重复性工作。什么时候不用:没有防护措施的大型 Monorepo,必须保留代码审查这道关卡。

⚠️ 注意:Token 消耗极其惊人。Claude Code 虽然强大,但消耗量确实吓人。有开发者通过逆向工程发现,系统底层存在缓存失效的 bug,会导致 Token 成本瞬间飙升10到20倍。建议在 CLAUDE.md 中添加项目的约束说明,让 AI 记住架构边界和可安全编辑的区域。

6. Spline:让 3D 设计像搭积木一样简单

Spline 是一个基于浏览器的 3D 设计工具,支持创建交互式 3D 场景,并能直接嵌入网站。

生活化类比:以前做 3D 就像用专业 CAD 软件画工程图,门槛极高。Spline 把 3D 设计变成了像用 PPT 画图一样直观——拖拽、点击、调整,甚至直接用文字描述就能生成 3D 模型。

正式定义:Spline 是一款浏览器端的实时 3D 设计工具,专注于 Web 端 3D 交互设计和动效制作。它内置了 Spline AI 功能,支持通过自然语言生成 3D 场景、3D 对象和材质纹理。生成的 3D 内容可以直接导出为 React 组件或嵌入代码,和前端工程无缝集成。

2026年3月,Spline 发布了 Omma——一个新的 AI 画布,把 3D、动效、动画和 UI 统一到了一个自然语言工作流里,几分钟内就能生成可以上线的交互体验。

// 环境:React 18+ / Next.js 14+

// 导出Spline场景为React组件

import Spline from '@splinetool/react-spline'

export default function Hero3D() {

return (

<div className="hero-container">

{/* 直接使用Spline导出的3D场景组件 */}

<Spline scene="https://prod.spline.design/xxx/scene.splinecode" />

</div>

)

}

什么时候用:营销网站、产品展示、交互式 Hero 区域。什么时候不用:内容密集型页面,3D 只会增加不必要的加载负担。

✅ 生产提示:导出轻量级 glTF 文件,懒加载 3D 场景;使用 Spline 的 Web 嵌入方式保持响应式布局。

7. n8n:自己掌控数据的自动化“瑞士军刀”

n8n 是一个开源的工作流自动化平台,支持自托管,拥有超过1000个原生集成节点。

生活化类比:这就像你有一个可以自由编程的“机器人总管”,它能连接你所有的办公软件(企业微信、飞书、数据库、API),按你设定好的规则自动执行任务。而且这个“总管”可以部署在你自己的服务器上,数据从不出门。

正式定义:n8n 是基于节点的自动化工作流平台,拥有 1000+ 预置节点,尤其擅长处理 API 集成和数据清洗。它采用“Fair-code”协议允许自托管,逻辑控制能力(循环、分支、错误处理)极强,非常适合处理确定性任务。

{

"nodes": [

{

"name": "Feishu Trigger",

"type": "n8n-nodes-base.webhookTrigger",

"parameters": { "path": "feishu-submit" }

},

{

"name": "AI Analysis",

"type": "n8n-nodes-base.httpRequest",

"parameters": {

"url": "http://localhost:11434/api/generate",

"body": { "model": "qwen", "prompt": "={{$json.content}}" }

}

},

{

"name": "Database Insert",

"type": "n8n-nodes-base.postgres",

"parameters": { "operation": "insert", "table": "submissions" }

}

]

}

国内生态补充:虽然 n8n 总部在德国,但在中国企业级市场同样拥有广泛受众。国内也有对标产品如 Juggle,它更贴合国内办公生态——深度适配企业微信、飞书、钉钉,对接淘宝、拼多多、抖音电商等平台接口,并提供专属客服和私有部署选项。

什么时候用:内部自动化、ETL 流水线、需要留在 VPC 内的 AI 增强场景。什么时候不用:简单的第三方自动化,SaaS 版的 Zapier 已经够用了。

✅ 生产提示:使用 n8n 的自托管 AI 入门套件快速启动本地模型集成,保持对 Token 和数据的完全控制。

8. Lovable & Replit:AI 驱动的快速应用构建器

Lovable 是 AI 优先的无代码构建器,能生成完整的 React/Tailwind 应用;Replit 是云端 IDE,集成了 AI 开发工具。

生活化类比:就像你拥有了一个“产品经理 + 前端工程师”的 AI 组合——你说“我想要一个任务管理应用”,几分钟后它就把可运行的代码和界面都给你准备好了。

正式定义:Lovable 是一个 AI-first 的无代码构建器,可以生成完整的 React/Tailwind 应用。Replit 是一个云端 IDE,集成了 AI 开发工具,特别适合教育和快速原型场景。

什么时候用:快速原型、产品演示、黑客马拉松、教学场景。什么时候不用:需要复杂自定义基础设施的大规模生产应用。

✅ 生产提示:尽早把生成的代码导出并纳入你正常的 CI/CD 流程,把生成代码当成第三方依赖一样对待——它需要被审查和测试。

9. Builder.io:设计师和开发者的“翻译官”

Builder.io 是一个可视化开发平台,能生成可直接上生产的 UI,集成设计系统,通过无头 API 连接你的应用。

生活化类比:这就像设计师和开发者之间的“同声传译”——设计师在 Figma 里画完稿子,Builder.io 直接把它转成 React 组件代码。设计师还能在界面上直接调整样式,改完就是生产就绪的代码。

正式定义:Builder.io 是一个可视化开发平台,通过视觉编辑生成生产级 UI,集成设计系统,通过无头 API 连接你的应用。它的 Visual Copilot 功能可以直接将 Figma 画板转换为组件。

什么时候用:营销页面、产品展示页、非技术人员需要创建生产页面的场景。什么时候不用:需要定制化性能调优的内部工具。

✅ 生产提示:用 Builder 的 Visual Copilot 将 Figma 画板转换为组件,但上线前务必审查并优化生成的代码。

10. NotebookLM & Gamma:文档研究和 PPT 生成的 AI 加速器

NotebookLM 是 Google 的 AI 笔记和研究助手,能基于你的文档做知识合成;Gamma 是 AI 演示文稿/写作工具,能快速生成结构清晰的幻灯片。

生活化类比:NotebookLM 就像一个 24 小时在线的研究助理,你丢给它一堆文档,它帮你读完、总结、提炼要点;Gamma 则像一个专业的 PPT 设计师,你说“我要一个关于 Q1 业绩的报告”,它直接把内容和排版都给你准备好。

正式定义:NotebookLM 是 Google 的 AI 笔记和研究助手,能基于你上传的文档进行知识合成,并支持 PPT 生成、视频生成等新功能。Gamma 是 AI 演示文稿工具,能快速将内容转化为结构清晰、视觉出色的幻灯片。

什么时候用:团队需要频繁产出简报、提案,或需要快速知识合成的场景。什么时候不用:需要严格法务或合规审批的正式文档。

✅ 生产提示:用 NotebookLM 生成初稿和提取演讲要点,再用 Gamma 转化为精美布局,形成一条高效的内容生产流水线。

11. Mintlify & Google Code Wiki:让文档不再“过期”

Mintlify 是 AI 优先的文档平台(文档即代码 + AI 助手集成);Google 的 Code Wiki 则提供内部代码知识工具和 CLI 扩展。

生活化类比:就像给你的代码库装了一个“自动更新的说明书”——每次代码变更,文档会自动同步更新,还能用 AI 搜索精准找到你想要的信息。

正式定义:Mintlify 是一个 AI 优先的文档平台,支持文档即代码和 AI 助手集成。Google Code Wiki 提供内部代码知识工具和 CLI 扩展,让文档对 LLM 更友好、更容易被检索。

什么时候用:中大型工程团队,知识流失已经成为真实成本的场景。什么时候不用:小团队,一个 README 加一个开发者就够用的情况。

✅ 生产提示:集成文档 CI 检查,在 PR 工作流中启用 AI 助手来关联代码和文档链接。

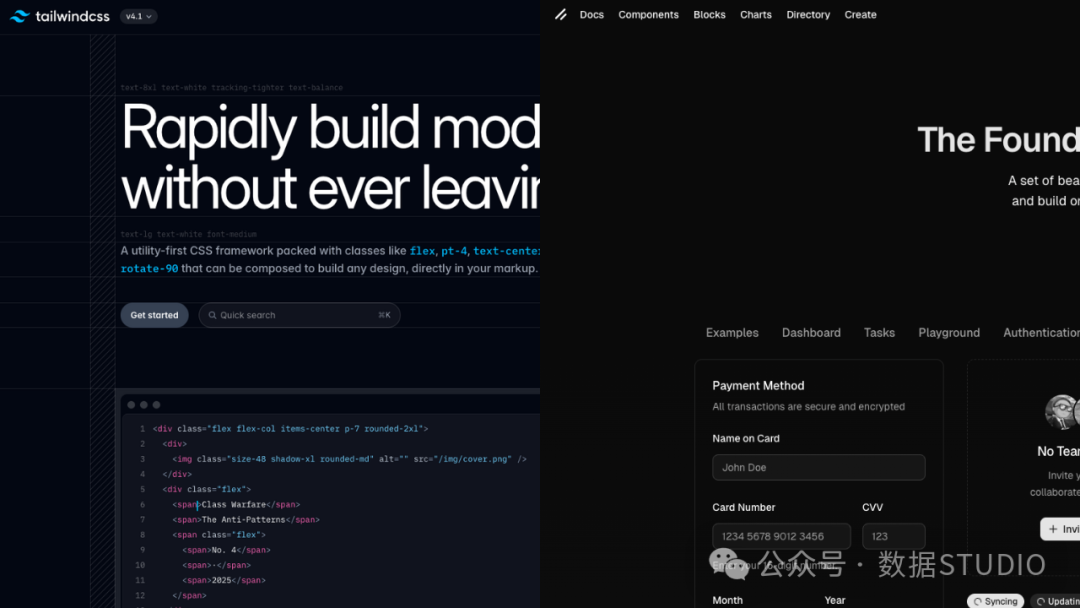

12. Tailwind CSS & shadcn/ui:前端开发的“乐高积木”

Tailwind 是原子化 CSS 框架,shadcn/ui 是基于 Tailwind 和 Radix 的开源组件集合,专为生产主题化设计。

生活化类比:Tailwind 就像有一套标准化的乐高颗粒,每个颗粒只做一件事(比如 p-4 表示内边距)。shadcn/ui 则是用这些颗粒搭好的“成品模型”,拿过来就能用,还能随意改颜色和样式。

正式定义:Tailwind 是原子化 CSS 框架,让团队标准化 UI 令牌并快速迭代。shadcn/ui 是一个基于 Tailwind 和 Radix 构建的开源组件集合,提供生产就绪的主题化组件。

// 环境:React 18+ / Next.js 14+ / Tailwind CSS 3.4+

// shadcn/ui组件使用示例

import { Button } from "@/components/ui/button"

import { Card, CardContent, CardHeader, CardTitle } from "@/components/ui/card"

export default function Dashboard() {

return (

<Card className="w-[350px]">

<CardHeader>

<CardTitle>欢迎回来</CardTitle>

</CardHeader>

<CardContent>

<p className="text-sm text-muted-foreground mb-4">

你今天有3个任务待处理

</p>

<Button className="w-full">查看详情</Button>

</CardContent>

</Card>

)

}

什么时候用:任何需要统一设计令牌、快速迭代的现代 React/Next/Vite 项目。什么时候不用:绑定在旧版 CSS 框架上、重写成本不可行的项目。

✅ 生产提示:将 Tailwind 与严格的设计令牌文件和 shadcn 组件结合,给设计师和工程师提供一个统一的 UI 事实源。

13. Relume & Stitch:组件库 + AI 生成 UI 的“加速器”

Relume 是一个大型 Webflow 组件库和 AI 建站工具;Stitch 能从提示词或线框图生成 UI 代码。

生活化类比:就像拥有了一个“素材库 + AI 设计师”——你需要什么页面布局,从素材库拖出来,AI 帮你调整成符合你品牌风格的版本。

正式定义:Relume 提供大量 Webflow 组件库和 AI 建站功能;Stitch 等工具能从提示词或线框图生成更接近生产代码的 UI。

什么时候用:设计机构、Webflow 工作室、需要快速交付数十个营销网站的场景。什么时候不用:有复杂交互逻辑的高度定制化 Web 应用。

✅ 生产提示:将 Relume 组件作为 Webflow 交付的规范构建块,生成 UI 后务必做一轮性能优化。

14. Wix Studio:面向机构的网站开发平台

Wix Studio 是 Wix 面向机构的进阶版产品,提供高级设计控制、多站点管理和 AI 功能。

生活化类比:这就像给你一个“网站工厂”的管理后台——你可以同时管理多个客户的网站,统一部署、统一分析,还能让客户自己在可控范围内修改内容。

正式定义:Wix Studio 是 Wix 面向机构的进阶版平台,提供高级设计控制、多站点管理、AI 功能和生产级特性(分析、SSO、协作)。

什么时候用:需要规模化交付营销网站的机构,偏好一体化托管平台。什么时候不用:需要对自定义后端基础设施完全控制的团队。

✅ 生产提示:用 Wix Studio 快速启动客户网站,通过 Staging 站点迭代,用 Git 备份自定义代码以保留版本控制。

15. Google AI Studio:Gemini 模型的原型到生产“一站式”平台

Google AI Studio(Vertex AI Studio)是一个用于 Gemini 模型和多模态工作流的 Web IDE。

生活化类比:就像 Google 给你搭好了一个“AI 应用实验室”——从写提示词、测试效果、调优参数到部署上线,全在一个界面里完成。

正式定义:Google AI Studio / Vertex AI Studio 是一个 Web IDE,用于使用 Gemini 模型和多模态工作流进行原型设计和构建。它提供了端到端的游乐场和部署路径,是许多生产级 ML-to-App 工作流的中心枢纽。

什么时候用:需要集成 Gemini、构建多模态工作流、需要从提示词到部署的完整生产路径。什么时候不用:基础设施必须保持完全供应商中立或本地部署的情况。

✅ 生产提示:在 Google AI Studio 中做原型,然后将关键推理迁移到 Vertex AI 进行规模化部署和监控。

工具如何组合:两个实战工作流

工作流1:从快速原型到生产上线

- UI 起步:用 Builder.io 做营销/落地页(可视化编辑)

- 设计系统:用 Tailwind + shadcn/ui 作为前端设计系统

- 本地开发:用 Bun 获得快速构建和测试体验

- 数据管理:用 TanStack Query 管理服务端状态,TanStack Table 处理大表格

- 自动化:自托管 n8n 连接 CI → 分析 → AI 增强

- 文档:用 Mintlify 保持文档可搜索,用 NotebookLM 做知识合成和新人入职培训

工作流2:AI 辅助开发流程

- 编码助手:用 Claude Code 或 Antigravity IDE 处理多文件重构和测试,但务必保留人机交互确认和严格权限

- 本地模型:敏感数据场景,用 LM Studio 或 Ollama 本地运行模型

- AI 应用开发:用 Google AI Studio 做 Gemini 模型原型

⚠️ 注意:AI 辅助开发的边界。AI Agent 能力越强,潜在风险就越大。Antigravity 的 Agent 可以自主跨编辑器、终端、浏览器执行任务,Claude Code 已经能“长出双手”操作 UI 界面。务必设置严格权限、使用沙盒仓库、破坏性操作必须人工确认。

写在最后

回顾这15款工具,你会发现一条清晰的脉络:2026年的工具生态,核心问题已经不再是“用哪个框架更好”,而是“如何组合一套工具链让整个开发流程更顺畅”。

我的建议是:选一个快速的运行时(Bun),配一套扎实的库(TanStack),加一个 AI 开发 助手(Claude Code 或 Antigravity),再用可视化工具处理那些重复性高、变更频繁的场景(Builder.io、Spline)。剩下的,交给文档和自动化去兜底。

工具越多,选择反而越难。真正的收益不在于把每款工具都用上,而在于精选一小撮有明确设计主张的工具,把它们深度集成到一个有纪律的 CI/CD + 文档 + 监控体系中去。

三个记忆点:

- 运行时选型:Bun 在开发和 CI 场景已经成熟,生产环境谨慎推进

- AI 助手是工具不是同事:权限管理和人机交互关卡是底线

- 文档和自动化是杠杆:花20%的时间做自动化,能省下80%的重复劳动

你在实际项目中用过哪些 AI 编程助手?Bun 和 Node.js 在你手头的项目中差距大吗?欢迎分享你的实战体验。

参考来源:

- Bun 1.3 发布说明及性能数据

- TanStack 官方文档及社区评测

- Google Antigravity 技术白皮书及开发者文档

- Ollama 与 LM Studio 对比评测报告(2026.03)

- Claude Code 2026年3月更新说明

- 阿里云、百度AI开发者社区工具评测报告

- n8n 社区文档及国内替代方案分析