当汽车以100公里/小时的速度行驶时,0.1秒的误差意味着2.5米的差距。

这2.5米,可能就是生与死的距离。这个触目惊心的数字,正是边缘计算在自动驾驶等领域变得不可或缺的核心原因。它不仅仅是技术的演进,更是对实时性、安全性的极致追求。

什么是边缘计算?

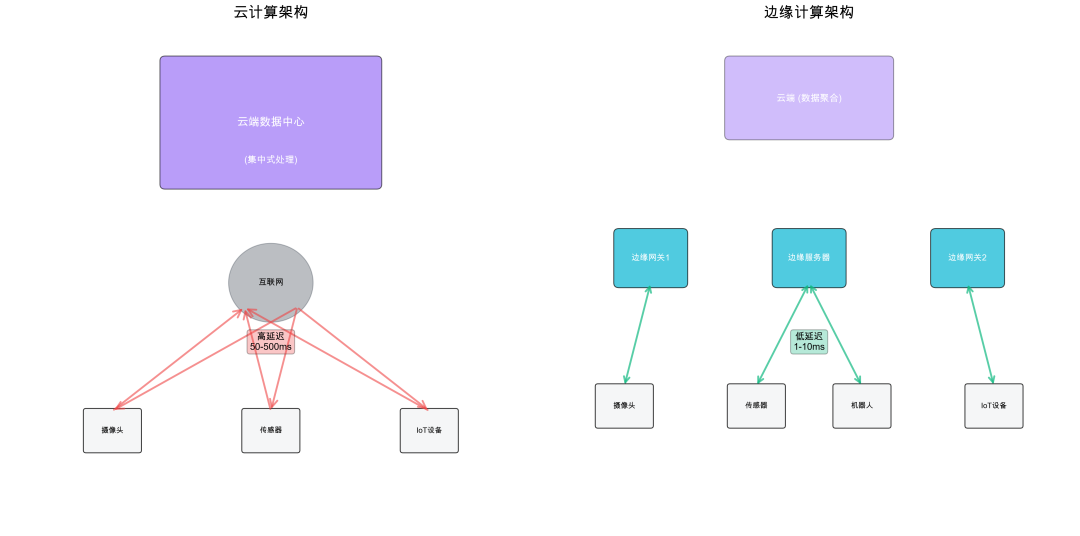

简单来说,边缘计算就是将计算任务从遥远的“云端”数据中心,迁移到离数据产生源头更近的地方——“边缘”。这种架构的根本转变带来了效率的质变。

- 传统的云计算模式:摄像头拍摄视频 → 通过网络传输到云端数据中心 → 云端服务器进行分析处理 → 将结果传回设备。

- 边缘计算模式:摄像头本地集成或就近连接计算单元 → 视频数据在本地或边缘服务器直接分析 → 立即得到处理结果并执行。

两者的核心区别可以浓缩为一个字:快。这种“快”不仅仅是速度,更是降低延迟、保障业务连续性的关键。

数据说话:边缘计算究竟快多少?

理论再好,不如数据直观。我们通过两个典型场景来量化边缘计算的价值。

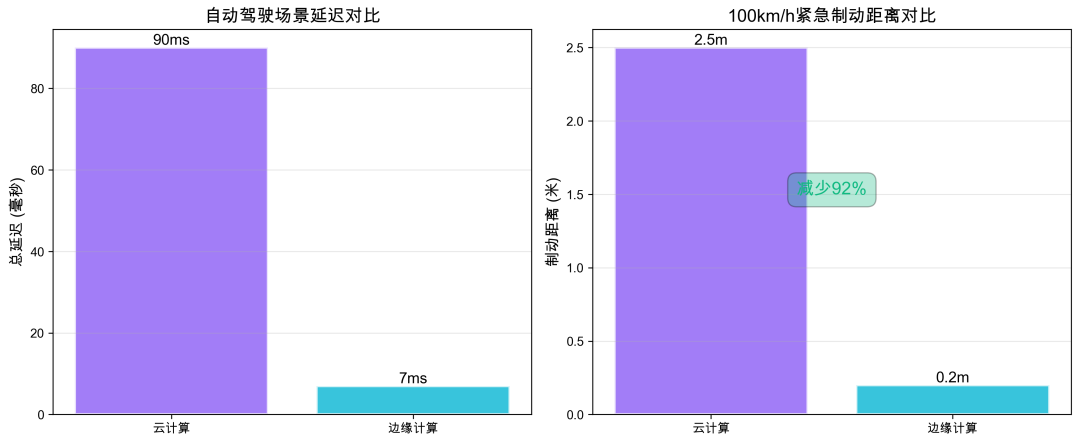

场景一:自动驾驶紧急制动

想象一下高速行驶中的自动驾驶汽车突然遇到障碍物,计算延迟直接决定了制动距离。

| 计算方式 |

系统总延迟 |

100km/h下的制动距离 |

| ☁️ 云端计算 |

90ms |

2.5米 |

| ⚡ 边缘计算 |

7ms |

0.2米 |

采用边缘计算,制动距离减少了惊人的92%。这关键的2.3米,在紧急情况下就是安全缓冲区。这也是为什么L4及以上级别的自动驾驶系统必须依赖边缘计算的原因。

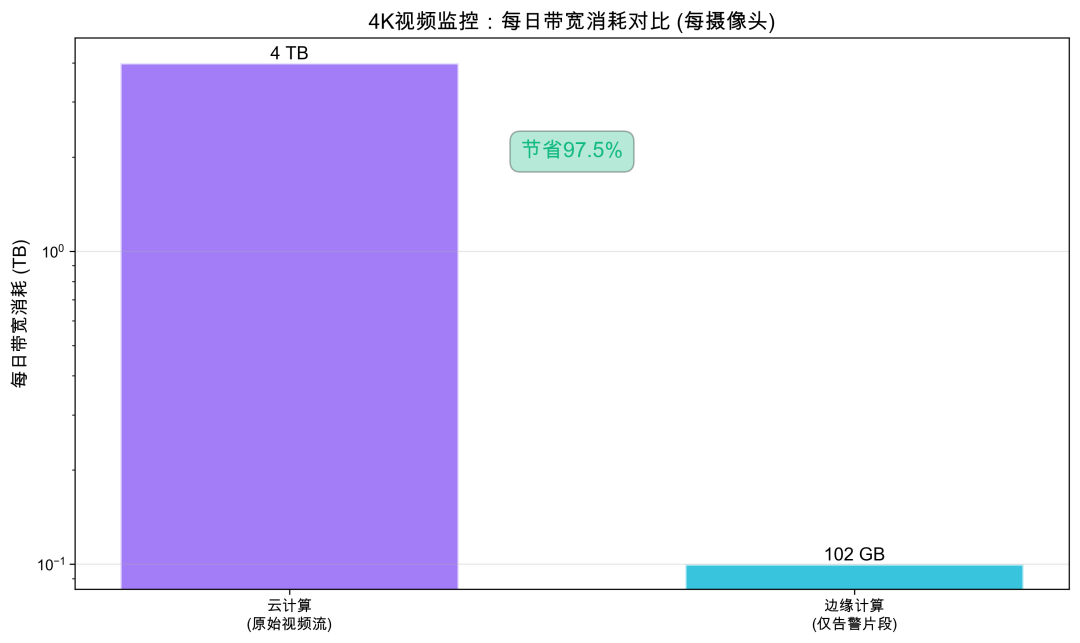

场景二:4K超高清视频监控

对于城市安防或工厂质检,海量视频流对网络带宽是巨大的挑战。

| 计算方式 |

单摄像头每日带宽消耗 (估算) |

| ☁️ 云端计算 (上传原始视频流) |

4 TB |

| ⚡ 边缘计算 (仅上传告警片段或元数据) |

约 100 MB |

通过边缘计算在摄像头端实时分析,仅当识别到异常事件(如入侵、火焰)时才上传关键片段或告警信息,带宽消耗可节省97.5%以上。对于一个部署了上百个摄像头的项目,一年节省的专线费用可能高达数十万元。

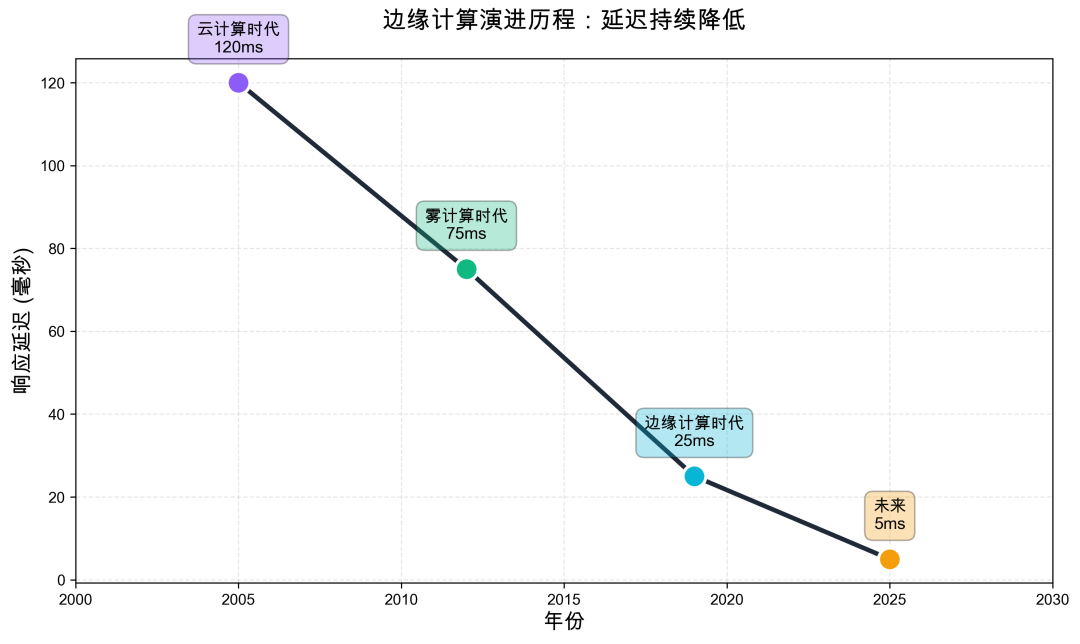

边缘计算的演进:延迟的持续降低

计算范式从集中式的云计算,走向分布式的边缘计算,其演进历程正是响应延迟不断降低的过程。从早期的百毫秒级,到雾计算的数十毫秒,再到如今边缘计算的毫秒级响应,未来甚至有望达到亚毫秒级,以满足工业机器人和车联网等极端实时性需求。

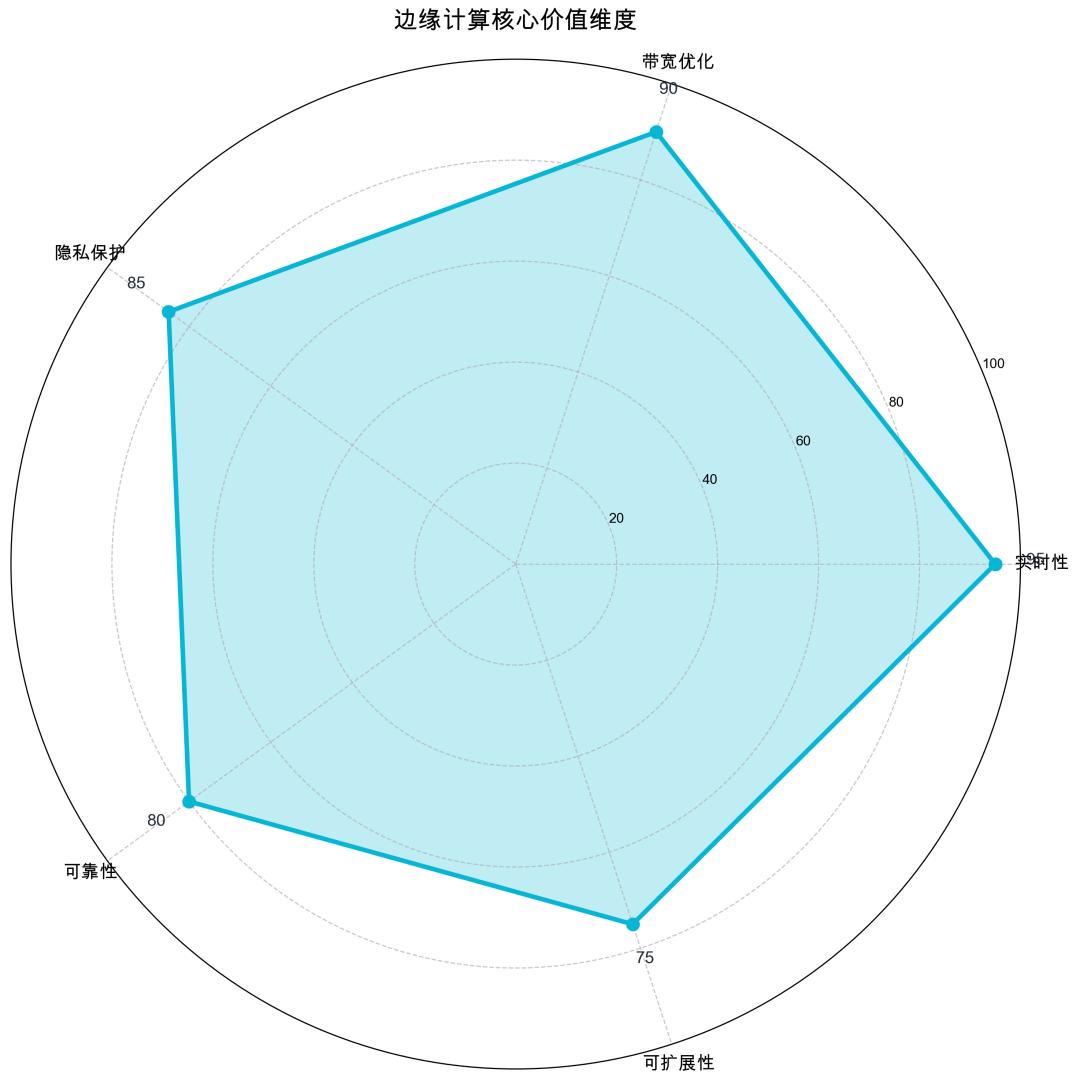

边缘计算的核心价值维度

除了显而易见的低延迟和带宽节省,边缘计算还在多个维度上体现出巨大价值。

- ✅ 毫秒级实时响应:数据本地处理,无需经历云端往返的网络延迟,满足控制类业务的严苛时效要求。

- ✅ 大幅优化带宽成本:仅上传价值密度更高的处理结果或元数据,而非原始数据流。

- ✅ 增强隐私与数据安全:敏感数据(如人脸、工艺参数)可在本地完成处理,无需出域,降低了泄露风险。

- ✅ 提升业务可靠性:在网络中断或云服务不可用时,边缘设备可独立运行,保证核心业务不中断。

- ✅ 实现弹性扩展:算力需求增长时,可以通过增加边缘节点来横向扩展,避免单一中心瓶颈。

实战指南:如何选择边缘计算硬件?

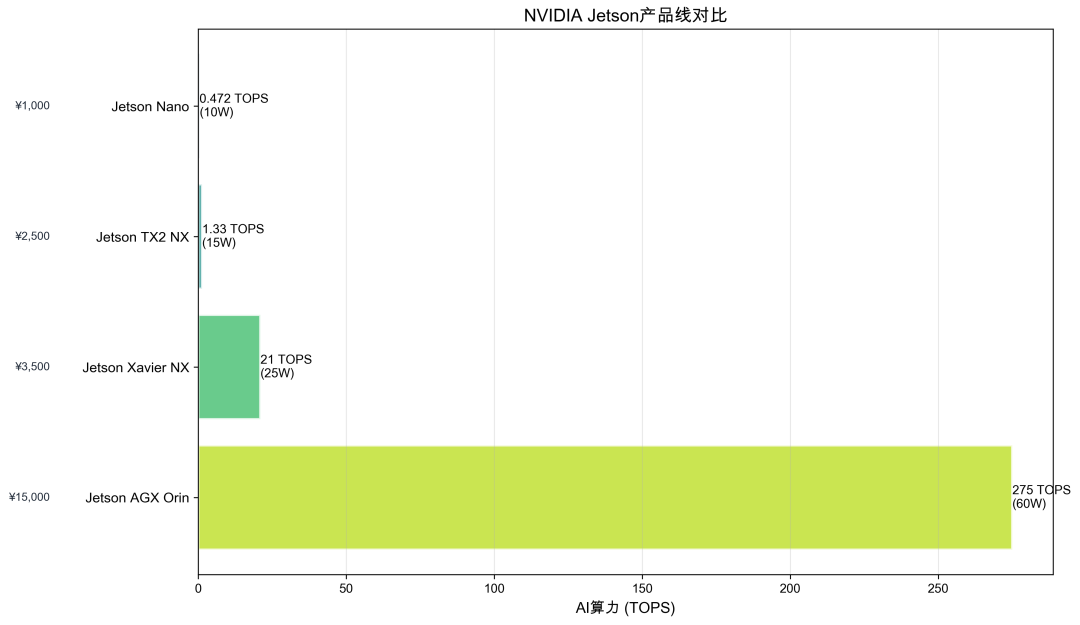

市场上硬件平台众多,选型是项目成功的第一步。NVIDIA Jetson 系列因其完善的AI生态和平衡的性能,成为许多开发者的首选。

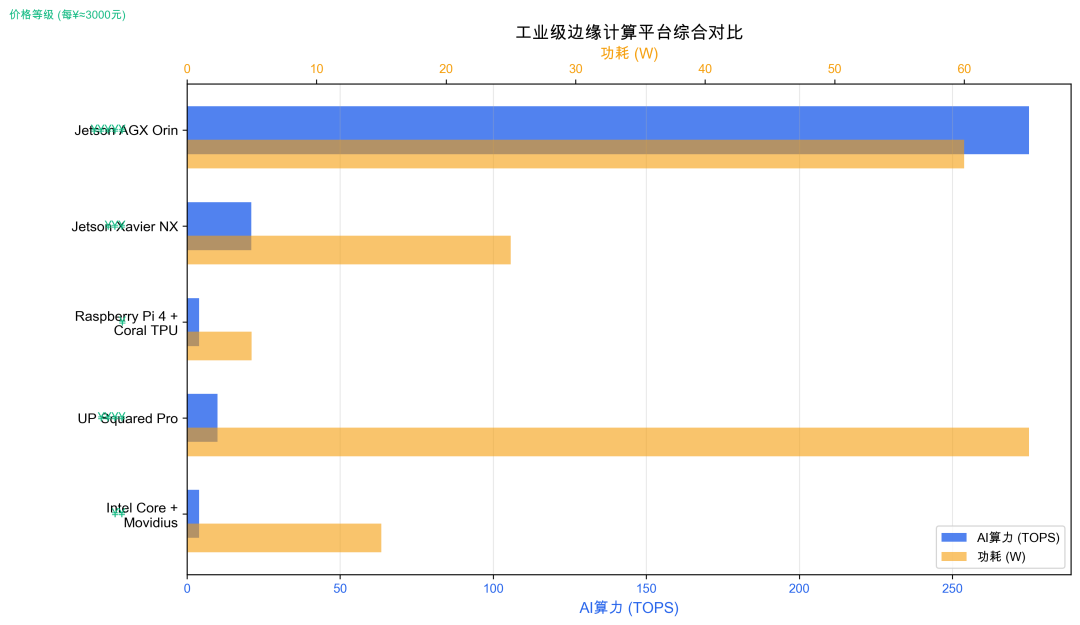

NVIDIA Jetson 产品家族对比

| 型号 |

AI 算力 (INT8) |

典型功耗 |

参考价格 |

适合场景 |

| Jetson Nano |

0.5 TOPS |

5-10W |

¥1000+ |

入门学习、简单推理 |

| Jetson TX2 NX |

1.3 TOPS |

15W |

¥2500+ |

轻量级AI应用、嵌入式设备 |

| Jetson Xavier NX |

21 TOPS |

25W |

¥3500+ |

安防监控、AGV、工业质检 |

| Jetson AGX Orin |

275 TOPS |

60W |

¥15000+ |

自动驾驶、高级机器人 |

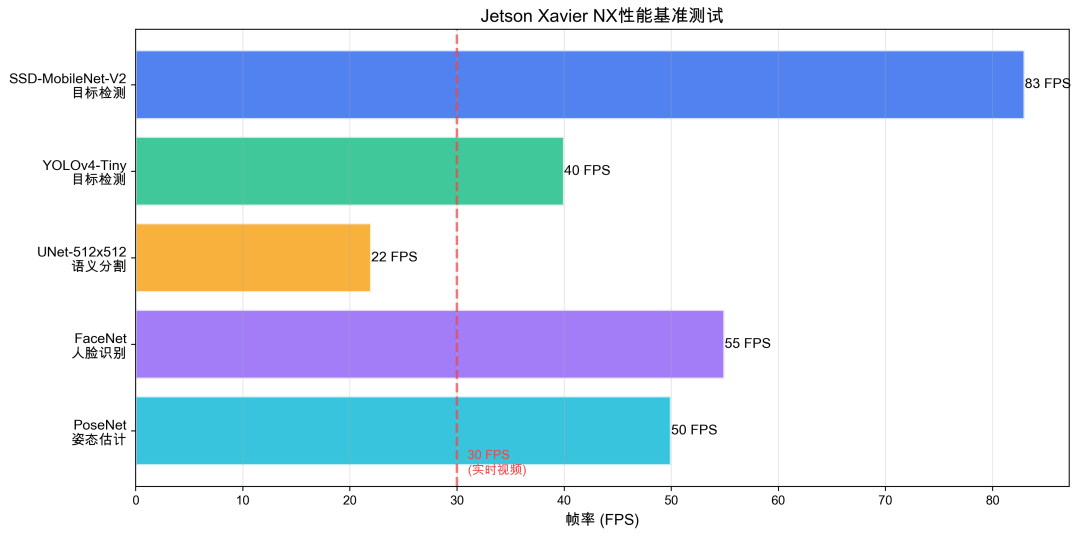

性能实测:Jetson Xavier NX 能跑多快?

光看算力参数可能不够直观,我们来看一些常见AI模型在Xavier NX上的实际帧率表现。

| 模型 |

帧率 (FPS) |

说明 |

| SSD-MobileNet-V2 |

83 |

目标检测,实时性绰绰有余 |

| FaceNet |

55 |

人脸识别 |

| PoseNet |

50 |

人体姿态估计 |

| YOLOv4-Tiny |

40 |

轻量级目标检测 |

| UNet-512x512 |

22 |

语义分割 |

结论:Jetson Xavier NX 在性能、功耗和价格上取得了极佳的平衡,能够覆盖大多数工业视觉、安防监控等场景的实时处理需求。

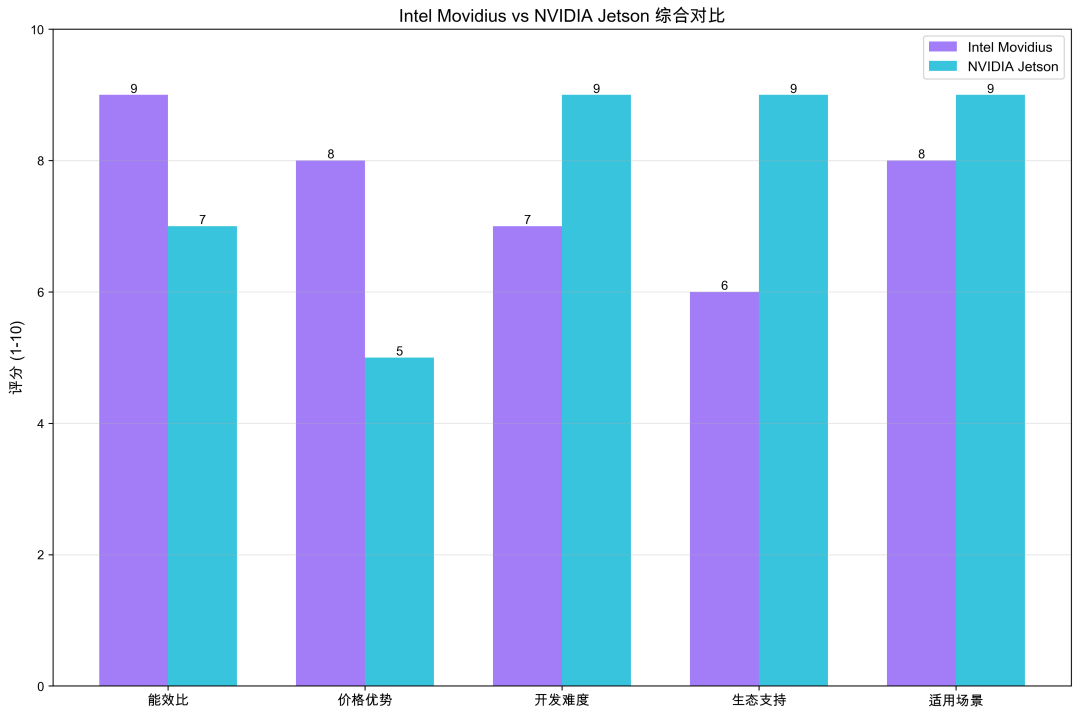

Intel Movidius 与 NVIDIA Jetson 综合对比

除了NVIDIA,Intel的Movidius VPU也是边缘AI领域的重要选手,两者定位略有不同。

| 对比维度 |

Intel Movidius |

NVIDIA Jetson |

| 能效比 |

⭐⭐⭐⭐⭐⭐⭐⭐⭐ (极高) |

⭐⭐⭐⭐⭐⭐⭐ (高) |

| 价格优势 |

⭐⭐⭐⭐⭐⭐⭐⭐ (高) |

⭐⭐⭐⭐⭐ (中等) |

| 开发难度 |

⭐⭐⭐⭐⭐⭐⭐ (中等) |

⭐⭐⭐⭐⭐⭐⭐⭐⭐ (低,生态好) |

| 生态支持 |

⭐⭐⭐⭐⭐⭐ (逐步完善) |

⭐⭐⭐⭐⭐⭐⭐⭐⭐ (极其丰富) |

| 典型场景 |

超低功耗、电池供电设备 |

通用边缘AI、复杂模型部署 |

工业级边缘计算平台横向对比

对于工业场景,需要综合考量算力、功耗、接口和可靠性。

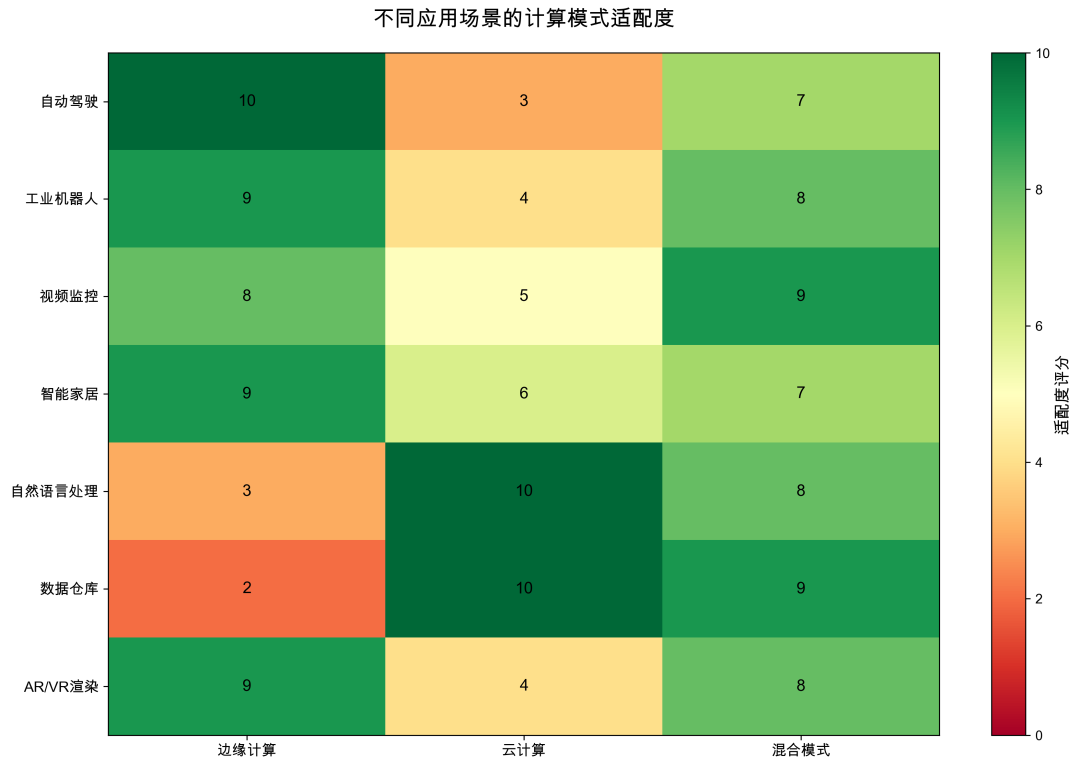

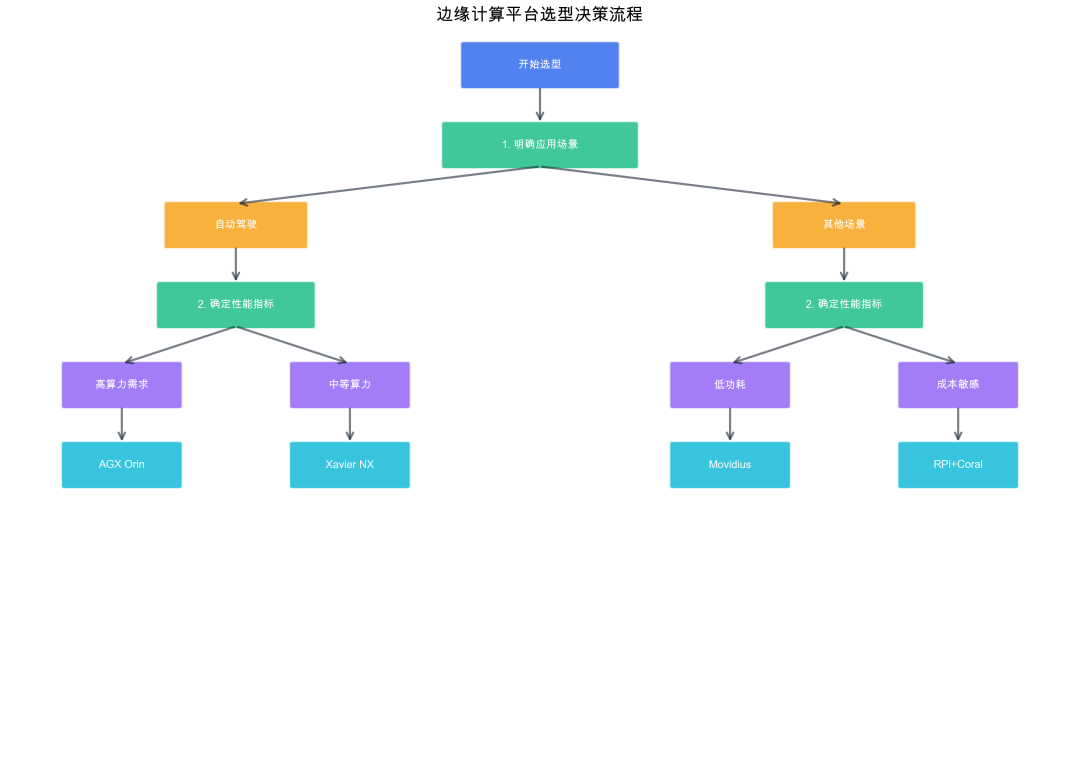

选型决策:根据应用场景来选择

没有最好的平台,只有最适合场景的平台。以下是一些常见的选型建议。

🚗 自动驾驶 / 高级驾驶辅助系统 (ADAS)

- 推荐:Jetson AGX Orin

- 理由:需要极高的算力处理多传感器(摄像头、激光雷达、毫米波雷达)融合感知;对实时性和可靠性要求极端严苛;通常预算较为充足。

🏭 工业视觉检测 / 安防监控

- 推荐:Jetson Xavier NX

- 理由:21 TOPS算力足以流畅运行主流检测、分割模型;性价比高;支持多路视频流同时分析;具备工业级宽温设计,适应严苛环境。

🏠 智能家居 / 低功耗IoT设备

- 推荐:树莓派 Raspberry Pi 4 + Google Coral USB加速棒

- 理由:整体功耗极低(<5W);成本极具优势(千元内);适合对算力要求不高、需要大规模部署的消费级场景。

选型决策流程图

如果你还在纠结,可以参考下面的决策流程来梳理思路。

实践避坑指南

-

❌ 只看峰值算力,忽视能效比

- 避坑:算力高可能伴随着高功耗和高热量。关注 TOPS/W(每瓦特算力)这个指标,它能更好地反映在功耗约束下的实际性能。

-

❌ 忽视开发工具链与生态

- 避坑:NVIDIA Jetson 拥有CUDA、TensorRT、DeepStream等成熟工具链,大幅降低开发难度。而一些专用芯片可能省电,但开发资料少,调试困难,会拖慢项目进度。

-

❌ 不考虑实际部署环境

- 避坑:工业现场需关注工作温度范围、抗振动等级、防尘防水(IP等级)等。消费级板卡直接用于工厂,很可能因为环境问题频繁故障。

-

❌ 盲目一次性大规模部署

- 避坑:任何新技术或硬件平台,都应遵循“小步快跑”的原则。先进行小规模概念验证(PoC),充分测试稳定性、准确性和实际收益后,再逐步推广。

总结

边缘计算并非要取代云计算,而是与云计算协同互补,形成更高效的“云-边-端”一体化架构:

- 边缘侧:负责实时响应(毫秒级)、高频数据处理、本地决策与隐私保护。

- 云端:负责大数据聚合分析、模型训练与迭代、非实时业务管理与全局调度。

在选择边缘计算平台时,请牢记以下原则:

- 场景驱动:明确你的核心需求是低延迟、省带宽、保隐私还是高可靠,并非所有应用都急需边缘化。

- 够用为王:在满足性能需求的前提下,选择性价比最高的方案,避免性能过剩。

- 生态优先:成熟的软件生态、丰富的社区资源和官方支持,能帮你避开大量技术深坑,加速产品上市。

- 迭代验证:采用敏捷方式,从小规模试点开始,快速验证技术路线的可行性,再考虑规模化部署。

通过本文的分析与对比,希望你能对边缘计算在自动驾驶等关键领域的重要性有更深刻的理解,并能在实际项目中选择合适的硬件平台,构建稳定高效的边缘智能系统。更多关于网络协议与系统架构的深度讨论,欢迎在云栈社区与广大开发者一同交流。