AI Agent搭建完成后,如何让它持续学习、变得越来越“聪明”?这往往是原型落地后更棘手的难题。

微软开源的 Agent Lightning 旨在将任何AI Agent转变为“可优化、可持续学习的智能体”,并且声称几乎无需修改现有代码。那么,在LangChain、AutoGen等框架林立的当下,它凭什么脱颖而出?

直面“训练鸿沟”

许多有过Agent部署经验的人都有同感:让一个Agent跑起来并不算太难,真正的挑战在于如何让它在实际应用中持续进步,适应复杂多变的真实场景。

以OpenAI的Agent SDK、LangChain为代表的编排框架,在快速原型设计和部署上确实表现出色。可能只需要几个小时,一个具备基础功能的Agent就能上线。但到了优化阶段——利用真实场景的反馈数据来训练和提升Agent表现时,开发者往往需要自己摸索,传统框架能提供的系统性支持非常有限。

微软的研究人员将这一问题称为 “训练鸿沟” 。开发环境中运行良好的Agent,一旦面对真实用户、边缘案例或领域特有难题时,性能就可能大打折扣。常见的应对方法不外乎手动调整提示词(Prompt)、修改参数,然后祈祷一切顺利。

Agent Lightning 正是瞄准了这一痛点。它的核心理念是将Agent框架与后续的优化基础设施进行解耦。按照微软的说法,该方案能够“无缝地为任何现有Agent启用模型训练,而无需对Agent代码进行任何修改。”

Agent Lightning 的工作原理

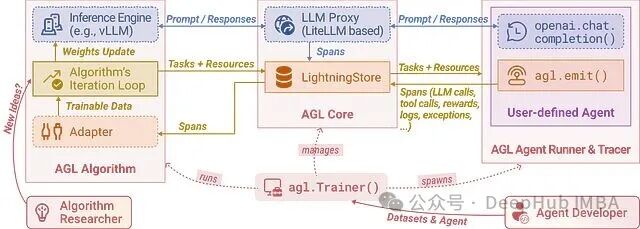

简单来说,Agent Lightning 在您现有的Agent代码与底层的训练基础设施之间,插入了一层轻量级的客户端-服务器架构。您可以将其理解为一个智能的“翻译层”和“优化器”:它负责捕获Agent的交互过程,将其转化为结构化的训练数据,经过算法优化后,再将改进后的参数反馈给Agent。

具体的工作流程如下:

- 无侵入式数据采集:您的Agent照常运行,无需任何代码改动。Agent Lightning 的客户端会透明地截获每一次与用户或环境的交互。

- 集中化训练优化:采集到的交互数据(包括LLM调用、工具调用、奖励信号、日志等)被发送到Lightning服务器。服务器端可以运行强化学习、自动提示工程、监督微调等多种算法,对Agent策略进行优化。

- 参数动态回传:优化后的模型权重、提示模板或策略参数会被推送回正在运行的Agent中,实现实时或近实时的性能提升。

该框架强调广泛的兼容性,明确支持 LangChain、AutoGen、CrewAI以及微软自家的Agent Framework。项目团队称其为 “Lightning AI Agent的终极训练器”。

安装过程极为简单,仅需一条命令:

pip install agentlightning

系统架构概览

下图清晰地展示了Agent Lightning 各组件间的协作关系:

实际应用场景

Agent Lightning 在需要Agent深度适配私有数据或特定行业需求的场景下尤其具有说服力。通用的预训练大模型处理常规任务尚可,但一旦涉及公司内部流程、行业术语或独特的业务逻辑,表现就容易不稳定。

- 客服助手Agent:它需要学习公司特有的工单升级流程、产品知识库中的“黑话”、以及与客户沟通的特定话术。传统方法是编写大量、精细的Prompt并希望其能泛化。使用Agent Lightning,系统可以直接从真实的客户对话历史中学习,利用解决率、满意度评分等业务指标自动优化响应策略。

- 代码生成Agent:在与团队代码库、编码规范和开发流程的持续交互中,Agent Lightning 可以不断微调底层模型,使其生成的代码越来越符合团队的个性化要求。

- 搜索与检索增强生成(RAG)Agent:Agent需要判断哪些数据源对特定查询最有价值、如何根据用户偏好排序结果、何时应该将问题转交给人工处理。这些决策逻辑都可以通过实际使用中的数据反馈进行持续优化。

竞争格局与开源策略

Agent Lightning 进入的是一个竞争激烈的赛道,但其定位具有明显的差异化。当其他玩家聚焦于Agent的编排、调度和模型服务时,微软选择切入了一个尚属蓝海的领域:Agent的持续优化与训练。

这实际上是微软平台战略的自然延伸。通过解决纯模型提供商或编排框架无法系统性解决的“后续”问题,微软旨在将开发者更深地绑定在其生态之内。值得一提的是,Agent Lightning 并未被包装成Azure云平台的独家服务,而是以开源形式发布。这既展现了微软对其平台和技术能力的自信,也表明了其推动整个AI Agent领域发展的诚意。

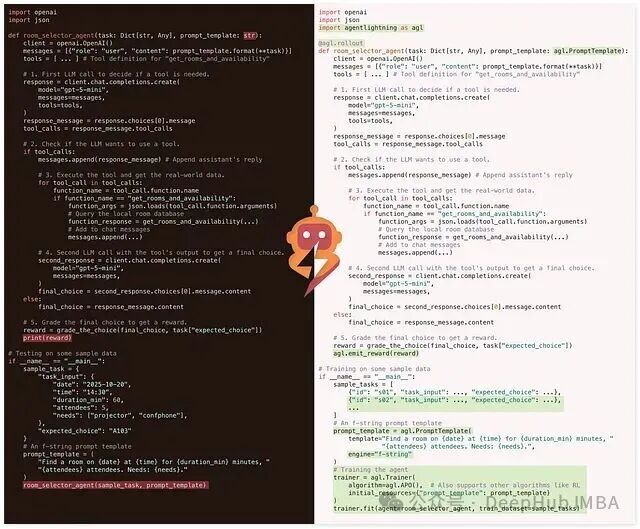

代码示例:快速上手

以下是一个简化的示例,展示如何将您的Agent函数与Agent Lightning 的训练器结合:

import openai

import json

def room_selector_agent(task: Dict[str, Any], prompt_template: str) -> Dict[str, Any]:

client = openai.OpenAI()

messages = [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": f"{prompt_template.format(task=task)}"}

]

# First LLM call to decide if a tool is needed.

response = client.chat.completions.create(

model="gpt-4-turbo",

messages=messages,

tools=[tool1, tool2, tool3]

)

response_message = response.choices[0].message

tool_calls = response_message.tool_calls

# Check if the LLM wants to use a tool.

if tool_calls:

# Execute the tool and get the real-world data.

function_name = tool_call.function.name

function_args = json.loads(tool_call.function.arguments)

# Call the local tool function.

function_response = get_rooms_and_availability(**function_args)

# Append assistant's reply with tool result.

messages.append(response_message)

messages.append({

"role": "tool",

"name": function_name,

"content": function_response

})

# Second LLM call with the tool output to get a final choice.

second_response = client.chat.completions.create(

model="gpt-4-turbo",

messages=messages,

tools=[tool1, tool2, tool3]

)

final_choice = second_response.choices[0].message.content

# Grade the final choice to get a reward.

final_grade = grade_the_final_choice(task="expected_choice")

return {

"final_choice": final_choice,

"reward": final_grade

}

else:

# Grade the final choice to get a reward.

final_grade = grade_the_final_choice(task="expected_choice")

return {

"final_choice": response.choices[0].message.content,

"reward": final_grade

}

# Testing on some sample data

sample_task = {

"name": "room_1",

"type": "conference",

"duration": "2025-10-20",

"expected_choice": "A103"

}

# An F-string prompt template

prompt_template = "Find a room at (date) at (time) for (duration_min) minutes.\n(attendees) attends.\n(Minutes: {duration_min})"

# 关键步骤:使用AGL Trainer包装您的Agent函数

trainer = AGILTrainer(

prompt_template=prompt_template,

trainer_agent=openai.ChatCompletion.create,

prompt_template_format=lambda x: x.replace("{duration_min}", str(x["duration_min"])),

agent_function=openai.ChatCompletion.create

)

# 启动训练过程

trainer.train(room_selector_agent, sample_task, prompt_template)

总结与展望

当前的AI Agent生态很大程度上解决了“如何搭建”的问题,但对于“搭建之后如何持续进化”则缺乏系统性的答案。Agent Lightning 提出的 “开发与优化解耦” 思路,恰好填补了从LangChain到AutoGen等一系列框架尚未覆盖的关键空白。

当然,需要理性看待的是,该项目目前版本(如文中所见的0.1.2)距离成熟、稳定的生产级应用仍有距离。但其指出的方向无疑是正确的。随着AI Agent越来越多地承担起关键业务角色,那些能够从真实世界反馈中持续学习的Agent,与那些静态、固化的Agent之间的效能差距只会越拉越大。

谁能够率先跑通“部署-监控-优化”的完整闭环,谁就可能在下一代智能应用的竞赛中占据先机。对于希望深入探索AI Agent训练优化的开发者来说,Agent Lightning 是一个值得关注和尝试的开源项目。欢迎在云栈社区继续探讨相关技术实践与前沿动态。