2026年2月10日,就在春节前夕,阿里巴巴的Qwen-Image-2.0与字节跳动的Seedream 5.0预览版在同一天登场,打响了新年的第一场AIGC大战。

这不只是时间上的巧合,两款重量级模型的同时亮相,更是AI生图领域“开窍”的集中体现。短短几年,这个赛道已经从“破圈”的Midjourney一枝独秀,演变为巨头们激烈角逐的技术亮剑。如今的大模型们,在可控生成、文字还原、多场景适配等关键能力上,已经实现了从“能画图”到“能干活”的质变。

我们不妨回顾一下这个快速的进化过程。

2022年,由Midjourney生成的《太空歌剧院》拿下艺术比赛冠军,让大众第一次惊叹于AI的艺术创作能力。但那时,AI生图更像是专业玩家的“玩具”,操作门槛和复杂的指令,让它离真正解决实际问题还有距离。

转折点出现在2025年。谷歌推出的轻量化模型Nano Banana,凭借其易于使用的特点,将AI生图真正带到了普通用户面前。到了2026年初,随着阿里、字节等巨头的重磅新模型发布,行业竞争已经进入白热化。

曾经的现象级工具Midjourney,为何在2026年的声音似乎变小了?以Qwen-Image-2.0、Seedream 5.0和Nano Banana为代表的新一代模型,又在哪些方面实现了突破?

01 AI生图为什么突然“开窍”了?

过去一年,行业重心发生了根本性转移:从比拼参数和生成速度,转向了比拼可控性、叙事能力和落地场景的实用性。

我们可以用两个关键节点来理解这个变化:

- 2025年,轻量化普惠时代。 Nano Banana的出现打破了“高端玩家专属”的壁垒,让“图文原生融合”成为可能,用户无需复杂指令也能快速出图。

- 2026年初,可控性落地时代。 阿里和字节的新模型代表了技术的集中突破。Qwen-Image-2.0首次将图像生成与编辑功能统一到单一架构,提升了出图效率;Seedream 5.0则增强了提示词理解、多步逻辑推理和联网知识整合能力。

这种技术跃迁的背后,是四大核心能力的集体突破:

- 多模态原生融合:终于解决了“图里的字乱码”这个老大难问题。现在生成一页PPT,图表、标题、数据标注都能一次准确到位。

- 物理世界对齐:生成的画面开始符合真实规律。光影统一、材质真实、空间关系合理,告别了那些“反物理”的离谱Bug。

- 可控生成:从“随机抽卡”变成了“指哪打哪”。可以精准控制局部细节、保持多图风格统一、进行多轮编辑而不“变脸”,极大提升了商用可用性。

- 动态叙事:能够理解复杂需求背后的业务逻辑。比如输入“生成一套产品营销图”,模型能主动推理出需要主KV、详情页、Banner等不同尺寸的交付物,并一键生成。

02 技术路线不同,擅长的活儿也不同

看着都能文生图、做编辑,这些模型实际用起来到底有什么区别?核心差距就在于“技术路线”。如果说共性是他们“都会做饭”,那差异就是有人擅长中餐,有人精通西餐,适合的场景完全不同。

先看共性: 无论各家怎么变,底层共识是都在主打端到端多模态图像生成。它们通常具备以下共同点:

- 功能一站式:文生图、图生图、编辑、局部修改、风格切换,一个工具全覆盖。

- 理解创作意图:AI开始真正理解需求,而不仅仅是执行字面指令。

- 生成效率高:深度优化的算法让生成速度大幅提升,几秒钟就能看到结果。

- 适配商用场景:支持细节微调、多图风格统一,能满足电商、设计等场景的交付标准。

然而,具体的技术路线决定了它们在不同场景下的表现各异。

场景一:中文创作

以Qwen-Image-2.0为例,它采用MMDiT多模态扩散架构,将生图和编辑能力整合到一个模型中。

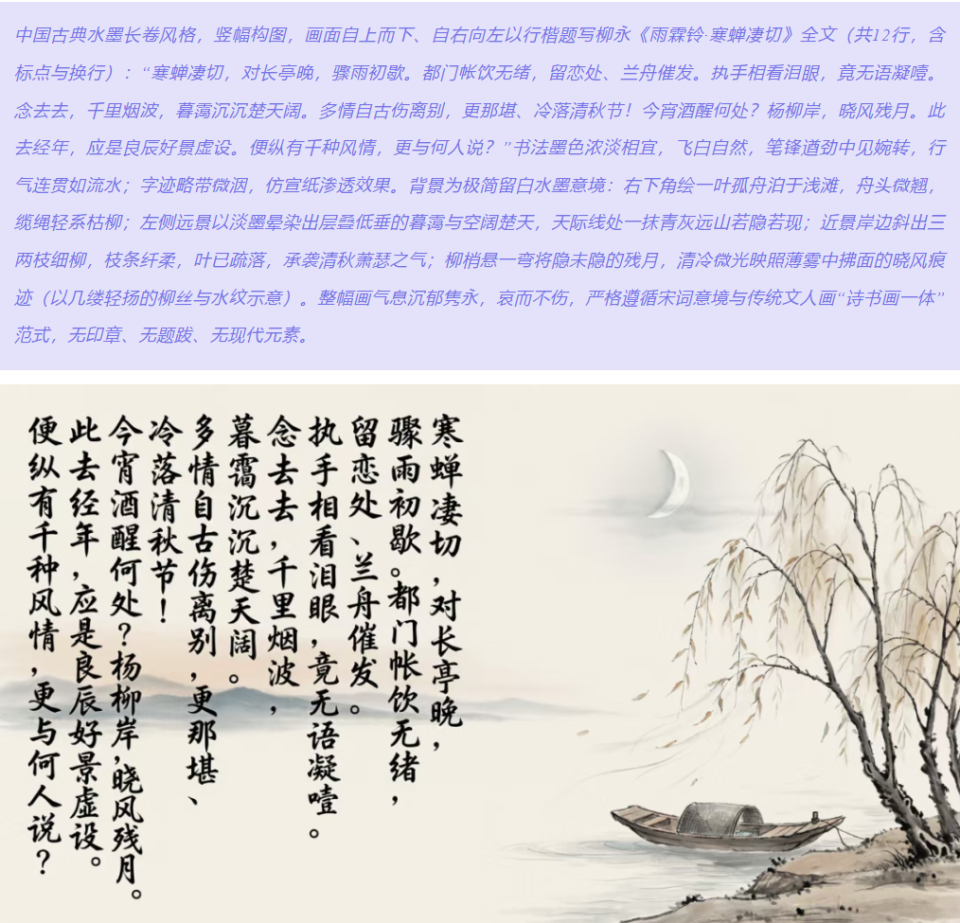

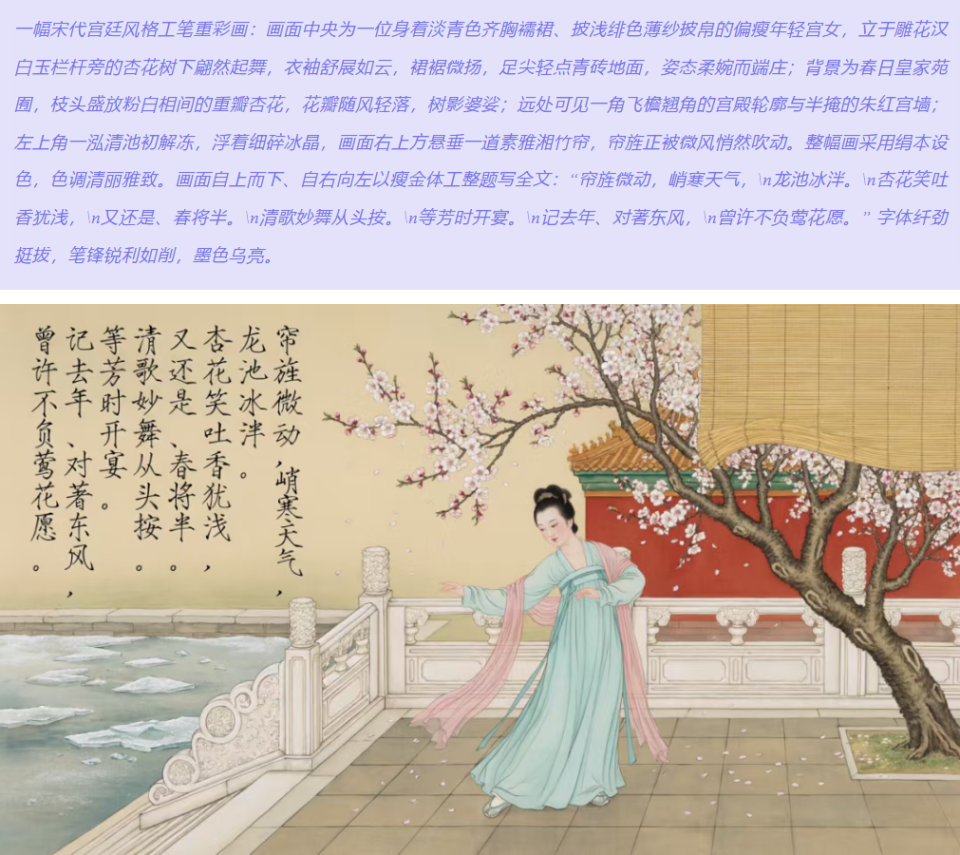

它的特点是能解析较长的中文指令(最多1000字符),对中文文字的生成相对准确。比如生成带有古诗词的图片,在字形和排版上能有较好的还原度,适合海报、广告图等需要精准呈现中文的场景。

Qwen也支持多种字体,例如用瘦金体书写宋词《探春令》。

局限:对于需要最新信息或复杂知识理解的场景,可能受限于训练数据的时效性。

场景二:时效性内容创作

以Seedream 5.0为例,它采用混合多模态架构,加入了RAG知识库和联网检索能力。

这意味着模型在生成图片前,可以先“上网查资料”,理解上下文。比如要生成2026年新发布的手机或热点事件,它能通过检索获取真实信息后再创作,而不是依赖旧数据“瞎猜”。

局限:联网检索的结果本身需要甄别,生成内容仍需人工核实。

场景三:创意内容生成

这类需求指令往往比较抽象。例如输入“李白漫游太空”,模型需要理解这是一个超现实创意,而非字面意思。Seedream 5.0在这类创意发散上表现不错。

同时,它也能实现精细的局部控制,比如在同一张图中,仅调整人物表情,生成喜怒哀乐不同版本。

场景四:高真实感与角色一致性

以Nano Banana为例,它采用Flow-Matching架构,在光影、材质、空间关系等物理细节还原上表现自然,角色一致性也较好。这使其适合故事绘本、IP设计等需要多图风格统一的需求。

作为轻量化模型,它在普通笔记本上也能运行,门槛较低。

局限:中文理解能力相对有限,且不支持联网检索。

03 AI生图的竞争逻辑变了吗?

Midjourney的画风与创意能力依然出色,那为何声量减弱?并非其能力退步,而是行业需求变了。

Midjourney的技术路线在文本理解深度与可控生成上,与当前主流模型侧重点不同。它的优势在于创意发散,擅长将模糊想法转化为多样化、高艺术完成度的视觉方案,非常适合“从0到1”的创意探索。

但其局限在于精细化控制不足,同一角色易“变脸”,局部修改会影响整体,生成速度也相对较慢。这使其难以满足需要批量、风格统一的商用场景。

到2026年,行业核心需求已从创意探索转向高效生产。 可控性、场景适配能力成为更重要的指标。当前的竞争焦点集中在三个方面:

- 可控性:能否精准响应需求。 这是从实验工具转向生产工具的关键。如今评价的核心是“需求匹配度”,即理解复杂指令、控制细节、保证主体一致性的能力。采用知识增强架构的Seedream、针对中文优化的Qwen,在商用场景下的输出可用率显著提高。

- 场景适配性。 行业呈现明显的场景分化。字节将Seedream集成到剪映,切入短视频制作;阿里的Qwen瞄准电商、办公;Nano Banana则面向专业摄影领域。深度绑定具体场景,能建立更强的竞争壁垒。

- 生态整合力。 技术轻量化之后,如何让更多人用起来是关键。Seedream提供限时免费和高清输出,Qwen上线了易用的千问APP,都是在降低使用门槛。

短期看,不同技术路线会在各自擅长的场景占据优势。长期而言,单纯比拼生成质量已不够,能够整合知识理解、场景适配和生态支持的技术路线,可能更符合行业发展的方向。

04 AI生图的下一步

从轻量化普及到可控落地,AI生图的进化速度有目共睹。结合趋势,未来可能朝这几个方向发展:

- 普及程度更高: 轻量化技术让更多设备流畅运行,免费或低成本选项增加,中小企业和个人创作者都能受益。

- 更“懂”用户意图: 未来的模型不仅能执行指令,更能理解背后的业务逻辑,甚至根据用户习惯生成个性化方案,大幅降低沟通成本。

- 场景结合更深: 技术与具体工作流结合更紧密。例如电商一键生成全渠道套图,短剧输入剧本生成分镜甚至视频,设计工具支持图层级编辑等。

- 使用门槛再降低: 可能不再需要复杂的提示词工程,上传参考图加简单描述就能得到理想结果。

应用的落地会不断反哺技术改进。短剧、电商等丰富场景的具体需求,将持续推动模型在多图关联、角色一致性等方面的优化。对于创作者和企业而言,选对适配自身场景的模型,就能抢占效率红利。而对于整个行业来说,这场朝着“可控、落地、普惠”方向的进化,才是AI生图技术真正的价值所在。想了解前沿技术动态和与同行交流,可以关注云栈社区。