大语言模型(LLM)在演示阶段看起来总是令人惊艳。然而,一旦进入生产环境,许多问题就会暴露出来:输出不稳定、结果难以预测,甚至直接无法使用。

从实践经验来看,核心问题很少出在模型本身。更多时候,关键在于如何设计、评估和迭代应用模型的提示词。LLM应用的输入提示词必须针对具体任务进行精细调整,才能将模型的行为约束在期望的输出范围内。

遗憾的是,提示词工程在今天很大程度上仍被视为一门“艺术”。这篇文章要探讨的正是为何这本身就是一个问题,以及我们如何能将其转变为一门可度量、可重复的工程学科。

提示词工程在很大程度上仍停留在“猜测”阶段。

许多团队改进提示词的流程相当粗糙:有人撰写(或重写)一段提示词,运行几个示例,基于主观感受判断“似乎好了一些”,然后就部署上线了。

整个过程缺乏客观的度量标准,没有明确的性能基线,甚至对于“更好”一词都没有清晰的定义。

这导致了一系列直接后果:提示词质量难以进行横向对比;评估基本依赖人工审查外部响应来模糊判断;回归问题不易察觉;许多潜在故障直到上线后才被发现。当我们的目标是构建可靠的AI系统时,这种极度主观的工程实践就成为了一个严重的瓶颈。

实际LLM应用中的一对矛盾

在生产环境中运行LLM时,我们反复遇到两个看似对立的问题。

不一致性:同一提示词,不同答案

同一段提示词运行多次,可能会产生明显不同的输出。这不仅仅是令人烦恼的问题,对于数据流水线、自动化决策系统以及评估框架而言,这是实打实的可靠性风险。在这些场景下,高方差是缺陷(bug),而非特性(feature)。模型的行为要么需要表现出确定性,要么其随机性必须被严格控制在可预测的范围内。

缺乏多样性:模型的创造力不足

另一方面,在多个实际项目中,我们也遇到了相反的困境。在进行创意生成、探索性分析或内容构思等任务时,模型的产出内容彼此之间过于相似,概念覆盖面非常狭窄。一旦规模化,模型似乎就失去了创造力。在这种情况下,确定性就从优势变成了束缚。

一个基本假设:提示词质量应是可衡量的

我们提出一个简单的假设:提示词的质量应该是可以衡量的。

有些任务需要最小化输出方差,确保稳定性;而另一些任务则需要最大化多样性,激发创造力。提示词的任何变更,都应该能够推动结果朝着可度量的方向移动。针对不同类型的任务,我们可以选择不同的度量标准。既然模型的行为可以被衡量,那么提示词所引导出的行为模式,为何不能呢?

为了验证这个想法,我们选择从模型行为的一个切面入手:响应多样性,并将其作为“创造力”的一个代理指标。

本次探索的目标不是找到完美的度量方式,而是试图回答两个核心问题:

- 提示词的变更能否转化为一致的、可观测的数值差异?

- 单次任务所表现出的“创造力”或“确定性”,究竟更多地取决于提示词的引导,还是仅仅由采样温度(temperature)参数所决定?

实验设计与方法

这是一个规模可控的探索性实验,设计如下:

1. 提示词设计

- 提示词A(基础版):

Create 5 ideas of creative banners for performance marketing of an AI benchmarking platform.

- 提示词B(创意版): 在A的基础上增加一条明确指令:

Create 5 ideas of creative banners for performance marketing of an AI benchmarking platform. Be as creative as possible.

2. 模型与采样设置

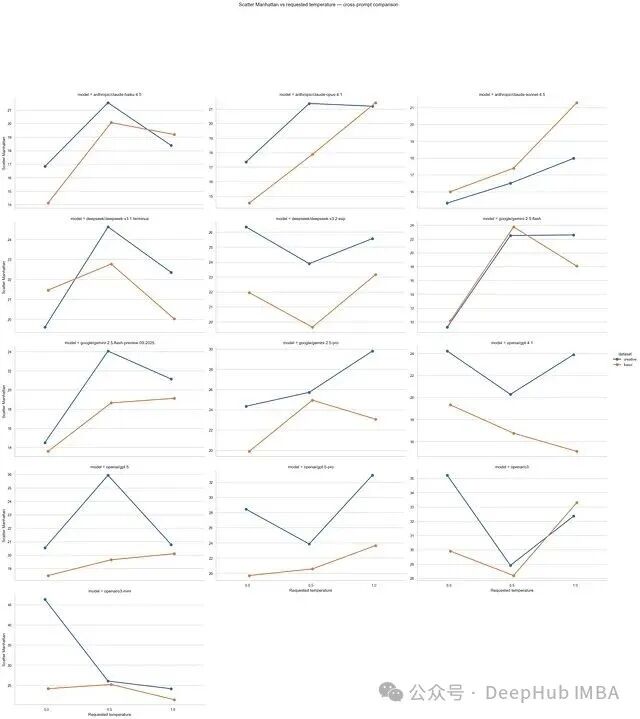

我们采用单次生成(single-shot)模式。测试了多个主流LLM(涵盖OpenAI GPT系列、Google Gemini系列、Anthropic Claude系列以及DeepSeek等家族的13个模型)。为每个模型设置了三个温度采样点:0.0、0.5 和 1.0(max)。每个(提示词、模型、温度)组合独立运行10次,以收集响应。

3. 多样性度量:基于Embedding的距离计算

对于每一次生成的文本响应,我们都计算了其4096维的语义嵌入向量。然后,针对每个实验集合(即固定的提示词、模型和温度),计算该集合内所有嵌入向量之间的最大成对距离,并将其作为“响应多样性”的度量指标。

其逻辑非常直观:如果集合内所有响应的语义向量彼此距离很近,说明模型的行为高度一致、确定性高;如果距离很大,则说明输出多样,可能更具创造性。最终,我们得到了一个数值,用以量化描述模型响应的“分散程度”。

实验结果与分析

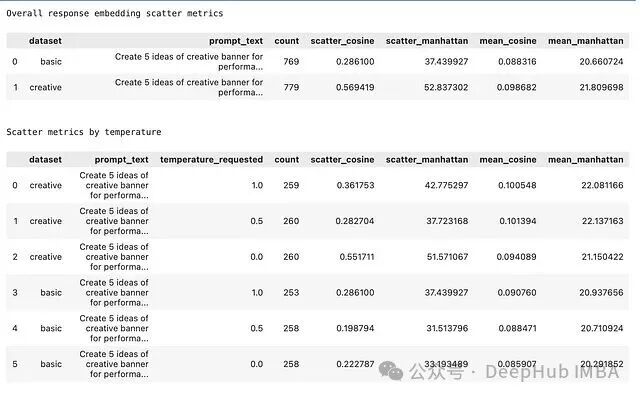

汇总数据显示,增加“Be as creative as possible”指令的创意提示词,导致了更显著的响应分散度。同时,温度参数的影响并非总是线性或一致的。

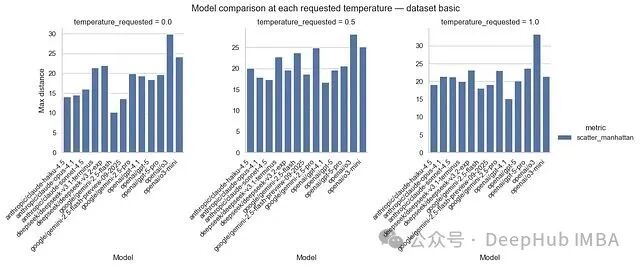

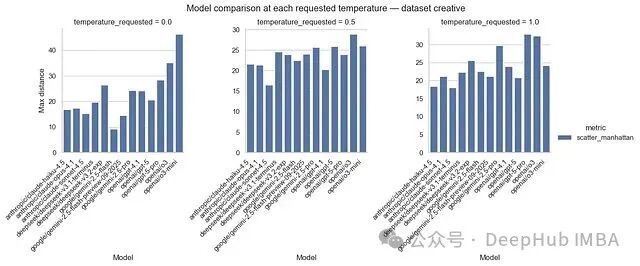

基础提示词与创意提示词在不同模型-温度组合下的比较。图表清晰显示了创意指令带来的整体性影响。

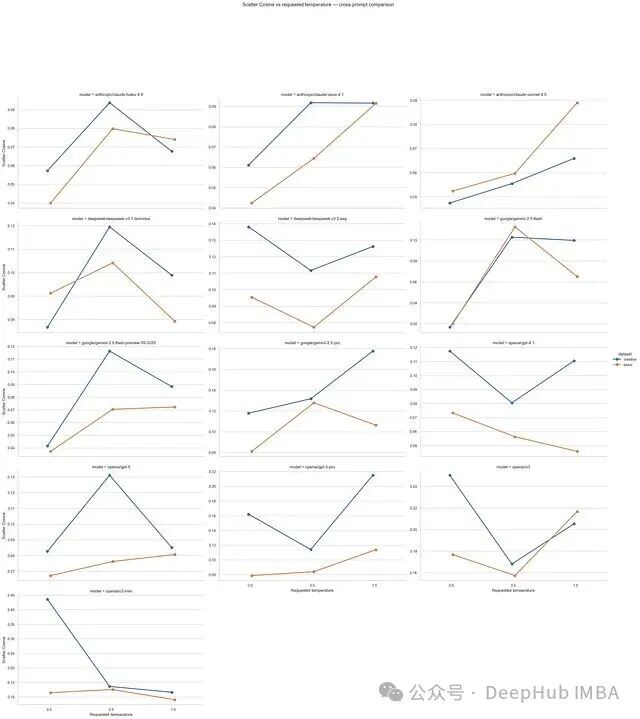

结果比预期的更为清晰。跨模型分析显示出了三个明显的趋势:

- 提示词指令是主要驱动因素:在提示词中加入明确的创造力指令后,几乎所有模型的响应分散度曲线都呈现一致性上移。

- 温度的作用有限且不稳定:提高温度参数在一定程度上增加了响应多样性,但由于样本量限制,此结论需谨慎看待。

- 模型对温度的敏感性各异:不同模型家族、甚至同家族的不同版本,对温度变化的响应模式差异很大,没有统一的规律。

关键结论:提示词的变更带来了可预测的、方向性的数值效果,而非随机噪声。这说明了两点:

- 提示词的迭代改进可以不完全依赖主观直觉,其引导的“输出创造力”在一定程度上是可量化的。

- 这一初步发现有望在更大样本和更多样化的应用场景中得到验证和推广。

实际意义:

这套方法为提示词工程提供了初步的量化工具。团队可以:

- 对不同的提示词设计方案进行基于数值的A/B测试。

- 在进行温度参数调优时,依据度量数据而非盲目猜测。

- 根据任务对“确定性”或“创造性”的具体需求,数据驱动地选择模型。

它使得团队有能力在提示词变更部署上线之前,就对潜在效果做出更可靠的推断。

实验的局限性与后续方向

尽管结果显示出积极信号,但本次探索性实验存在若干局限性,需要在解读时注意:

度量标准的任务特定性

本文定义的“创造力”严格来说是任务相关的。使用嵌入向量距离衡量的响应多样性,在创意生成、营销文案构思等探索性任务上作为代理指标是合理的。但在事实性问答、代码生成或结构化数据提取等场景下,高多样性可能毫无意义,甚至产生误导。它不能作为模型质量的通用指标。

对嵌入模型空间的依赖

所有测量都建立在特定的嵌入模型和距离度量函数之上。更换不同的嵌入模型、向量归一化方式或距离函数,绝对数值会发生变化,模型间的相对排名也可能不同。本实验观察到的趋势是稳定的,因此结果应被视为相对比较,而非绝对值。

有限的样本量

每个配置只运行了有限的次数。虽然趋势一致,但要减少方差、估算置信区间并得出强有力的统计结论,样本量还远远不够。目前的发现更应被视为探索性的线索,而非最终定论。

提示词与领域偏差

实验仅使用了一种任务表述(横幅创意)和一个较窄的领域(AI平台的效果营销)。推广到其他领域或提示词风格时,效果可能减弱、增强或呈现完全不同模式。将结论泛化到创意任务之外需格外谨慎。

创造力与实用性的权衡

响应多样性高并不等同于结果质量高。高度多样化的输出中可能混杂着不相关的想法、低质量的建议或不连贯的回复。本实验测量的是方差,而非实用性或商业价值。在实际应用中,创造力度量必须与质量过滤或下游评估标准配合使用。

LLM的非平稳性

大语言模型会被服务提供商持续更新,因此绝对分数可能随时间发生漂移,甚至在提示词未改的情况下发生变化,可复现性可能降低。任何长期的基准测试都必须将这种非平稳性纳入考量。

相关性不等于因果性

最后,我们必须指出,温度、提示词指令与响应多样性之间虽存在明确的相关性,但这并不等同于我们已完全理解了模型行为背后的因果机制。实验证明的是“提示词变更的效果可以被量化衡量”,而非创造力可以被这套度量标准完全解释。

总结与展望

这只是我们系列研究中的第一个探索性实验,后续结果将在接下来的文章中陆续分享。下一步计划包括:增加样本量以提高统计效力;尝试更多样化的提示词修改策略;实验如何通过提示词设计来“降低”创造性(即提高确定性);为代码生成、摘要等不同类型任务定义新的专用度量标准;以及构建一个定期更新的多维度模型能力排行榜。

对LLM应用进行系统化、可度量的工程化探索,是迈向可靠AI系统的必经之路。欢迎在云栈社区交流你的想法与实践。