9B模型实现端侧百万上下文推理,比同尺寸模型速度最高提升 3.5 倍。

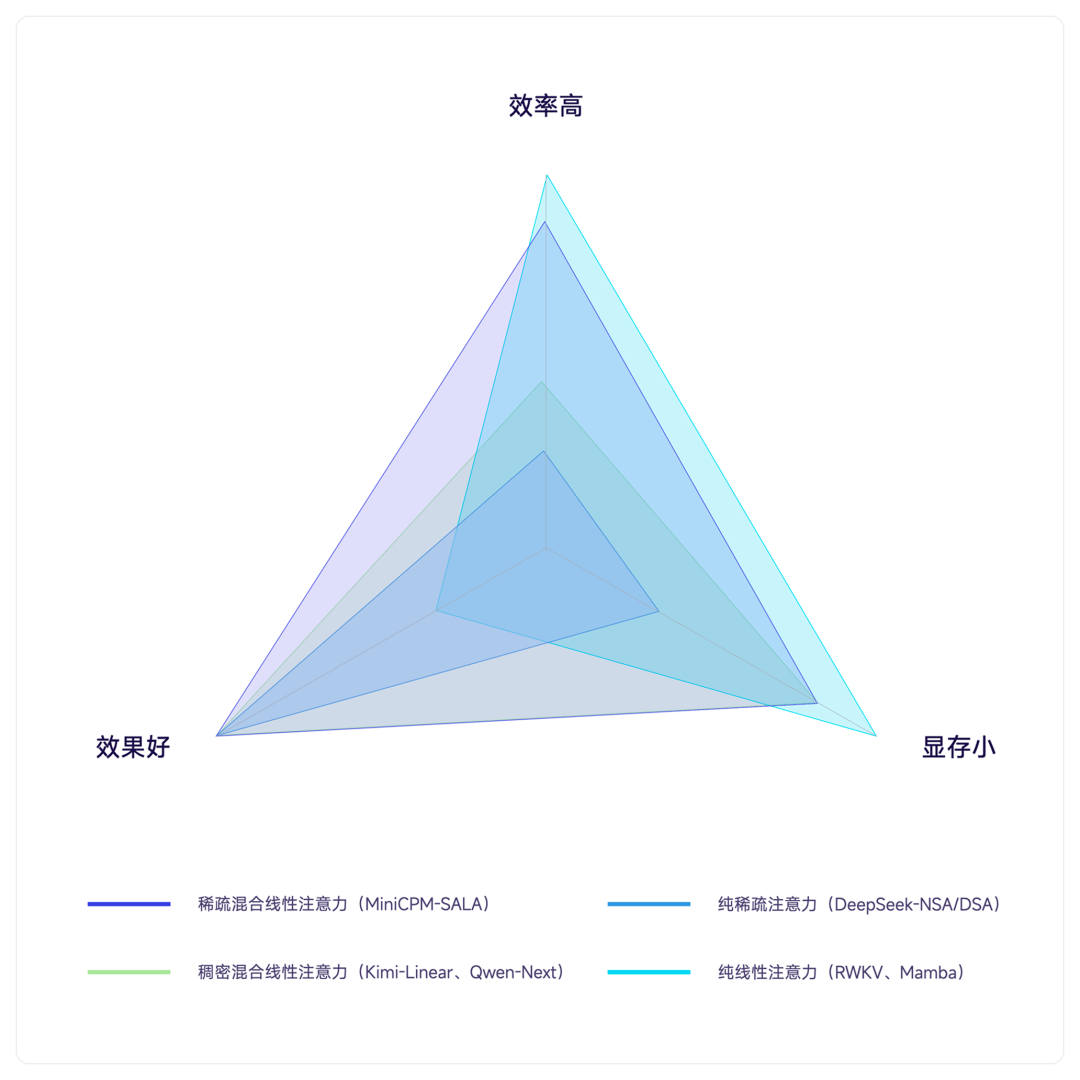

众所周知,Transformer及其核心的全注意力机制虽长期占据大模型架构的核心地位,但其平方级计算复杂度和高额显存占用的瓶颈,已成为实现超长上下文处理与模型规模化应用的主要障碍。从DeepSeek的稀疏注意力到月之暗面的线性注意力,行业正积极投入注意力架构的革新。

如今,面壁智能也在这场变革中迈出了关键一步:正式发布了行业首个大规模训练的稀疏-线性注意力混合架构SALA(Sparse Attention-Linear Attention),以及基于该架构的文本模型MiniCPM-SALA。该模型旨在追求更长的文本处理能力与极致的推理性价比,不仅在多项长文本理解与生成评测中优势明显,且在知识、数学、代码等核心能力维度上,保持了与同规模全注意力模型相当的卓越水平,实现了“长短兼备”的综合性能。

MiniCPM-SALA 核心亮点

- 架构革新:采用“稀疏-线性”注意力混合架构,在显著降低推理开销与显存占用的同时,克服了纯线性架构在长程信息召回上的精度瓶颈,兼顾效率与性能。

- 卓越性能:采用HyPE(混合位置编码)来协调短、长上下文的性能。在保持通用能力与其他8B模型相当的同时,在多个长上下文基准测试中表现出明显优势。

- 高效推理:不使用投机采样等加速算法,在云端推理芯片上,当序列长度为256K词元时推理速度高达Qwen3-8B的3.5倍,并支持在云端和消费级端侧GPU上进行高达一百万词元上下文长度的推理。

相关链接

为何混合架构是更优解

传统Transformer模型在处理长文本时面临计算和显存的双重瓶颈。现有的线性注意力与稀疏注意力方案各有短板:前者存在精度损失,后者则有存储瓶颈。

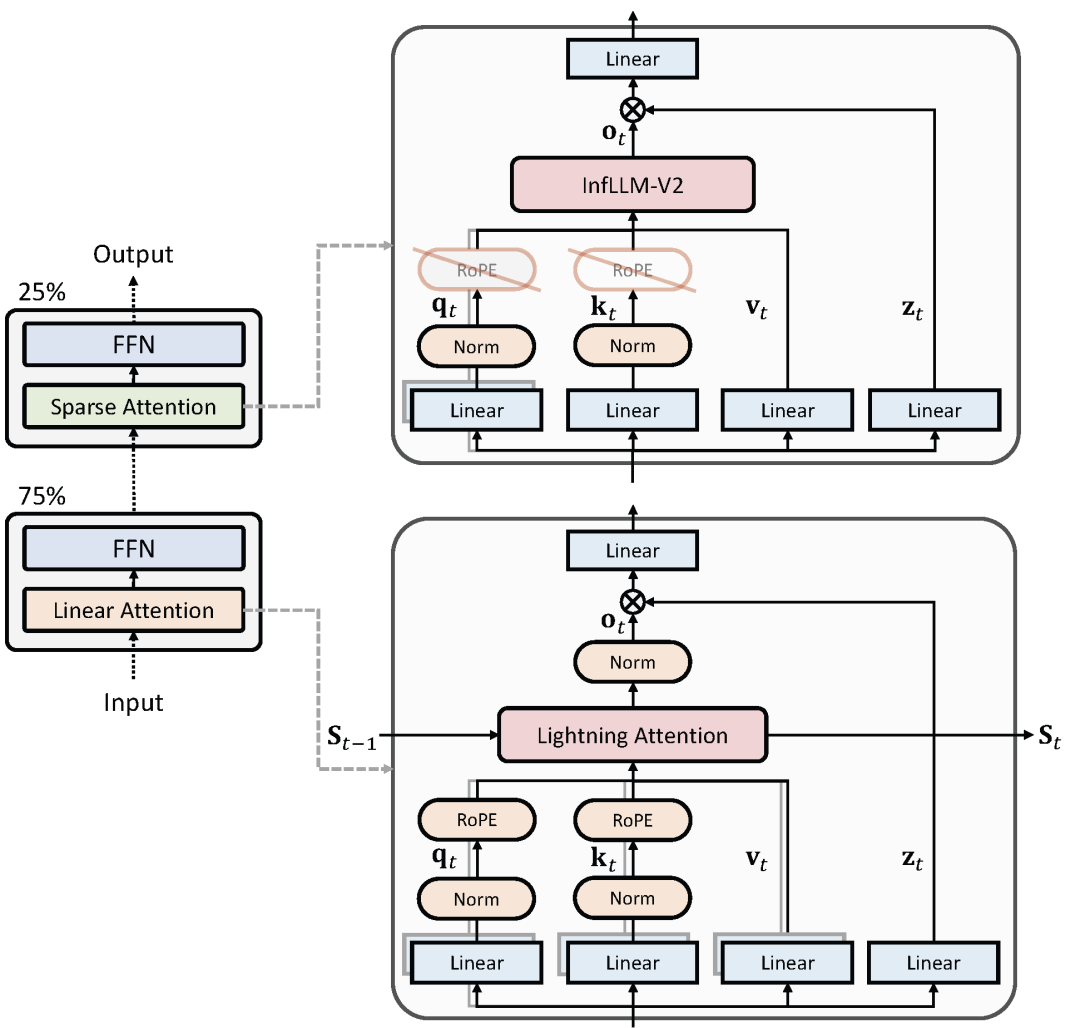

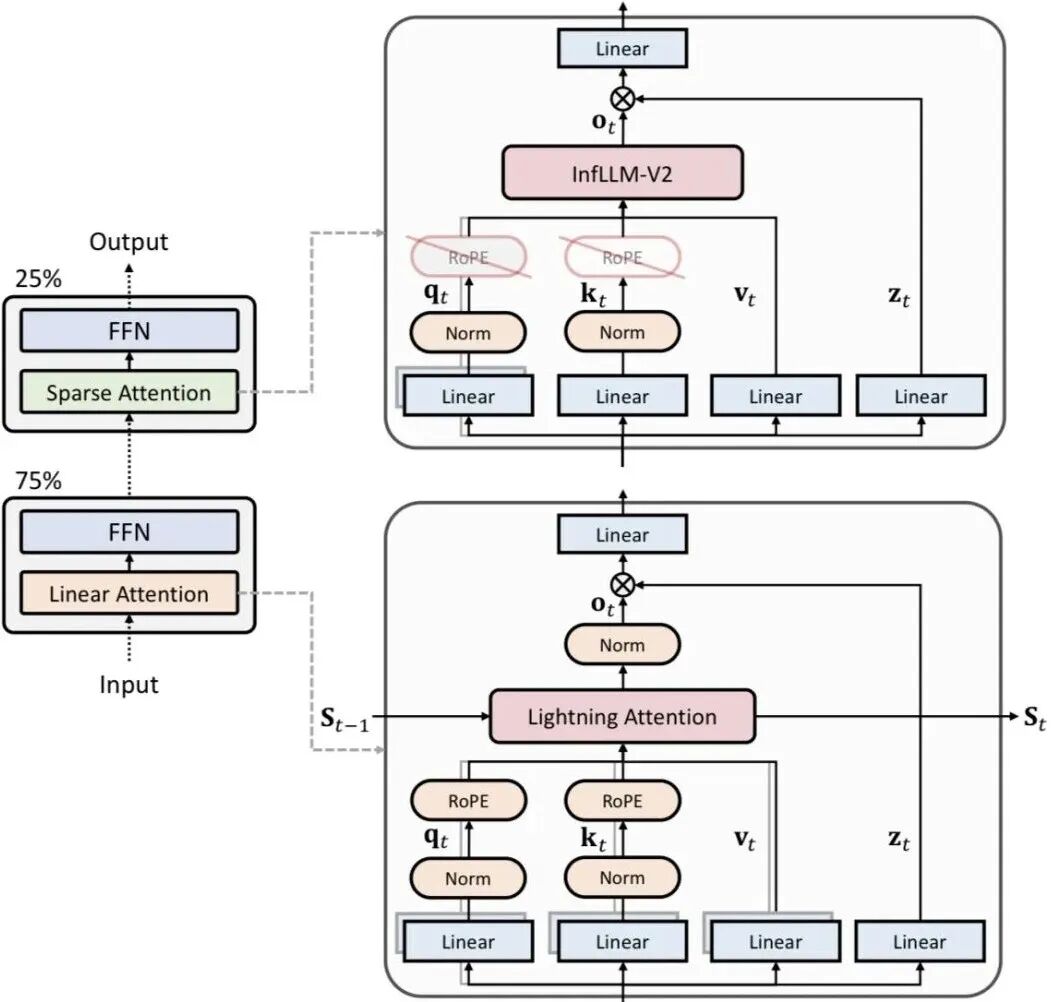

MiniCPM-SALA首创的稀疏-线性混合注意力架构,巧妙地解决了这一矛盾。模型中75%的层采用线性注意力(Lightning Attention),负责信息的高效全局流转;其余25%的层采用稀疏注意力(InfLLM-v2),专注于精准捕捉局部关键信息。这种黄金配比实现了计算效率与语义精度的平衡。

相关研究论文现已公开:

不止于「长」,更在于「强」

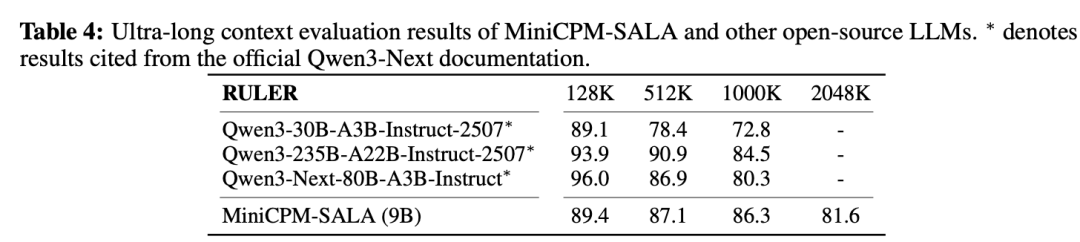

MiniCPM-SALA具备优异的长度泛化能力。在不使用任何额外技术(如YaRN)的前提下,可以将上下文长度有效外推至2048K。

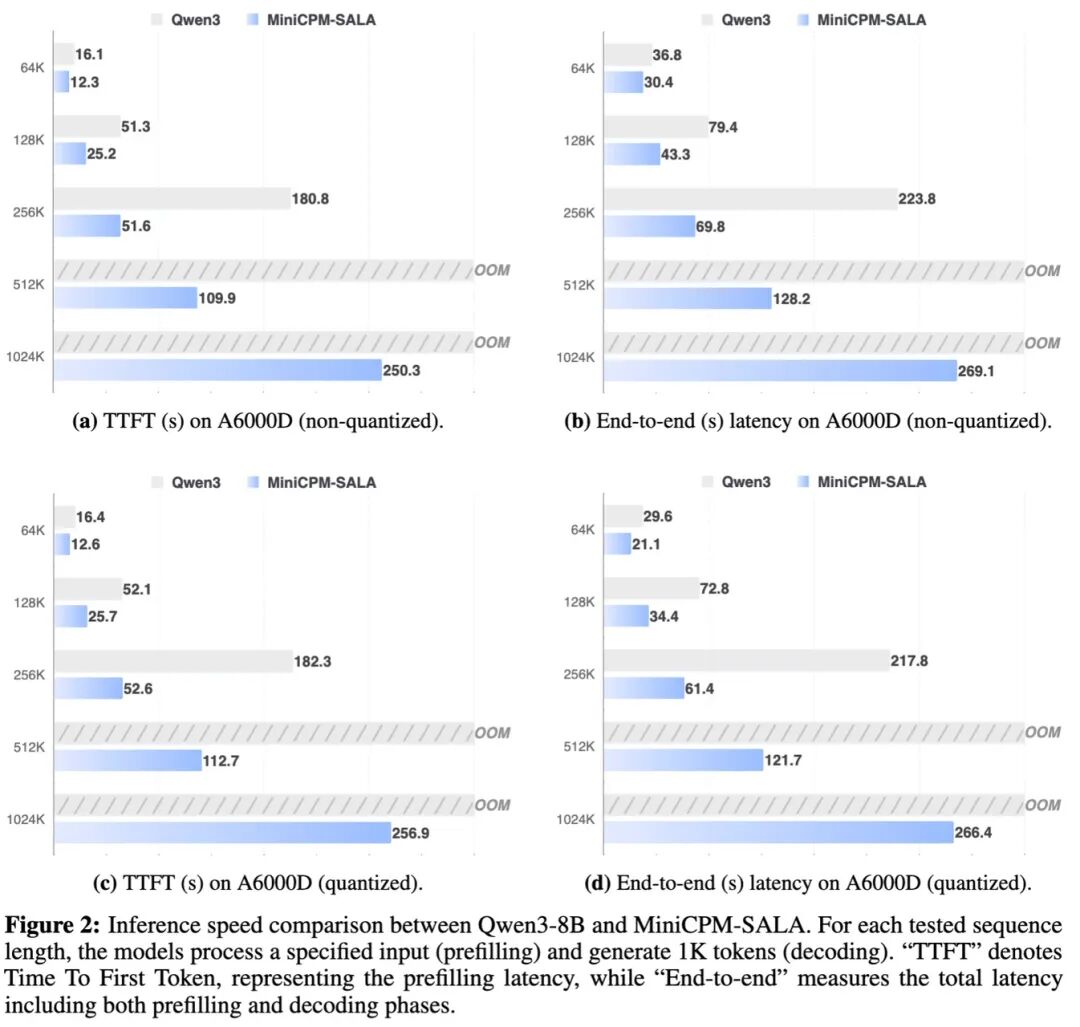

在推理效率方面,从64K到1024K词元的不同序列长度下,MiniCPM-SALA均表现出显著优势。在256K序列长度下,其推理速度相比Qwen3-8B实现了约3.5倍的加速。

当序列长度达到512K及1M时,同尺寸开源模型已因显存不足(OOM)而无法推理,MiniCPM-SALA却依然能够稳定运行。这使其在汽车、手机、机器人等端侧领域的应用成为可能。

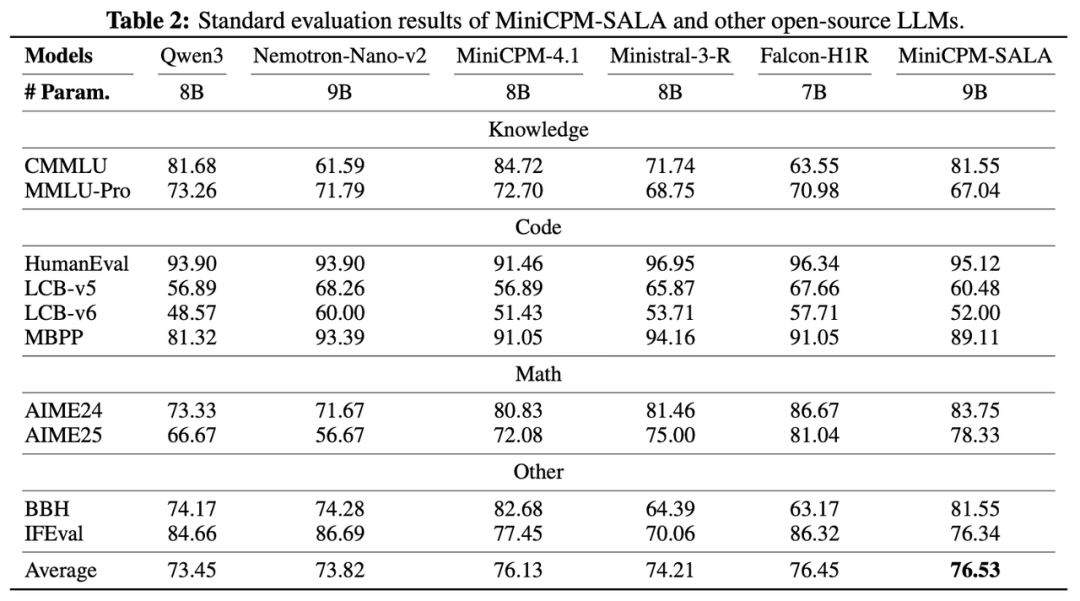

此外,在仅有9B参数的前提下,MiniCPM-SALA在知识、数学、代码等核心能力上保持了与同规模全注意力模型相当的卓越水平,真正做到了“长短兼备”。

邀你挑战推理极限

为进一步探索SALA混合注意力架构在实际部署中的性能极限,OpenBMB联合SGLang、NVIDIA、面壁智能共同发起2026稀疏算子加速大奖赛(SOAR)。大赛聚焦于稀疏化算子融合与编译优化等底层硬核课题,挑战在消费级GPU上实现百万级词元推理与KV Cache的极致效率。

比赛官网:https://soar.openbmb.cn/

技术报告精要

01 引言

随着大模型应用场景的深化,处理超长上下文(如整本手册、数万行代码)的能力变得至关重要。然而,传统Transformer面临着“计算墙”(复杂度O(N²))和“显存墙”(KV-Cache巨大)的双重挑战。

现有稀疏注意力和线性注意力方案各有优劣。MiniCPM-SALA采用的稀疏与线性注意力混合架构,结合了前者的高保真局部建模能力与后者的全局计算效率,旨在实现高效的长序列建模。

主要贡献如下:

- 创新架构设计:提出SALA混合注意力机制,25% InfLLM-V2 + 75% Lightning Attention,平衡性能与效率。

- 高效训练范式:通过对预训练权重进行架构转换,总训练量仅为从头训练的25%。

- 强大的综合性能:在保持通用能力与主流模型相当的同时,长上下文性能优势明显。

- 优越的推理效率:在A6000D上,256K长度推理速度达Qwen3-8B的3.5倍,并支持端侧百万词元推理。

02 模型架构

(1)总体架构设计

基于交替式混合注意力架构,采用25%稀疏注意力与75%线性注意力的混合配比。利用HALO算法将预训练的全注意力Transformer转换为混合架构,而非从头训练。

(2)稀疏注意力模块

采用InfLLM-V2作为稀疏注意力模块。其可切换特性允许在长文本训练中开启稀疏模式,在标准长度训练中关闭,以平衡效率与通用能力。加入了输出门控机制以提升性能。

(3)线性注意力模块

选择Lightning Attention作为线性层核心算子,因其计算范式与全注意力更接近,与HALO转换算法适配度更优。采用了QK归一化、GQA转MHA、输出门控等设置以提升稳定性和性能。

(4)混合位置编码

沿用HyPE策略:线性层保留RoPE以保持与转换前模型的一致性;稀疏层采用NoPE,使历史KV-Cache不耦合位置信息,从而规避RoPE的长距离衰减问题,增强远距离召回能力。

03 模型训练

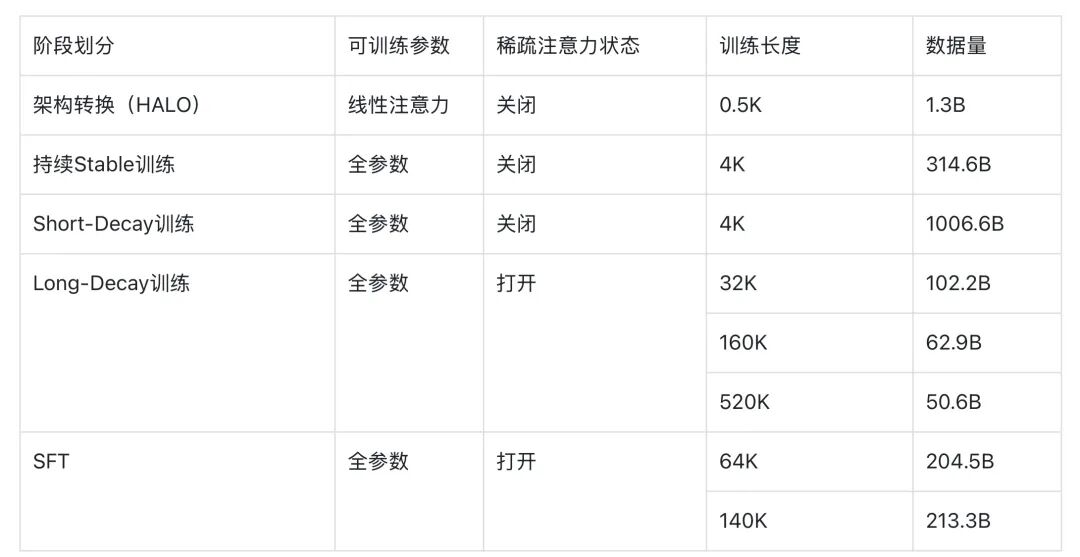

模型整体训练过程如下表所示:

- 架构转换(HALO):将Transformer转换为混合架构,仅训练转换后的线性注意力层,使用1.3B词元(长度512)。

- 持续Stable训练:序列长度4K,训练314.6B词元,促进各组件适配,本阶段关闭稀疏注意力。

- Short-Decay训练:序列长度4K,训练1T词元,学习率指数衰减,增加高质量及合成数据权重。

- Long-Decay训练:上下文窗口从32K逐步扩展至520K,启用稀疏注意力,进行全参数训练以学习两种注意力的协同。

- SFT:使用高质量的推理密集型及长上下文合成数据,依次在64K和140K长度下训练,稀疏注意力全程启用。

04 模型能力测试

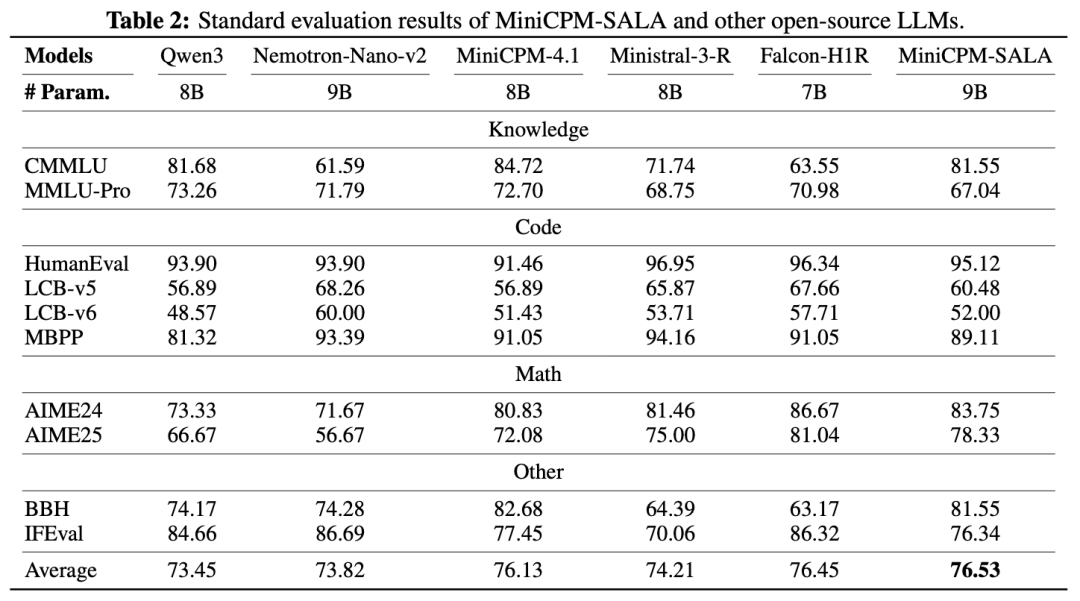

短上下文能力测试:

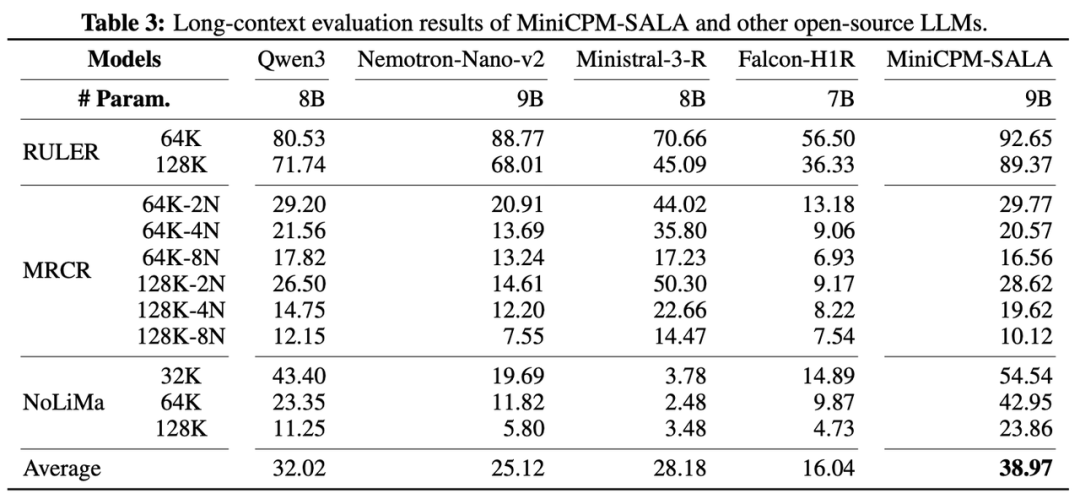

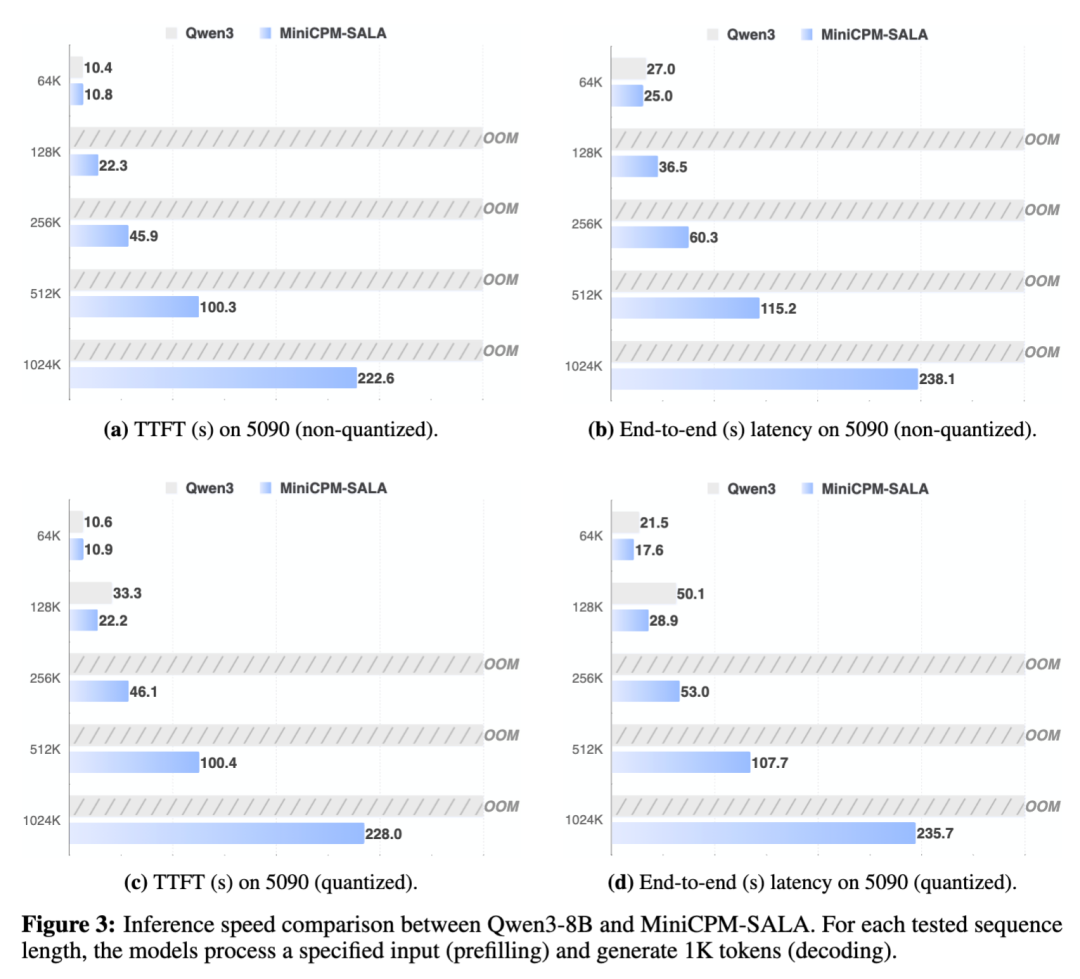

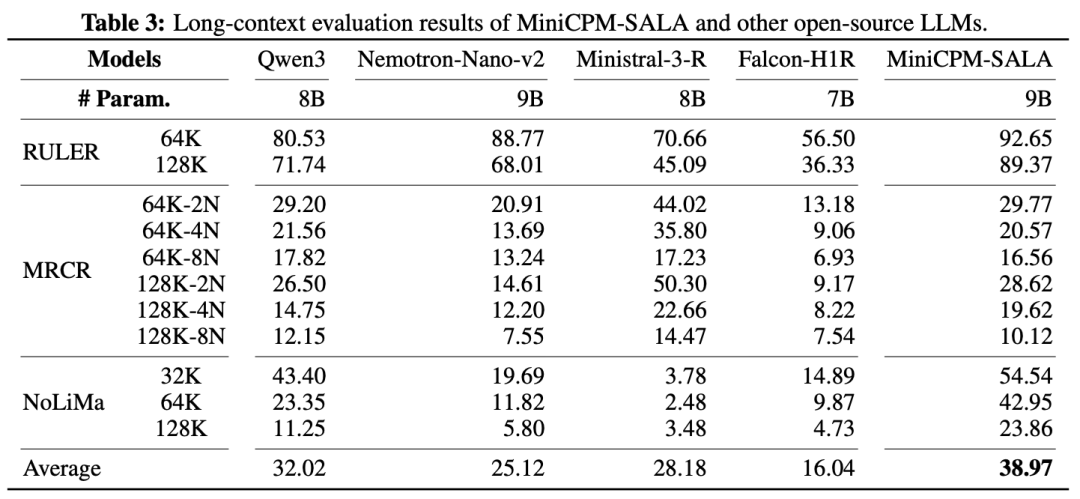

长上下文能力测试:

超长序列能力测试:

上述结果表明,MiniCPM-SALA在不损害短上下文能力的前提下,显著提升了长文本处理能力,并具备优异的长度外推能力。

05 计算效率测试

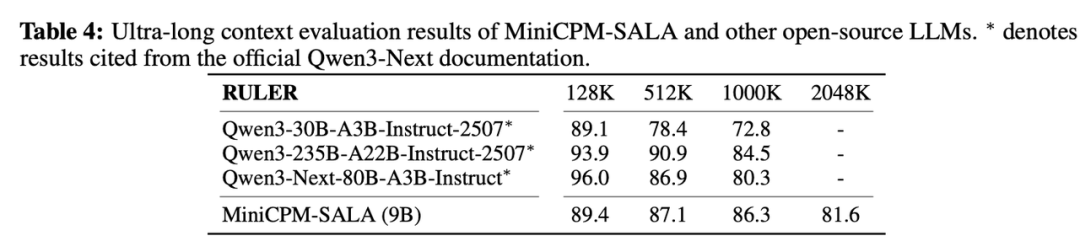

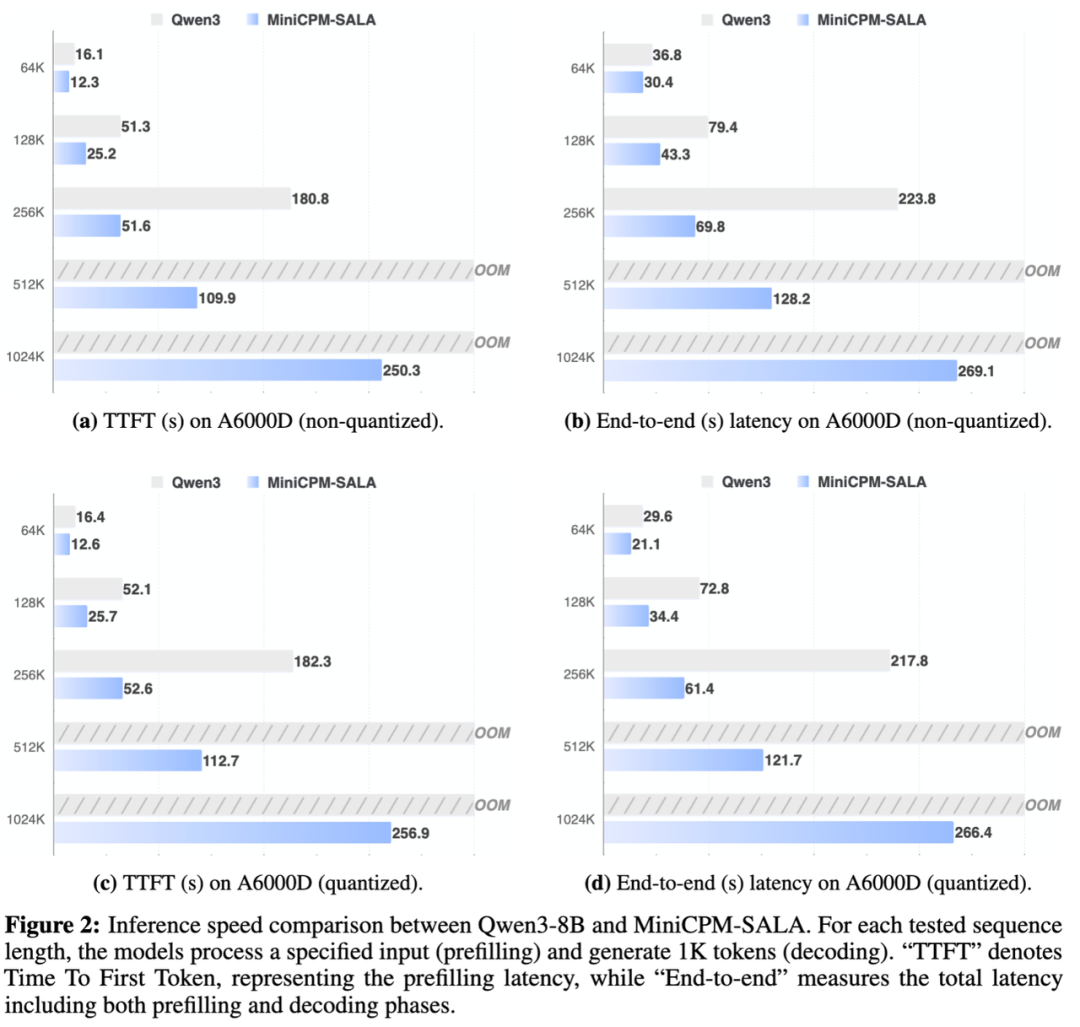

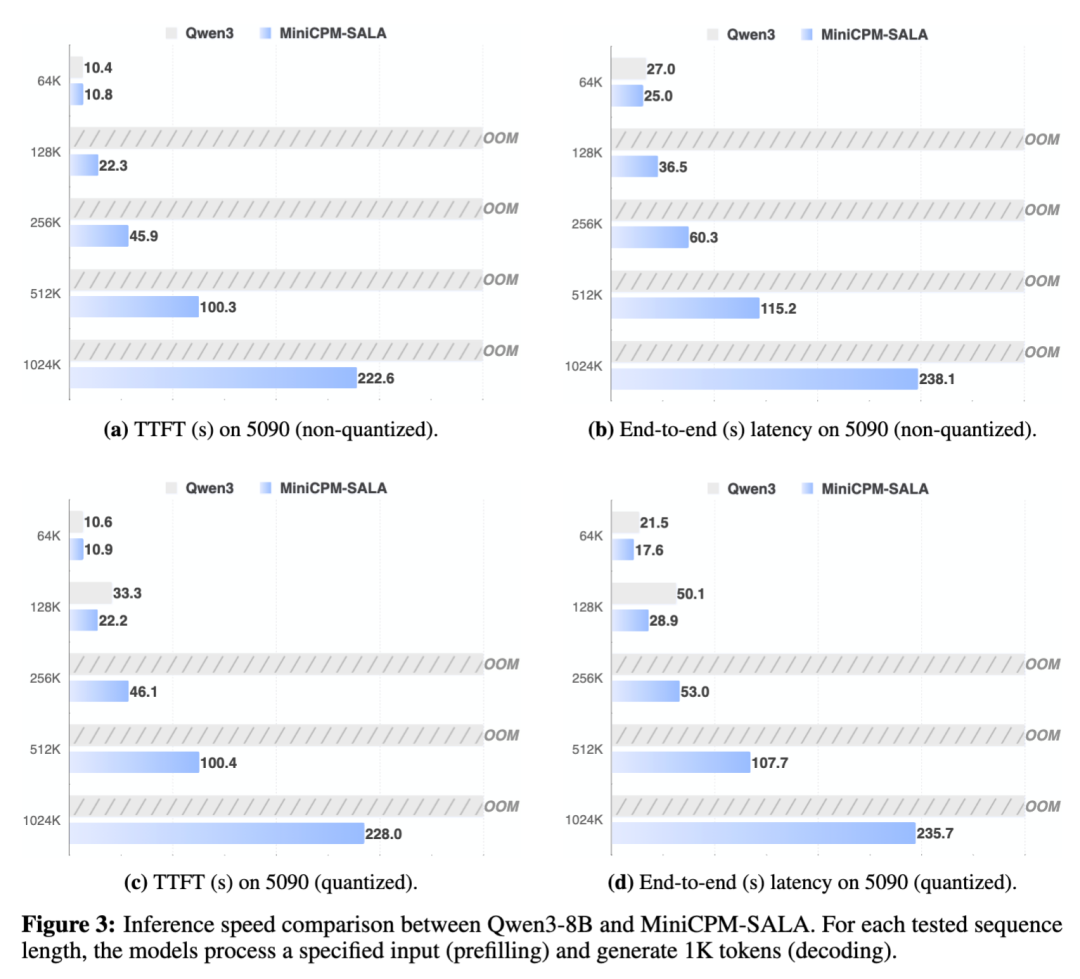

我们评估了MiniCPM-SALA和Qwen3-8B在不同硬件上的推理速度(TTFT及端到端延迟)。

在A6000D上,MiniCPM-SALA在所有序列长度下均具效率优势。在256K长度下,TTFT从Qwen3的180.8秒降至51.6秒,加速约3.5倍。当Qwen3在512K/1024K遭遇OOM时,MiniCPM-SALA仍可稳定处理。

在显存有限的RTX 5090上,优势更为明显。Qwen3在非量化128K、量化256K时即触发OOM,而MiniCPM-SALA可成功扩展至1024K词元,使得在消费级GPU上处理百万词元成为可能。

06 结论

整体而言,通过融合稀疏与线性注意力构建的SALA混合架构,在模型能力与长上下文处理效率之间实现了出色平衡。该架构及相关开源项目的实践表明,稀疏‑线性混合方向是解决大模型长上下文问题的实效技术路径之一。欲了解更多实现细节与实验数据,可查阅完整的技术报告。