随着GPU集群规模向百卡甚至千卡演进,互连技术正经历着从“电”到“光”的深刻变革。在这一进程中,NPO(Near-Packaged Optics,近封装光学)作为连接传统可插拔模块与未来CPO(Co-Packaged Optics,共封装光学)形态的关键桥梁,正在重塑高性能计算网络的物理层基础。近期,阿里云宣布成功点亮行业内首个基于OIF标准封装的3.2T NPO光模块(相关报道),这不仅是单点技术的突破,更是全光Scale-Up互联迈向工程化落地的一个重要里程碑。

NPO的定位与全景对比

概念解析:什么是NPO?

NPO是一种介于传统前面板可插拔光模块与CPO之间的光互连形态。它的核心设计思想,是将光引擎(Optical Engine, OE)从交换机或服务器的前面板,移动到主ASIC芯片附近的主板基板(Substrate)或高密度PCB上。

与CPO将光引擎直接与ASIC裸片封装在同一基板上不同,NPO保持了光引擎与ASIC的物理分离,二者通过极短的高速PCB走线进行电气连接。这种“物理紧邻但电气解耦”的架构,既大幅缩短了电信号传输距离,降低了损耗和信号完整性挑战,又保留了光引擎作为独立组件进行制造、测试和更换的灵活性。

横向全景对比:LPO vs. NPO vs. CPO

在当前AI互连的技术栈中,FRO/LPO(可插拔)、NPO(近封装)和CPO(共封装)构成了三种主流的演进路径。它们在性能、工程实现与商业生态上存在着深刻的权衡。

NPO的独特优势:高性能与工程落地的“最大公约数”

在当前AI基础设施建设的时间窗口,NPO展现出了独特的战略价值。可以说,它是平衡极致性能追求与工程落地现实的最优解。

突破“密度墙”而不牺牲灵活性:随着交换芯片容量向51.2T甚至102.4T演进,传统可插拔模块面临严峻的“密度墙”。例如,使用800G OSFP模块,1U面板最多容纳32个,总带宽仅25.6T。NPO通过将光引擎下沉至主板,利用高密光纤阵列(FAU)连接面板,彻底打破了这一物理瓶颈,单层交换即可支撑512卡甚至千卡规模的Scale-Up互连。

规避CPO的“良率与维护陷阱”:CPO虽然在能效和密度上更进一步,但其“光电共封装”带来了巨大的商业风险。一旦光引擎失效,昂贵的交换芯片可能随之报废。NPO采用可拆卸的连接器设计(如LGA Socket),使得光引擎可以作为独立组件进行测试、老化和更换。这不仅保证了系统可维护性,也让光引擎和ASIC可以分别进行良率控制,大幅降低了制造和拥有成本。

开放解耦的生态位:与CPO目前主要由ASIC巨头垂直整合不同,NPO沿用了开放生态的思路。它允许终端用户选择不同的ASIC和光引擎供应商,只要符合OIF等标准接口即可互通。这种开放性对于希望避免被单一厂商锁定的云服务商而言至关重要。

综上所述,NPO并非仅仅是通向CPO的过渡技术。它在当前技术周期内,通过“线性直驱(去DSP)+ 结构解耦”,精准地满足了高性能Scale-Up网络对高带宽、低功耗、高可靠及供应链安全的迫切需求。

为何Scale-Up需要“全光”与NPO?

如果说NPO技术的崛起是底层光电工艺成熟的结果,那么将其推向舞台中央的决定性力量,则是AI大模型架构演进对互连基础设施提出的苛刻要求。在Scale-Up(节点内/机柜级扩展)领域,传统的铜互连正在逼近物理极限,一场从架构到介质的重构势在必行。

架构演进倒逼:MoE与“训推一体”的带宽饥渴

大模型的参数竞赛已进入深水区,模型架构正经历从稠密(Dense)向混合专家(MoE)的范式转变。同时,算力负载也从单一的预训练向“训推一体”演进。这一趋势对底层网络提出了两大苛刻要求:

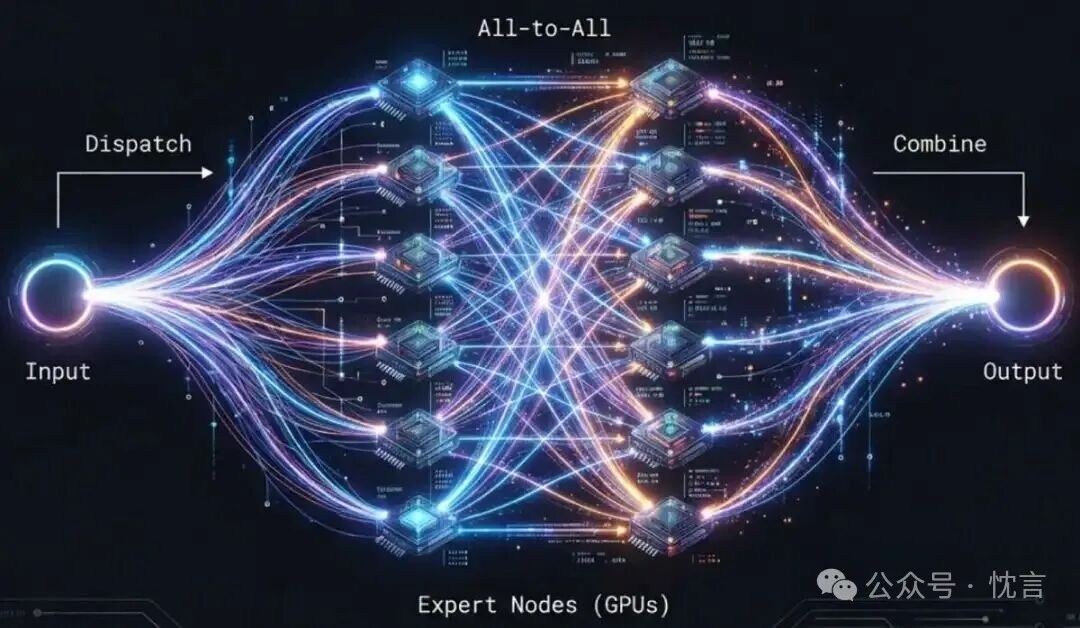

All-to-All通信的常态化:MoE架构引入了专家并行(EP)模式。在处理Token时,需要将数据分发给分布在不同GPU上的“专家”处理,处理完后再聚合。这种机制导致GPU间的All-to-All通信流量激增。为了提升计算效率,扩大EP并行域(即Scale-Up域)成为刚需,业界已出现384卡甚至576卡的超大Scale-Up域需求。

带宽密度的指数级增长:Scale-Up网络的带宽需求远高于Scale-Out。以最新架构为例,Scale-Up带宽(如NVLink)已达1.8TB/s(双向),是Scale-Out网络带宽的近9倍。

在这种极端吞吐需求下,网络不再仅仅是传输管道,而是成为了制约集群算力上限的关键瓶颈。

铜互连的物理极限:被困在“AI Rack”里的算力

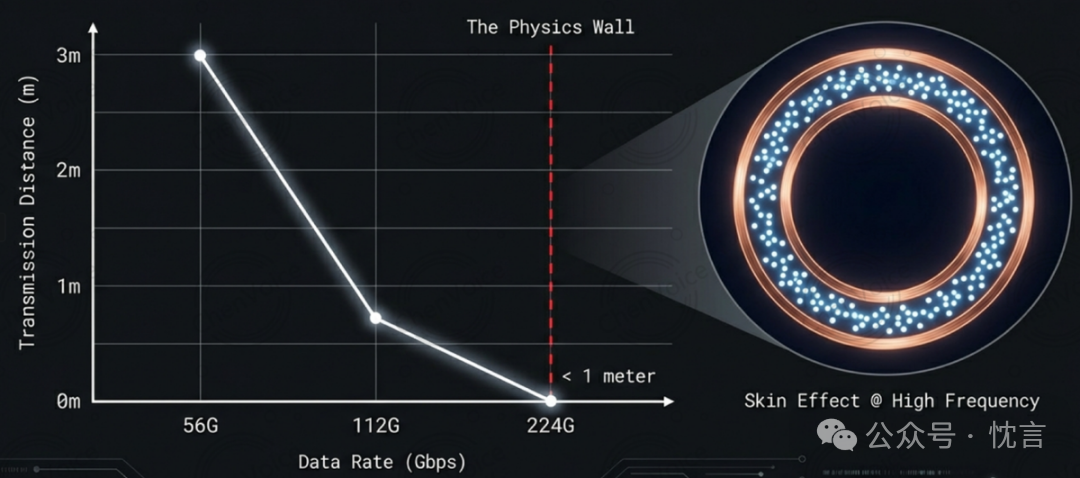

在百卡级规模下,铜互连(DAC/ACC)凭借低成本和高可靠性曾是Scale-Up的首选。然而,随着互连速率向224Gbps/lane迈进,铜缆面临着无法逾越的物理墙:

趋肤效应带来的距离归零:铜缆的传输距离随频率升高而急剧缩短。在224G时代,无源铜缆(DAC)的有效传输距离被压缩至1米以内。

“AI Rack”的工程陷阱:为了在铜缆的物理极限内实现互连,系统设计被迫走向极致的紧耦合——即AI Rack(如NVL72)。这种架构将数十个GPU和交换芯片压缩在一个机柜内,通过高密背板连接。虽然解决了互连问题,但却带来了巨大的副作用:

- 散热与供电噩梦:极高的功率密度迫使机柜必须依赖液冷,且风道设计极度受限。

- 运维黑洞:高密铜缆背板通常是一体化组件,一旦单链路故障,往往需要更换整个线缆托盘甚至停机维护,平均修复时间(MTTR)极高。

- 扩展性锁死:算力规模被物理机柜锁死,难以跨机柜构建更大的Scale-Up域。

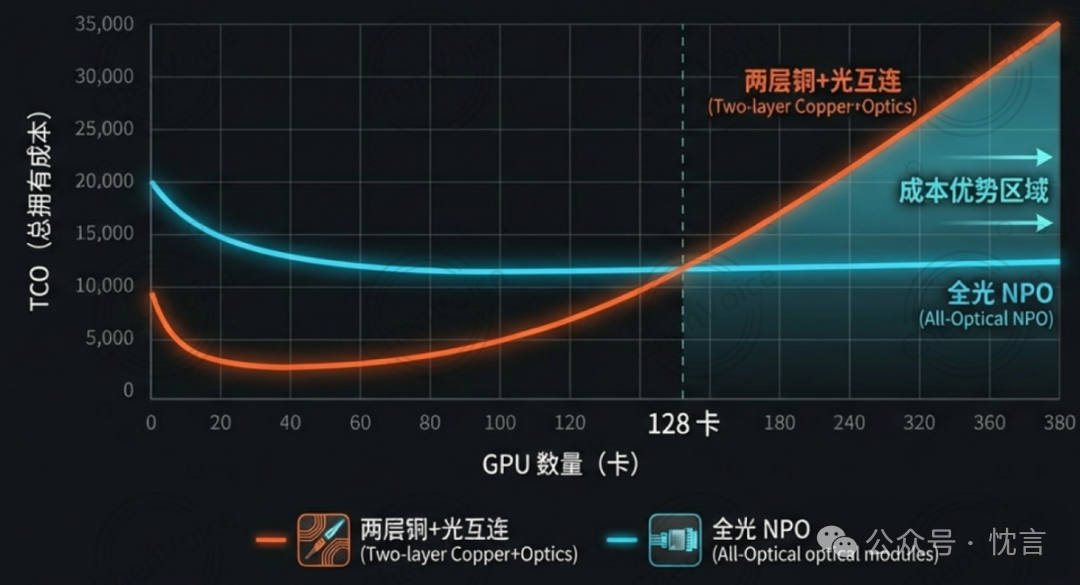

成本模型分析显示,当Scale-Up域超过128张卡时,传统的单层光互连方案在总拥有成本(TCO)上已经优于复杂的“两层互连(L1铜+L2光)”方案。

NPO的契合度:打破“AI Rack”的物理束缚

NPO的出现,恰逢其时地解开了Scale-Up网络“既要高性能,又要易部署”的死结。它通过以下三个维度,实现了对传统架构的升级:

物理层面的“解耦”:NPO带来的全光互连彻底打破了铜缆1-2米的距离限制。计算节点(xPU Box)与交换节点(Switch Box)可以分离部署,不再受制于定制化的高密背板。这意味着数据中心可以使用标准的19英寸机柜,灵活规划空间、供电和散热,实现了向标准服务器集群的回归。

突破“密度墙”:在Scale-Up场景下,单芯片交换容量正向102.4T演进。如果使用传统的可插拔模块(如OSFP),受限于前面板物理尺寸,1U空间最多仅能提供25.6T接入能力,无法发挥交换芯片的全部性能。NPO将光引擎下沉至PCB内部,通过高密光纤阵列出线,理论上可在1U空间内实现200T-300T的接入带宽,完美匹配下一代ASIC的端口基数(Radix)需求。

攻克“功耗墙”:Scale-Up网络对能效极其敏感。NPO采用线性直驱(Linear Drive)架构,去除了DSP芯片,相比传统重定时光模块(FRO),功耗降低约50%,时延降低约110ns。这对于动辄数千条链路的超节点而言,意味着兆瓦级的电力节省。

总结而言,Scale-Up网络拥抱NPO,本质上是为了在扩大算力域规模(Scale) 的同时,降低系统的工程复杂度(Complexity)。NPO提供了一种“全光解耦”的范式,让大规模MoE模型的训练不再受限于物理机柜的方寸之间。

阿里云3.2T NPO光模块的行业里程碑意义

在Scale-Up互连技术路线的十字路口,阿里云成功点亮全球首款基于OIF标准封装的3.2T NPO光模块。这一事件不仅是单点技术的突破,更是对未来AI基础设施形态的一次关键定义。它标志着全光Scale-Up网络从“实验室概念”正式迈入“工程落地”阶段,为行业提供了一套独立于芯片巨头封闭生态之外的开放解耦范式。

技术突破拆解:于方寸间见乾坤

这款3.2T NPO模块在仅22.5mm × 35.1mm(约1.5枚1元硬币大小)的微小尺寸内实现了3.2Tb/s的惊人吞吐量,其技术含金量主要体现在以下三个维度的极致平衡:

线性直驱的工程验证(No-DSP):该模块最核心的突破在于彻底去除了传统光模块中高功耗、高时延的DSP芯片,采用了线性直驱架构。在没有DSP进行信号重定时的情况下,该模块依然实现了优异的信号完整性:发送端典型TDECQ仅为1.9dB,接收端灵敏度优于-5dBm(@1E-6误码率)。这一数据证明了线性驱动方案完全能够满足严苛标准,消除了行业对“去DSP”后信号质量的顾虑。

高密封装与散热的“甜蜜点”:模块基于两颗16通道收发一体硅光芯片(SiPh)或VCSEL芯片构建,通过成熟的2D封装工艺将光子集成电路(PIC)与电子集成电路(EIC)倒装集成。这种设计将典型功耗控制在20W左右,相比同带宽的传统DSP方案降低了约50%。在散热层面,NPO的物理位置避开了ASIC的核心热点区域,配合独立的散热器设计,巧妙规避了CPO面临的极端热串扰问题。

标准化的LGA互连:不同于CPO常见的焊接固定方式,该模块采用了标准的LGA(Land Grid Array)插座连接。这一机械结构创新意义重大:它保留了光引擎的可插拔性,使得光器件的测试、良率筛选和现场更换成为可能,极大地降低了生产与运维的门槛。

对Scale-Up互联的系统级价值:解耦与重构

阿里云3.2T NPO的成功点亮,是其UPN512全光架构落地的关键一环。它将Scale-Up互连从“铜互连AI Rack”的物理束缚中解放出来,推动系统向“全光超节点”演进。

- 物理架构的彻底解耦:通过NPO实现的光互连,计算节点(xPU Box)与交换节点(Switch Box)不再需要紧紧捆绑在同一个机柜内。这种解耦使得数据中心可以沿用标准的19英寸机柜,灵活调配供电与散热资源,避免了对定制化液冷机柜和昂贵铜缆背板的过度依赖,从根本上降低了大规模集群的部署难度。

- 极致时延与稳定性的双赢:在Scale-Up场景中,时延即性能。NPO方案去除了DSP引入的数十纳秒时延,使得端到端的光互连时延能够媲美铜缆。同时,由于去除了DSP这一复杂的有源器件,并简化了信号路径,系统的理论可靠性大幅提升。实测数据显示,线性驱动方案的链路抖动概率仅为传统DSP光模块的1/3,逼近铜缆的稳定性水平。

产业链价值重构:打破围墙的锤子

在当前AI芯片巨头垂直整合日益加剧的背景下,阿里云此举对上下游产业链具有深远的战略意义。

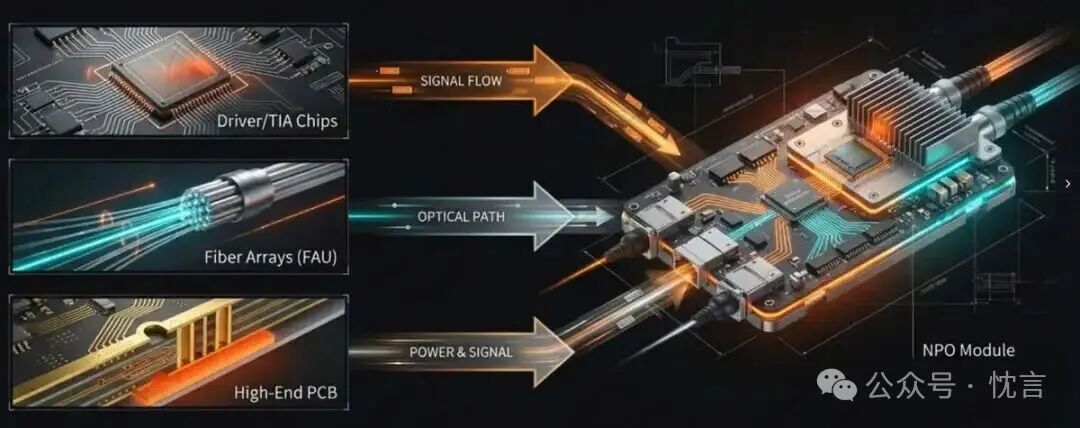

上游:激活开放生态供应链

这款NPO模块的发布,直接拉动了非ASIC绑定的光器件供应链。它向Driver/TIA电芯片厂商、高精密光纤阵列(FAU)制造商以及PCB基板厂商释放了明确的信号:线性直驱市场不仅仅在LPO,在更高密度的NPO领域同样存在巨大机遇。特别是对于国产供应链而言,这是一个在非标准私有协议之外,建立自主可控高性能互连生态的绝佳切入点。

下游:为云厂商提供“第三条道路”

对于其他云服务商和服务器厂商而言,阿里云的NPO实践提供了一个极具参考价值的范式:即无需完全依赖芯片厂商的“全家桶”,也可以构建出性能对齐甚至超越原厂方案的Scale-Up集群。这种“白盒化”的Scale-Up网络能力,将极大提升云厂商在硬件采购中的议价权。

生态:打破ASIC封闭围墙

最为关键的是,该模块基于OIF(光互连论坛) 标准封装。这与倾向于将光引擎与其交换芯片深度绑定的封闭策略形成了鲜明对比。阿里云通过推动OIF标准的工程化落地,实际上是在倡导一种“ASIC - 光引擎”解耦的开放生态,让电芯片与光芯片能够各自按照最优的节奏演进。

落地实践:首款国产4芯片交换机

一项底层光电技术的成熟,必须经过系统级工程的严苛检验。阿里云不仅成功点亮了3.2T NPO模块,更将其率先应用于新一代国产四芯片交换机中。这一落地实践,完成了从“单一器件突破”到“整机系统重构”的关键跨越。

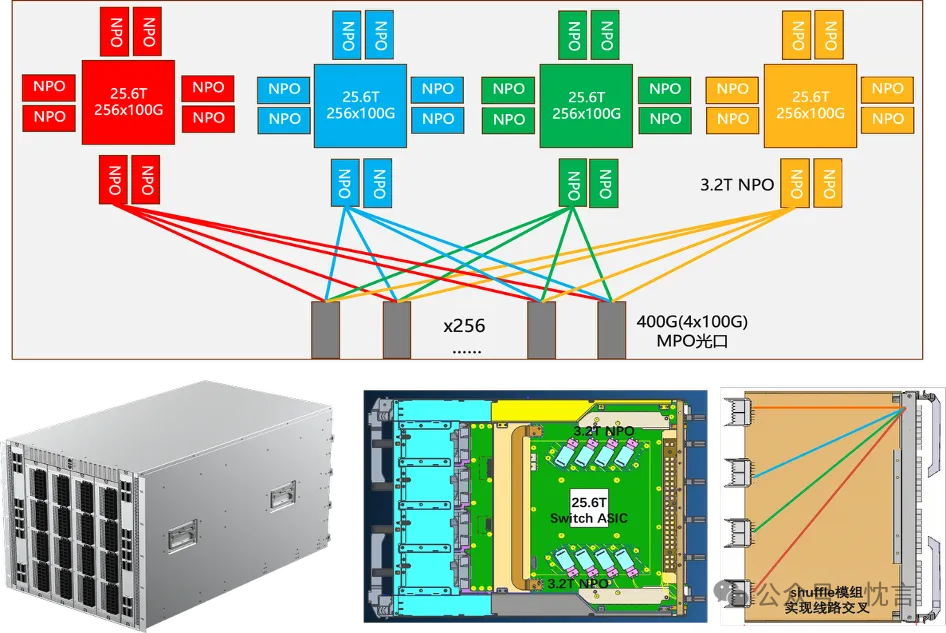

102.4T交换机的架构解构

在硬件架构上,该设备在单机内集成了4颗25.6T的国产交换芯片,实现了高达102.4T的总交换容量,并为未来向4×102.4T平台的平滑演进预留了架构空间。

其架构设计的核心亮点在于端口粒度的精细化拆分与内部重组:每颗交换芯片均以256×100G的细粒度端口模式运行。在系统内部,物理端口的多条高速通道被巧妙拆解,并交叉连接至不同的交换芯片上。这种设计的巧妙之处在于,它最大化了单芯片的端口基数利用率,极大提升了Scale-Up组网的规模上限与拓扑灵活性。同时,该设备对外依然以400G/800G等主流端口形态交付,完美兼容现有机房的MPO光纤布线体系。

软硬协同与工程实现的三大突破

在一个有限的机箱空间内,驾驭上百T的交换吞吐与成百上千条微米级光纤,其工程难度极高。阿里云通过软硬协同与系统级的互连设计,成功化解了这一挑战,实现了三大工程突破:

- 极致的电通道压缩(NPO下沉布局):NPO模块被紧贴着交换芯片部署,在距离ASIC最近的“芯片侧”直接完成电-光转换。这一布局大幅缩短了高速电信号在PCB上的走线距离,从物理根源上抑制了高频信号的插入损耗。

- 创新的光交叉模组(Shuffle Box赋能):面对内部海量的光信号,系统在前部集成了一个光交叉(Shuffle)模组。光信号从NPO引擎发出后,经过该模组的物理规整与线路交叉汇聚,最终整齐地输出至前面板。这种设计既保证了内部光信号的高效互连,又兼顾了外部线缆连接的标准化。

- 面向高可用的模块化解耦(运维友好设计):在交换模组与前部的Shuffle模组之间,创新性地采用了快插式光连接设计。这意味着核心模组支持系统级的热插拔与独立更换,将潜在的硬件故障影响范围严格收敛至最小的物理单元。它显著提升了现场故障恢复效率与系统的整体可用性。

目前,该款国产四芯片交换机已成功完成整机上电与核心功能验证,NPO端口顺利建立了稳定的通信链路,项目已正式迈入长期可靠性测试阶段。这不仅验证了NPO技术在大规模、高密度系统中的工程可行性,更为未来全光Scale-Up网络的规模化落地提供了一套经过验证的硬件级范式。

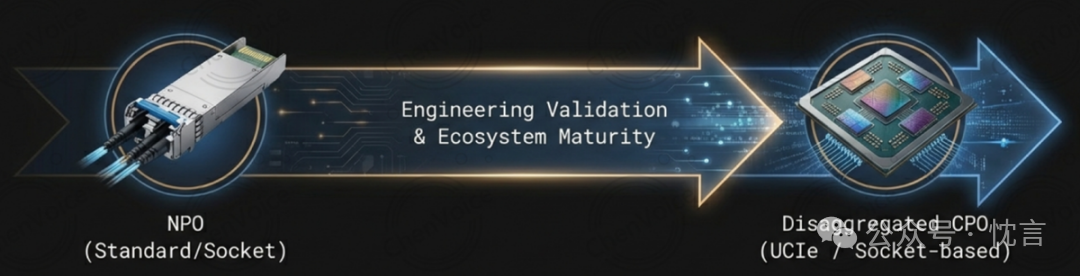

远景展望:CPO的解耦之路与未来

阿里云3.2T NPO的成功,实质上是产业链对“后摩尔时代”互连形态的一次重要实践。它证明了在追求极致性能的道路上,未必只有“垂直整合”这一条路。当我们把目光投向更远的未来,CPO(共封装光学)作为物理层面的终极形态,其大规模普及仍需跨越商业与技术的双重“围城”。

CPO的“围城”困局:物理极优与商业极难

从物理学第一性原理来看,CPO无疑是Scale-Up互连的终局。通过将光引擎直接集成在ASIC基板甚至中介层上,CPO能将互连能效压至极低,并实现数量级的带宽密度提升。然而,这种“物理上的完美”目前正受困于“商业上的封闭”。

- ASIC厂商的强绑定(Vendor Lock-in):目前的CPO路线图主要由Switch ASIC巨头主导。在这些方案中,光引擎变成了ASIC厂商交付的“黑盒”系统的一部分。对于下游云厂商而言,这意味着失去了对光模块供应链的选择权和议价权。

- 维护成本的“核爆级”风险:在非Socket式的CPO设计中,光引擎与昂贵的高端交换芯片是“生死与共”的。一旦某个光通道失效,可能导致整个交换芯片报废。这种“一损俱损”的维护风险,是追求高可用性的数据中心运营商所难以接受的。

- 封闭生态的良率挑战:CPO要求光芯片与电芯片在封装级进行集成。这意味着光器件的良率将直接拉低最终成品的良率。在缺乏开放测试标准和分层责任界定的情况下,这种制造复杂性成为了量产的拦路虎。

解耦的可能性与路径:寻找“中间态”

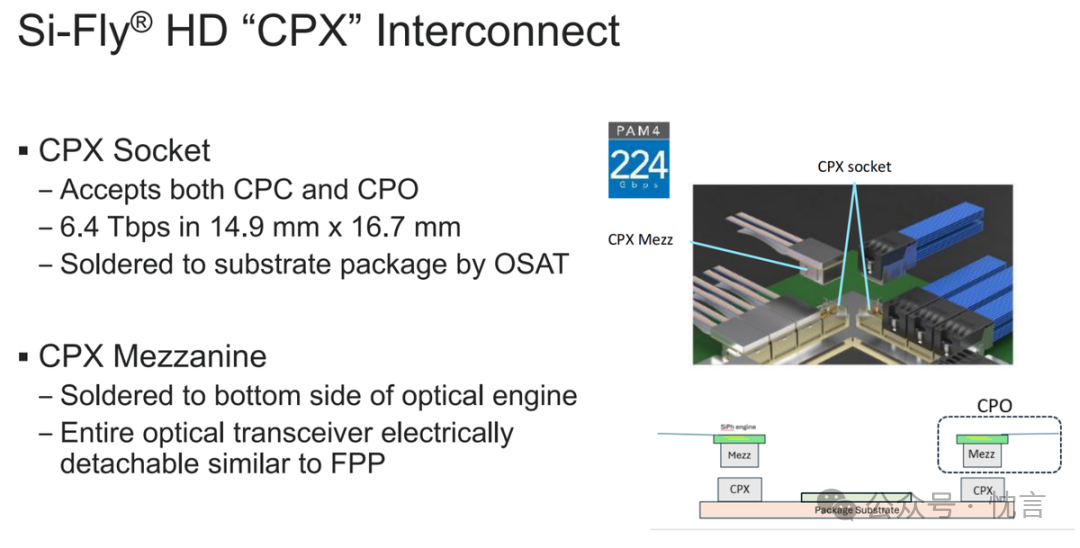

为了打破上述困局,行业正在探索CPO的“解耦”路径,试图在保留CPO性能优势的同时,引入类似NPO的灵活性。

- 接口的标准化(电气解耦):类似于Chiplet领域的UCIe标准,光互连领域也在呼唤统一的接口标准。如果有类似UCIe的标准协议能被广泛采纳,光引擎就可以成为标准化的“光Chiplet”,由第三方厂商制造,并在封装阶段与不同厂商的ASIC集成。

- 光电异构集成的新形态(物理分层):除了传统的基板集成,一些初创公司正在尝试更激进的解耦——光中介层(Optical Interposer)。这种方案将光波导和无源器件“埋”在底层基板中,而计算芯片和有源光芯片堆叠在上方。这种3D堆叠结构使得计算Die和光学Die可以在制造和测试上实现一定程度的解耦。

- 可插拔Socket式CPO设计:行业正在探讨类似CPU插槽的方案,将光引擎设计成可以压合或插拔的小型载板,放置在ASIC封装边缘。这种设计既保留了极短的电走线优势,又实现了光组件的现场可维修性。

终局思考:分叉的未来

阿里云3.2T NPO的点亮,向行业揭示了Scale-Up网络演进的“双轨制”未来:

- “交钥匙”的封闭高性能路线:以某些原厂系统为代表,通过极致的CPO/LPO垂直整合,提供开箱即用的最高性能,服务于对成本不敏感、追求快速上市的顶级AI训练集群。

- “开放解耦”的白盒化路线:以阿里云UPN512为代表,通过NPO和未来的标准化CPO技术,构建基于开放标准的生态。这条路线更符合大规模云厂商对供应链安全、成本控制和运维灵活性的核心诉求。

NPO绝非昙花一现的过渡技术。在CPO彻底解决可维护性(如实现标准化Socket)和互操作性(如OIF标准成熟)之前,NPO将在很长一段时间内,作为Scale-Up网络中“光进铜退”的最佳着陆点,支撑起百E级参数大模型的算力底座。而阿里云的这次突破,正是为这套开放生态投下的关键信任票。对于关注人工智能基础设施发展的技术人而言,理解这些底层互连技术的演进,是把握未来算力格局变化的重要视角。