加拿大芯片初创公司 Taalas 近日宣布完成1.69亿美元的新一轮融资,使其总融资额超过2.19亿美元。与此同时,这家位于多伦多的公司正式走出“隐身模式”,向外界展示了其一项颠覆性的核心技术:将大型语言模型直接“蚀刻”到定制化的硅芯片电路中。

传统上,无论使用GPU还是其他专用AI加速器,运行AI模型都需要先将模型参数(权重)从存储设备加载到内存中,计算单元再反复从内存中读取数据进行运算。这个过程会产生大量的数据搬运开销和功耗。

Taalas 的做法则截然不同。他们通过定制化的芯片架构,将特定模型(如 Llama 3.1 8B)的权重和计算逻辑永久性地固化在芯片的晶体管与金属连线中。简单来说,芯片通电后,其电路结构本身就是模型。数据流沿着预设的固定路径行进,无需反复存取权重,从而实现了极高的计算效率和能效比。

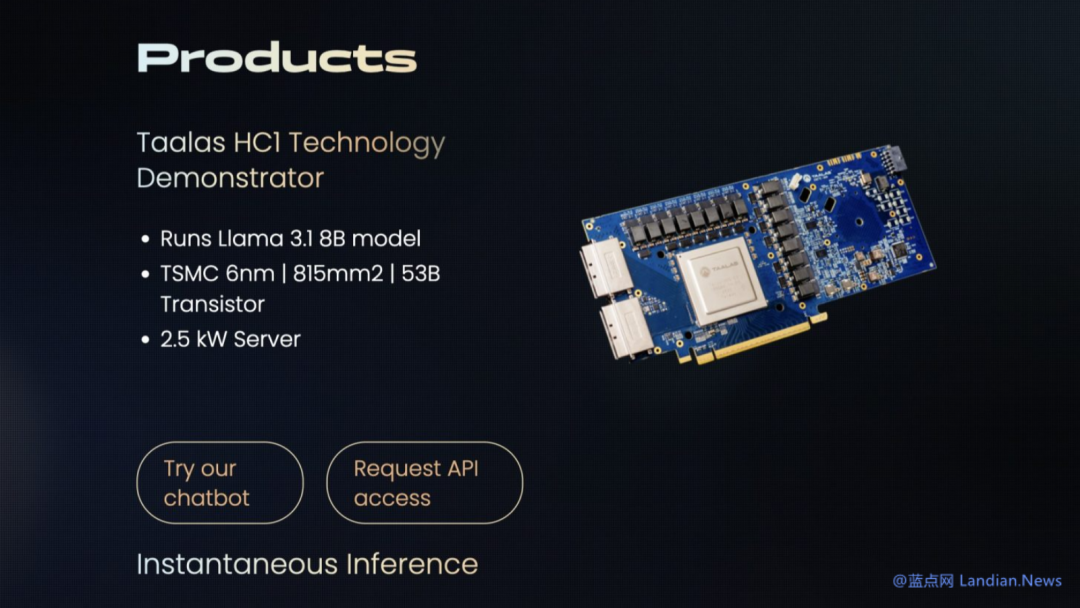

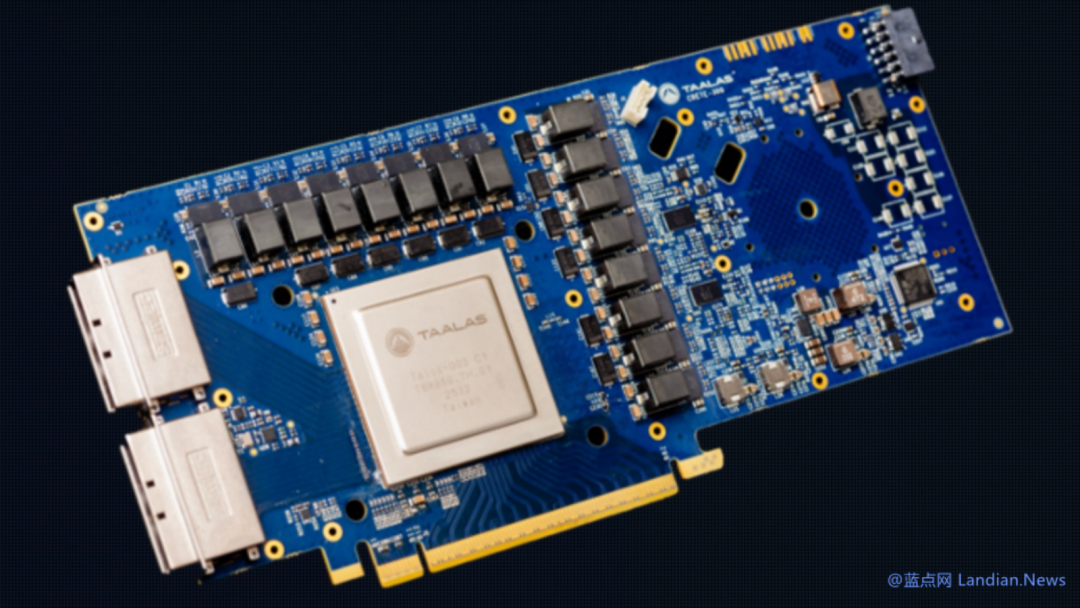

其首款演示芯片 Taalas HC1 在单用户推理任务中,速度达到了惊人的 每秒17,000个以上Tokens(Tokens/s)。

一个便于理解的比喻

- 传统GPU/加速器:模型像是放在书架(内存)上的书籍。每次计算,芯片(读者)都需要走到书架前,取出书(读取权重),进行计算思考,然后再把书放回去。这个过程耗时耗力。

- Taalas HC1芯片:书籍的内容被直接雕刻在了房间的墙壁(芯片电路)上。芯片(读者)只需走进房间,目光所及之处即是知识,计算(理解)瞬间完成,省去了所有取书放书的步骤。

这种“芯片即模型”的思路,让人联想到上世纪90年代的门阵列(Gate Array)技术。Taalas的创新之处在于,他们利用现代工艺和设计方法,将这种“硬连线”逻辑应用于处理大型语言模型中参数稀疏性和量化带来的复杂性。

技术原理:如何将模型“刻”进硅里?

这项技术的核心基于结构化ASIC和定制掩膜工艺。其实现路径可以概括为以下几个步骤:

- 预制芯片基底:Taalas首先设计并制造了一个接近完成的通用芯片基底。这个基底已经包含了约100层的晶体管和金属互联结构,完成了大部分通用逻辑和存储电路。

- 保留定制层:最后两层金属层(掩膜)被预留出来,用于实现最终的功能定制。

- 模型写入:通过设计最后两层金属层的连接图案,将目标模型(如Llama 3.1 8B)的权重值和特定的数据流路径永久性地“编写”进芯片。这类似于PCB设计中,最后两层铜箔的走线决定了电路板的具体功能。

- 硬编码计算:权重值并非存储于可读写的内存中,而是像ROM(只读存储器)一样,通过晶体管是否导通的物理状态来硬编码。计算时,输入数据流过这些固化好权重的电路,乘法和加法运算直接在电流流经特定路径时完成,无需传统的“读取-计算-写回”流程。

- 灵活性的保留:为了处理模型推理中的动态部分(如不断变化的上下文),芯片中仍集成了小容量的SRAM,专门用于缓存当前的对话上下文。

(图中可见芯片核心区域,周围并未配备传统形式的大容量内存模块)

优势与显而易见的挑战

优势:

- 极致性能与能效:消除了权重访问的瓶颈,实现超低延迟和高吞吐量推理。

- 成本潜力:一旦模型确定,针对该模型优化的专用芯片在大规模生产时可能具备成本优势。

挑战(劣势):

- 模型不可变:这是最根本的制约。一颗蚀刻了Llama 3.1 8B的芯片,将永远只能运行这个特定版本的模型,无法通过软件升级来适配Llama 3.2、GPT-4或任何新兴模型。

- 迭代成本与周期:要更换模型,就必须重新设计掩膜并流片生产新的芯片。尽管Taalas表示其利用最后两层金属定制的流程可将周期缩短至约2个月,但这相比软件更新仍显漫长,且会产生新的硬件成本。

- 适用场景:该技术更适合模型架构稳定、需要极致性能且对成本不敏感的场景,或在AI模型发展进入平台期后,针对主流固化模型进行部署。

未来展望

Taalas的这项技术为AI计算提供了一条另辟蹊径的思路。在当前AI模型快速迭代的阶段,其适用性可能受到限制。然而,如果未来出现某些“统治性”的稳定模型架构,或者在某些对延迟、功耗有极端要求且功能固定的边缘计算场景中,“模型即芯片”的方案可能会找到其独特的生态位。

随着芯片制程工艺的持续进步,未来在单颗芯片上蚀刻参数量更大(如800亿参数)的模型也将成为可能。这引发了业界对于计算范式的重新思考:在软硬件协同设计的道路上,我们是否正在见证一次从“通用计算”向“功能固化”的螺旋式回归?

你对这种硬件固化的AI计算方式有何看法?是未来方向还是特定场景的补充?欢迎在云栈社区与更多开发者交流探讨。 |