本帖最后由 异或Lambda 于 2026-2-24 21:34 编辑

在很长一段时间里,大模型圈子流行一种“参数崇拜”:参数越多越好,模型越大越强。

但对于真正要在生产环境部署业务的工程师来说,超大模型简直是噩梦——显存爆炸、推理延迟高、电费惊人。

刚刚发布的 Qwen3.5-397B-A17B,给出了一个极其性感的工程解法:平时博学多才(397B),干活时精打细算(17B)。

这就好比你雇了一个拥有 4000 亿脑细胞的超级天才,但他每回答一个问题,只动用其中 4% 最关键的脑细胞。

一、 拒绝“虚胖”:MoE 的极致效率

Qwen3.5 的核心架构是 混合专家模型(MoE)。

传统的稠密模型(Dense)是“全脑运转”,不管你是问“1+1等于几”还是“量子力学”,它所有的参数都要过一遍。这不仅慢,而且浪费。

Qwen3.5 拥有 397B 的总参数量(Total Params),这保证了它知识库的广度,足以媲美 GPT-4 级别的旗舰模型。但在推理时,通过路由机制,它仅激活 17B 的参数(Active Params)。

这意味着什么?

- 显存占用:你需要存下 397B 的权重(硬盘/显存需求依然大)。

- 计算速度:你只需要付出 17B 模型的计算量。

结合最新的 Gated DeltaNet 技术,它的推理解码速度比上一代 Qwen3-Max 快了 8.6 到 19 倍。这种架构的演进,正是 人工智能 领域从“暴力美学”转向“精细化运作”的标志。

二、 原生多模态:眼睛和脑子长在一起

以前做多模态(VLM),通常是“外挂”一个视觉编码器(Vision Encoder),像给盲人配个导盲犬。

Qwen3.5 采用了 原生多模态(Native Multimodal) 设计。它在预训练阶段就进行了早期融合,文本和图像在它看来都是 Token。

这种“原生”带来的优势是理解力的质变。在处理复杂的图表分析、视频理解任务时,它不再是“看图说话”,而是真正理解了视觉信息背后的逻辑。

三、 生产力落地:Agent 与长文档

在 云栈社区 的开发者讨论( https://yunpan.plus/f/80 )中,大家最头疼的往往不是模型不够聪明,而是模型“太慢”或者“记性太差”。

Qwen3.5 精准解决了这两个痛点:

- Agent 响应速度:得益于 17B 的激活参数,它在进行工具调用(Function Calling)时极其敏捷,非常适合构建实时交互的智能体。

- 1M Token 上下文:原生支持 262K,最高扩展至 1M。你可以把整个项目的代码库、或者几百页的财报丢进去,配合它的 Thinking Mode(思维链),让它进行深度的逻辑推理。

对于正在构建复杂系统的团队,这种能力可以无缝集成到现有的 后端 & 架构 中,替代原本昂贵的 API 调用。

四、 异或Lambda 的建议

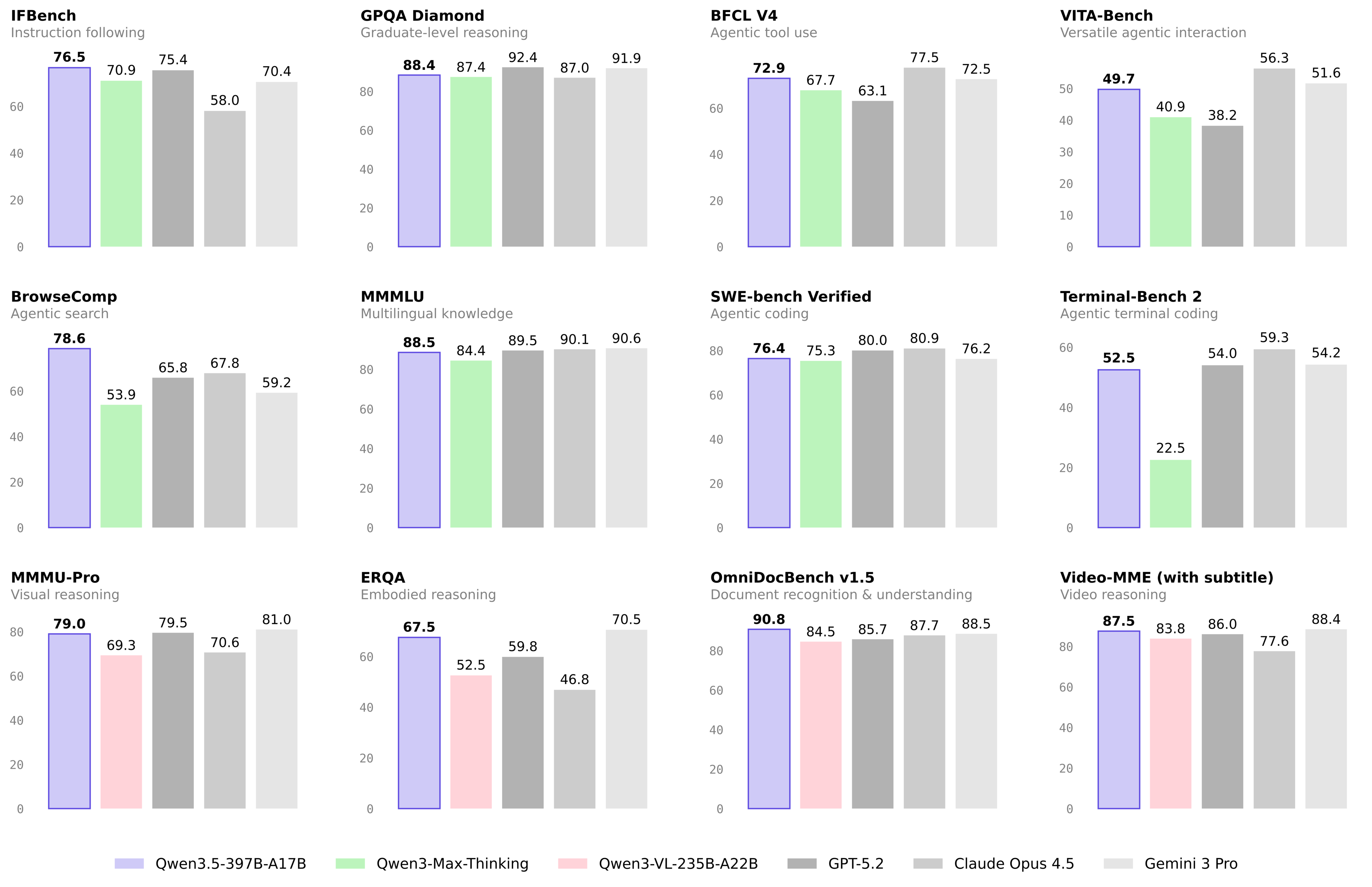

Qwen3.5-397B 是一个分水岭。它证明了开源模型不再只是“陪跑”,而是在架构效率上开始教闭源模型“做人”。

如果你手头有足够的显存(或者使用量化版本),强烈建议在本地或私有云部署尝试。它可能是目前市面上聪明程度和响应速度平衡得最好的模型,没有之一。

技术在变,但核心逻辑不变:解放生产力,永远是第一原动力。

关注《异或Lambda》,解码未来生产力。

标签: #Qwen3.5 #MoE架构 #开源模型 #云栈社区 #LLM #多模态 #后端开发 #技术解析 |