Bark 完全解析:Suno 开源的生成式文本到音频模型

当大多数文本到语音模型还停留在“朗读文字”的阶段时,一个能生成笑声、音乐和叹息的开源项目出现了。Suno AI 开源的 Bark 彻底打破了这一界限,它是一个基于 Transformer 的生成式音频模型,不仅能生成高度逼真的多语言语音,还能创作音乐、添加背景噪音、模拟非语言声音,让 AI 的输出真正富有表现力。

Bark 在 GitHub 上已获得 39k Stars,采用 MIT 许可证,完全开源且可商用。它的出现标志着文本到音频生成从“合成”走向了“创造”的新阶段。

核心功能:语音、音乐、音效三位一体

多语言语音生成

Bark 内置支持 13 种语言(包括中文、英语、德语、法语、日语、韩语等),并可根据输入文本自动判断语言。更令人惊喜的是,它还能处理混合语言输入,生成带有对应语言口音的语音。

音乐与音效生成

Bark 并不区分“语音”和“音乐”——只要输入文本,它就能生成任何类型的音频。在歌词周围加上音乐符号(♪),就能生成歌曲;描述一个场景,就能生成相应的环境音(如雨声、人群嘈杂声)。

非语言表达

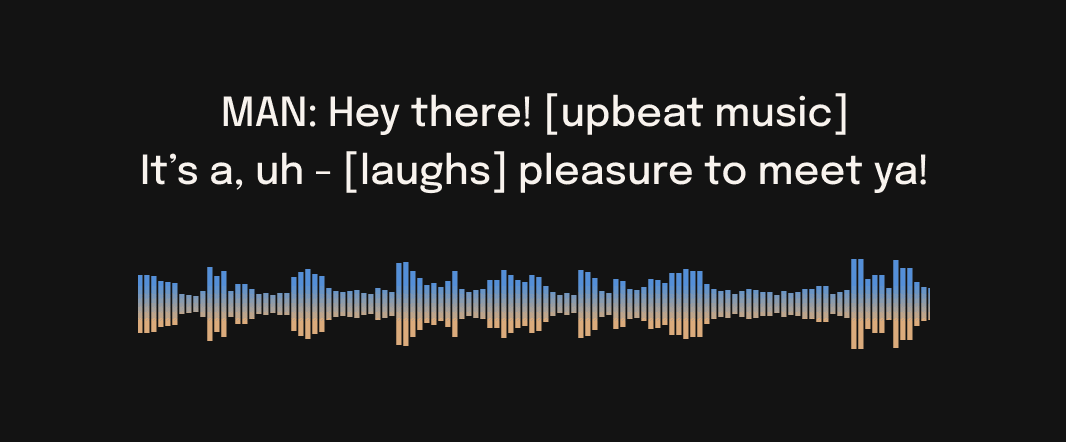

通过特殊的提示词(如 [laughs]、[sighs]、[music]),Bark 可以生成笑声、叹息、清嗓子等人类特有的非语言声音,让对话 AI 更加真实自然。

声音预设与个性化

Bark 提供 100+ 种声音预设,涵盖不同性别、年龄、情绪和口音。用户可以在代码中选择预设,或者浏览社区分享的声音库。虽然目前不支持声音克隆,但预设足以覆盖绝大多数场景。

长音频生成

Bark 的单次生成长度受限于模型上下文(约 13-14 秒),但官方提供了长音频生成的 notebook 示例,通过分段生成和拼接,可以产出任意长度的音频。

使用方法:快速生成你的第一个音频

安装

安装时需注意,不要直接使用 pip install bark,那会指向另一个不相关的包。正确的安装命令如下:

pip install git+https://github.com/suno-ai/bark.git

Python 基础示例

from bark import SAMPLE_RATE, generate_audio, preload_models

from scipy.io.wavfile import write as write_wav

# 预加载模型(首次运行会自动下载)

preload_models()

# 生成带有笑声的语音

text_prompt = """

Hello, my name is Suno. And, uh — and I like pizza. [laughs]

"""

audio_array = generate_audio(text_prompt)

# 保存为 WAV 文件

write_wav(“bark_generation.wav”, SAMPLE_RATE, audio_array)

Bark 也已集成到 Hugging Face Transformers 库,安装最新版即可使用:

from transformers import AutoProcessor, BarkModel

processor = AutoProcessor.from_pretrained(“suno/bark”)

model = BarkModel.from_pretrained(“suno/bark”)

inputs = processor(“Hello, my dog is cute”, voice_preset=“v2/en_speaker_6”)

audio_array = model.generate(**inputs)

命令行使用

对于喜欢命令行操作的用户,Bark 也提供了便捷的方式:

python -m bark --text “Hello, my name is Suno.” --output_filename “hello.wav”

硬件与性能要求

在部署和使用 Bark 前,你需要了解其对硬件的要求:

-

VRAM 要求:完整模型运行时约需 12GB 显存。但项目贴心地提供了降低需求的方案,通过设置环境变量即可:

import os

os.environ[“SUNO_OFFLOAD_CPU”] = “True”

os.environ[“SUNO_USE_SMALL_MODELS”] = “True”

这样可以在 2GB 显存的 GPU 甚至 CPU 上运行,但推理速度会相应变慢。

-

推理速度:在企业级 GPU 上可以做到接近实时生成,而在普通 CPU 上则可能需要数倍的时间。

优势对比:Bark 与传统 TTS

那么,这个生成式音频模型和传统的文本转语音技术到底有什么不同呢?下面这个对比表格或许能给你直观的感受。

| 对比维度 |

Bark(生成式音频模型) |

传统 TTS(如 Tacotron、FastSpeech) |

| 输出类型 |

语音 + 音乐 + 音效 |

仅语音 |

| 非语言表达 |

✅ 支持笑声、叹息等 |

❌ 通常不支持 |

| 语言支持 |

13 种语言,可混合 |

通常单一语言 |

| 声音预设 |

100+ 种,社区共享 |

通常只有几种 |

| 克隆支持 |

❌ 不支持声音克隆 |

✅ 部分支持 |

| 生成方式 |

直接生成音频,无需中间表示 |

生成声学特征,再经声码器 |

| 自由度 |

高(可偏离脚本) |

低(严格遵循脚本) |

| 商用许可 |

✅ MIT 许可证 |

视具体模型而定 |

Bark 的最大优势在于其生成性:它不是机械地朗读,而是像人类一样“表演”,甚至能即兴发挥。这使其非常适合游戏角色、虚拟主播、创意内容生成等需要丰富表现力的场景。

总结:让 AI 真正“声”动起来

Bark 的开源不仅为开发者提供了一个强大的音频生成工具,更重要的是它展示了生成式模型在音频领域的无限可能。通过简单的文本提示,就能创造出情感丰富的语音、动听的音乐片段,甚至是复杂的音效场景。其宽松的 MIT 许可证更是扫清了商业应用的障碍。

随着社区的不断贡献,Bark 的潜力将进一步释放。无论是想为你的应用添加更生动的语音交互,还是探索创意音频生成,都可以尝试一下这个有趣的项目。开发过程中如果遇到问题,欢迎来云栈社区的 AI 相关板块交流讨论。

项目地址:https://github.com/suno-ai/bark