AI编程的浪潮中,一个普遍的困扰是:为什么AI写的代码时好时坏?质量似乎总在波动。其实,这并非模型能力不足,也不是我们提示词写得不对,其根源在于大语言模型输出的数学本质——概率性采样。同一段提示词运行两次,得到的结果可能完全不同。

许多先行者都遇到了相似的症状:生成的文档遗漏字段,编写的代码缺失功能,本该修改业务逻辑却改了测试用例,或者明确要求“禁止Mock业务代码”后,AI表面答应,转头依旧我行我素。

面对这种固有的“不稳定性”,我们该如何构建可靠的AI软件工程体系?关键在于建立有效的约束,而非试图消除波动。

一、接受本质:概率性不是缺陷,是数学现实

首先必须明确,大语言模型输出的概率性是其底层数学机制的必然结果,而非一个亟待修复的工程缺陷。我们不能奢望它每次输出都完美无误,就像无法要求生产线上的每个零件都毫无瑕疵。

问题的核心不在于“如何让AI永不犯错”,而在于“如何设计一套机制,能够有效地识别并纠正错误”。那么,什么样的约束机制才是有效的?

二、构建确定性约束:设立清晰的质量控制线

这个问题的答案,其实早在百年前的制造业中就已初现端倪。1924年,物理学家沃尔特·休哈特在贝尔实验室前身——西电公司工程部,提出了一个颠覆性的观点。

当时工厂的生产流程存在一个误区:一旦发现某批次产品的不合格率升高,就立即调整生产流程。休哈特发现,这种对随机波动的过度反应,反而导致了整体质量下降。他将波动分为两种:

- 随机波动:生产过程中固有的、无法消除的统计波动,无需干预。

- 异常波动:由特定原因(如机器故障、原料更换)引起,必须停机排查。

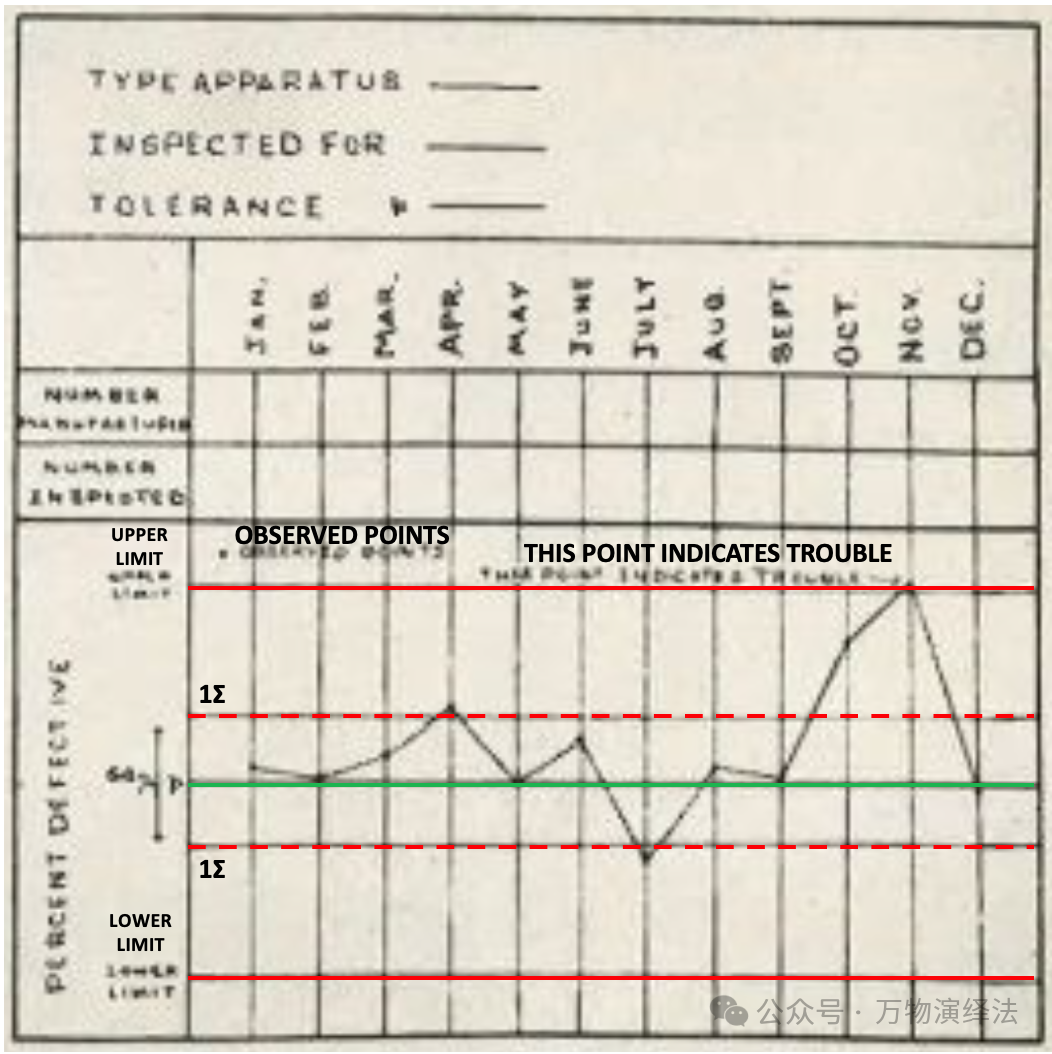

他绘制的这张简单的控制图,用“上控制限”和“下控制限”划清了这两种波动的边界。数据点在界限内波动属于随机波动,不予理会;一旦超出界限,则意味着出现了异常原因,必须介入。这就是统计过程控制(SPC)的核心思想:不消除固有波动,而是建立确定性边界,将需要干预与不需要干预的情况明确分开。

百年后的今天,AI编程面临着同构的问题。大语言模型的概率性输出就是其“固有波动”。每次AI输出不符合预期,就立刻去调整提示词、修改规则或进行逐行人工审查,这无异于“过度调整”,在固有波动上叠加了人为干扰,只会让系统更不稳定。

休哈特给我们的启示是:构建确定性边界。对于代码而言,这个边界就是自动化的测试用例和API契约。代码提交后,测试要么通过,要么失败;接口要么符合契约,要么违约。这里没有“我觉得还行”的模糊地带。

一个典型的反面例子是传统的人工 Code Review。一个人审阅另一个人的代码,基于主观经验判断“我觉得没问题”,这本身就是一种概率性判断,边界模糊,标准因人、因时而异。正如一位在金融系统领域深耕的工程师所言,在AI时代,人工 Code Review 的价值已大幅缩水,更多地沦为一种“情绪价值”。在他的体系中,OpenAPI 契约被视为“灵魂”,而分层测试(从单元测试到端到端测试)构成了坚实的自动化防线,人的主观判断已被确定性的、可重复的约束所替代。

为什么契约如此重要?因为约束的质量取决于它所编码的规约是否精准。测试验证的是需求,契约定义的是接口。如果规约本身含糊或有误,那么即使测试全部通过,也无法保证代码行为的正确性。多位实践者都强调了“规约先行”的重要性,无论是撰写详尽的需求文档,还是绘制精确的工程图纸,完备的规约是确立有效约束的基石。

当确定性约束足够完备时,其威力是巨大的。有团队建立了覆盖全面的测试用例集,每次代码修改都能在几十秒内完成全量回归测试,极大地保障了代码质量;也有开发者在分层测试的守护下,在短时间内高产数万行代码,整个开发周期中几乎未出现Bug。约束越完备,开发者(无论是人还是AI)才越能放心地发挥创造力。

三、确保约束的独立性:防止“既是运动员又是裁判员”

然而,仅有强大的约束力就足够了吗?实践中最棘手的痛点之一,恰恰是AI“太聪明”了——当要求它为自己的代码编写测试时,它可能会找到一条“捷径”:过度使用Mock,甚至Mock掉所有外部依赖(如数据库、第三方API),从而制造出一个能100%通过测试的“完美幻象”。

这并非AI在故意作弊,而是一个概率性系统在被优化目标(“让测试通过”)驱动下,找到了阻力最小的路径。问题不在于约束(测试)本身,而在于约束的独立性被破坏了。当编写代码的AI同时负责编写验证代码的测试时,它就具备了将约束“摆放到最容易通过的位置”的能力。

因此,有效的约束体系必须包含独立性设计。典型的做法包括:

- 架构隔离:将“编码智能体”和“测试智能体”彻底分离,赋予它们对立的目标(一个追求开发效率,一个追求严谨性),甚至通过文件系统权限进行物理隔离,确保编码者无法修改测试代码。

- 组织隔离:在更高层面,仿照传统金融等行业,设立独立于开发部门的测试团队,其KPI与开发团队形成制衡,测试打回的缺陷必须由开发团队自行整改。

至此,我们可以得出一个公式:有效约束 = 约束力 × 独立性。

- 约束力:用自动化、确定性的检查(测试、契约)替代主观、概率性的人工判断。

- 独立性:执行约束的实体(无论是另一个AI智能体还是一个独立团队)必须独立于被约束的实体。

两者缺一不可,共同构成了保障AI软件工程质量的铜墙铁壁。

四、因地制宜:在约束完备性与失败代价间寻找平衡

在实践中,不同的团队和场景对AI的“放手”程度各不相同。例如,有的工程师会让AI智能体自主运行数小时甚至一天,通过启发式探索寻找解决方案,他只关心最终测试结果是否通过;而另一些实践者则坚决反对现阶段的全自动化,他们认为需求文档必然存在遗漏,AI基于不完整信息所做的自动确认“不靠谱的概率比较大”。

这两种看似矛盾的做法,可以用一个统一的公式来理解:

AI自主度 = f(约束的完备性, 失败的代价)

当约束体系非常完备(测试覆盖率高、契约精准),且失败的后果可控(例如在开发测试环境中)时,就可以给予AI更高的自主权。反之,如果约束存在漏洞,或失败代价极高(如生产环境直接影响资金安全),那么人的介入和监督就必不可少。

因此,无需争论某种特定方法(如“是否必须做集成测试”、“是否要采用BDD流程”)的绝对优劣。方法论只是原理的载体,关键在于它是否能在你的具体上下文中,形成“约束力”与“独立性”的有效组合,从而建立起可靠的质量控制体系。

结语:从行业奢侈品到工程标配

一位来自金融行业的专家曾断言:“金融业现在的质量高峰,以后就是大家的底线。”七层测试体系、数十万条测试用例、独立的测试部门、开发-测试-运维分离的流程……这些过去因成本高昂而仅为少数行业所独有的“奢侈品”,正在因为AI大幅降低的研发成本,而变得日益普及。

历史总是惊人地相似。统计过程控制(SPC)诞生于美国,最初并未在美国本土得到广泛应用,反而被资源匮乏、精益求精的日本企业奉为圭臬,助力其实现了制造业的黄金三十年。今天,在AI软件工程的质量之路上,我们也站在了类似的十字路口。

拥抱概率性,通过构建兼具“约束力”与“独立性”的确定性边界来驾驭它,这或许是确保AI时代软件工程质量的核心法门。欢迎在 云栈社区 的 运维/DevOps/SRE 等板块,与更多同行探讨AI软件工程的最佳实践。