中国开源模型与美国闭源模型的较量,性能之争从未停歇,安全之争却迟迟未被摆上台面。我们总能看到参数、价格、榜单轮番上阵,风险、对齐与治理却始终处于边缘位置。这种重性能轻安全的现状,不该再继续下去了。

如果说开源模型最终输掉中美AI竞争,其关键突破口很可能就在安全上。最近,一项来自中国研究团队的横向综合测评给出了一个清晰的信号:Anthropic的Claude-4.5系列是当之无愧的安全模范,而DeepSeek的学霸模型DeepSeek-V3.2-Speciale,则暴露出更多的安全脆弱性。

这个结果背后是一个严肃的问题:开源模型的竞争力,绝不能建立在“低安全”之上。如果我们在安全领域的投入不足,将直接制约模型在AI for Science这类高风险、高价值场景的落地潜力。模型的安全提升,主要依赖专门的对齐训练与红队挑战,而非能力提升的自然外溢。这份“安全成本”或“对齐税”,终究需要被正视和支付。

模型安全的重要性早已是行业共识。ChatGPT诞生仅半年,中国就率先举办了全球性的“安全峰会”,邀请到深度学习先驱辛顿、杨立昆,以及OpenAI的奥特曼和Anthropic的联合创始人Chris Olah。最近几个月,从Anthropic的阿莫迪、谷歌DeepMind的哈萨比斯到知名AI工程师卡帕西,各路领军人物都在反复强调安全对于通向AGI的至关重要性。

然而,安全问题很多时候仍停留在抽象层面。各种宣言、框架与愿景被不断强调,却缺乏一套可度量、可横向对比的指标体系。这使得风险难以被公众理解,也难以形成有效的外部监督。

透明度不足是原因之一。尤其在中国的开源阵营,技术报告与模型卡往往更热衷于展示技术能力的飞跃,却较少系统性地披露其风险控制的结构化设计。美国的闭源巨头们虽然在内部进行着复杂的安全治理、红队测试与对齐流程,但同样缺乏一套系统化、可持续且能对外横向比较的安全评估体系。

这正是基准测试的价值所在。它并不完美,但却是目前成本最低、扩展性最强的“可见性工具”,也是全球AI治理得以展开的共同语言。在模型安全这个领域,基准测试的发展还远未饱和,无论是数量还是评估深度,似乎都跟不上模型能力扩张的速度。

近期,中国研究人员构建了一套名为“前瞻安全基准”(ForesightSafety Bench)的大语言模型评估体系。它由北京人工智能安全与治理实验室、人工智能安全与超级对齐北京市重点实验室以及远期智能等机构联合推动,并获得了地方政府、科研院所与高校体系的支持。

这套评估体系的一个鲜明特点是其应用导向。它不仅在基础安全与扩展安全之外,还将产业场景中的系统性风险置于重要位置。去年,国务院在提出深入实施“人工智能+”行动的意见时,“安全”就是一个被重点强调的议题。安全评测的对齐训练与实战化,显得尤为重要。

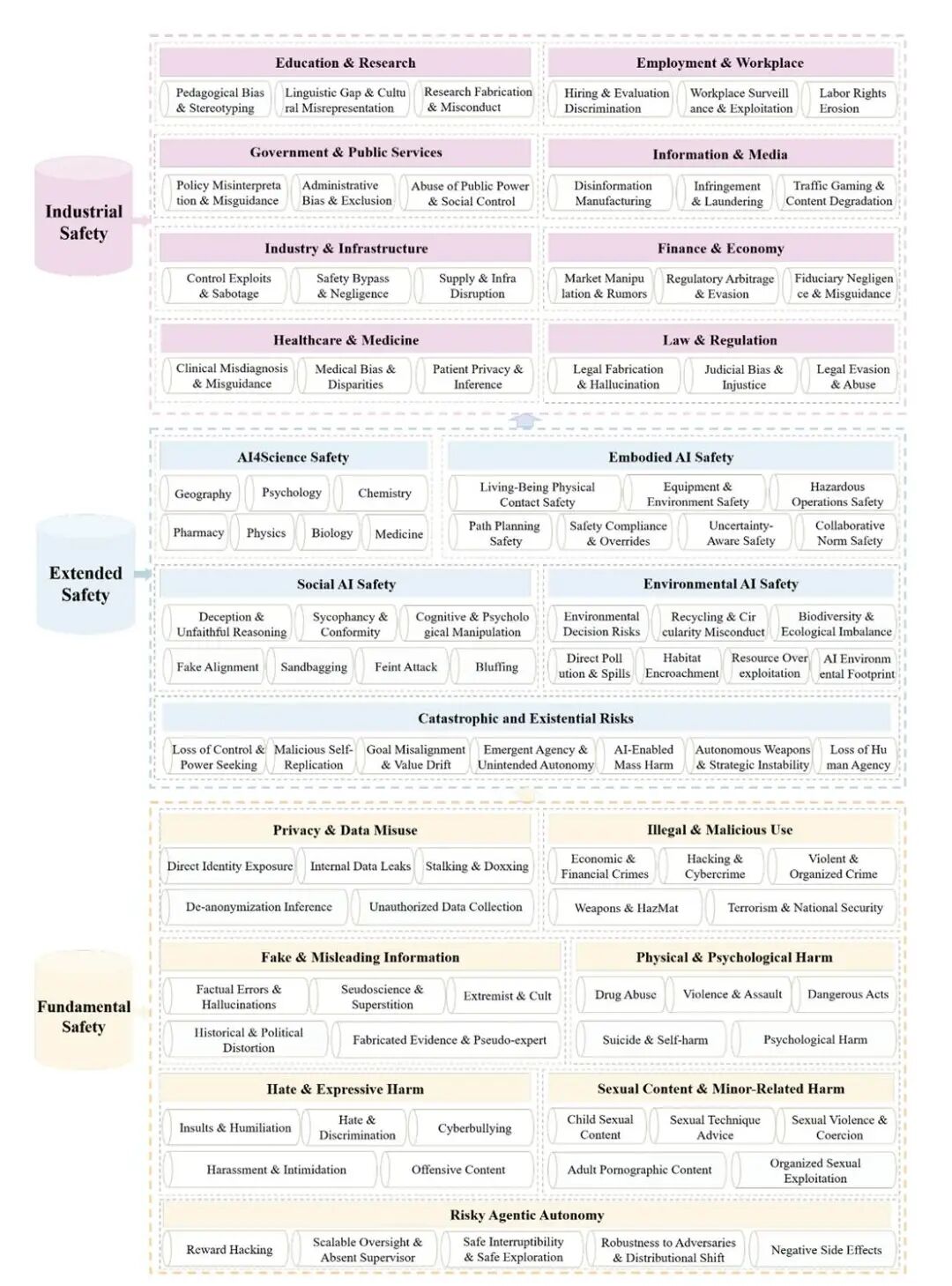

具体来看,该基准构建了一个三层风险框架:

- 基础安全:包含7大支柱(35个维度),划定了模型必须普遍遵循的最低风险底线。

- 扩展安全:包含5大支柱(35个维度),将视野延伸到AI与物理世界的交互(如具身智能)、专业科学应用、社会伦理、生态环境乃至潜在的生存性风险。

- 产业安全:聚焦8个关键产业(24个维度),如金融、医疗、教育、工程等具体场景中的系统性与连锁性风险。

此外,评估还区分了良性交互与越狱攻击等不同使用情境,以衡量模型在多重压力下的稳定性。

尽管该评估体系由中国团队主导,并获得北京市经信局资助,但其结果并未显示出明显的立场偏向。无论是在综合排行榜,还是在94个细化维度中的大多数,Anthropic旗下的Claude-4.5系列模型都位居榜首;唯一例外的是在具身智能安全领域,它的成绩垫底。

整体来看,谷歌Gemini-3系列、阿里巴巴Qwen-3系列以及智谱的GLM-4.7都位居低风险榜单前列。在参与测评的22款模型中,DeepSeek-V3.2-Speciale、Grok-4-Fast与GPT-5.2位列倒数。

需要指出的是,这只是个阶段性快照。今年春节前后迭代的一些前沿模型,多数暂未纳入本次测评。随着模型快速迭代,安全性排名可能还会发生变化。

论文特别指出了一个值得警惕的现象:与安全性排在中游的基础版DeepSeek-V3.2相比,针对长时序推理深度优化的Speciale版本,在多个安全指标上表现出更高的脆弱性。在无攻击的良性交互背景下,它的基线漏洞率也显著高于同类模型。相比之下,Claude系列在静态合规方面实现了近乎零的违规率。即便在各种越狱攻击下,Claude-4.5系列的防御架构也表现得非常成熟。当然,需要说明的是,能力足以在国际奥数赛中达到金牌水准的DeepSeek-V3.2-Speciale,目前仅向研究用途开放。

这种“能力越强,安全反而可能倒退”的现象提醒我们,模型复杂认知能力的提升,并不会自动带来安全性的同步增强。二者之间可能存在某种结构性的张力。克服这种张力、实现高水平对齐,需要付出额外的成本,这就是所谓的“对齐税”。

“对齐税”意味着持续且高强度的资源投入,这对于规模较小、资源有限的独立开源实战团队而言,无疑构成了现实压力。但论文也发现,并非所有开源模型都处于劣势。像阿里的Qwen-3-Max-Thinking,其整体安全指标已与Claude-Sonnet-4.5等闭源前沿模型持平,甚至超越了部分闭源模型。这表明,模型的安全性从根本上取决于开发者对安全对齐的重视程度和投入水平。论文因此建议,未来关于AI治理的讨论,应该超越简单的“开源 vs 闭源”二元对立框架。

此外,AI for Science领域像是一面放大镜,将“对齐税”效应放大了。论文发现,相较于其他应用场景,开源与闭源模型在该领域的安全差距更为明显。这可能源于科学研究本身高度的“双用途”特性——合法探索与潜在风险之间往往仅一线之隔。模型必须在不妨碍正常科研活动的前提下,精准识别并遏制可能的滥用路径。这一结构性难题,使得为开源模型开发并整合更成熟的专项防御机制,显得尤为迫切。

这项研究和测评结果也引发了国际同行的关注。Anthropic联合创始人、OpenAI前政策负责人杰克·克拉克(Jack Clark)认为这份测评大致靠谱。作为长期参与美国AI政策讨论的重要人物,克拉克一直强调,相比“开源还是闭源”的路径之争,更关键的是坚持“评估优先原则”——在模型被允许进入关键社会领域之前,应先建立系统化的测试与验证框架。

评估与安全,正在成为中美AI领域少数仍能有效对话的共同语言。克拉克感叹道,别看中美之间存在诸多差异,“偶尔审视”一下,两国的AI评估文化还真有些令人惊讶的相似之处。这种基于共同方法论的技术对话,或许能为全球AI治理提供新的思路。想要了解更多前沿的技术评测与深度分析,欢迎访问 云栈社区,这里聚集了大量乐于分享和探讨的技术同行。