《华尔街日报》的一篇独家报道,在硅谷引发了巨大震动。

前脚,特朗普总统刚下令全面禁止联邦机构使用Anthropic的技术。后脚,美国军方对伊朗发动了一场大规模空袭——而这场行动的情报环节,据称正集成了他们所“禁止”的AI模型Claude。

它不仅被用于生成情报评估报告,还直接参与了目标识别,甚至在战斗场景模拟中扮演了核心角色。知情人士证实,负责中东地区的美军中央司令部以及美军驻全球的多个司令部都在使用Claude AI,其渗透程度远超外界想象。

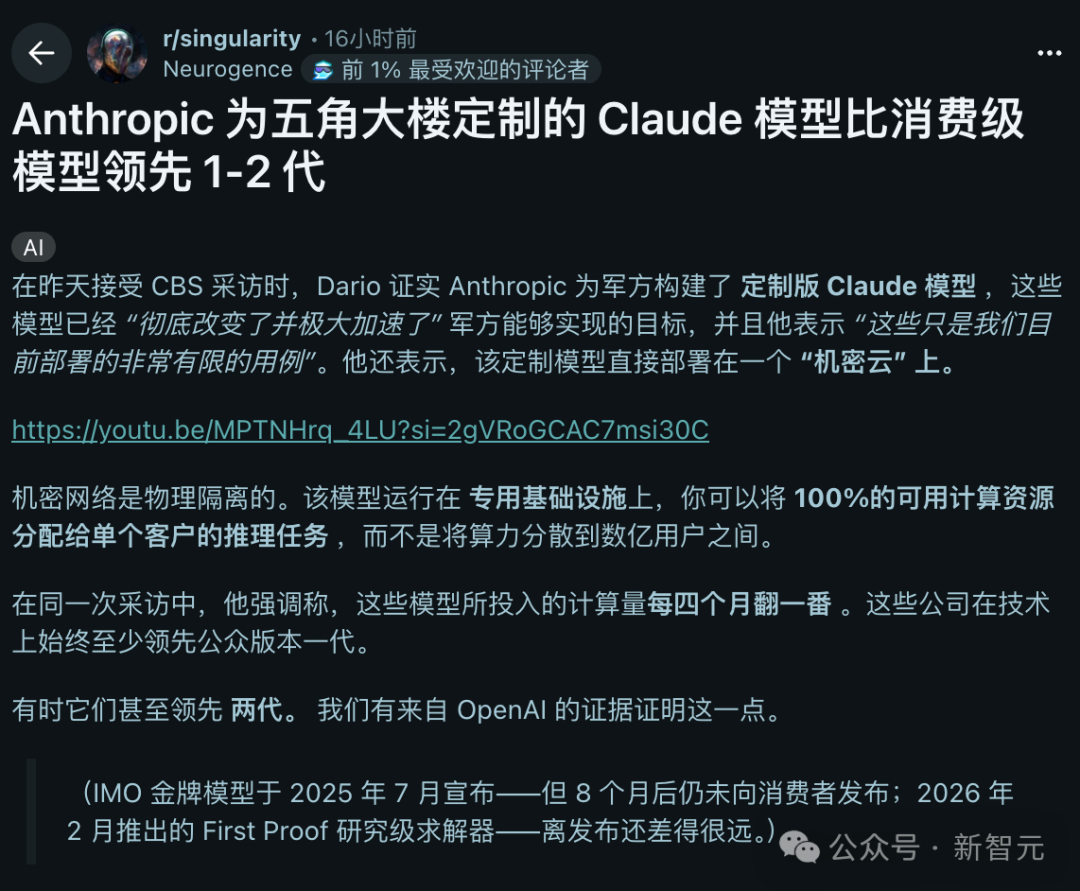

随后,更爆炸性的消息从昨天CNBC的独家采访中传出。Anthropic联合创始人兼首席执行官Dario Amodei亲口证实:公司已经为美国军方打造了一款“定制版Claude”。他形容这款模型“彻底改变并极大加速了军方能够实现的目标”,而这仅仅是Anthropic目前部署的“非常有限的用例”。

据网络社群分析,这款军用定制版Claude的能力,可能比公众目前使用的Opus 4.6版本领先一至两代——性能或许已经达到了尚未公开发布的Opus 5,甚至是Opus 5.5的水平,且享有专属的满额计算资源。

禁令与空袭:一场矛盾的现实

中东紧张局势持续升级,这场军事行动背后,牵扯出白宫与硅谷AI巨头之间复杂的博弈。就在特朗普发布针对Anthropic的禁令数小时后,美军便发动了空袭。这种时间上的巧合与政策上的矛盾,凸显了先进AI技术在现代军事体系中已经扮演了难以替代的角色。

面对外界关于军方“违令”的质疑,白宫方面给出了一个耐人寻味的回应:想让Claude从现有军事系统中彻底“退役”,至少需要6个月的时间。这被称为技术上的“戒断”期。目前,美国国防部已签署协议,准备在机密环境下转用OpenAI和马斯克旗下xAI的模型。

然而,“无痛换血”谈何容易。一方面,Claude已经深度接入了Palantir等合作伙伴的数据挖掘与分析架构,替换过程牵一发而动全身。另一方面,AI专家指出,部队适应全新模型、并围绕其重构整套作战流程,至少需要数月时间。从实战系统中“拔掉”一个深度集成的AI,远比一纸禁令要复杂和困难得多。

定制版Claude:或已达“Opus 5.5”水平

在CNBC的采访中,Dario Amodei的疲惫与无奈清晰可见。他揭开了一个让科技界震动的技术内幕:Anthropic为军方定制的Claude模型,直接部署在物理隔离的“机密云”上。这意味着该模型运行在专用基础设施上,可以将100%的可用计算资源分配给军方的推理任务,而非与数亿普通用户共享算力。

Amodei还特别强调了一句:“投入到这些模型上的计算量,每四个月就翻一倍。”

更值得关注的是其技术领先性。这其实某种程度上已成为行业“常识”:硅谷巨头们内部研发和部署的模型,其能力通常比面向公众发布的版本领先至少一代。例如,有社区用户以OpenAI为例,指出其2025年7月公布的IMO金牌模型,以及2026年2月推出的研究级数学求解器,均未向消费者发布。

因此,为五角大楼定制的Claude,很可能是一个在训练数据、计算规模和推理能力上都远超民用版本的“怪物”。从美国政府对其采取的罕见施压手段也能窥见,军用版Claude的能力早已超出了普通对话助手的范畴。

结合其在军事行动中可能发挥的作用,可以推测这款定制模型至少具备以下能力:

- 自主战略推理:独立分析复杂地缘政治局势,以超越人类的速度进行兵棋推演,从海量机密情报流中发现规律。

- 实时信息综合:跨多个机密数据库进行实时关联分析,这种工作量传统上需要一个分析师团队花费数周才能完成。

- 超长深度思维链:其内部推理过程(思维链)可能比普通消费者能接触到的版本长好几个数量级。

基于以上推测,有分析认为五角大楼使用的Claude,可能就是基于Claude Opus 5甚至Opus 5.5架构的、计算能力最大化的定制版本。

当然,也有观点认为军方可能只是针对特定用例进行了微调,例如使其擅长分析海量卫星图像以识别军事目标。另一些网友则对Anthropic“拒绝五角大楼”又“为其定制模型”感到困惑。实际上,Anthropic拒绝的是移除AI模型中的安全护栏(Guardrails)以及某些触及隐私红线的数据使用方式,而非技术合作本身。

Anthropic与五角大楼的“杀手机器人”红线之争

《大西洋月刊》的报道进一步揭示了双方谈判破裂的细节。谈判的转折点出现在一个关键分歧上:五角大楼希望利用Claude来分析大规模搜集的美国民众数据,包括网络聊天记录、搜索历史、地理位置轨迹、消费流水等,并与个人生活的其他隐私细节进行交叉分析。

Anthropic的高管们认为这完全踩到了公司的伦理红线,谈判就此崩盘。

另一个核心争议点是“自主武器系统”。美国军方在自动化武器领域投入巨大,从单兵无人机到无人机蜂群技术都在快速发展。有趣的是,Anthropic曾主动提出合作,希望帮助提高这些系统的可靠性和安全性,其逻辑类似于追求更安全的自动驾驶——在某些场景下,精准的机器或许能降低误伤平民的概率。

然而,公司高管们一致认为,目前的AI技术远未达到可以安全地应用于武器末端决策的水平。五角大楼曾提出折中方案,将Claude限制在“云端”进行分析,而非直接部署在武器上。但Anthropic看穿了这种“文字游戏”:在现代战争高度网络化的架构中,云端服务器与前线武器单元紧密相连。只要AI模型实时参与杀伤链的决策,无论其物理位置在何处,其在伦理上承担的责任并无本质区别。

他们真正的担忧是,将不成熟的AI“大脑”植入武器,可能导致不可预测的误判,危及平民甚至己方人员的安全。

这场博弈凸显了一个尖锐的现实:AI技术正以“月”为单位飞速进化,而人类社会的法律、伦理和行政命令,在瞬息万变的军事需求与技术能力面前,正显得日益被动和迟缓。

当最先进的大语言模型开始化为战争机器的“参谋”甚至“决策辅助”时,硅谷曾经的技术理想主义叙事正面临严峻挑战。这场关于人工智能权力、责任与控制的战争,或许才刚刚拉开序幕。

参考资料:

想了解更多关于AI前沿技术动态和深度分析的开发者,欢迎关注云栈社区的相关讨论。