最近在逛代码仓库时,偶然发现一个名为 RunAnywhere 的开源 SDK,感觉挺有意思。它做的事情很直接:将大语言模型、语音识别、语音合成这些能力,全部搬到手机本地运行,让你的 AI 助手直接“住”进用户的 iPhone 或安卓设备里。

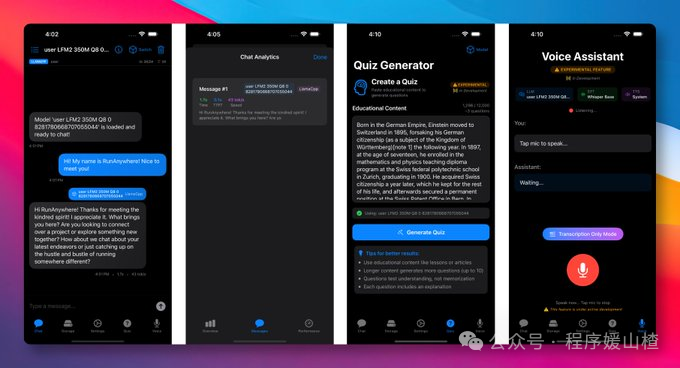

最直观的感受有两点:不联网也能工作,以及用户说完话后几乎是秒回。没有了云端来回的网络延迟,整个对话的流畅度直接提升了一个档次。对于开发语音助手、离线翻译这类应用来说,体验上的提升会非常明显。

成本方面也更可控。以往调用云端 API,用户聊得越尽兴,开发者心里可能越没底:这个月的账单会不会又超额了?本地推理虽然也消耗算力,但逻辑上属于“一次购买模型,长期在应用内运行”,对于中小团队而言,成本预期一下子清晰了很多。

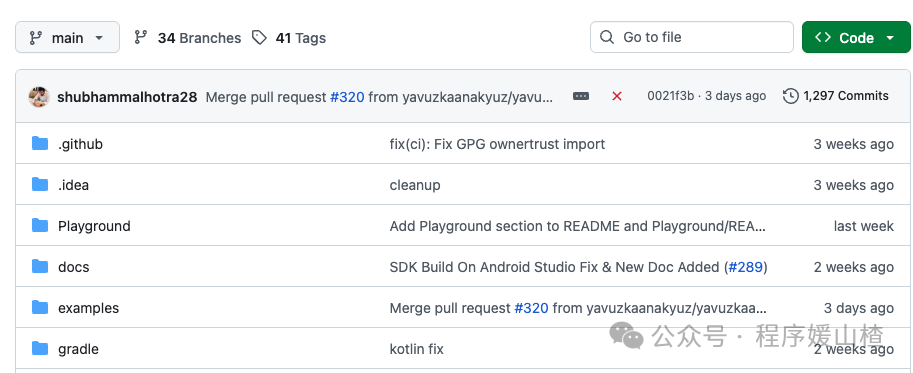

RunAnywhere 的开发门槛也压得比较低。官方一口气提供了 Swift、Kotlin、React Native 和 Flutter 四套 SDK,基本覆盖了移动端的主流技术栈。你在 App 里集成后,写几行代码就能下载并加载模型,然后直接传入文本或语音,让它开始生成回复。

在能力上,它也不是“玩具级别”的。大语言模型方面,支持 Llama、Mistral、Qwen 等一系列主流开源模型;语音层面集成了 Whisper 做语音转文字,Piper 做文字转语音,串联起来就是一条完整的语音助手链路:听得懂、能思考、还能回答,全程离线运行。

一些细节功能也做得比较“工程化”。SDK 内置了模型下载进度追踪,用户能清楚知道下载进度;推理过程支持流式输出,可以一边生成结果一边刷新界面;还提供了结构化 JSON 生成功能,这让实现工具调用、表单填充等场景变得顺手很多。对于经常与 大模型 打交道的开发者来说,这些贴心的小功能都很加分。

iOS 开发者可能会更开心一点:RunAnywhere 还将苹果自家的基础模型也接入了进来。这意味着你既可以选择运行开源大模型,也可以调用系统级能力,根据实际场景灵活混搭。这种“云、端、本地”能力兼备的自由度,给想要实现创新功能的 App 提供了很大的想象空间。

更重要的是,它不是只扔给你一堆 API 文档就让你自己摸索。项目里直接包含了完整的示例应用,iOS 和 Android 平台都有,你可以从 App Store 和 Google Play 下载回来体验一番,看看真实环境下的耗电、发热、响应速度大概是什么水平,再决定是否采用,这比对着 README 空想要靠谱得多。

对于独立开发者和小团队而言,本地 AI 最大的意义,或许在于把“做一个自己的语音助手、私人知识库或离线翻译器”这个想法,变成了一个真正可以上线落地的产品,而不仅仅是停留在 Demo 阶段。你不再需要搭建和维护一套复杂的云端推理服务,只需在 App 里集成一个 SDK,就能构建出相当完整的 AI 功能体验。

如果你已经在开发 AI 应用,现在面临的最现实问题可能是:继续重度依赖云端,还是开始尝试将一部分能力向设备端迁移?RunAnywhere 这类方案,非常适合用来做一个“小范围的实验版本”,先验证本地方案的体验和成本,再决定后续的架构演进方向。对这类移动端前沿技术感兴趣的开发者,不妨到 云栈社区 的移动开发或开源板块逛逛,交流更多实战经验。

项目的 GitHub 地址是:github.com/RunanywhereAI/runanywhere-sdks |