字数 1274,阅读大约需 7 分钟

本地大模型运行工具 Ollama 迎来了重要更新,版本号跃升至 v0.7.0。此次更新的核心在于引入了一个全新的模型引擎,专门用于原生支持多模态大模型,这标志着 Ollama 在处理图像、文本混合输入的能力上迈出了关键一步。

首批获得支持的多模态模型包括:

- Meta Llama 4

- Google Gemma 3

- Qwen 2.5 VL

- Mistral Small 3.10

- 其它视觉模型

如何升级至 Ollama 0.7.0?

要体验多模态功能,你必须将 Ollama 升级到 v0.7.0 或更高版本。如果你的版本过低,可以参照以下步骤进行升级(以 Linux 系统为例):

-

下载最新版本

wget https://github.com/ollama/ollama/releases/download/v0.7.0/ollama-linux-amd64.tgz

-

停止 Ollama 服务

sudo systemctl stop ollama

-

删除旧版本文件

sudo rm -rf /usr/lib/ollama

-

启动 Ollama 服务

sudo systemctl start ollama

完成升级后,你就可以拉取并运行新的多模态模型了。

多模态模型实战:以 Qwen 2.5-VL 为例

让我们以 qwen2.5vl 模型为例,演示如何下载并使用它进行图像内容识别。首先,通过命令行拉取模型:

$ ollama pull qwen2.5vl

pulling manifest

pulling a99b7f834d75: 100% ▕████████████████████████████████████████████████████████████████████████████████████████████████████████▏ 6.0 GB

pulling a242d8dfdc8f: 100% ▕████████████████████████████████████████████████████████████████████████████████████████████████████████▏ 487 B

pulling 75357d685f23: 100% ▕████████████████████████████████████████████████████████████████████████████████████████████████████████▏ 28 B

pulling 832dd9e00a68: 100% ▕████████████████████████████████████████████████████████████████████████████████████████████████████████▏ 11 KB

pulling 52d2a7aa3a38: 100% ▕████████████████████████████████████████████████████████████████████████████████████████████████████████▏ 23 B

pulling 83b9da835d9f: 100% ▕████████████████████████████████████████████████████████████████████████████████████████████████████████▏ 567 B

verifying sha256 digest

writing manifest

success

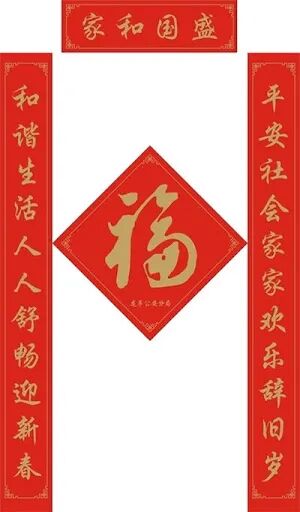

模型下载完成后,运行 ollama run qwen2.5vl 进入交互模式。你可以直接上传一张图片并向模型提问。例如,给模型一张春节对联的图片并询问其内容:

>>> ./spring-couplets.jpg what is content in this picture?

Added image './spring-couplets.jpg'

The image appears to be a set of Chinese New Year decorations, specifically red couplets and a central piece with the character "福" (fú), which means

"blessing" or "good fortune." The couplets and the central piece contain various phrases in Chinese, which are wishes for good fortune, happiness, and

prosperity. Here are some of the phrases:

- "家和国盛" (jiā hé guó shèng): "Family harmony and country prosperity."

- "和气生财" (hé qì shēng cái): "Harmony brings wealth."

- "平安社会" (pái ān shè huì): "Peaceful society."

- "生活人人舒畅" (shēnghuó rén rén shū chàng): "Everyone enjoys a comfortable life."

- "新春" (chūn xīn): "New Year."

- "辞旧迎新" (cí jiù yíng xīn): "Bid farewell to the old and welcome the new."

These phrases are commonly used in Chinese New Year decorations to express wishes for a prosperous and harmonious year ahead.

模型准确地识别出了图片中的中文祝福语并给出了解释,展示了多模态AI模型在视觉理解上的能力。

深入解析:新版多模态引擎的设计考量

为何要推出新引擎?

Ollama 长期以来依赖 ggml-org/llama.cpp 项目来支持各类模型,其设计重心在于极致的易用性和模型的可移植性。然而,随着各大研究机构密集发布功能各异的多模态模型,在现有架构下无缝集成这些模型变得越发困难。

Ollama 团队决定引入一个新引擎,目标是让多模态支持成为一等公民,并鼓励生态伙伴通过 GGML 张量库直接为社区做贡献。此举旨在从根本上提升本地推理的可靠性与准确性,并为未来支持语音、图像生成、视频处理及超长上下文等高级功能铺平道路。

全新的模型规范:隔离与专注

新引擎的核心思想是模型的高度自包含。在传统的多模态处理中,文本解码器和视觉编码器通常是分离的,需要在交互层编写大量模型特定的胶水代码,这容易导致代码臃肿和潜在错误。

Ollama 的新方案让每个模型都完全自包含,并能暴露自身训练时对齐的投影层。这种隔离使得模型创作者可以专心于模型本身的训练与发布,无需为了适配框架而去修改核心逻辑或添加复杂的条件判断。这相当于为每个模型建立了独立的“沙箱”,大幅提升了系统的可靠性和可维护性。

追求更高的推理准确性

处理图像时,大尺寸图片会产生海量的token,可能超出标准批处理大小。Ollama 通过在处理流程中添加图像元数据来辅助模型,以追求更精准的输出。

例如,引擎需要智能决策:何时启用或禁用注意力机制?如何将庞大的图像嵌入进行分批处理?分界的依据是什么?错误的分割点会导致输出质量显著下降。许多本地推理工具在处理这些细节时方式各异,虽然结果可能近似,但未必符合模型原始的设计与训练方式。Ollama 的新引擎致力于更贴近模型的“原意”。

更高效的内存管理

- 图像缓存:Ollama 会缓存已处理的图像,当用户在同一会话中再次使用相同图片时,响应速度会更快。这些缓存图像会被保留,不会因为内存清理策略而被轻易丢弃。

- 内存估算与优化:Ollama 正与硬件制造商和操作系统伙伴合作,以更精确地检测硬件元数据,从而更好地预估和优化内存占用。同时,新引擎也包含了对 KV 缓存的优化,提升了内存的使用效率。

未来展望

Ollama 已经公布了接下来的开发蓝图,重点关注以下能力:

- 更长的上下文支持

- 思维链/推理能力

- 流式响应时的工具调用

- 计算机使用(Agent)能力

总结

Ollama v0.7.0 不仅仅是一次简单的版本迭代,它通过发布全新的多模态引擎,从根本上提升了框架处理复杂AI模型的能力。其长远目标是建立一套模型标准,让不同的开源模型提供者只需专注于发布模型本身,而将高效、可靠的推理实现交给 Ollama 来完成。

这次更新为本地运行更强大、更复杂的多模态大模型打开了大门,对于开发者而言,意味着能在本地更容易地实验和部署前沿的AI应用。如果你想了解更多类似的技术实践和解读,欢迎到云栈社区与更多开发者交流探讨。