近日,OpenAI 正式开源了 gpt-oss-120b 和 gpt-oss-20b 两款轻量级语言模型,其表现卓越且允许免费商用。这两个模型具备以下几个核心特性:

- 智能体能力:原生支持

工具调用、网页搜索、Python代码执行以及结构化输出。

- 完整的思维链:可以获取模型的完整思考过程,便于调试并增强对输出结果的信任度。

- 可配置的推理能力:支持

low/medium/high 三种推理效果等级,可按需调整。

- 可参数微调:支持通过参数进行细粒度的优化调整。

- Apache 2.0 许可:无论是用于实验、定制还是商业部署,都可自由构建,无需担心版权或专利风险。

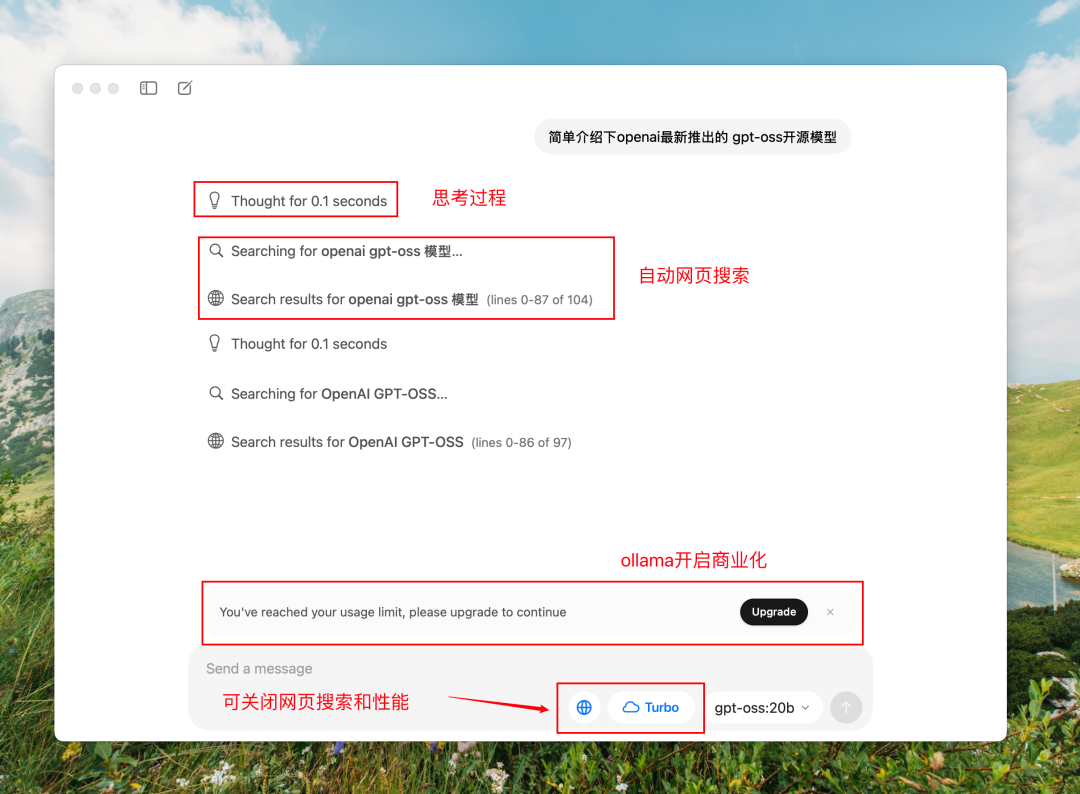

有开发者通过 Ollama 进行了简单试用,反馈效果不错,但在持续使用时会遇到需要订阅的提示。

模型架构

这两个模型均基于 Transformer 架构,并采用了专家混合 (MoE) 技术来减少处理每个输入令牌时实际激活的参数数量。具体来说,gpt-oss-120b 每个令牌激活约51亿参数,而 gpt-oss-20b 激活约36亿参数。

| 模型 |

层数 |

总参数 |

每个令牌激活参数 |

总专家数 |

每个令牌激活专家数 |

上下文长度 |

| gpt-oss-120b |

36 |

117b |

5.1b |

128 |

4 |

128k |

| gpt-oss-20b |

24 |

21b |

3.6b |

32 |

4 |

128k |

OpenAI 使用了一个高质量、主要为英文的纯文本数据集对模型进行训练,重点聚焦于 STEM、编程和通用知识领域。数据令牌化使用了 OpenAI o4-mini 和 GPT‑4o 所用令牌化器的超集—— o200k_harmony。该令牌化器也已一同开源,源代码地址为:https://github.com/openai/harmony 。

性能评估

|

gpt-oss-120b |

gpt-oss-20b |

OpenAI o3 |

OpenAI o4-mini |

| 推理与知识 |

|

|

|

|

| MMLU |

90 |

85.3 |

93.4 |

93 |

| GPQA 钻石级 |

80.9 |

74.2 |

77 |

81.4 |

| 人类水平评估 (HLE) |

19 |

17.3 |

24.9 |

17.7 |

| 竞赛数学 |

|

|

|

|

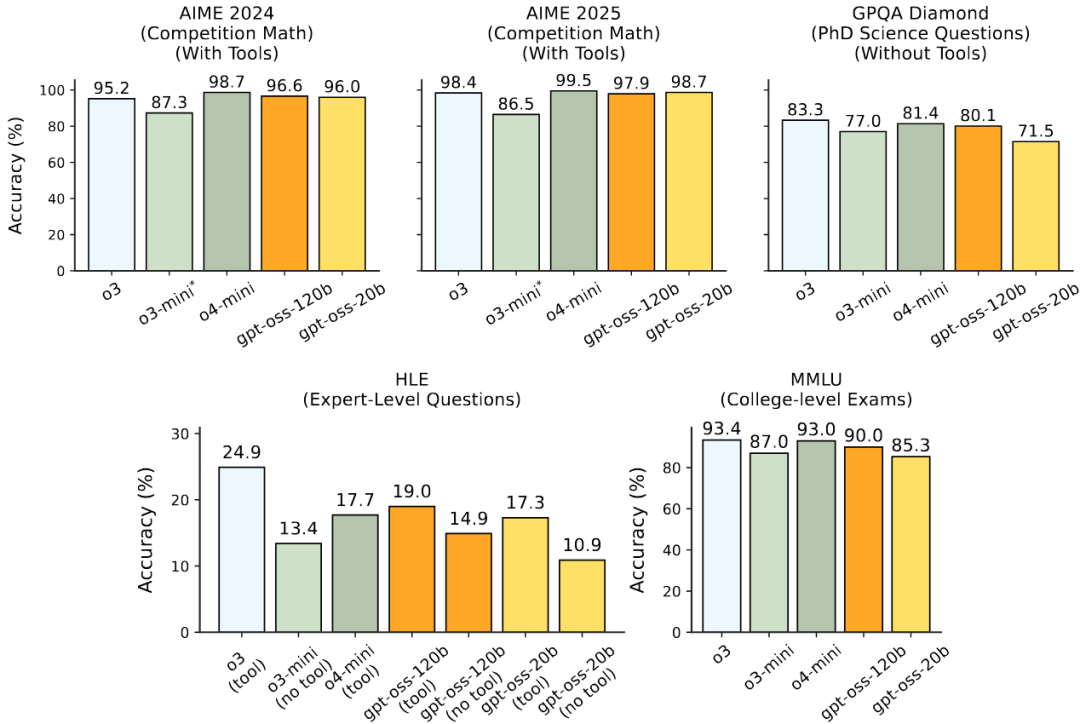

| AIME 2024 |

96.6 |

96 |

91.6 |

93.4 |

| AIME 2025 |

97.9 |

98.7 |

88.9 |

92.7 |

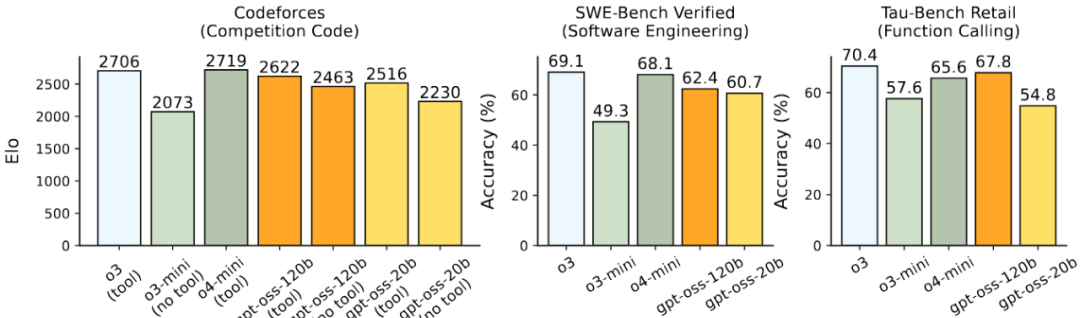

综合评估显示:

gpt-oss-120b 在竞赛编程 (Codeforces)、通用问题解决 (MMLU 和 HLE) 以及工具调用 (TauBench) 方面的表现优于 OpenAI o3‑mini,并与 OpenAI o4-mini 持平或实现超越。此外,它在健康相关查询 (HealthBench) 和竞赛数学 (AIME 2024 和 2025) 方面比 o4-mini 表现更好。

尽管 gpt-oss-20b 规模较小,但在上述相同评估中,它与 OpenAI o3‑mini 持平或实现超越,甚至在竞赛数学和医疗相关任务上表现更佳。

可用性与部署

模型已原生量化为 MXFP4 格式,gpt-oss-120b 需要约80GB内存,而 gpt-oss-20b 仅需约16GB内存。

gpt-oss-120b 面向生产可用场景,适合部署在大型数据中心或高端设备上。gpt-oss-20b 则是设备端应用、本地推理或需要快速迭代且无需昂贵基础设施场景的理想选择。

为了提升灵活性和易用性,OpenAI 与众多领先的部署平台展开了合作,方便开发者快速集成:

- Hugging Face

- Azure

- vLLM

- Ollama

- llama.cpp

- LM Studio

- AWS

- Fireworks

- Together AI

- Baseten

- Databricks

- Vercel

- Cloudflare

- OpenRouter

在硬件层面,OpenAI 也与 NVIDIA、AMD、Cerebras 和 Groq 等厂商合作,以确保模型在各类系统上都能获得性能优化。其核心目的,是希望这些模型能够被广大开发者方便地使用。

总结

gpt-oss 系列模型虽然不是 OpenAI 最前沿的模型,但它汇聚了 OpenAI 内部诸多先进的技术理念、模型架构和训练方法。其强大的智能体能力,包括对工具调用、网页搜索和 Python 代码执行的原生支持,为开发者探索人工智能应用提供了丰富的可能性。

两款模型定位清晰:20B 参数版本可在消费级硬件(16GB显存)上运行,适合个人开发者和普通用户;120B 参数版本面向生产环境,需要更强的计算资源(约80GB显存)。此次开源行动,旨在加速前沿研究,促进创新,并推动在更广泛的应用场景下实现更安全、更透明的 AI 开发。

参考

|