很多做量化的同行最近都在折腾大模型,试图让 Claude 或 Cursor 直接包揽因子挖掘和回测。就像把 AI 当成许愿祈祷的神,直接给出能赚钱的代码。

理想很丰满:

输入一句“帮我拉取过去十年的美联储利率数据,并跑一个 Fama-MacBeth 回归”,然后坐等收钱。

现实很骨感:

AI 确实飞快地写出了一坨看起来极其优雅的代码。但你一跑,不是 API 字段名捏造的(幻觉),就是依赖包版本冲突,要么就是根本不懂金融数据的对齐逻辑。

说白了,现在的 LLM 就像一个极其自信但毫无常识的实习生。你不能指望它“懂”量化,你必须给它一本极度详尽的《SOP 操作手册》。

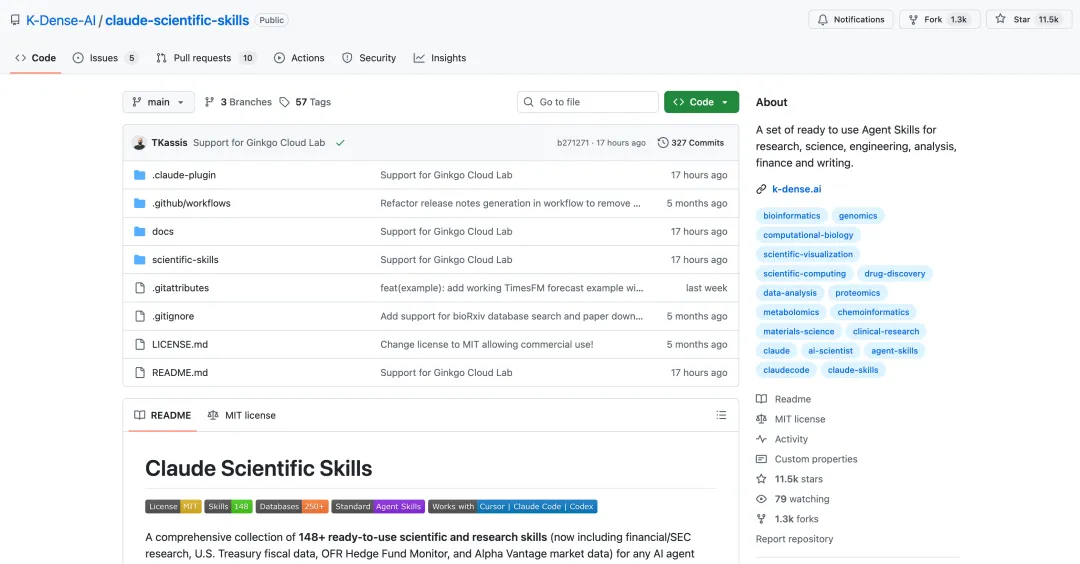

今天《alphaFind》要拆解的 GitHub 热门项目 Claude Scientific Skills,本质上就是给这位实习生准备的“量化操作手册”。

扯掉包装:这项目到底是个啥?

如果你看官方的宣传,会觉得这是一个“把 AI 变成科学家的超级外挂”。但从工程视角扒开它的源码,它的架构其实非常“土味”且实用。

它没有去微调什么牛逼的模型,也没有搞复杂的向量数据库。它只是维护了 148 个文件夹,每个文件夹代表一个技能(比如 alpha-vantage、statsmodels)。

核心全在每个文件夹里的 SKILL.md 文件。这个文件就是写给 Claude 看的 Prompt,里面硬编码了:

- 这个库是干嘛的。

- 官方 API 到底长什么样(拒绝 AI 靠猜)。

- 正确的代码示例。

当你在 Cursor 里调用它时,系统通过 marketplace.json 注册表找到对应的 SKILL.md 塞进上下文。同时,它利用 uv 包管理器做按需加载(Lazy Install)——用到哪个库,瞬间在后台把环境装好。

这就是目前人工智能在垂直领域落地最务实的解法:用高质量的上下文,暴力压制大模型的幻觉。

因子投研视角:它能帮我们干什么?

站在量化工程的角度,我不关心它里面那些生物、化学的技能,我只看它金融数据栈的成色。

1. 锁死数据管线,告别 API 幻觉

做因子的第一步是洗数据。项目里内置了 fred-economic-data(美联储宏观数据)、edgartools(SEC 财报与机构持仓)、hedgefundmonitor(OFR 机构资金监控)等技能。

这意味着,当你让 AI 去拉取 13F 机构持仓或者宏观 CPI 数据时,它会老老实实按照 SKILL.md 里的官方规范去写请求,而不是凭空捏造一个根本不存在的 endpoint。

2. 规范统计建模流程

在验证信号阶段,它整合了 statsmodels、aeon(时间序列分析)和 scikit-learn。这保证了 AI 在处理时间序列相似度搜索,或者做截面回归时,调用的是业界标准的统计包,而不是自己手搓一段漏洞百出的代码。

泼点冷水:别把它当银弹

文章写到这,肯定有人觉得这玩意儿无敌了。但作为一线从业者,我得泼点冷水。

首先,它解决不了微结构和高频数据的问题。它内置的 alpha-vantage 顶多处理分钟级数据,如果你做的是 Tick 级策略,面对海量订单簿数据,底层的算法/数据结构优化和内存管理,依然得靠你自己手写 C++ 或 Rust,AI 目前根本插不上手。

其次,148 个技能全装就是灾难。千万别一上来就把整个包塞进你的 Cursor。上下文窗口是有限的,塞太多无关的技能只会让 AI 变傻。

我的落地建议是:

把这个项目当成一个“脚手架”。挑出你平时最常用的 3 到 5 个数据源(比如宏观、财报、行情),把它们的技能文件夹抽出来,装到本地。甚至,你可以参考它的格式,把自己公司内部的私有数据 API 写成 SKILL.md 喂给 AI。

项目地址与参考资料

- GitHub 仓库:

K-Dense-AI/claude-scientific-skills

- 学习编程基础:

https://yunpan.plus/f/14

- AI 应用课程:

https://yunpan.plus/f/29

- 算法基础充电:

https://yunpan.plus/f/35

如果你对这种“调教 AI”的工程化实践感兴趣,或者想看看别人是怎么魔改这类工具的,欢迎来 云栈社区 逛逛。在 云栈社区 的开源实战板块,有不少开发者在分享如何把开源项目改造成适合自己业务流的利器。

技术没有魔法,只有工程上的死磕。

关注《alphaFind》,Faster Alpha Discovery。从因子到策略,陪你走完最后一毫秒。

标签:#claude-scientific-skills #Github #量化工程 #Agent #数据分析 #量化投资 #云栈社区