数据时间:2026-03-03(ARC Prize 官方 leaderboard)

许多评测热衷于让模型参加考试、撰写文章或充当搜索助手。久而久之,评测结果越来越像一场“表达能力竞赛”:输出更长、逻辑链条写得更为华丽,往往就能获得更高评价。

然而,ARC Prize 的 ARC-AGI 榜单反其道而行,做了一件看似不讨喜却极具价值的事:它尽可能剥离模型的知识储备与语言技巧,将目光聚焦于一个更基础的问题——模型在面对前所未见的规则时,能否快速学习并正确应用,并且,这个过程中还要衡量成本。

如果我们把“AI能干事”理解为:任务格式变化、规则调整、输入输出方式改变后,系统依然能够稳定交付结果,那么 ARC-AGI 这类基准测试则提供了一个更接近现实需求的衡量标尺。它不考察你背下了多少百科全书,而是在测试你是否能像人类一样,从寥寥数个示例中领悟规则并实现迁移。

ARC Prize 是什么组织?这张榜单在测什么

ARC Prize Foundation 是一个非营利组织,主要致力于两项工作:维护 ARC-AGI 系列基准测试,并运营一个持续更新的排行榜。它在测试政策中表述得非常直白:这些基准旨在衡量 AI 能力的进展,而非宣布“AGI 已经到来或尚未到来”。

其方法论也十分明确:尽可能公开数据与工具,同时保留“半私有/全私有”评测集以降低数据泄漏与模型过拟合风险;此外还通过竞赛形式在约束环境下进行验证。之所以采取如此复杂的措施,原因在于,一旦评测集完全公开并被反复刷榜,模型与方法便会开始“适配题库”,最终测出的不再是能力本身,而是对特定题库的工程优化能力。

ARC-AGI-1 与 ARC-AGI-2:从“表现聪明”到“兼顾适应与效率”

ARC-AGI 是由 François Chollet 在 2019 年提出的一套“抽象与推理”任务体系。其最常见的直观形态是网格题:输入是一张用 0–9 表示颜色的方格图,系统会看到少量训练样例(输入与输出配对),要求从样例中归纳出隐含规则,并对新的测试输入生成正确的输出。

ARC-AGI-1 是最初的版本,后来被 ARC Prize 作为竞赛和长期基准延续下来。它的定位是考察机器的一般性归纳、抽象、推理与泛化能力——许多人将其视为衡量“流体智力”的代表性测试。

ARC-AGI-2 则是升级版本。ARC Prize 在排行榜的说明中明确了它的方向:系统需要同时展现出高适应性与高效率。这句话的现实含义是,并非“耗费巨额推理预算磨出答案”就能算数,而是要以可承受的计算资源,学会陌生规则并稳定地做出正确判断。

此外,ARC-AGI-2 的开源仓库给出了详细的数据结构信息:包含 1000 个公开训练任务、120 个公开评测任务;同时还有半私有与全私有测试集(不在仓库中),用于降低数据泄漏概率,并使难度校准到与公开评测的人类表现相当。

ARC-AGI 如何判定对错:不奖励漂亮话,只认结果

在 ARC-AGI-2 的定义中,“做对一道题”并非写出一段看似合理的解释,而是输出的网格必须与标准答案完全匹配。官方仓库对成功判据的关键点包括:

- 每个任务由训练集(示例输入/输出对)与测试集(测试输入)组成;

- 必须对该任务的所有测试输入都生成完全正确的输出,才算“解决该任务”;

- 每个测试输入允许进行 2 次尝试(此规则对人类与 AI 统一)。

这种判据天然偏向“可验证的交付”:结果非对即错。它不会因为模型输出了冗长且美观的推理链条而给予额外分数。

为何这张榜单更贴近“能否干活”:成本成为显性指标

ARC Prize 排行榜的一个关键设计在于:除了展示分数,还同步公布单任务成本。它将“性能-成本”关系以散点图形式呈现:不仅要做对,还要在合理的资源消耗下做对。

在同一张榜单上,你可以看到:

- Base LLM(基座模型):单次推理所展现的原始能力;

- CoT(思维链):同一模型在不同“思考档位”下的表现(通常思考越深入,成本越高);

- Refinement / Custom(精炼/定制系统):更偏向系统工程与专用求解器的方案。

这也意味着,如果一个系统需要极其昂贵的推理预算才能接近高分,那么它更像一种“实验室能力展示”;而如果一个系统能在很低的成本下取得不错的分数,则更接近于“可规模化的实用能力”。

全球顶尖水平:ARC-AGI-2 已出现得分70%-80%+的机器系统

首先看“天花板”:人类评审小组在 ARC-AGI-2 上的得分为 100%。

再看机器系统:榜单顶部的模型/系统已经将 ARC-AGI-2 的分数推高至 70%-80%+ 的区间。以下是按官方排行榜表格顺序截取的前五名(用于建立对全球水平的直观认识):

| 名次(ARC-AGI-2) |

系统 |

机构/作者 |

ARC-AGI-2 |

Cost/Task |

| 1 |

Human Panel |

Human |

100.0% |

$17.00 |

| 2 |

Gemini 3 Deep Think (2/26) |

Google |

84.6% |

$13.62 |

| 3 |

Gemini 3.1 Pro (Preview) |

Google |

77.1% |

$0.962 |

| 4 |

GPT-5.2 (Refine.) |

Johan Land |

72.9% |

$38.99 |

| 5 |

Claude Opus 4.6 (120K, High) |

Anthropic |

69.2% |

$3.47 |

同一列表中,既能看到 80%+ 的高分结果,也能观察到成本从每任务不足 1 美元到几十美元的巨大差异。ARC-AGI-2 的现实意义在此凸显:它不允许“只谈能力,不论代价”。

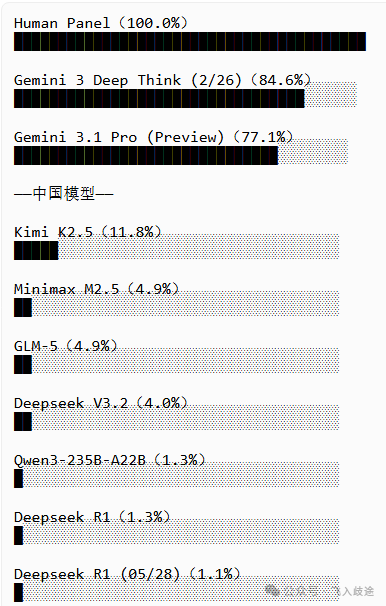

中国模型在 ARC-AGI-2 上的位置:最高11.8%,多数处于1%-5%

将焦点拉回到中国模型。以下为本文撰写时,从 ARC Prize 官方排行榜中汇总的所有中国相关机构条目。名次按官方表格自上而下排列;官方更新后排名可能发生变化。

| 机构 |

模型/系统(官方名称) |

类型 |

ARC-AGI-1 |

ARC-AGI-2 |

Cost/Task |

ARC-AGI-2 名次(约) |

| Moonshot AI |

Kimi K2.5 |

CoT |

65.3% |

11.8% |

$0.280 |

32 |

| Minimax |

Minimax M2.5 |

CoT |

63.7% |

4.9% |

$0.170 |

43 |

| Z.ai |

GLM-5 |

CoT |

44.7% |

4.9% |

$0.270 |

43 |

| Deepseek |

Deepseek V3.2 |

Base LLM |

57.0% |

4.0% |

$0.120 |

47 |

| Alibaba |

Qwen3-235b-a22b Instruct (25/07) |

Base LLM |

11.0% |

1.3% |

$0.004 |

70 |

| Deepseek |

Deepseek R1 |

CoT |

15.8% |

1.3% |

$0.080 |

70 |

| Deepseek |

Deepseek R1 (05/28) |

CoT |

21.2% |

1.1% |

$0.053 |

76 |

如果仅看“最高值”,当前中国上榜条目中 ARC-AGI-2 的最佳成绩是 11.8%(Kimi K2.5);其余大多集中在 1%—5% 的个位数区间。与之形成对比的是,全球头部系统已处于 70%—80%+ 的水平。

更值得注意的是成本侧:中国模型的整体成本并不高,甚至出现了极低的成本(例如 Qwen3-235b-a22b Instruct 标注为 $0.004/任务)。这里显现的落差似乎并非源于“算力堆砌不足”,而更像是模型在这种特定规则迁移任务上的能力结构尚未对齐。

榜单投射的现实:差距不在“表达”,而在“迁移”

ARC-AGI-2 的任务形式决定了它对“语言表达能力”几乎不予理睬:最终只判断网格输出是否正确。因此,它对规则迁移能力的考察,比许多传统榜单更为直接和严苛。

在这种测量方式下,当前中国上榜模型整体呈现出三个关键信息:

- 在成本方面并不处于劣势,甚至存在极低成本条目;

- 在 ARC-AGI-1 上的分数尚可,但到了 ARC-AGI-2 普遍骤降至个位数甚至 1% 左右;

- 与全球头部 70%—80%+ 的分数区间相比,存在着数量级上的明显差距。

从“实际干活”的角度来理解,这类差距最容易出现在何种场景?当规则全新、格式陌生、输入输出必须严格结构化且可验证时——例如处理一种新型表单、遵循一套新流程、或在全新约束下执行批处理任务。一旦任务无法依靠“说得像模像样”来蒙混过关,模型底层的抽象与迁移能力便会经受放大镜般的检验。这不仅仅是模型规模或数据量的问题,更涉及到核心算法与推理架构的创新。

这张榜单提醒我们,在追求模型“能说会道”的同时,或许更需要关注其解决未知、结构化问题的硬核能力。对于关心技术前沿的开发者而言,持续追踪此类基准,参与相关的开源实战与讨论,是理解人工智能发展真实脉搏的重要途径。欢迎在云栈社区继续交流相关见解。

信息来源