3月3日,阿里巴巴一口气开源了千问(Qwen)3.5系列的四款全新小尺寸模型。这四款模型分别是 Qwen3.5-0.8B、Qwen3.5-2B、Qwen3.5-4B 和 Qwen3.5-9B。

最小的 0.8B 和 2B 版本,模型体积极小,推理速度非常快,非常适合移动设备、IoT 边缘设备部署,以及对延迟要求极高的实时交互场景。

而 4B 版本则是一款性能强劲的轻量级模型,适合作为轻量级 Agent 的核心大脑,在性能与资源消耗之间取得了不错的平衡。

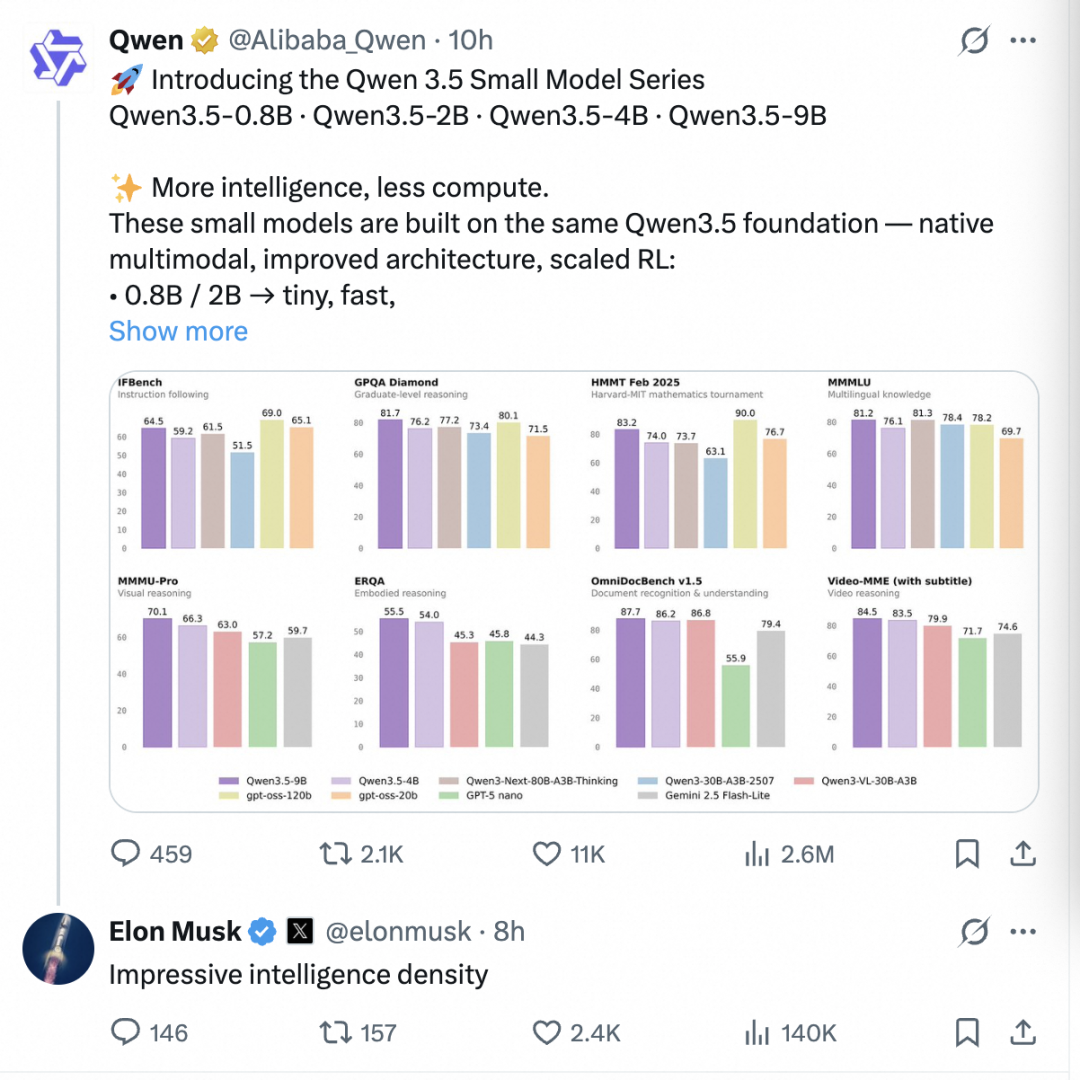

9B 版本更是拥有媲美 GPT-OSS-120B 等更大模型的性能,适合那些需要较高智力水平但显存资源有限的服务器端部署场景,堪称性价比极高的通用模型选择。

这四款新发布的 Qwen3.5 模型虽然尺寸小巧,但都继承了该系列的原生多模态能力,在极小的参数量下实现了显著的性能跃升。这一动态在 AI社区 迅速引发了广泛关注,连埃隆·马斯克(Elon Musk)也很快在社交媒体上点赞并评论,称阿里千问模型拥有“令人印象深刻的智能密度(Impressive intelligence density)”。

千问(Qwen)是目前公认的世界最强开源模型之一,其版本已经迭代至 3.5 系列。就在刚刚过去的除夕,千问开源了 3.5 系列的首款模型 Qwen3.5-397-A17B,其参数量虽不到4000亿,但性能已超越万亿参数的 Qwen3-Max 模型,且部署成本大幅下降。

上周,千问又开源了 3.5 系列的中型尺寸模型,包括 Qwen3.5-122B-A10B、Qwen3.5-35B-A3B 和 Qwen3.5-27B,这些模型的性能可媲美 GPT-5,并且能在消费级显卡上运行。而这次新开源的 4 款小尺寸模型,则延续了“以小胜大”的策略,凭借精巧的尺寸实现了卓越的智能水平。

至此,千问 3.5 家族已累计开源了 8 款模型。它们均以更少的参数实现了“跨级”的性能超越:小尺寸模型能媲美中型模型的性能,而中型尺寸的模型则拥有接近顶级模型的智能水平。这正是马斯克所提及的“智能密度”的直观体现。

整个千问家族迄今已开源超过 400 款大模型。每个系列不仅包含不同尺寸的语言模型,还涵盖了编程、数学、语音、视觉理解、图像生成等多种类型的模型。这种“全尺寸”+“全模态”的开源策略,深受全球开发者欢迎。无论是个人开发者还是企业用户,都能根据自身需求和具体场景,找到一款适配的千问大模型。

不久前开源的千问 3.5 大型及中型系列模型,已经成功包揽了 HuggingFace 全球开源模型榜单的前四名。千问正在成为越来越多企业的 AI 基座。这股“千问旋风”也早已席卷硅谷,除了马斯克,包括英伟达 CEO 黄仁勋、谷歌前 CEO 埃里克·施密特、Airbnb CEO 布莱恩·切斯基以及 Perplexity CEO 阿拉温德·斯里尼瓦斯等科技领袖,都曾在不同场合公开称赞过千问模型的表现。

从庞大的基础模型到极致轻量的小模型,千问的开源图谱日益完善,为不同场景的 AI 应用提供了丰富的选择。对于开发者而言,这无疑是个好消息。如果你想了解更多关于前沿 AI 技术和开源项目的深度讨论,欢迎来云栈社区交流分享。 |