旧金山霍华德街,Anthropic总部外的人行道上布满了粉笔涂鸦,写着“上帝爱Anthropic”。

大约三公里外,OpenAI总部外是相似的景象,只不过粉笔字的内容大不相同:“拿出合同来。”“也许是时候辞职了?”

最具标志性的,是有人用粉笔在人行道上画上长长的“红线”,围住了总部建筑,这直接指向了美国国防部(DoD,原文为DoW)与Anthropic之间争议的核心。

一切始于Anthropic坚持的两条“红线”——禁止用于自主武器与大规模监控——这直接导致了其与国防部的合同谈判破裂。以此为导火索,一场在AI巨头OpenAI、Anthropic和马斯克的xAI之间的“三国杀”正式拉开帷幕。

马斯克带着xAI迅速表态愿意接盘,而OpenAI的Sam Altman则上演了一出先公开支持、后迅速“背刺”的戏码。

就在今天,根据The Information的爆料,当地时间周五早晨,OpenAI刚宣布与国防部达成合作,下午,Anthropic的CEO达里奥·阿莫迪(Dario Amodei)就给全体员工发送了一份长长的内部备忘录,措辞严厉地抨击OpenAI向公众兜售“谎言”。

AI正在深度改变现代战争的形态。在近期的一些军事行动中,包括美国中央司令部在内的多个指挥机构都在使用Anthropic的Claude模型进行情报评估、目标识别和模拟战斗场景。尽管高层已明令停止与Anthropic的合作,但一线部队的依赖程度可见一斑。

作为首家与国防部展开“机密”级别合作的AI公司,Anthropic模型的完全撤出预计需要长达半年的过渡期。路透社的消息称,投资Anthropic的英伟达、亚马逊等科技巨头已表示担忧,一些有影响力的投资者也在试图斡旋,缓和双方矛盾。

在这半年里,一切皆有可能:Anthropic与国防部的关系能否缓和?OpenAI的公众形象能否扭转?xAI又是否能真的如愿开展机密合作?变数依然存在。

01 OpenAI:心系天下还是“撒谎精”?

一份最新曝光的Anthropic内部备忘录,似乎掀开了OpenAI的遮羞布。阿莫迪在备忘录中措辞辛辣,毫不留情。

让我们先快速回顾一下事件脉络。

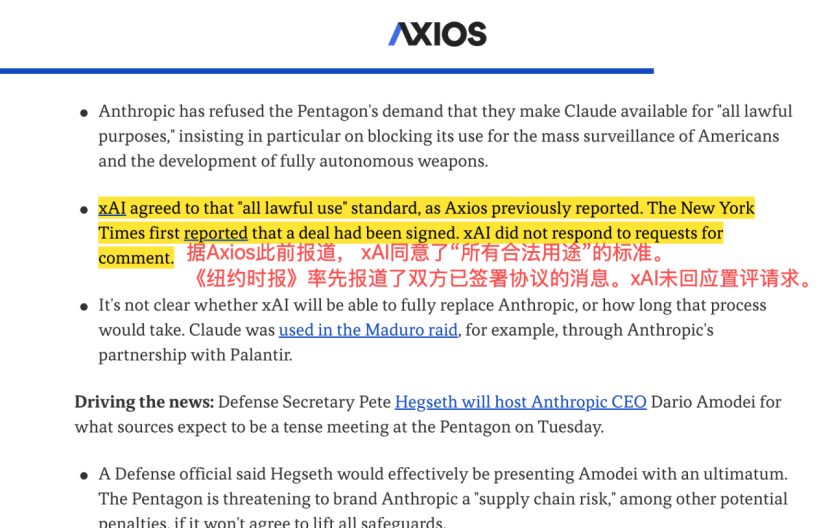

冲突的核心,是Anthropic与国防部之间一笔价值2亿美元的合约谈判破裂。国防部要求增加一个条款,允许其对AI模型进行“所有合法使用”。但Anthropic坚持附加两个前提条件:一,不用于开发或部署完全自主的武器系统;二,不用于对美国民众进行大规模监控。

矛盾公开化后,特朗普政府下令停止与Anthropic的合作,国防部高层也公开指责Anthropic“自以为是”。在这个阶段,OpenAI高调站出来,公开支持Anthropic的立场, 并声称两家公司在原则问题上是一致的。这一举动当时为OpenAI赢得了不少赞誉,被视为商业竞争对手在重大伦理问题上能够统一战线的佳话。

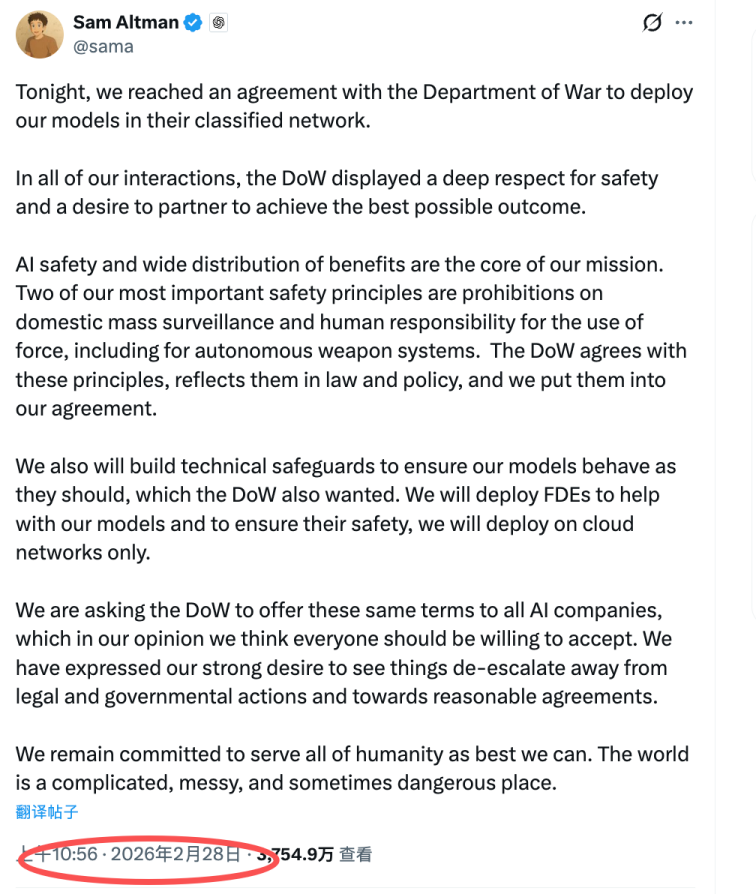

然而,局势在上周五发生突变。奥特曼突然在X(原Twitter)上宣布,OpenAI已与国防部达成协议,将在机密网络内部署其模型。简而言之,就是取代Anthropic的位置。

消息一出,舆论哗然。

奥特曼不仅在X上开设问答帖,还补发了一条长文进行解释。但他给出的信息复杂且模糊:一方面,OpenAI似乎接受了国防部的“所有合法用途”条款;另一方面,他又坚称双方在“两条红线”上达成了共识,并声称将通过设置“安全栏”、派驻专人监督等技术与管理措施来确保底线。

奥特曼甚至反复强调,OpenAI与国防部达成协议,是为了整个行业好,意在缓和Anthropic与国防部之间的紧张关系。

但这套说辞难以平息公众的质疑与愤怒,许多人认为奥特曼只是在玩文字游戏。于是,便出现了本文开头描述的景象——OpenAI办公楼外布满了抗议性的涂鸦。

然而,就在奥特曼疲于应对舆论之时,The Information反手贴出了阿莫迪发送给员工的内部备忘录,内容可谓狠狠打了奥特曼的脸。

这封备忘录的发送时间,正是奥特曼官宣合作的同一天。开篇第一句就定下基调:“我想非常明确地谈谈OpenAI目前释放出来的信息,以及其中的虚假和误导性。”

备忘录内容很长,既包含对OpenAI与国防部合作具体方式的技术性质疑,也包含对奥特曼个人的直接攻击。

我们先看阿莫迪的技术性质疑。

他指出,OpenAI的做法表面上是接受“所有合法用途”条款,但附加一层“安全栏”进行约束。然而,阿莫迪认为这种方法可能只有20%的实际效果,剩下80%都是一种“安全表演”。

原因有二:

第一,模型的知识是有限的。 例如,模型本身无法感知在整个武器系统中是否存在“人类在环”(human-in-the-loop)监督,因此无法判断其输出是否被用于自主武器。同样,它也无法判断所处理的数据是否来源于大规模监控。所谓的“安全栏”管不到模型接收信息之外的事情。

第二,依赖模型自我“拒绝”是不可靠的。 对于Transformer架构的大语言模型而言,“越狱”和提示词注入攻击的普遍性,资深AI用户都心知肚明。

阿莫迪还提到,派驻员工进行现场监控的方案,Anthropic早就提出过,但他们清楚这仅在极少数特定场景下有效,并非什么值得夸耀的万能措施。

备忘录中还提到了国防部机密部署中的关键合作伙伴Palantir(一家数据挖掘公司,美军Maven系统的主要开发者)。阿莫迪猜测,OpenAI所谓的“安全栏”方案可能就来自Palantir。如果是这样,情况更糟,因为Palantir曾向Anthropic推销过类似方案,而阿莫迪认为那纯粹是为了安抚AI公司员工和公众的“面子工程”。

除了技术性质疑,阿莫迪的“人身攻击”更为直接。

在这封备忘录中,他用来形容奥特曼的词汇包括:虚假、误导、撒谎、操纵……他直接呼吁员工“识别奥特曼的行为模式”。

阿莫迪推演了整个事件:奥特曼先公开支持Anthropic的“红线”,占领道德制高点,为塑造自己“为全行业谋福祉”的形象做铺垫;但实际上,他早已暗中和国防部谈判,准备随时取而代之。

他之所以能成功,是因为双方一拍即合:Anthropic拒绝的“安全表演”,奥特曼接受了;国防部则愿意提供一些之前拒绝给Anthropic的条款,并协助“安抚”OpenAI的内部员工。

至于国防部为何对奥特曼青睐有加?阿莫迪给出的理由更为露骨:奥特曼拥有无与伦比的优势——他曾向特朗普提供政治捐款,并公开对其表示赞赏。

总结起来,阿莫迪认为:奥特曼愿意当“舔狗”而Anthropic不愿意,所以Anthropic输了。 他甚至猜测,奥特曼可能在谈判过程中煽风点火,加剧了国防部与Anthropic的矛盾。

阿莫迪指出,奥特曼的公开声明看似伟光正,但字里行间暗含Anthropic“不够灵活、不讲道理、难以合作”的潜台词。他认为这不是无心之失,而是典型的“煤气灯效应”,是奥特曼在操纵公众认知。

02 “三国杀”背后的“三角恨”

最有趣的是,作为Anthropic的CEO,阿莫迪在给自家员工的备忘录结尾,却这样解释自己的动机:“我真正关心的是:确保这种(虚假)叙事不要影响OpenAI的员工。”

阿莫迪很清楚,在激烈的竞争中,什么都可以失去,但不能失去AI人才的心。OpenAI、Anthropic、xAI围绕国防合约的“三国杀”已经打响,但这远不止一纸合同那么简单。

耐人寻味的是,当前舆论的谴责中心是OpenAI和奥特曼,而非xAI和马斯克。

要知道,在Anthropic与国防部矛盾公开后,第一个被确认将“接替”其角色的正是xAI。

而且马斯克对此毫无掩饰。他长期以来就对Anthropic和阿莫迪持批评态度。当国防部长在X上大骂阿莫迪“虚伪”时,马斯克在评论区直接附和:“Anthropic憎恨西方文明。”

他的立场,可以说是一目了然、不加掩饰的。

所以,如果说公众担忧的是硅谷AI公司抛弃其“不作恶”的价值观,蜕变为新时代的“军火商”,那么xAI和马斯克似乎才是更符合这一“反派”印象的选手。

在Anthropic不惜为“红线”与国防部交恶时,xAI只是耸耸肩说:“它不做,那就我来做。”

然而,正是这样的“反派”,却几乎被舆论放过了。

于是,一个“只有OpenAI受伤”的世界暂时达成了:

- Anthropic 失去了国防部合约,并可能被列入“供应链风险”名单,但其公司声誉和CEO阿莫迪的个人声誉达到了顶峰,用户用行动(如将其App推上苹果商店榜首)表达了支持。

- xAI 不费吹灰之力获得了顶替Anthropic的机会,且名誉未受明显损害。

- OpenAI 虽然也拿到了合约,但付出了巨大的声誉代价,内部员工和外部公众的信任均遭遇危机。

原因或许很简单——Anthropic求“义”,马斯克要“利”,而奥特曼试图“名利双收”。

如果考虑到这三家AI明星创业公司之间盘根错节的关系,以及它们目前共同面临的关键节点,这场争斗就显得更加意味深长。

马斯克、奥特曼以及阿莫迪之间,存在着持续多年的“三角恨”。

简单来说,马斯克和奥特曼同为OpenAI的联合创始人,而阿莫迪曾是OpenAI的早期核心员工。后因理念不合,马斯克退出OpenAI,阿莫迪也离职创办了Anthropic。这一切都发生在ChatGPT引爆全球之前。ChatGPT成功后,马斯克对OpenAI和Anthropic都颇有微词,最终自己创立了xAI。

OpenAI、Anthropic、xAI走出了三条截然不同的技术路线,也塑造了三种鲜明的“人设”:

- OpenAI 代表通用化路线,追求规模、能力与商业生态的全面铺开。

- Anthropic 强调安全、可控与边界,其Claude模型以克制、理性著称,尤其在AI编程和智能体(Agent)领域表现出色。

- xAI 则主打“自由表达”,其Grok模型深度嵌入X社交生态,带有强烈的马斯克个人风格。

而今年,三家公司不约而同地来到了同一个大门前——筹备纳斯达克上市。据多家媒体报道,OpenAI、xAI、Anthropic均已进入IPO准备阶段。马斯克更是已将xAI与SpaceX合并,创造出估值可能超过1.25万亿美元的巨无霸。

这是硅谷当下估值最高、最具影响力的三家AI独角兽。上市前夕,它们几乎同时与国防部扯上关系,这绝非巧合。一份稳定的、长期的政府合约,能为IPO故事提供至关重要的“确定性”叙事。

03 当AI深度嵌入现代战争

抛开纷争,一个确定的事实是:AI正在以前所未有的深度和速度改变现代战争。

美军广泛使用的Maven智能系统由Palantir开发,能从海量机密数据中提取信息。目前,嵌入在该系统核心的,正是 Anthropic的Claude模型。

《华盛顿邮报》报道称,在过去一年中,Claude与Maven的结合已日趋成熟,成为多个军方部门的日常工具。在最近的军事行动中,这套系统提出了数百个潜在打击目标,给出精确坐标并进行优先级排序,将原本需要数周完成的战役规划压缩到近乎实时。

指挥官们已经对这一AI系统形成了高度依赖。乔治城大学的研究显示,Maven系统能使一支20人的团队完成以往需要2000人才能完成的工作。

这意味着,对于这些顶级AI公司而言,国防部订单不仅是模型能力的延伸应用,更标志着公司身份和角色的转变。它们正从“前沿的模型训练与算法创新者”,转向成为国家关键基础设施的“基础能力提供者”。

这类合作意味着更稳定的收入、更高的壁垒,但也伴随着更严格的审视、更大的争议和风险,尤其在IPO的敏感时期。

奥特曼在声明中试图扮演“行业调停者”和“规则制定者”的角色。但正如他自己所说,一切以结果论。成功了,就是高瞻远瞩的“天才”;失败了,便可能沦为众人口中的“小丑”。

目前,Anthropic表示已准备好进行长达半年的“交接”工作,协助国防部的新合作伙伴接入系统。同时,他们誓言将就“供应链风险”名单一事,在必要时诉诸法律。

半年的过渡期,充满了变数。

《华尔街日报》报道,xAI的Grok模型被允许用于机密范畴,已令部分官员感到不安。美国总务署的一份测试报告认为,即使有限使用Grok,也需要极其严格的安全监督,否则将带来“难以管理的安全风险”。

另一方面,将Anthropic列入“供应链风险”名单的潜在影响,已引发其众多合作伙伴(包括科技巨头)的担忧。这一决定的波及范围尚不明确。

这场争议的影响力远超一纸合同。舆情,是三方在厮杀时必须慎重考量的变量。

彭博社称,阿莫迪近期透露,Anthropic的年化营收规模已达到190亿美元,增长迅猛。OpenAI、Anthropic、xAI,这场围绕AI安全红线、商业利益与地缘政治的复杂博弈,最终谁能真正赢得国防部的深度信任,抑或谁能全身而退,依然是一个巨大的未知数。

这场顶尖AI公司间的角逐,不仅是商业竞争,更关乎技术伦理的未来走向。对于整个人工智能行业和开发者社区而言,这其中的技术细节、安全框架设计与商业博弈,都值得深入探讨。想了解更多关于AI前沿技术、模型安全与产业动态的深度分析,欢迎关注云栈社区的相关讨论。