最近在模拟面试时,一位同学被问到了这样一个问题:“你知道什么是 MCP 协议吗?” 这让他一时语塞。今天就和大家深入聊聊这个由 Anthropic 提出的、旨在解决 AI 应用碎片化问题的 Model Context Protocol。理解了它,也许能让你在下次 技术面试 中多一份底气。

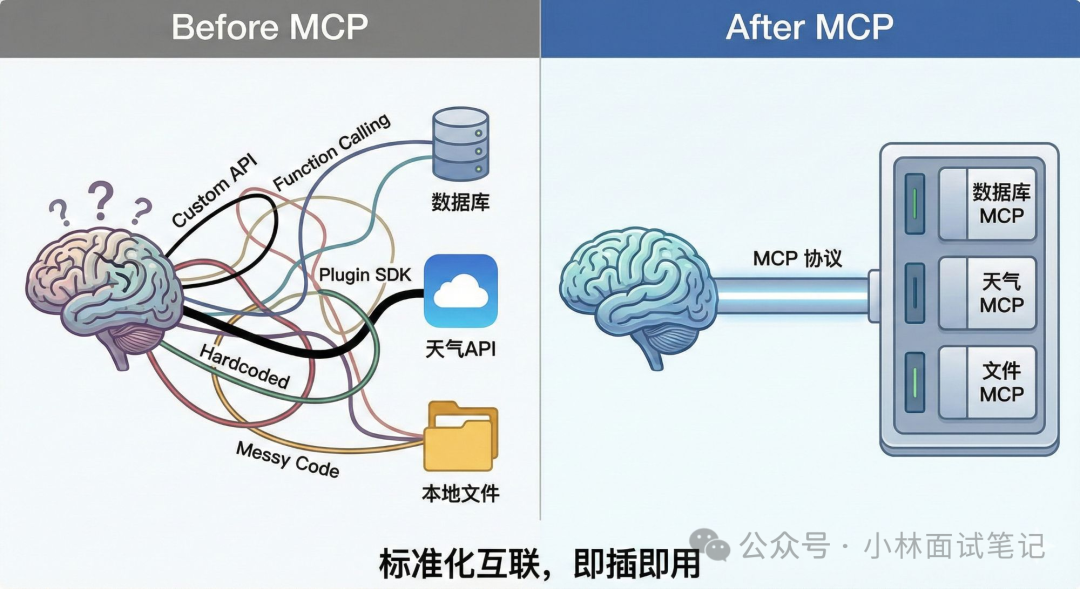

要理解 MCP 的价值,我们得先看看它要解决什么问题。

现在我们开发 AI 应用,特别是 Agent 类的应用,经常需要让大模型调用各种外部工具,比如搜索引擎、数据库或者 API 接口。但痛点在于,各家厂商的接口规范和数据格式五花八门。OpenAI 有自己的 Function Calling 格式,Claude 有 Tool Use,Google 的 Gemini 又是另一套。这导致开发者需要编写大量繁琐的“胶水代码”和适配层,维护成本极高。

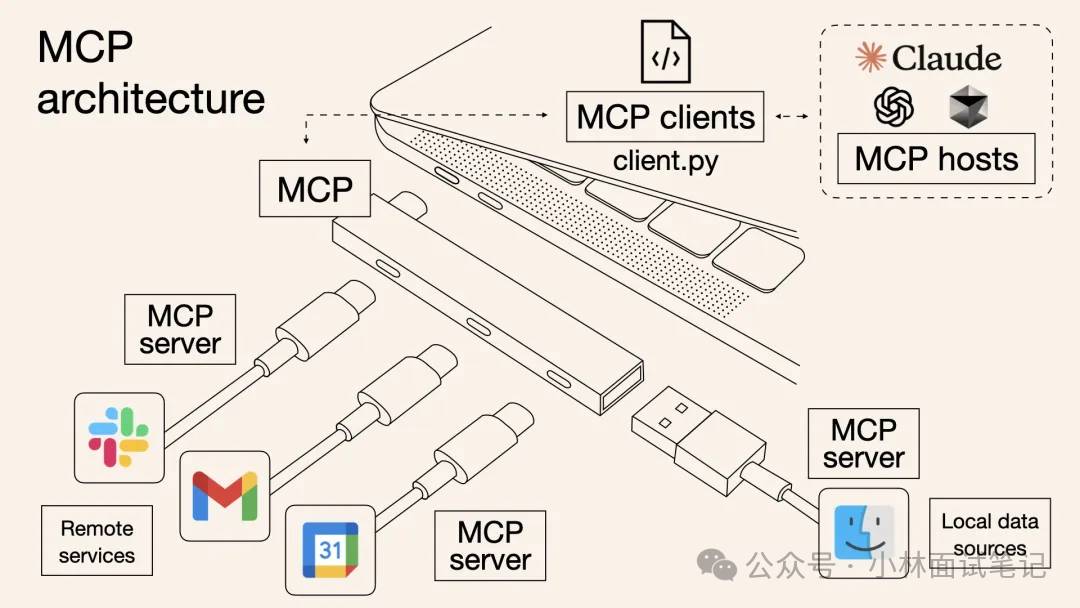

MCP (Model Context Protocol) 正是在这个背景下诞生的。它的目标是成为 AI 领域的“USB 接口标准”,为模型、工具和数据源之间定义一个统一的通信协议。

简单来说,MCP 试图让不同的 AI 系统、外部服务和数据源能够通过一套标准化的协议来交互,从而提升整个生态的互操作性,让开发者不再需要重复造轮子。

MCP 的核心概念与架构

“Model Context Protocol”这个名字很有深意。“上下文”一词强调,MCP 不只关注单次的工具调用,更着眼于在整个对话或任务执行过程中,如何持续、稳定地在模型与外部世界之间传递信息。你可以把它想象成专为 AI 应用设计的“HTTP 协议”。

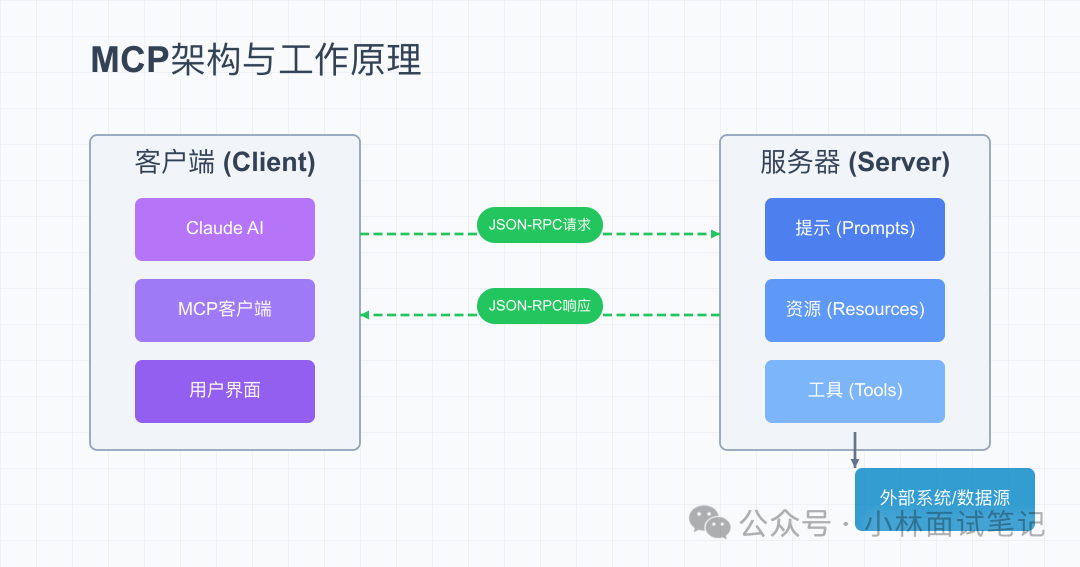

MCP 采用经典的 Client-Server(客户端-服务器) 架构:

- Server 端:作为能力提供方。它可以是你的企业数据库、文件系统或任何 API 服务,只要它们实现了 MCP 协议来暴露自身能力。

- Client 端:通常是 AI 应用或大模型本身。它通过 MCP 协议来发现并调用 Server 端提供的资源。

这种设计实现了良好的解耦:资源提供方(Server)无需关心具体是哪个模型在使用它;而模型(Client)也无需为每种资源编写专门的适配代码。

MCP 协议的核心组件

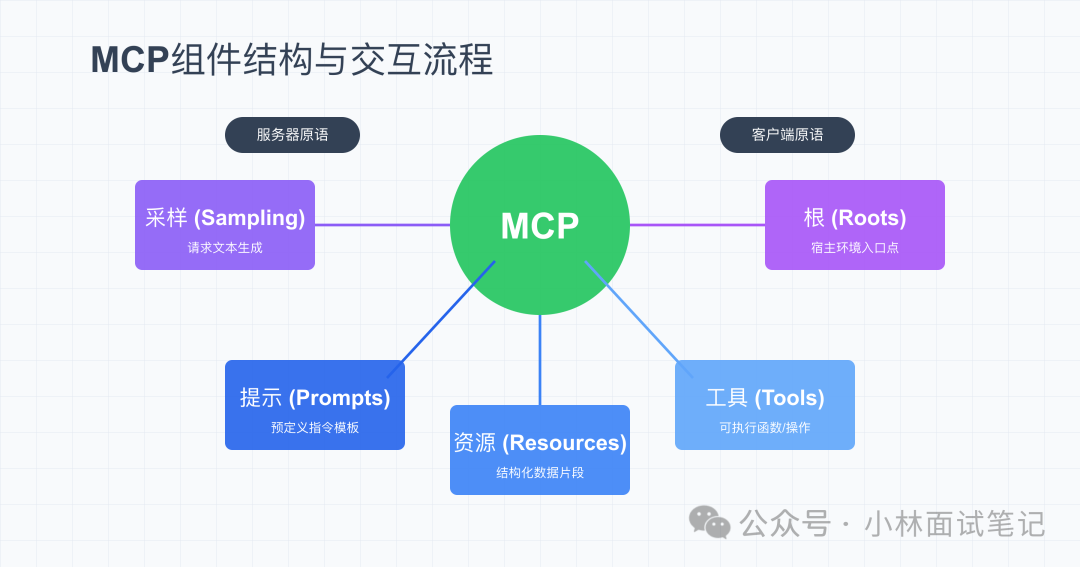

MCP 协议定义了三个核心的原语(Primitive),用于标准化交互内容:

-

Resources(资源)

指代可供访问的结构化数据片段,例如一份文档、一条数据库记录或一个 API 端点。MCP 用统一的方式描述这些资源的元信息(如 URI、名称、描述、MIME 类型)和访问方式。

-

Tools(工具)

类似于传统 Function Call 中的“函数”,但定义更加标准化。每个工具都需要明确其名称、描述、输入参数的模式(Schema)以及返回值的格式。这使得 AI 模型能够以统一、可预测的方式调用任何实现了 MCP 的工具。

-

Prompts(提示)

MCP 甚至允许 Server 端提供预定义的提示词模板。Client 端可以直接使用这些模板来构造请求,确保了提示工程的一致性和最佳实践的可复用性。

从混乱到标准:MCP 的价值体现

让我们通过一个例子来体会 MCP 带来的改变。

假设你有一个企业数据库,存放着客户信息和订单数据。你希望 AI 助手能查询这些数据。

在没有 MCP 的情况下:

你需要为这个数据库专门开发一套后端服务,定义 REST API 接口,实现认证逻辑,编写数据转换代码。然后,在每个 AI 应用(比如一个基于 Claude 的客服 Agent 和一个基于 GPT 的数据分析助手)中,分别编写适配代码来调用你的 API。这是一个典型的 M x N 集成问题,复杂且难以维护。

在使用 MCP 的情况下:

你只需要实现一个 MCP Server,让它以标准化的方式声明自己提供了哪些资源(如 database://customers)和工具(如 query_customers)。伪代码逻辑如下:

# MCP Server端实现(伪代码示意)

class DatabaseMCPServer:

def list_resources(self):

# 声明这个Server提供的资源

return [

{

"uri": "database://customers",

"name": "客户数据库",

"description": "包含所有客户的基本信息",

"mimeType": "application/sql"

}

]

def list_tools(self):

# 声明这个Server提供的工具

return [

{

"name": "query_customers",

"description": "查询客户信息",

"inputSchema": {

"type": "object",

"properties": {

"customer_id": {"type": "string"},

"fields": {"type": "array"}

}

}

}

]

def call_tool(self, tool_name, arguments):

# 执行具体的工具调用

if tool_name == "query_customers":

return self.query_database(arguments)

而在你的 AI 应用(Client端)中,代码变得异常简洁:

# MCP Client端使用(伪代码示意)

client = MCPClient("database-server")

# 自动发现Server提供的工具

available_tools = client.list_tools()

# 让AI模型知道有这些工具可用

response = model.generate(

prompt="查询客户ID为12345的订单历史",

tools=available_tools

)

# 如果模型决定调用工具

if response.tool_calls:

for tool_call in response.tool_calls:

result = client.call_tool(

tool_call.name,

tool_call.arguments

)

这里的关键价值在于标准化。任何实现了 MCP 协议的 Server,其暴露能力的方式都是统一的。Client 端无需为每个 Server 编写专用适配代码。未来如果你想更换 AI 模型(例如从 Claude 换到 GPT-4),只要新模型支持 MCP 协议,你的后端基础设施就完全无需改动。这极大地降低了系统的耦合度与维护成本。

MCP 的高级特性与设计思想

除了基本的资源与工具发现、调用,MCP 还支持双向通信。这意味着 Server 可以主动向 Client 推送信息,例如数据更新通知或状态变更,这对于需要实时交互的场景至关重要。协议本身也设计了完善的错误处理、权限控制以及多轮对话状态管理机制。

从架构设计的角度看,MCP 体现的是一种“面向协议编程”的思想。它并非要取代现有的 Function Call 或 Tool Use 等具体实现,而是在它们之上定义了一层抽象,让不同的实现能够互通。这种思路在软件工程中很常见,例如 JDBC 让 Java 程序能用统一的方式访问不同的数据库,MCP 也旨在为 AI 生态达成类似的效果。

总结

MCP 协议的核心目标,是解决 AI 应用与外部世界连接时的碎片化与重复劳动问题。通过定义一套标准化的通信协议,它将工具、资源的提供者(Server)与消费者(Client)解耦,实现了“一次开发,处处可用”。

对于开发者而言,掌握 MCP 不仅意味着多掌握一项前沿技术,更代表你理解了构建可扩展、易维护的 AI 应用架构的关键。它不仅是面试中的一个知识点,更是未来设计和开发复杂 AI Agent 系统时,绕不开的一个重要标准。如果你想了解更多关于协议设计和标准化接口的 技术文档,可以持续关注云栈社区的相关讨论。