最近,一个名为 OpenClaw(俗称“大龙虾”)的 AI 项目在技术圈内引发了不小的关注。它不仅是一个开源框架,更因能够直接在本地执行复杂的系统操作而备受瞩目。今天,我们就来深入探讨一下 OpenClaw 究竟是什么,它与我们熟知的普通大模型有何本质区别,以及在拥抱其强大能力时需要注意哪些核心风险。

一、OpenClaw(大龙虾)是什么?

OpenClaw(大龙虾)是一款本地优先、开源、可自主执行任务的 AI 智能体框架。它的核心目标是将用户的自然语言指令直接转化为电脑上的实际操作,实现“一句话让 AI 替你干活”,而不仅仅停留在对话和回答的层面。

基本信息

- 开发者: 奥地利程序员 Peter Steinberger(PSPDFKit 创始人)

- 开发语言:

TypeScript

- 开源协议: MIT(完全开源、可自由定制)

- 曾用名: ClawdBot → Moltbot → OpenClaw(2026 年 1 月 30 日定名)

- 核心定位: 数字执行官 / 本地 AI 执行者,而非聊天机器人

核心特性(区别于普通 AI)

- 本地部署,隐私可控: 运行在你的电脑或服务器上,数据与记忆不离开本地,支持沙箱或完整权限模式运行,这为数据安全提供了更多保障。

- 全系统操作权限: 拥有 Shell 级访问权,可直接操控文件、终端、浏览器、鼠标键盘,执行代码、部署服务。

- 自主任务闭环: 支持“一句话下达目标 → 自动拆解 → 执行 → 纠错 → 完成”的完整流程,无需用户反复交互引导。

- 多模型兼容: 支持 Claude、GPT、DeepSeek、Qwen 及本地开源模型作为其“大脑”,用户可以根据需要灵活切换。

- 持久记忆与主动工作: 能够记住你的偏好与上下文,支持定时任务、后台监控、异常预警,理论可 7×24 小时不间断运行。

- 模块化技能: 提供官方及社区技能商店,可一键安装邮件处理、日历管理、代码生成、网络爬虫、报表制作等专项能力。

- 子智能体协同: 主智能体可调用多个子 AI 进行分工协作,共同处理复杂的多步骤任务。

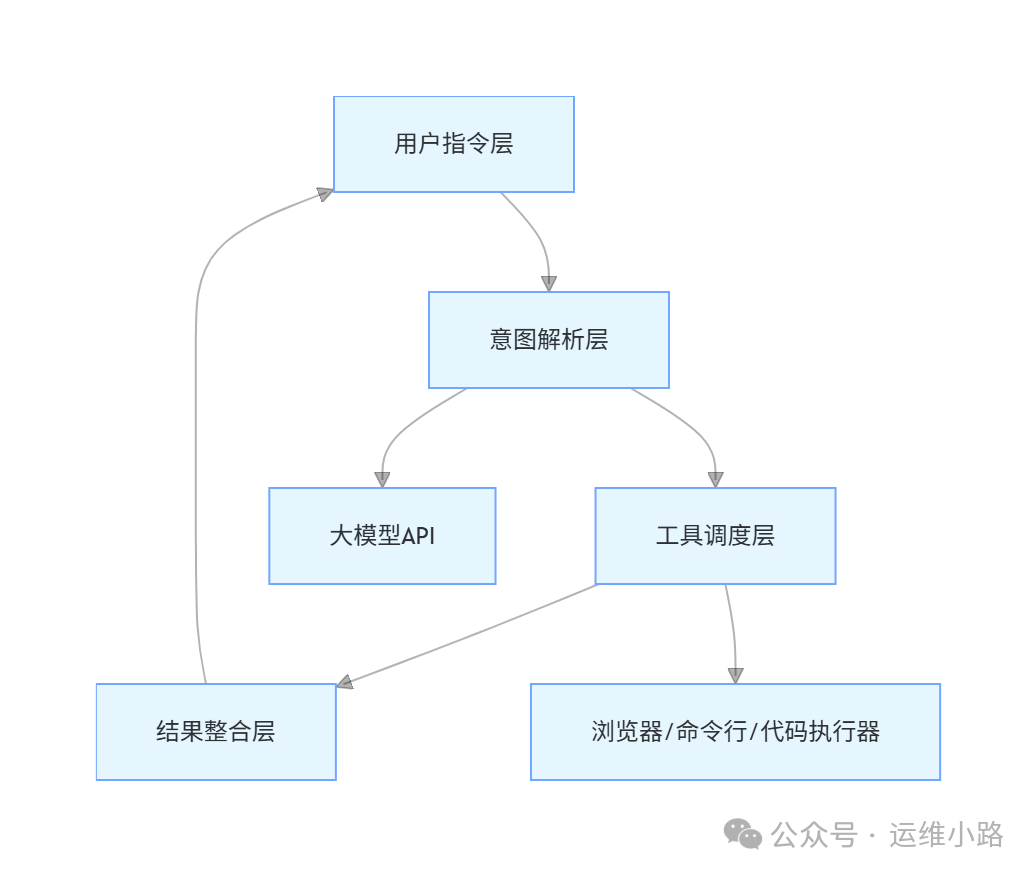

为了更直观地理解其工作原理,下图展示了 OpenClaw 的一个典型系统架构:

其工作流程通常涉及以下几个核心模块:

| 模块 |

功能 |

依赖 |

示例 |

| 意图解析层 |

把用户自然语言指令拆解为「可执行任务」 |

大模型(如通义千问等) |

用户说「查服务器内存使用」→ 拆解为「执行 free -h 命令」 |

| 工具调度层 |

调用具体工具执行拆解后的任务 |

系统命令、浏览器、Python 环境 |

执行 ssh root@192.168.1.100 free -h |

| 结果整合层 |

把工具执行结果转化为自然语言回复 |

大模型 |

把 free -h 的输出整理为「服务器总内存 16G,已使用 12G,使用率 75%」 |

二、OpenClaw 与传统 AI 的关键区别

它与普通的大模型聊天助手有何不同?我们可以从以下几个维度进行对比:

| 维度 |

OpenClaw(大龙虾) |

普通聊天 AI(如 GPT) |

| 定位 |

执行者(动手) |

思考者 / 问答者(动口) |

| 权限 |

本地系统全操作 |

云端沙箱,无法操作本地 |

| 交互 |

单次指令,自主完成 |

多轮对话,人工引导 |

| 数据 |

本地存储,隐私性强 |

云端处理,隐私性较弱 |

| 工作模式 |

主动、后台、7×24 |

被动响应,即时交互 |

三、核心风险分类与具体表现

赋予 AI 如此强大的系统操作权限,必然伴随着相应的风险。以下是部署和使用 OpenClaw 时需要重点关注的几类风险。

1. 权限过大风险(最高优先级)

- 风险本质: OpenClaw 可直接执行系统命令(如

rm、systemctl、chmod),若以 root 用户运行,一旦指令错误或被恶意利用,会直接导致系统瘫痪或数据丢失。

- 具体表现:

- 大模型误解析指令,将 “删除某个日志文件” 翻译成

rm -rf /var/log/nginx/error.log,但因参数或路径错误变成 rm -rf /(删除根目录)。

- 执行 “修改 MySQL 配置” 时,误改核心参数(如

datadir),导致数据库服务无法启动。

- 影响范围: 服务器宕机、关键数据丢失、系统配置损坏,后续故障排查和恢复成本极高。

2. 大模型指令误判风险

- 风险本质: 作为核心的大模型对运维或开发指令的理解可能存在偏差,尤其在处理模糊需求、需要复杂条件判断的场景时,容易生成错误或具有高危险性的命令。

- 具体表现:

- 用户指令 “清理磁盘空间”,大模型可能生成

find / -type f -size +10G -delete 这样的命令,误删重要的数据库文件或系统核心文件。

- 用户指令 “重启异常服务”,大模型未能准确识别目标服务,错误地重启了

sshd 服务,导致所有远程连接中断。

3. 模型依赖与可用性风险

- 风险本质: OpenClaw 的任务拆解与结果汇总完全依赖外部大模型的 API 服务,模型侧的任何故障或不稳定都会直接导致 OpenClaw 失效。

- 具体表现:

- 执行“分析 nginx 访问日志”任务时,因大模型 API 达到限流或被临时禁用,任务直接中断。

- 大模型版本更新,其指令输出格式发生变更,导致 OpenClaw 无法正确解析,从而生成无效或错误的操作指令。

- 影响范围: 自动化运维任务中断,尤其在监控告警、应急排障等对时效性要求高的场景下,会严重影响运维响应效率。

4. 数据泄露风险

- 风险本质: OpenClaw 为理解上下文和生成命令,需要将服务器上的敏感数据(如命令原始输出、日志片段、配置文件内容)发送给云端大模型进行解析,这存在潜在的数据泄露隐患。

- 具体表现:

- 执行 “分析数据库慢查询日志” 时,日志中可能包含的账号、密码、真实业务数据被一并发送至第三方大模型服务器。

- 执行 “查看系统用户列表” 时,

/etc/passwd 文件的内容被上传,导致服务器用户信息泄露。

- 合规风险: 对于金融、政务、医疗等受严格数据安全法规监管的行业场景,此类风险可能直接导致合规违规。

5. 无浏览器环境的功能局限风险

- 风险本质: 在无图形界面或未配置浏览器自动化驱动(如 Puppeteer)的环境下,OpenClaw 无法处理需要与动态网页交互的任务,且可能因工具调用失败而报出令人困惑的错误。

- 具体表现:

- 用户指令 “爬取云厂商控制台的服务器监控图表数据”,因环境缺少浏览器驱动,任务无法执行,并可能返回与真实原因不符的错误信息。

综上所述,OpenClaw 代表了一种更激进、更强大的 AI 应用形态,它将 AI 的“思考”能力与系统的“执行”能力深度结合。对于开发者而言,它是一个极具潜力的效率工具和探索人工智能前沿应用的平台。但在实际应用中,尤其是在生产环境,必须对其伴生的高风险有清醒的认识,并采取严格的沙箱隔离、权限最小化、操作审计等安全措施。技术的进步总是伴随着新的挑战,理性评估,谨慎使用,方能驾驭好这类强大的AI智能体工具。关于更多前沿技术框架的实践与讨论,欢迎访问云栈社区进行交流。 |