如果你现在搭建的RAG系统,还停留在“切块、向量化、TopK检索、生成”这四步曲上,那么你可能已经落后于当前的生产实践了。2024到2025年,企业级RAG技术经历了一场从架构到策略的全面革新。

几个关键数据直观地说明了这场变革的规模与深度:

- arXiv上RAG相关论文:2024年超过1,200篇,相比2023年的93篇增长了惊人的13倍。

- 超过80% 实施生成式AI的企业正在使用RAG框架。

- 纯向量搜索已被业界视为过时的方案,混合检索成为了新的生产标准。

- LazyGraphRAG将GraphRAG的索引成本降低了99.9%。

- 高达90% 的Agentic RAG项目在生产中失败(这个数据至关重要,后文会深入分析)。

- 法律领域的RAG工具幻觉率仍高达17-33% (Stanford, 2024)。

本文面向已经理解基础RAG概念的技术从业者,我们将直接切入核心:2024-2025年,企业生产环境究竟在用哪些技术、为什么用、踩过哪些坑,以及实际效果如何。

2、2025年企业RAG技术全景一览

我们先通过一张图来概览当前企业级RAG的技术分布与成熟度。

从生产成熟度出发,我们可以将这些技术快速分层:

| 技术 |

生产成熟度 |

核心价值 |

主要风险 |

| Hybrid RAG |

⭐⭐⭐⭐⭐ |

召回率全面提升5-10个百分点 |

参数调整成本 |

| GraphRAG |

⭐⭐⭐⭐ |

多跳推理准确率提升3倍 |

索引成本高(LazyGraphRAG已解决) |

| Agentic RAG |

⭐⭐⭐(谨慎) |

复杂多步骤任务自动化 |

90%生产失败率 |

| Self-RAG/CRAG |

⭐⭐⭐ |

自动校验检索质量 |

推理开销增加 |

| Multimodal RAG |

⭐⭐ |

图文统一检索 |

成本高、集成复杂 |

| LongRAG |

⭐⭐ |

解决语义切割不完整问题 |

依赖超长上下文LLM |

从上到下,技术越新,实验性越强。对于企业级落地,应优先考虑上层的成熟技术,底部的更多是面向2025-2026年的探索方向。

3、Hybrid RAG:混合检索已成生产标准

3.1 为什么纯向量搜索被淘汰了

纯向量搜索在通用语义理解上表现出色,但在企业级场景中存在一个致命短板:对关键词精确匹配不敏感。

设想一个典型查询:“查找合同编号 SLA-20240315-0089 的服务等级条款”。纯向量搜索可能会返回大量关于“服务等级协议”的文档,但就是找不到那份编号精确的合同。原因在于,向量模型难以有效捕捉专有名词、产品编号、法律条款引用这类需要精确匹配的信号。

在法律、金融、监管合规这些企业核心场景中,精确匹配与语义理解同等重要。纯向量搜索的局限性在此被放大了。数据也印证了这一点:纯向量搜索在基准测试中的召回率天花板约为75-80%,而混合检索能轻松将这一指标提升5到10个百分点。

3.2 BM25 + 向量的黄金组合

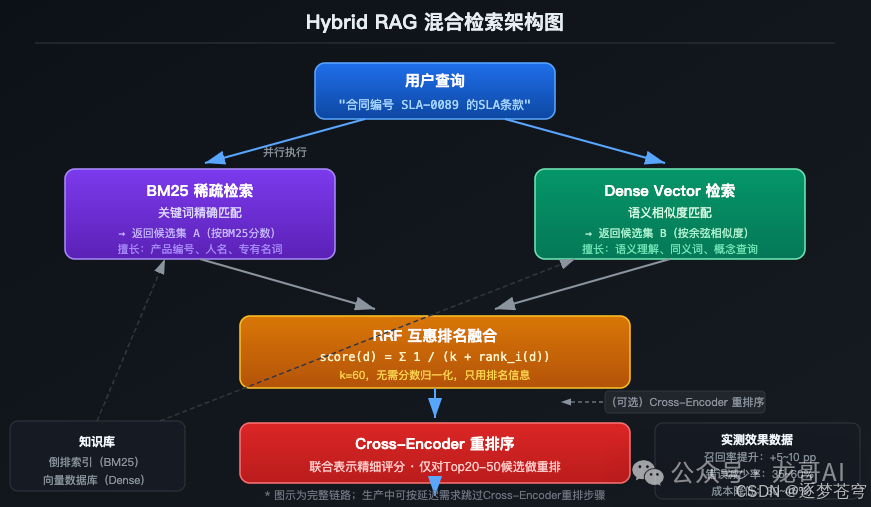

混合检索的核心架构可以概括为以下流程:

用户查询

├── BM25 稀疏检索(关键词精确匹配)

│ └── 返回候选集 A(按BM25分数排序)

└── Dense Vector 检索(语义相似度)

└── 返回候选集 B(按余弦相似度排序)

↓

RRF 互惠排名融合 / 加权分数合并

↓

Cross-Encoder 重排序(可选)

↓

LLM 生成

其中,互惠排名融合(RRF) 是最常用的融合策略之一,其公式优雅且实用:

RRF_score(d) = Σ 1 / (k + rank_i(d))

# k通常取60,rank_i是文档d在第i个检索器中的排名

这个公式的优势在于,它无需对不同检索器的原始分数进行归一化处理,仅利用排名信息,完美避开了分数量纲不一致的难题。

Cross-Encoder重排序是另一个关键的性能增益点。它使用一个更精细的模型(通常是小型BERT变体)对初步检索出的TopK候选文档进行二次评分,通过计算查询和文档的联合表示来获得更准确的排序。当然,这会带来更高的延迟,因此通常只对Top 20-50的候选文档进行重排。

3.3 实际效果数据

用真实数据说话:

- 错误减少率:相比单一检索方法,混合RAG架构的综合错误减少率达到 35-60%。

- NVIDIA:在其金融文件分析中采用Graph+Vector混合架构,实现了96% 的事实忠实度。

- Azure AI Search 研究结论明确指出:混合检索+语义重排序是开箱即用的最有效相关性方法。

- LinkedIn:集成知识图谱的混合检索使其平均倒数排名(MRR)提升了77.6%,工单解决时间减少了28.6%。

- 智能路由:根据查询类型动态选择检索策略,可将RAG成本降低30-45%,延迟降低25-40%。

何时使用混合检索? 几乎所有的企业场景,只要文档中包含专有名词、产品编号、日期、人名等需要精确匹配的信息,就应该采用混合检索。

何时可以不用? 纯粹的开放域问答、知识库内容高度通用化、且对延迟有极端要求而精确匹配需求极低的场景。

4、GraphRAG:关系推理的突破

4.1 微软GraphRAG原理

GraphRAG是微软研究院在2024年推出的重要创新。传统RAG将文档视为扁平的文本块,而GraphRAG则先通过LLM从文档中提取实体和关系,构建出一个知识图谱,然后在这个图谱上进行检索和推理。

核心差异对比如下:

| 维度 |

传统RAG |

GraphRAG |

| 数据表示 |

文本块向量 |

实体-关系知识图谱 |

| 检索方式 |

向量相似度 |

图遍历 + 向量搜索 |

| 查询能力 |

局部相关片段 |

跨文档全局洞察 |

| 代表查询 |

“什么是X” |

“X与Y的关系”、“所有合同的合规风险” |

GraphRAG尤其擅长处理主题级或汇总型查询。例如:“分析这500份供应商合同中,哪些存在数据隐私合规风险?”——这类需要跨文档汇总和分析的查询,传统RAG很难有效处理。

性能数据:

- KG-LM基准测试:GraphRAG准确率达54.2%,而纯向量RAG仅为16.7%,提升达3.3倍。

- 模式密集型类别查询:性能提升3.4倍。

- Lettria演示:传统RAG答案正确率50% → 混合GraphRAG方案 80%以上。

- LinkedIn应用:使工单解决时间从40小时缩短至15小时。

4.2 LazyGraphRAG:99.9%成本降低的突破

GraphRAG此前面临一个巨大的工程障碍:索引成本极高。构建知识图谱需要对全部文档进行LLM调用以提取关系,对于大型文档库,其成本可能是普通向量RAG的数十倍,令许多企业望而却步。

2024年11月,微软发布的 LazyGraphRAG 彻底改变了这一局面。

核心思路:不在索引阶段预先进行昂贵的LLM摘要和关系提取,而是在查询时按需、迭代地提取相关概念及其共现关系。

效果:

- 索引成本与普通向量RAG持平,仅为完整GraphRAG成本的 0.1% (降低99.9%)。

- 查询成本相比GraphRAG的全局搜索降低700倍以上。

- 在所有评估指标上均显著优于8种对比方法。

这一突破使得GraphRAG的工程可行性大幅提高。“成本太高”不再是一个有效的拒绝理由。

4.3 适合哪些场景

适合GraphRAG的场景:

- 合规审查(如供应商合同、监管文件的全局风险评估)。

- 企业知识管理(需要跨部门、跨文档检索关联知识)。

- 研究分析(从论文、技术报告中挖掘概念关系)。

- 金融分析(对SEC文件、财报进行主题分析)。

不适合GraphRAG的场景:

- 简单的单文档问答(2025年2月arXiv:2502.11371的系统评估指出,GraphRAG对此类查询效果不如基线RAG)。

- 对检索延迟有极端要求的实时场景。

- 文档更新极其频繁的场景(图谱维护成本高)。

一句话判断标准:如果你的查询需要“汇总多个文档的共同特征”或“找出实体间的隐藏关联”,就用GraphRAG;如果只是简单的“找到这个问题的答案”,用普通Hybrid RAG足矣。

5、Agentic RAG:让RAG自己思考

5.1 架构原理

Agentic RAG的本质是将AI Agent的能力嵌入RAG管道,使系统能够自主决策检索策略和执行步骤,而非遵循固定流程。

核心能力对比如下:

| 能力 |

传统RAG |

Agentic RAG |

| 查询处理 |

单次检索 |

多轮迭代检索 |

| 检索策略 |

固定 |

Agent动态决策 |

| 工具调用 |

无 |

API、SQL、图谱、外部搜索 |

| 复杂查询 |

能力有限 |

可分解为子任务序列 |

| 失败处理 |

无感知 |

自动重试/切换策略 |

一个典型的基于ReAct框架的Agentic RAG工作流示例如下:

Query: “对比2023和2024年Q4销售数据,找出下滑超过20%的产品类别并分析原因”

→ Agent思考:需要先获取两年的销售数据

→ Action: SQL查询 2023 Q4数据

→ Observation: [结果...]

→ Action: SQL查询 2024 Q4数据

→ Observation: [结果...]

→ Action: 向量检索“产品类别下滑原因”相关市场报告

→ Observation: [文档片段...]

→ Agent综合分析 → 生成最终答案

主流实现框架包括:

- LangChain LangGraph:擅长图编排、状态持久化,支持人在回路(HITL)。

- LlamaIndex AgentQueryEngine:提供代理工作流引擎。

- Microsoft AutoGen:专注于多代理协作。

5.2 为什么90%项目在生产中失败

这是整篇文章最需要警惕的风险提示。行业报告显示,约90%的Agentic RAG项目在生产部署中失败,主要原因在于工程团队低估了系统复杂性和累积失败成本。

失败模式分析:

-

链式失败的累积效应

Agent的每一步工具调用都引入了一次失败概率。假设单步成功率为95%,一个10步的工作流整体成功率仅为 0.95^10 ≈ 59.9%。在生产环境中,高达40%的失败率是完全不可接受的。

-

难以调试的不确定性

传统RAG失败,问题可能出在检索或生成环节。Agentic RAG失败,你很难定位是哪一个决策步骤出了问题,且每次执行的路径可能不同,问题复现困难。

-

成本和延迟爆炸

多步骤工作流意味着多次LLM调用和工具调用,成本和延迟呈线性甚至指数增长。用户能容忍等待10秒,但等待60秒几乎不可能。

-

过度工程化

许多团队在并不需要Agent能力的场景强行使用Agentic架构,为了“炫技”而非“解决问题”。

5.3 成功落地的关键

那成功的10%是如何做到的?看几个真实案例:

Morgan Stanley(最成功的案例之一):

- 场景:内部金融研究工作流的检索代理。

- 采用率:98% (用户主动认可使用)。

- 准确率提升:80%。

- 关键做法:严格限定在高价值、边界清晰的金融研究场景。

PwC:

- 场景:税务和合规流程自动化。

- 成果:自动化了80% 的税务合规流程。

- 关键做法:采用高度结构化的工作流,限制Agent的自由度。

Fisher & Paykel:

- 场景:客户服务知识问答。

- 成果:新员工培训时间减少76%。

- 关键做法:限定领域,并构建了高质量的知识库。

成功落地的共同特征:

- 限定在高价值、有明确边界的场景,不做“万能Agent”。

- 分步骤验证:先确保每个工具调用本身可靠,再组合成工作流。

- 加入人在回路(HITL):对高风险决策步骤设置人工确认节点。

- 充分的监控和可观测性:详细记录每一步执行过程和结果,便于排查。

- 渐进式增加复杂度:从简单的单工具调用开始,逐步增加工作流复杂度。

判断:Agentic RAG代表着未来的方向,但在2025年仍需谨慎对待。如果你的业务场景用普通RAG能解决80%的问题,那就先把这80%做好,不要为了使用Agent而使用Agent。

6、Multimodal RAG & LongRAG

6.1 Multimodal RAG:多模态统一检索

多模态RAG在2024年开始从实验室走向生产,主要有两条技术路线:

路线一:多模态嵌入

使用CLIP等支持多模态的嵌入模型,将文本和图像映射到同一向量空间,实现跨模态的语义检索。

路线二:LLM图像摘要

使用GPT-4V/GPT-4o等视觉模型将图像内容转化为详细的文字描述,然后将这些描述与文本一同存入向量数据库,沿用纯文本检索流程。此方案工程实现更简单,是目前企业落地的主流选择。

真实效果数据:

- MMed-RAG(医疗多模态RAG):在5个医疗数据集上平均提升事实准确率43.8%。

- RULE(EMNLP 2024):该医疗视觉语言模型将事实准确率平均提升47.4%。

- 医疗合规效率提升:25-30%。

- 成功实施复杂多模态RAG的企业报告生产力提升30-42%。

生产挑战需清醒认识:

- 高计算成本:真正的多模态检索需要大型模型和强大的算力基础设施。

- 跨模态幻觉:图文信息融合时产生的幻觉比纯文本更难监控和纠正。

- 集成复杂度高:文本、图像、表格、音频等不同模态需要各自独立的处理管道。

判断:多模态RAG在2025年仍处于“早期采用者”阶段。如果你的核心业务文档(如医疗影像、工程图纸、金融图表)包含大量非文本信息,值得投入;否则,优先将纯文本RAG做到极致更为实际。

6.2 LongRAG:解决切块语义割裂问题

LongRAG(Jiang et al., 2024)直指传统RAG的一个根本性缺陷:短文本块切割导致的语义不完整。

传统RAG将文档切分为约100词左右的短块,一段完整的论述或论证可能被切得支离破碎。每个块单独看语义通顺,但在回答需要连贯上下文推理的问题时,拼接出的答案往往残缺或矛盾。

LongRAG的解法:将文档处理为4K token的长单元(约为传统长度的30倍),并依赖Gemini-1.5-Pro、GPT-4o等支持超长上下文的LLM作为“阅读器”来理解和提取信息。

性能数据:

| 数据集 |

传统RAG |

LongRAG |

| NQ Answer Recall@1 |

52% |

71% |

| HotpotQA Answer Recall@2 |

47% |

72% |

| NQ EM(精确匹配) |

— |

62.7% |

| HotpotQA EM |

— |

64.3% |

在法律文档分析中,LongRAG相比传统RAG减少了35% 的上下文信息损失。

局限性:LongRAG严重依赖于支持长上下文的LLM。如果你使用的模型上下文窗口较小,此方案则不适用。目前它仍主要处于研究和早期应用阶段。

7、主流框架选型指南(2025版)

7.1 LlamaIndex vs LangChain/LangGraph 最新对比

两大主流框架在2024-2025年均有重大更新,选型逻辑也更为清晰。

LlamaIndex 2025年核心新特性:

| 功能 |

说明 |

| LlamaParse |

支持90+文件格式,擅长解析复杂PDF/PPT/图表,表格可提取为Markdown。 |

| LlamaCloud |

企业级托管平台,提供工业级文档解析、索引和检索服务。 |

| Workflows 1.0 |

事件驱动的异步持久化工作流,支持暂停与恢复。 |

| 混合检索 |

原生支持BM25+向量混合检索及Cross-Encoder重排序。 |

| 评估套件 |

内置忠实度、答案相关性、上下文召回率等评估指标,与RAGAS集成。 |

| 300+数据连接器 |

覆盖主流数据源。 |

LangChain/LangGraph 2025年核心新特性:

| 功能 |

说明 |

| LangGraph |

图编排框架,专为多代理、多步骤工作流设计;支持状态持久化和人在回路(HITL)。 |

| Corrective/Adaptive RAG |

原生支持CRAG(自校正RAG)和自适应RAG工作流。 |

| 企业集成 |

与Salesforce、Microsoft 365、AWS等企业服务无缝集成。 |

| 缓存与内存优化 |

2025年版本在性能和内存开销上进行了大幅优化。 |

选型建议:

- 专注于RAG应用(数据管道、检索优化) → 首选 LlamaIndex,其数据处理能力更强,LlamaParse对复杂文档的处理是显著优势。

- 专注于多代理复杂工作流(Agentic RAG) → 首选 LangGraph,其在状态管理和图编排方面更为强大。

- 需要进行系统的RAG评估 → 选用 RAGAS,这是目前最广泛使用的RAG专项评估框架。

- 两者并非互斥,在复杂项目中,常见组合是使用LlamaIndex处理数据层,再用LangGraph构建上层工作流。

7.2 向量数据库怎么选

2024年向量数据库市场规模已达22亿美元,选型变得愈发重要。各主流产品对比如下:

| 特性 |

Milvus |

Weaviate |

Pinecone |

Qdrant |

pgvector |

| 类型 |

开源 |

开源+托管 |

完全托管 |

开源 |

PostgreSQL扩展 |

| 规模上限 |

数十亿向量 |

中到大型 |

自动扩展 |

中到大型 |

取决于PG实例 |

| P50延迟 |

<10ms |

中等 |

20-50ms |

20-50ms |

竞争力强 |

| 混合搜索 |

有限 |

最强(原生) |

基本 |

良好 |

需扩展功能 |

| 索引类型 |

11种(最丰富) |

HNSW+倒排索引 |

专有 |

HNSW |

HNSW/IVFFlat |

| 成本 |

完全自主控制 |

灵活(托管/自建) |

按量计费(偏贵) |

低成本 |

最低(若已有PG) |

快速决策矩阵:

- 无运维负担、要求严格SLA → Pinecone。

- 需要强大的原生混合搜索(向量+关键词+过滤) → Weaviate。

- 面向十亿级超大规模、要求完全掌控基础设施 → Milvus(GitHub Star超35,000)。

- 已有PostgreSQL基础设施,希望升级成本最小化 → pgvector(基准测试显示,pgvectorscale扩展在5000万向量上比Qdrant的QPS高11.4倍)。

- 生产环境中需要复杂过滤条件的工作负载 → Qdrant。

- 快速原型验证或轻量级应用 → Chroma。

2024-2025年趋势:得益于与PostgreSQL生态的深度整合,pgvector的采用正在加速。对于已经部署了PG数据库的企业而言,引入向量搜索功能的边际成本几乎为零。

8、行业落地案例

8.1 金融:Morgan Stanley的成功范本

Morgan Stanley内部金融研究RAG代理:

- 场景:内部金融分析师查询公司研究报告、市场数据。

- 成果:实现了98% 的员工采用率,研究准确率提升80%。

- 成功关键:场景高度明确(金融研究),知识库边界清晰,用户均为专业分析师。

Morgan Stanley DevGen.AI(Agentic RAG代码现代化):

- 基于GPT-4的代码分析代理。

- 已审查代码:900万行。

- 节省开发时间:约28万小时。

8.2 法律:高准确率背后的幻觉警告

法律AI是RAG落地最热门的领域之一,但也是风险最高的领域。

Stanford重要研究指出:LexisNexis和Thomson Reuters等主流法律AI工具(均采用RAG技术),其幻觉率仍在17-33% 之间。

这意味着,每处理100份法律文件,可能有17到33份包含不准确或虚构的信息。在法律实践中,这可能直接导致错误的法律意见、错误的案例引用,甚至误导整个诉讼策略。

有法律援助机构采用LongRAG进行文档分析,将上下文信息损失减少了35%,但这主要解决的是语义完整性问题,并未根除幻觉风险。

判断:在法律领域应用RAG,必须设置人工复核环节,不能实现端到端全自动化。在幻觉率降至5%以下之前,法律从业者必须对RAG工具的输出保持高度警惕。

8.3 医疗、IT服务等

医疗行业:

- IBM Watson for Oncology:其癌症治疗建议与专家肿瘤医生的匹配率达到96%(《临床肿瘤学杂志》研究)。

- 放射科QA系统:采用Agentic RAG后,诊断准确率从68%提升至73%。

- 多模态医疗RAG(MMed-RAG):在多个任务上将事实准确率提升43-47%。

IT服务:

- ServiceNow:利用多轮RAG和缓存检索管道,加速了重复性IT事件的处理。

- Fisher & Paykel:客户服务场景应用Agentic RAG,将新员工培训时间减少76%。

PwC税务:

- 使用Agentic RAG自动化了80% 的税务合规流程。

- 成功关键:税务合规流程本身具有清晰、结构化的规则边界。

9、总结:企业RAG技术选型建议

2024-2025年,企业级RAG的核心演变是从“能用”到“好用”,从依赖“单一技术点”到采用“协同技术组合”。

技术选型核心建议:

第一步:将混合检索作为基础设施标准

无论上层应用何种高级技术,底层的检索引擎都应采用Hybrid RAG(BM25 + 向量 + RRF融合)。这是投入产出比最高、几乎无需犹豫的基础升级。

第二步:按场景需求决定是否引入图谱

- 存在大量多跳推理、关联分析、跨文档汇总需求 → 积极尝试LazyGraphRAG(成本障碍已消除)。

- 主要是简单的事实问答场景 → 使用普通Hybrid RAG即可,引入GraphRAG可能得不偿失。

第三步:Agentic RAG务必小步快走,谨慎验证

- 切忌一开始就设计复杂的多Agent宏大系统。

- 应从单Agent配合少量可靠工具起步,将单步成功率做到90%以上,再逐步增加复杂度。

- 对于高风险决策步骤,必须设置人工确认(HITL)节点。

第四步:评估体系先行

在开始任何优化之前,先接入RAGAS或LlamaIndex内置评估套件,建立 faithfulness(忠实度)、answer relevancy(答案相关性)、context recall(上下文召回率)等基线指标。没有量化指标的优化是盲目的。

关键风险提示:

- 法律、医疗等高风险场景:绝不能完全信任RAG的自动化输出,必须建立人工复核机制。

- Agentic RAG:90%的生产失败率是真实存在的统计数据,务必对其复杂性和可靠性进行审慎评估。

- 安全威胁:BadRAG/TrojanRAG等针对RAG系统的文档投毒攻击真实存在,企业级部署必须考虑检索层的安全性。

2025年最值得跟进的方向:

- LazyGraphRAG的工程化实践(成本降低使其真正具备生产可行性)。

- 基于LangGraph的Agentic工作流模式(相对最成熟的工程实践)。

- RAG系统安全(一个被严重低估但至关重要的方向)。

最后用一句话总结:混合检索是必须掌握的现在,GraphRAG是值得投入的进阶,Agentic RAG是充满潜力但需谨慎探索的未来,而完善的评估体系应贯穿始终。

希望这篇结合了最新数据与实战分析的指南,能帮助你在技术社区(例如云栈社区这样的开发者平台)的交流中,更好地把握RAG技术的演进脉络与落地节奏。

参考资料来源:Microsoft Research Blog、Stanford Legal RAG研究、arXiv 2024-2025论文、Azure AI Search技术博客、LlamaIndex/LangChain官方文档、各企业公开案例报告。