在量化投资领域,Alpha因子的发现始终是一项核心但极具挑战性的任务。无论是股票多因子模型、统计套利,还是高频交易策略,能够持续发现新的有效信号,往往决定了一家量化机构的竞争力。

然而随着时间推移,因子库不断扩张,新的Alpha信号变得越来越难以发现。大量候选因子之间高度相关,真正能够提供新增信息的信号越来越稀缺,这种现象在业内常被称为 “Correlation Red Sea”。

近期,来自清华大学等机构的研究者提出了一套新的解决方案——FactorMiner。这是一种具备技能模块与经验记忆的自进化AI Agent系统,其目标是自动发现新的公式化Alpha因子,并在探索过程中不断积累经验、优化搜索策略。

量化因子发现为何越来越困难?

在传统量化研究流程中,Alpha因子的构建通常依赖研究员的金融直觉与经验。例如经典文献中提出的 Alpha101 或 Alpha191 因子库,都是人工设计的公式信号。

这种公式化因子具有重要优势:

- 逻辑透明,可审计

- 便于风险控制与监管合规

- 在不同市场环境下具备较强可解释性

但当研究规模扩大时,问题也逐渐出现。

首先是搜索空间极其庞大。一个因子通常由多个运算符组合而成,例如:

- 时间序列算子(TsRank、Delta)

- 横截面算子(CsRank)

- 统计算子(Std、Skew、Kurtosis)

- 价格与成交量函数

当这些算子进行组合时,可能形成的表达式数量呈指数级增长。

其次是知识无法积累。传统自动化搜索方法,例如遗传算法或强化学习,往往每次都从零开始探索,无法记住过去哪些方向成功、哪些方向失败。随着因子库扩大,系统很容易不断重复探索相似结构。

第三个问题是因子相关性约束。

在实际投资中,单个因子的质量并不足够,因子之间必须保持较低相关性。论文将这一问题形式化为:

其中:

- $L^*$:优化后的因子库

- $\Phi(\alpha)$:因子质量

- $\rho(\alpha_i, \alpha_j)$:因子相关性

随着因子数量增加,可行搜索空间迅速缩小,这就是所谓的 Correlation Red Sea。

FactorMiner 的核心思路

为了解决上述问题,研究者提出了一种新的 AI Agent 架构:FactorMiner。

其核心思想是:

让AI不仅能够生成因子,还能够在长期探索过程中积累经验,并利用这些经验不断优化未来的搜索方向。

系统由三个关键组件组成:

- Agent Skill(因子挖掘技能模块)

- Experience Memory(经验记忆模块)

- Ralph Loop(自进化循环机制)

这三个部分共同构成了一个可以持续进化的因子发现系统。

因子挖掘技能模块

FactorMiner首先将因子挖掘过程封装为一个可调用的技能模块(Agent Skill)。

这一设计借鉴了近年来AI Agent系统的工具调用思想:语言模型负责推理与规划,而具体计算任务由外部模块执行。

在FactorMiner中,技能模块主要包含两个层级。

因子算子库

系统构建了一套包含 60多个金融算子 的运算库,例如TsRank、Rsquare、Delta、Skew、CorrEMA等。

这些算子被GPU加速实现,以支持大规模计算。

LLM Agent生成的因子表达式,都会基于这套算子库构建,因此保证所有候选因子都是可执行的数学程序。

多阶段因子验证流程

为了确保因子质量,系统设计了一套严格的评估流程。

整个流程包含四个阶段:

Stage 1 快速IC筛选

首先在较小资产子集上计算IC:

即因子信号与未来收益之间的Spearman相关系数。

只有满足阈值条件的因子才会进入下一阶段。

Stage 2 因子相关性检测

计算候选因子与已有因子的相关性:

如果相关性过高,则会被拒绝。

Stage 3 批量去重

即使通过前两轮筛选,同一批生成的因子之间仍可能高度相似,因此系统还会进行批内去重处理。

Stage 4 完整验证

最终阶段在完整数据集上进行全资产测试、稳健性分析和Out-of-sample验证,只有通过所有测试的因子,才会被纳入因子库。

经验记忆模块

FactorMiner最具创新性的部分,是其Experience Memory(经验记忆)机制。

这一模块会在每轮因子挖掘后总结经验,并存入长期记忆库。

记忆内容主要分为三类。

成功模式

系统会总结哪些结构经常成功,例如:

- 高阶统计量因子(Skew / Kurtosis)

- 趋势回归指标(R² / Slope)

- 成交额效率因子

这些被记录为 Recommended Directions。

失败区域

如果某类因子长期因高相关性被拒绝,系统会将其标记为 Forbidden Regions

例如:

- 简单VWAP偏离

- 标准化收益因子

- 过度重复的价格动量结构

未来生成因子时,系统会主动避免这些区域。

策略级经验

系统还会记录更高层次的经验,例如:

- 非线性因子组合效果优于线性组合

- 高频数据中高阶矩不稳定

这些信息会影响未来的搜索策略。

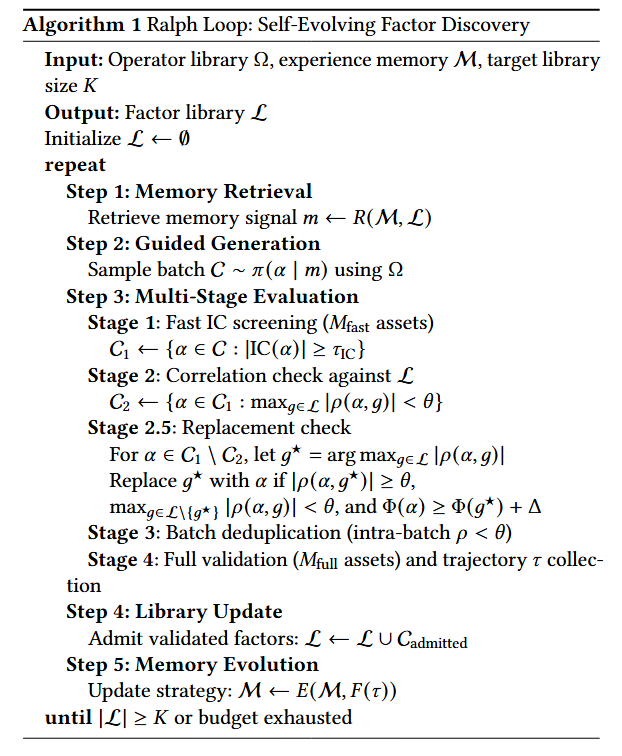

Ralph Loop 自进化循环

FactorMiner的核心运行机制被称为 Ralph Loop。

整个流程可以概括为五个步骤:

1. 记忆检索 :系统从经验库中检索相关模式。

2. 因子生成:LLM根据记忆提示生成候选因子。

3. 多阶段评估:候选因子进入验证流程。

4. 因子库更新:通过验证的因子被加入库中。

5. 经验蒸馏:本轮探索结果被总结并写入记忆库。

这一循环不断重复,使系统具备持续学习能力:

每一次因子挖掘,都会让未来的搜索更加高效。

实验分析

实验设置

论文在两个市场进行了实验验证:

A股市场: 使用10分钟频率数据,包括CSI500, CSI1000, HS300。数据规模超过 2500万条记录。

加密货币市场: 使用Binance交易所 64个主流资产 的10分钟数据。

预测目标为:未来10分钟开盘到收盘的价格变化率。

训练数据为 2024年全年,测试数据为 2025年。

实验结果

实验中,FactorMiner与多种方法进行了对比,结果显示:

FactorMiner能够构建出110个高质量Alpha因子库。

这些因子具有两个重要特点:

一是预测能力稳定,在IC与ICIR指标上表现优于多个基线方法。

二是因子之间相关性较低,相关性矩阵显示,大部分因子之间只有弱到中等相关关系,说明系统能够持续发现新的信息来源。

研究启发

FactorMiner的意义不仅在于提出一个新的因子挖掘工具,更重要的是展示了一种新的研究范式。

过去的自动化因子搜索通常具有三个特点:

- 每次搜索相互独立

- 缺乏长期经验

- 因子生成与评估高度耦合

FactorMiner则引入了三个新的思想:

长期经验积累,系统会记住哪些结构有效。

技能模块化,复杂计算由专用模块执行。

自进化探索,Agent在探索过程中不断改进策略。

近年来,AI Agent正在从简单的文本生成工具,逐渐发展为能够执行复杂研究任务的系统。

在量化投资领域,这种趋势尤为明显。FactorMiner展示了这种方向的一种早期形态。

当AI开始“学习如何寻找Alpha”,量化研究本身也正在进入新的阶段。

随着AI Agent技术进一步发展,自动化Alpha研究系统可能成为未来量化机构的重要基础设施。对这类融合了 人工智能 与专业领域知识的前沿探索,也是 云栈社区 上开发者们持续关注和交流的焦点。