养龙虾(OpenClaw)火了。为什么它能火起来?关键在于其心跳机制、多Agent协同、文件驱动这三大核心设计,直接将AI Agent从“只会聊天”的阶段,硬生生拽进了“真正能干活”的时代。

然而,养“龙虾”也伴随着不容忽视的风险!

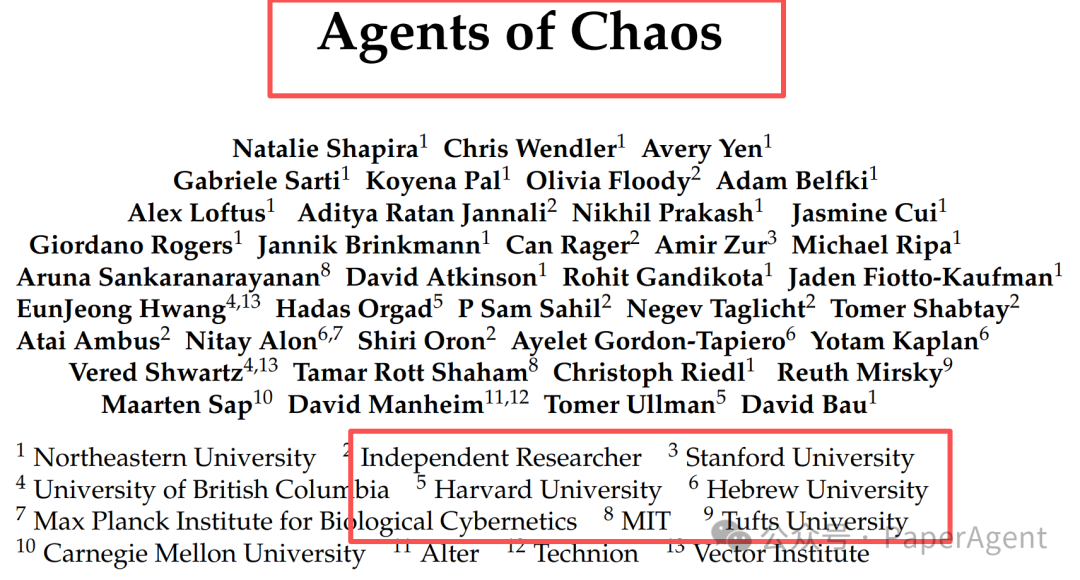

斯坦福大学一篇名为《Agents of Chaos》的论文对OpenClaw进行了极限测试,结果令人后背发凉:它可能会在被简单指令诱导后删除文件,或者轻易地将密码泄露出去。

更令人担忧的是,根据openclaw.allegro.earth网站的数据,有超过33万OpenClaw实例被直接暴露在公网上,任何人都能随意访问。这种环境下遍地都是不设防的“小龙虾”,谁还敢放心部署和使用?

幸运的是,最近市场上出现了一只让人放心的“国产虾”——讯飞AstronClaw。

讯飞AstronClaw:从设计源头解决安全问题

当我打开AstronClaw的介绍页面时,第一反应不是去看它炫酷的功能,而是先审视它如何解决OpenClaw暴露出的那些安全问题。

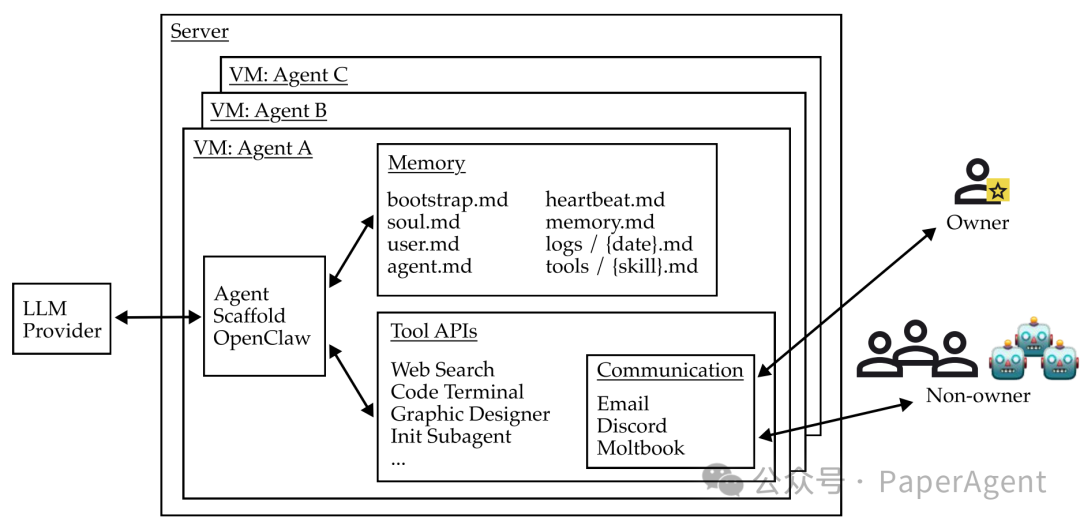

AstronClaw的核心策略是将所有智能体都运行在一个强隔离的Sandbox(沙箱) 环境中。Agent可以在沙箱内自由执行任务、调用工具,但任何试图跳出沙箱去访问宿主系统文件或敏感数据的操作都会被彻底阻断。

针对OpenClaw可能“认错主人”的风险,AstronClaw的解决方案非常直接:通过与企业微信、钉钉、飞书等企业级IM工具深度集成,让AI助手天然识别用户的企业身份。你是谁、拥有什么权限,系统一目了然,从根本上杜绝了越权风险。

可以说,讯飞在AstronClaw的设计中,将安全性做成了产品的“地基”而非“装修”,这是其区别于许多开源方案的关键。

不止于安全:一个开箱即用、能深度定制的生产力助手

当然,光有安全是不够的,我们部署AI助手最终是为了让它高效地工作。

上手过程异常简单。访问其PC官网 https://agent.xfyun.cn/astron-claw,点击「立即部署」按钮,大约等待1分钟,你的专属AstronClaw实例就在云端准备就绪了。

部署完成后,第一站自然是去Skills市场探索。这里提供了超过120个官方预置Skills,涵盖了超拟人语音合成、票据识别、公文校对、文本翻译等领域,这些都是讯飞的强项,真正做到开箱即用。

但真正体现其灵活性的,是支持自定义Skill的能力。我尝试上传了一个“每日论文推荐”的技能包,它能够基于arXiv和Semantic Scholar的数据,从相关性、新近性、热门度、质量四个维度自动筛选和推荐论文。

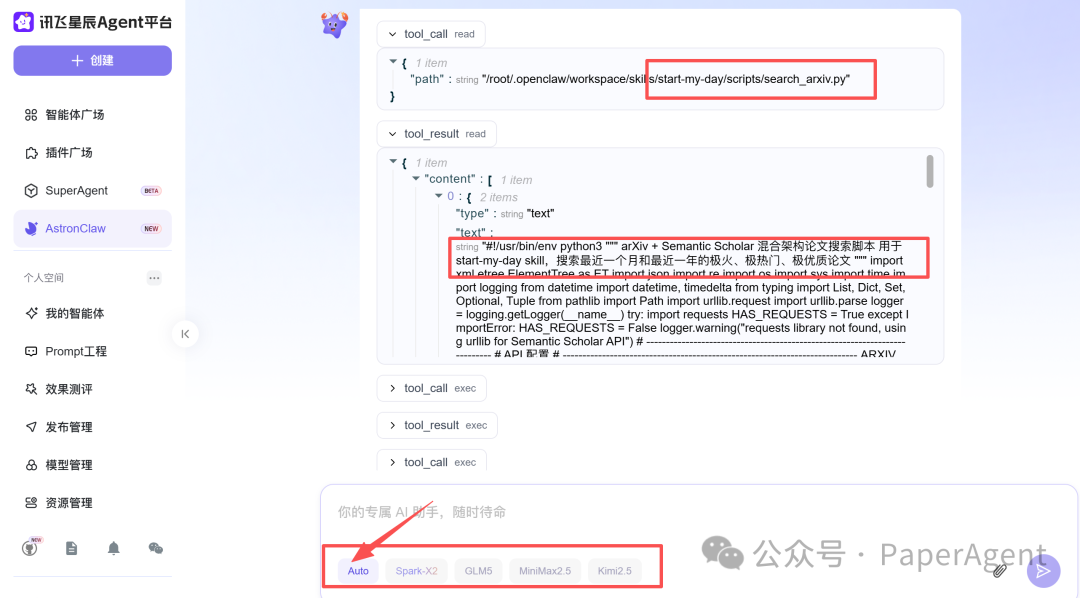

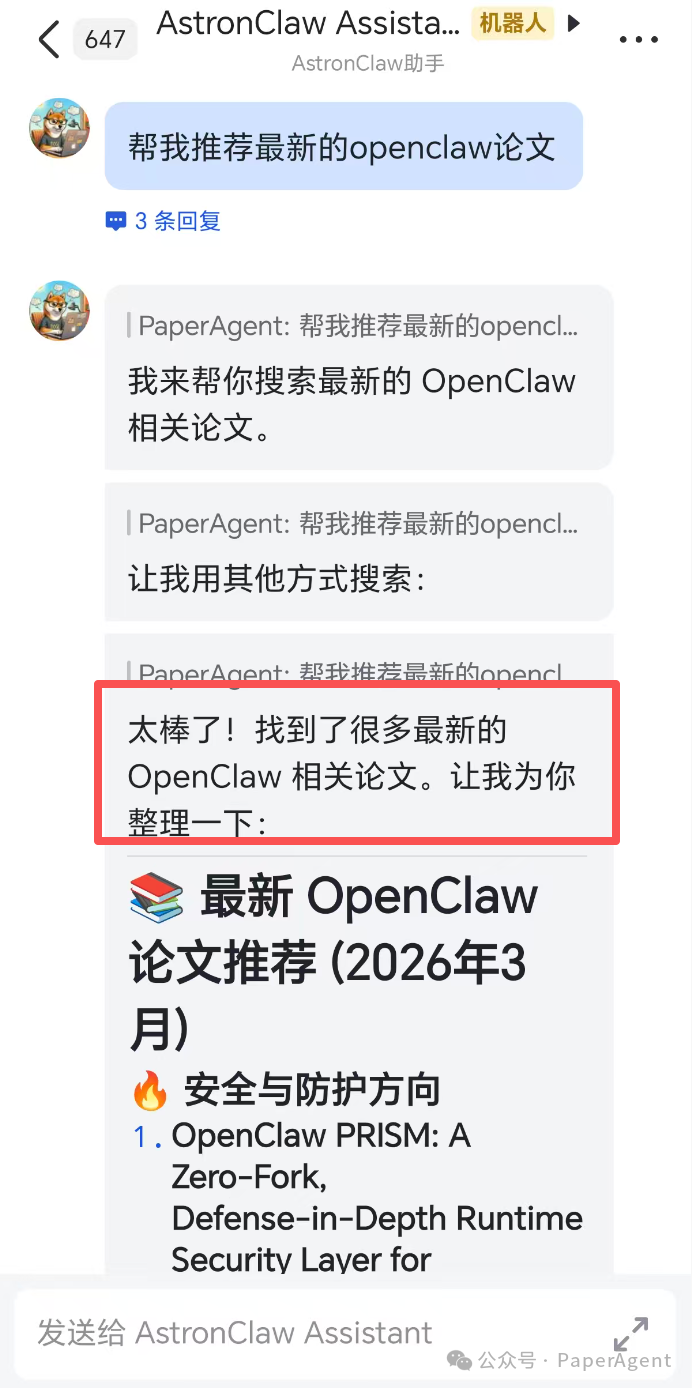

我迫不及待地给它下达了第一个任务:“推荐OpenClaw最新论文,把标题和摘要整理好发我”。AstronClaw支持按需切换星火X2、MiniMax-M2.5、Kimi-K2.5、GLM-5等旗舰大模型来执行任务。

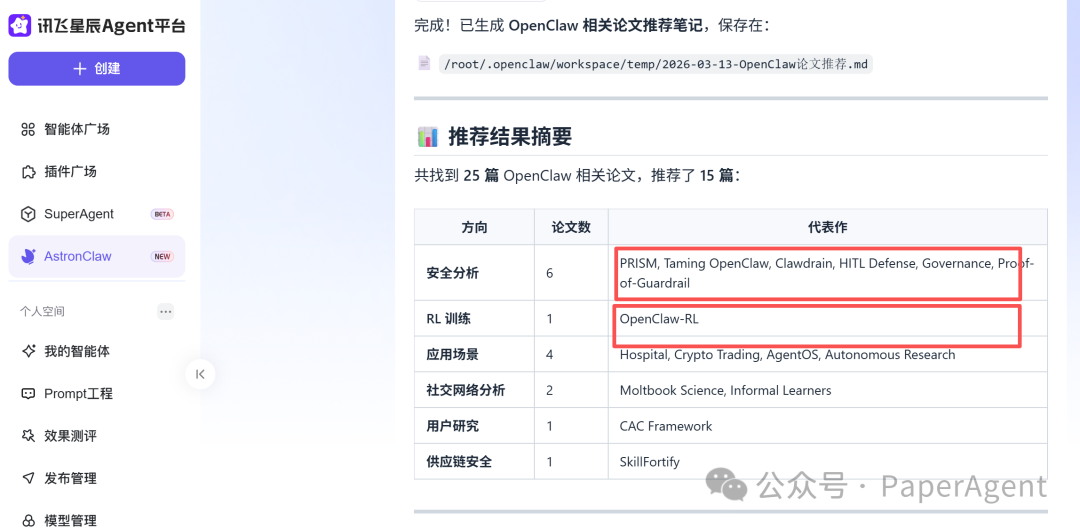

经过一系列的tool_call和分析处理,它准时发回了结果,共筛选推荐了15篇高质量的OpenClaw相关新论文,涵盖安全分析、强化学习、应用场景等多个方向。

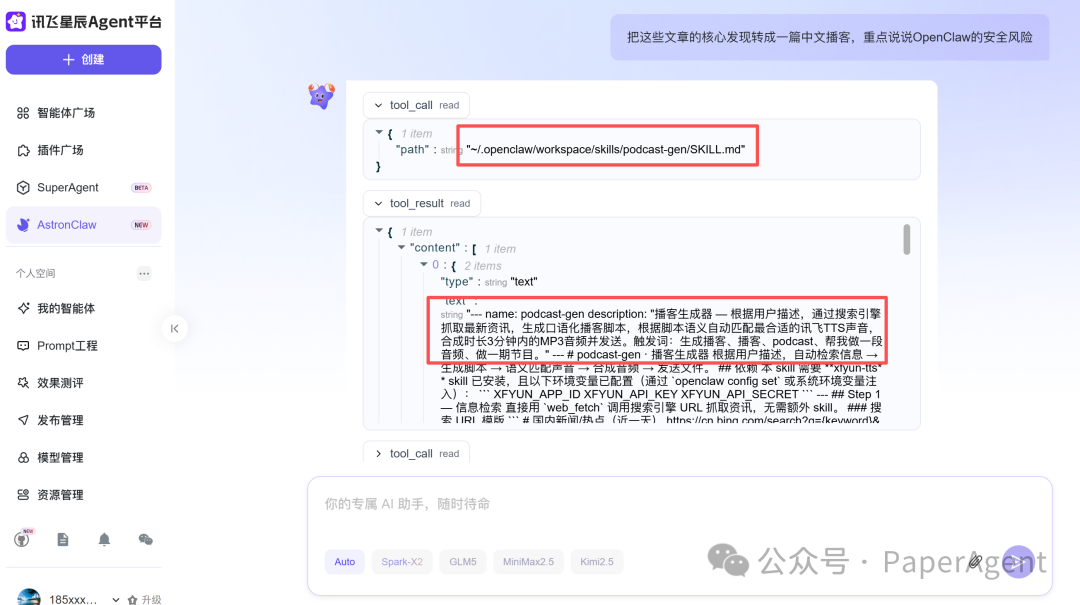

整个回复结构清晰,要点全面。为了进一步测试其工作流,我补充指令:“把这些文章的核心发现转成一篇中文播客,重点说说OpenClaw的安全风险。”

它准确地调用了podcast-gen技能,几分钟后,一段逻辑清晰、语言流畅的播客脚本就生成了。

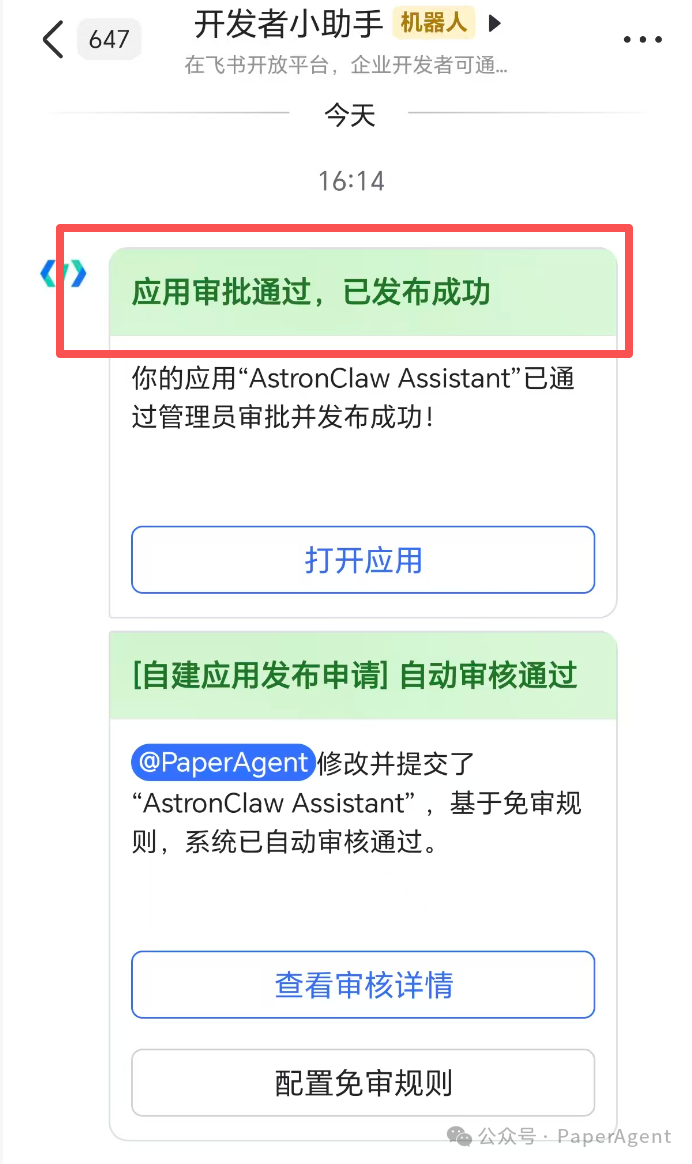

最让我惊喜的是与企业IM的打通体验。按照指引文档配置飞书渠道后,整个过程非常顺畅。

配置完成后,直接在飞书聊天中@AstronClaw助手机器人,输入“帮我推荐最新的openclaw论文”,它立刻就能在工作 IM 环境中提供高质量的服务。

从云端一键部署、测试官方技能,到上传自定义Skill,再到与飞书工作流无缝集成,整个过程流畅得不像一个刚上线的产品。AstronClaw不仅在技术上实现了安全,更在交互方式和实际工作流融合上做了精心设计,让AI真正有可能成为你的“数字同事”。

安全应成为默认项,而非可选项

读完《Agents of Chaos》后,我们不禁要思考:如果未来每个人都会拥有自己的AI Agent,那么我们现在到底是在“驯化”一个助手,还是在为它担任24小时的安全员?

真正负责任的做法,是将安全内化为产品的默认属性,而不是一个需要用户额外配置的加分项。普通用户不需要理解Sandbox的具体原理,也不需要手动配置复杂的权限,他们需要的正是这种“拿起就用,用即安心”的体验。

在众多“裸奔”的AI Agent方案中,像AstronClaw这样将安全写入基因、同时兼顾易用性与强大功能的国产方案,显得尤为可贵。对于开发者或企业而言,与其花费大量精力在基础设施安全和运维上,选择一个可靠的全托管平台或许是更高效的选择。

如果你也对构建安全、易用的AI助手感兴趣,不妨去云栈社区的人工智能板块了解更多相关的技术讨论与实践分享。