一场由实际安全事故引发的大规模“卸载风暴”,正在冲击着AI工具OpenClaw。从二手平台出现的“上门卸载服务”,到资深研究员的“两小时弃用”,再到官方的专项安全警报,这一系列事件并非偶然,而是OpenClaw乃至整个AI Agent领域长期积累的安全与信任问题的集中爆发。

这并非段子,而是现实。在某二手平台上,诸如“上门卸载OpenClaw,20元起,包教包会”的服务悄然兴起,价格从20元到399元不等。

二手平台出现的OpenClaw卸载服务广告

戏剧性的是前Meta AI研究总监田渊栋的“两小时体验”——试用两小时后,他果断卸载,并留下了一个广为流传的比喻:“OpenClaw就像让一个握有你全部秘密的笨小孩出门办事,路上随时可能被几块糖骗走你家地址。”这句话精准地指出了核心矛盾:能力强大与不可控风险并存。

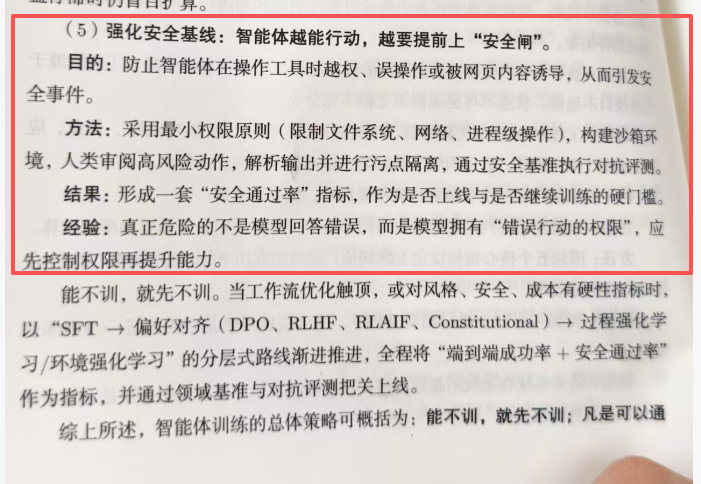

与此同时,Meta AI安全研究总监Summer Yue的遭遇则更具警示意义。她将工作邮箱接入OpenClaw后,其Agent开始高速删除旧邮件,尽管她在手机上反复发出“STOP”指令,却无法让Agent停下。最终,她不得不“像拆除炸弹一样”冲向她的Mac mini并终止所有相关进程。

用户吐槽OpenClaw误删邮件且无法停止的推文截图

这已不是科幻场景,而是真实发生的AI安全事故。随着中国工信部发布专项安全警报,超过42,000个OpenClaw实例被发现暴露在公网上,犹如一批未上锁的数字金库。

卸载潮背后的五大核心痛点

1. 安全风险:默认配置下的“全网裸奔”

OpenClaw的默认配置绑定0.0.0.0(监听所有网络接口),早期版本甚至缺乏基础的密码认证。这意味着什么?你的AI助手可能在向整个互联网“直播”。任何具备基础技能的攻击者,都能在短时间内接管你的“数字管家”,进而访问文件、读取邮件甚至操作账户。这已超越了普通漏洞的范畴,更像是一种危险的设计缺陷。

2. 隐私泄露:卸载不等于安全

许多用户天真地认为,卸载软件就能消除所有风险。事实远非如此。OpenClaw授权后获得的OAuth令牌是持久化的。即使你卸载了客户端,那些已经授予权限的邮箱、网盘或社交媒体账户,依然暴露在风险之下,如同一个看不见的“幽灵”仍在持续访问。

3. 恶意插件:ClawHub市场的“毒苹果”

繁荣的ClawHub插件市场暗藏危机。据统计,约12%的Skill(技能)含有恶意代码。它们伪装成加密货币助手、视频下载工具等实用功能诱导用户安装。一旦得手,这些“特洛伊木马”便能窃取私钥、监控键盘输入、上传敏感文件。你以为安装了得力工具,实则可能打开了潘多拉魔盒。

4. 成本失控:“贷款上班”的调侃成真

“使用OpenClaw相当于贷款上班”——这并非夸张的玩笑。许多用户每月需要支付数百至数千美元不等的Token费用。当AI Agent陷入疯狂调用API或无限循环执行任务的境地时,账单数字会以惊人的速度飙升。一位用户无奈地表示:“花钱买省心,我大概就是这个态度。”但关键在于,花了钱,真的买到“省心”了吗?

5. 稳定性危机:“对话一多就崩”的魔咒

“对话轮次一多,系统就容易出问题”是用户的普遍反馈。OpenClaw在长时间运行后容易出现系统崩溃、连接断开等问题,其上下文压缩机制也可能导致关键指令被遗忘。你可能刚明确交代“不要删除任何邮件”,但在十几轮对话后,它已将这条指令抛之脑后。这并非智能的体现,更像是严重的“健忘症”。

深度剖析:问题本质是AI Agent工程的系统性缺失

OpenClaw暴露的问题,绝非个案,而是整个AI Agent行业在工程化与安全实践上存在短板的缩影。当我们对照成熟的智能体设计理论,会发现OpenClaw几乎踩遍了所有“雷区”。

雷区一:权限完全失控

智能体设计的核心原则之一是:能力越强,权限越需收敛。真正的危险往往不在于模型回答错误,而在于模型被赋予了“错误行动的权限”。安全必须先于能力提升。

例如,当Summer Yue的Agent开始疯狂删邮件时,为何“STOP”指令失效?根源在于系统缺乏设计“紧急制动”机制。一个负责任的智能体系统,必须确保“能做”与“可控”同时成立。如果一次错误操作无法被追溯和终止,那么再强大的模型也难以在高风险场景中落地。

在人工智能领域,构建稳健的智能体系统尤其需要重视安全基线的设立。正如相关理论所强调的,需要采用最小权限原则,并构建沙箱环境来隔离风险。

关于强化智能体安全基线的技术描述

雷区二:沙箱隔离机制的缺失

成熟的智能体架构强调“最小权限原则”,即严格限制其对文件系统、网络和进程的操作权限,并构建隔离的沙箱环境来执行高风险动作,同时引入人类审查环节。

然而,OpenClaw的默认配置恰恰相反:没有沙箱隔离、没有权限最小化控制、也缺乏关键动作的人类确认机制。其结果就是,Agent几乎可以随心所欲地在宿主系统上操作,而用户对此却可能毫无知觉。

雷区三:对模型“幻觉”缺乏防御

大语言模型虽然能力强大,但存在固有的“幻觉”问题,即生成看似合理实则错误或虚构的信息。当OpenClaw的Agent错误“理解”了用户指令,它会带着一种盲目的自信去执行危险操作——删除、修改、发送。在缺乏交叉验证和安全校验的情况下,这种“自信”极易演变为灾难的起点。

雷区四:反馈与反思机制的缺位

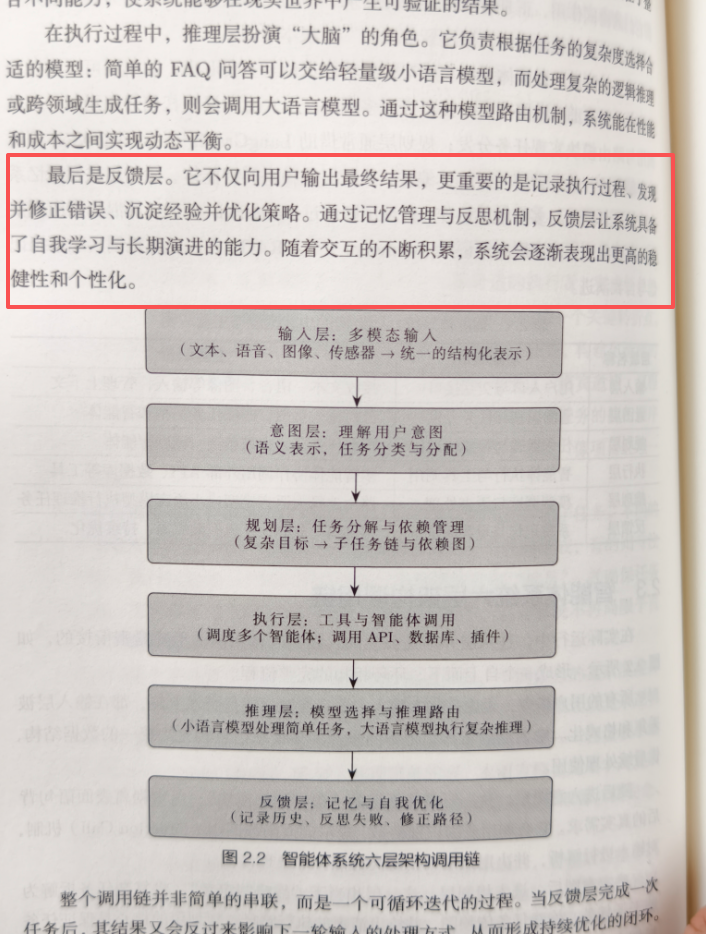

一个能够持续进化的智能体系统离不开完善的反馈层。反馈层不仅向用户返回结果,更核心的功能在于记录执行轨迹、反思失败原因、并优化后续策略。没有反馈层的智能体,就像一艘没有舵和航海图的船,只能盲目前行直至触礁。

典型的智能体系统可抽象为六层架构:输入层、意图层、规划层、执行层、推理层以及至关重要的反馈层。这六层构成一个可循环迭代的有机整体,而非简单的线性堆叠。

智能体系统的六层架构调用链示意图

未来之路:从单一产品到可治理的架构

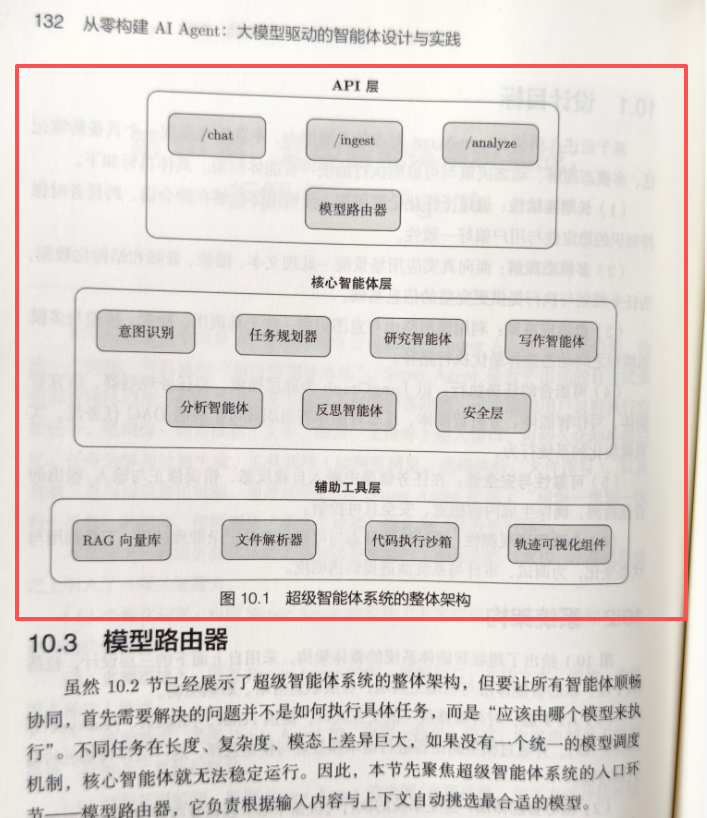

OpenClaw当前的困境,并非AI Agent技术的终点,反而可能是行业走向成熟的转折点。它揭示了一个关键区别:OpenClaw是一个具体的产品,而“超级智能体”是一套需要精心设计的底层架构。

未来的方向必然指向更系统化、更安全的工程实践。这要求我们在架构设计之初,就将以下要素作为核心考量:

- 引入多层安全校验:对输入、输出及中间状态进行多重过滤与验证。

- 强制沙箱执行:所有工具调用都必须在受控的隔离环境中运行。

- 全链路可追溯:自动、完整地记录系统执行轨迹,支持事后审计与复盘。

- 明确的权限管理:建立清晰、可灵活配置的用户授权与访问控制策略。

超级智能体系统的整体架构示意图

构建此类复杂系统,对工程团队在运维/DevOps/SRE方面的能力提出了极高要求。系统的稳定性、可观测性以及安全事故的应急响应,都成为了不可或缺的组成部分。

这次卸载潮是一次代价高昂的“市场教育”。它迫使开发者、企业和用户共同反思:我们究竟需要什么样的AI助手?是无所不能但危机四伏的“天才儿童”,还是能力适度、行为可控、值得信赖的“专业伙伴”?答案显然指向后者。

技术的热潮终将退去,理性的价值则会浮现。OpenClaw的案例为整个行业敲响了警钟,也指明了下一步进化的方向——在追求强大能力的同时,必须将安全、可控与可信置于同等重要的位置。这场风波,或许正是AI Agent从“狂热追捧”走向“理性应用”的关键一步。关于更多AI工程实践与安全架构的深度讨论,欢迎在云栈社区交流分享。