在AI的世界里,算法和算力构成了其发展的双翼。如果说算法决定了模型的“智力”,那么算力则决定了它思考和进化的“速度”。对于许多开发者和研究人员来说,理解并量化支撑庞大AI模型运行的GPU算力底座,是一项基础且必要的工作。

本文将带你深入GPU内部,拆解其理论峰值算力的计算公式,并通过对NVIDIA A100的实际计算演示,让你彻底掌握CUDA Core与Tensor Core这两大核心计算单元的算力评估方法。

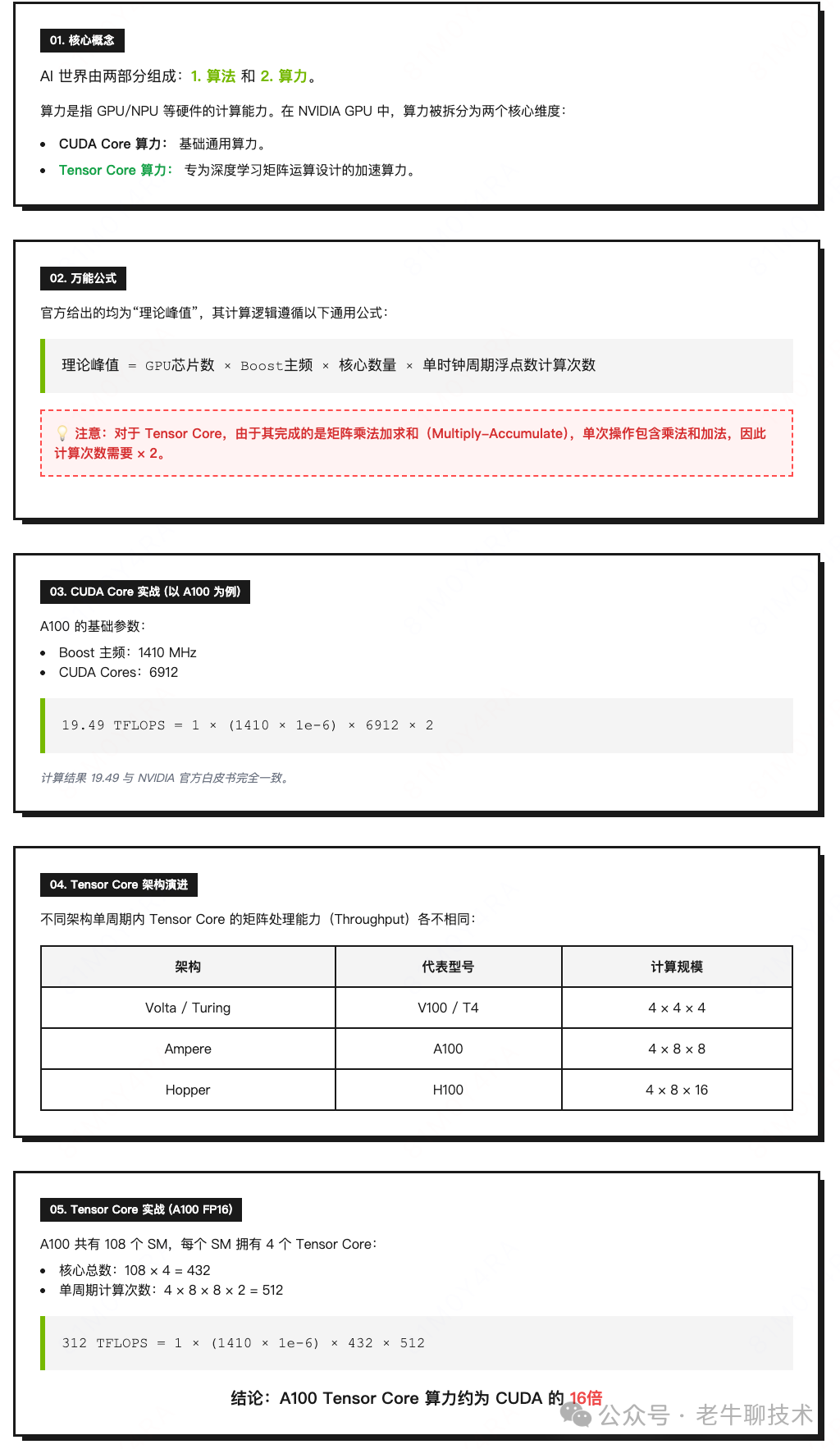

01. 核心概念

AI世界由两部分组成:1. 算法 和 2. 算力。

算力是指 GPU、NPU 等硬件的计算能力。在 NVIDIA GPU 中,这项能力被清晰地拆分为两个核心维度:

- CUDA Core 算力:基础通用算力,适用于广泛的并行计算任务。

- Tensor Core 算力:专为深度学习中的矩阵乘法与卷积等张量运算设计的专用加速单元,效率极高。

02. 万能公式

NVIDIA官方给出的性能参数通常是“理论峰值”,其背后的计算逻辑遵循一个通用的万能公式:

理论峰值 = GPU芯片数 × Boost主频 × 核心数量 × 单时钟周期浮点数计算次数

注意:对于 Tensor Core,由于其完成的是矩阵乘法加和操作,单次操作包含一次乘法和一次加法,因此计算次数需要乘以 2。

03. CUDA Core 实战(以 A100 为例)

我们以 NVIDIA A100 为例,实际计算其 CUDA Core 的 FP32 理论峰值。

首先,获取 A100 的基础参数:

- Boost 主频:1410 MHz

- CUDA Cores:6912 个

套用万能公式:

理论峰值 = 1 × (1410 × 10^6) × 6912 × 2 FLOPS

这里乘以 2 是因为 CUDA Core 每个时钟周期可以完成一次 FMA 运算,一次 FMA 包含一次乘法和一次加法,计为 2 次浮点操作。

计算过程:

- 将主频单位转换为 Hz:1410 MHz = 1.41 × 10^9 Hz

- 代入公式:1.41e9 × 6912 × 2 = 约 1.949 × 10^13 FLOPS

- 单位换算:1.949 × 10^13 FLOPS = 19.49 TFLOPS

计算结果 19.49 TFLOPS 与 NVIDIA 官方白皮书公布的 FP32 理论峰值完全一致。

04. Tensor Core 架构演进

Tensor Core 的架构在不断演进,其单周期内能处理的矩阵规模也不同,这直接决定了其峰值算力。以下是几个关键架构的对比:

| 架构 |

代表型号 |

每周期计算规模 (Tensor Core) |

| Volta / Turing |

V100 / T4 |

4 × 4 × 4 |

| Ampere |

A100 |

4 × 8 × 8 |

| Hopper |

H100 |

4 × 8 × 16 |

这个“计算规模”通常表示为 M × N × K,代表一个 Tensor Core 在一个时钟周期内可以完成一个 M行×K列 矩阵与 K行×N列 矩阵的乘法运算。规模越大,单周期吞吐量越高。

05. Tensor Core 实战(A100 FP16)

现在,我们来计算 A100 在 FP16 精度下 Tensor Core 的理论峰值。

首先需要明确:

- A100 共有 108 个流式多处理器。

- 每个 SM 拥有 4 个 Tensor Core。

- 因此 Tensor Core 核心总数为:108 × 4 = 432 个。

根据 Ampere 架构的规格,每个 Tensor Core 单周期可完成一个 4×8 矩阵与 8×8 矩阵的乘法(即规模为 4×8×8)。由于这是 MAC 操作,需要乘以 2。

- 因此 单周期计算次数为:4 × 8 × 8 × 2 = 512 次浮点操作。

再次套用万能公式:

理论峰值 = 1 × (1410 × 10^6) × 432 × 512 FLOPS

计算过程:

- 代入:1.41e9 × 432 × 512 ≈ 3.12 × 10^14 FLOPS

- 单位换算:3.12 × 10^14 FLOPS = 312 TFLOPS

结论:A100 Tensor Core 在 FP16 下的理论峰值算力约为 312 TFLOPS。对比其 CUDA Core 的 19.49 TFLOPS,Tensor Core 的算力约为前者的 16 倍。这正是专用硬件加速器在特定领域展现出的巨大性能优势。

掌握这套计算方法,不仅能帮助你准确理解不同GPU型号的纸面性能,还能在构建AI训练或推理平台时,做出更符合实际业务需求的硬件选型与成本评估。如果你对更底层的并行计算优化或具体的性能调优实践感兴趣,欢迎到云栈社区的相应板块与更多开发者交流探讨。