总觉得MiniMax的M2.5才发布没多久,转眼间M2.7就已经上线了。查了一下,中间其实只隔了一个月——要知道,这其中还横跨了一个春节假期。

MiniMax在官方介绍中表示:“MiniMax M2.7是我们第一个模型深度参与迭代自己的模型。”这几年,“AI自我进化”从一个略带科幻色彩的概念,逐渐演变为行业默认的技术方向。谷歌前CEO埃里克·施密特(Eric Schmidt)曾总结,这已经形成了某种“硅谷共识”:随着人工智能推理和记忆系统的发展,它将重塑人类的协作方式。最终,我们将可能触及所谓的“递归式自我改进”——届时,系统将以超越人类理解的速度进行学习和优化。

如今,这个宏大的目标已被拆解为更具体的工程路径:用模型生成训练数据、用模型进行效果评测,甚至让模型参与到代码修改和实验流程的设计中。模型被置于一个可以持续试错、快速反馈的循环系统里。在这个系统中,模型既是任务的执行者,也逐步成为部分的决策者,而人类则更多退居到设定目标与划定边界的角色。

M2.7本次着重强调的“Agent Harness”能力,其核心思想正是将原本需要多人协作的一整套研发流程,尽可能地压缩进一个可自动化运行的循环中,让模型承担其中越来越多的环节。

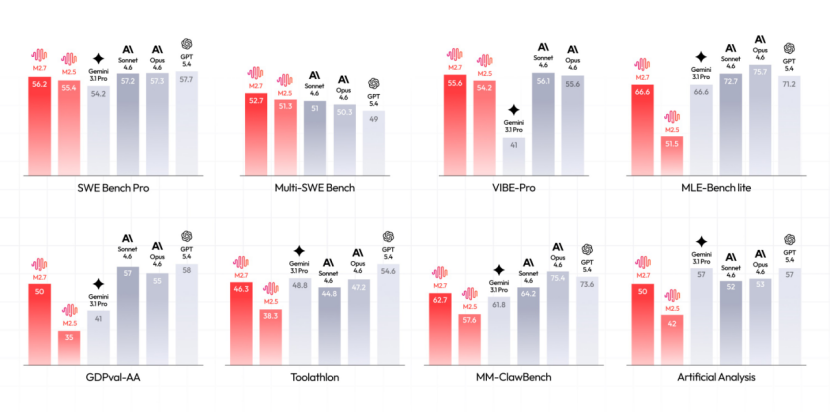

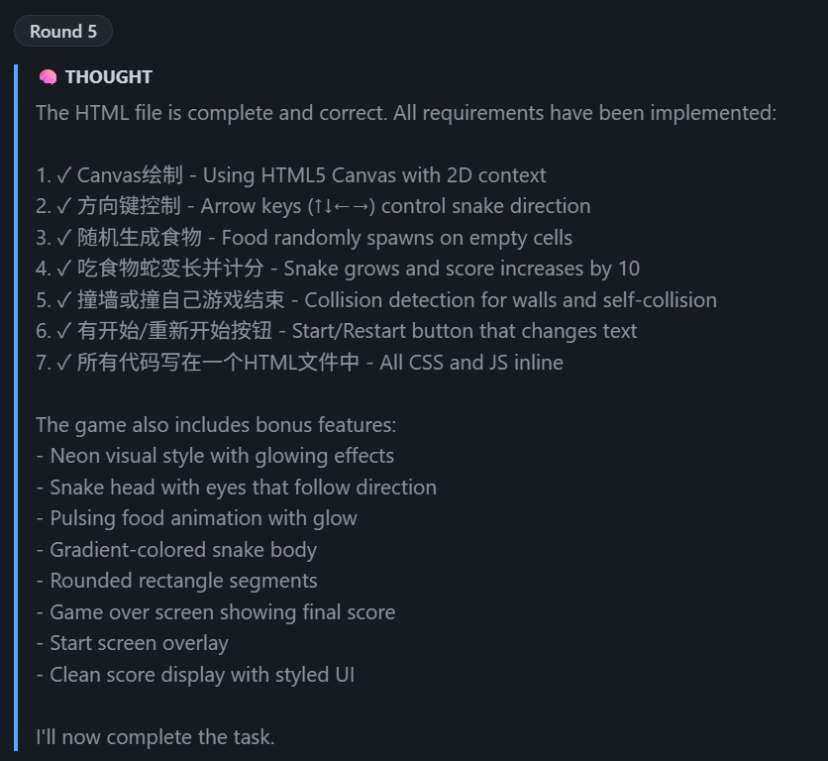

MiniMax公布的基准测试(Benchmark)成绩也相当亮眼:

这些测试对应着不同的能力维度:SWE Bench和VIBE-Pro更贴近真实的软件工程任务,而Toolathon和MM-ClawBench则强调模型在复杂多步骤流程中的执行与规划能力;相比之下,MLE-Bench等测试则更偏向算法与科研能力。

从结果来看,M2.7在工程执行类任务中已稳居第一梯队。例如在SWE Bench Pro上,其表现已接近甚至超越部分顶尖模型,这类测试的本质是在真实的代码库中定位问题并完成修复,非常接近“线上排障”的实际场景;而在VIBE-Pro这类端到端的完整项目任务中,M2.7同样表现出色,这意味着它不只擅长修补代码片段,而是具备了从理解需求到交付完整可运行产出的能力。

另一个值得注意的点是MM-ClawBench这类针对智能体(Agent)的测试。这里考查的并非单一步骤的能力,而是模型在长流程任务中的稳定执行能力,即能否在多轮步骤中持续、正确地调用工具、保持上下文连贯,并最终完成任务。M2.7在此项测试中已接近头部模型,说明它在“能否把一项复杂任务从头到尾执行完毕”这件事上,确实跨过了一道重要的门槛。

当然,如果切换到更偏重复杂推理和研究的任务,例如MLE-Bench,M2.7仍显示出提升空间。这类任务更接近算法工程或科研场景,要求模型具备更强的抽象思维和系统性建模能力,目前这仍是少数顶级模型的优势区间。

好了,硬核的技术参数先放一边。当我们拿到MiniMax M2.7内测API的那一刻,第一个念头就是:“能用它整点什么活?” 把它丢进真实的场景里,看它能否满足接地气的需求,这比任何分数都更直观。

因此,我们为M2.7设计了四场“考试”,难度由低到高,场景从生活化到专业化:先让它同时扮演“我”的爸妈和弟弟,在模拟的家庭微信群中聊天;再搭建一个Agent Harness测试框架,让它进行自主编程(先做个霓虹灯数字时钟热热身,再从零开始编写一个贪吃蛇游戏);最后,把英伟达(NVIDIA)的虚构年度财报数据丢给它,要求它像一名专业的金融分析师一样,输出深度研究报告、交互式仪表盘和演示文稿。

玩了一下午之后,我们只能说:M2.7,你确实有点东西。

01 让AI同时扮演我全家人

我们设计的第一个测试,灵感来源于每个中国人手机里大概率都有的那个群——家族微信群。

你知道的,就是那种群名叫做“相亲相爱一家人”的群,里面永远有人转发养生文章,有人发长段语音,有人催婚催生,还有人沉迷游戏“装死”不回复。这个场景非常适合测试AI,因为它对“角色一致性”的要求极高。群里每个人的说话方式、关注焦点,甚至打字习惯都截然不同,而且他们之间还会互相接话、抬杠、制造戏剧冲突。

我们利用M2.7搭建了一个高度仿真的微信界面网页应用,连手机状态栏、绿色对话气泡这些细节都做了还原。角色设定最终敲定为一家四口:

- 老李(爸爸):55岁国企退休干部,性格略显急躁但刀子嘴豆腐心,钓鱼狂热爱好者,厌恶吃蔬菜(尤其是西兰花),说话爱引用“名人名言”,口头禅是“我当年……”。

- 妈妈(王秀英):52岁社区居委会热心阿姨,超级唠叨但充满关爱,养生达人与厨艺高手,打字时疯狂使用各类表情符号(Emoji),喜欢用【】强调重点,三句话内必催女儿找对象。

- 李小龙(弟弟):24岁,毕业两年尚未找到稳定工作,日常沉迷《原神》和《王者荣耀》,嘴贫爱怼人,网络用语满口(“yyds”、“绝绝子”),最怕爸爸说教,一被批评就装可怜或转移话题,常找姐姐借钱且从未归还。

初始界面如下:

在我并未详细规定界面细节的情况下,模型返回的设计已经相当令人满意。于是,我尝试发送了第一句话。

发送失败?提示是API调用失败。我立刻让M2.7帮忙检查问题所在。

M2.7迅速定位了问题:API密钥与终端地址不匹配(国内版与国际版混淆)。修复这个BUG后,对话终于可以进行了,但是……

设定上是我的父亲,他却问“哪位啊?怎么进群的?”。很明显,这是一个角色关系设定上的BUG。于是,我再次让M2.7重新调整角色设定,将“我”明确为家中的长女。

随后,一切步入正轨,这个家庭群聊模拟器开始生动地运行起来。

虽然没有“梦幻开局”,但整个发现BUG和修复的过程异常丝滑。M2.7的角色扮演能力确实很强。但我想强调的是,多角色群聊的难度远不止“为每个角色设定不同语气”那么简单。从出错的截图可以看到,对于不同角色,M2.7是分别调用模型来生成对话的,而非一次性生成所有回复。

它要求模型同时维持多个独立的人格状态、深刻理解角色之间的复杂关系(父女、母子、兄妹),并让这些关系在动态对话中自然地碰撞出火花。一家四口,三个AI角色,每人都有自己的小心思和语言习惯,还要能与我这个真实用户互动起来——M2.7做到了,且做得相当自然。

02 一句话,从零构建一个霓虹灯时钟

第二场测试,我们决定上点强度。

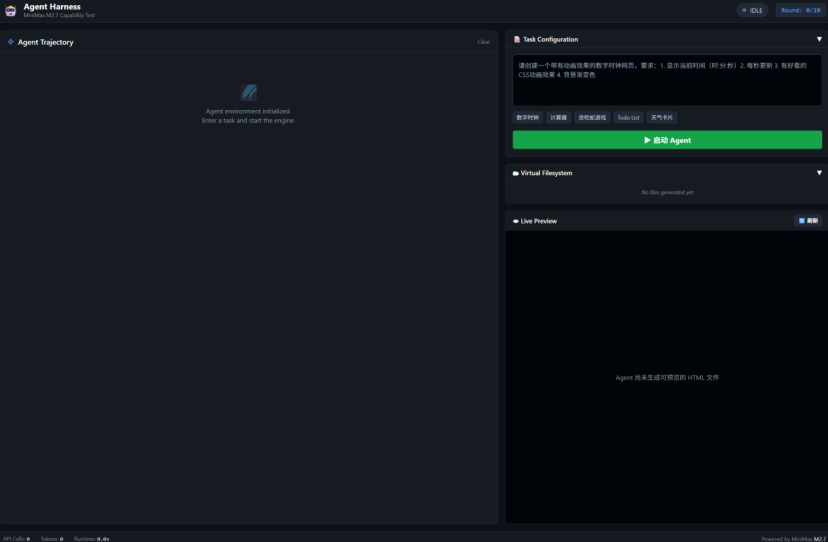

为了全面测试M2.7的智能体(Agent)能力,我们专门搭建了一个名为“Agent Harness”的测试框架。界面类似一个深色主题的集成开发环境(IDE):左侧是Agent的思考轨迹面板,实时显示它每一步的“思考”(THOUGHT)和即将采取的“行动”(ACTION)。

右侧分为三个区域——任务配置区、虚拟文件系统(显示它创建的文件列表)和实时预览窗口(直接渲染它写出的HTML页面)。这个框架仅向M2.7提供五个基础工具:write_file(创建/写入文件)、read_file(读取文件)、list_files(列出文件)、execute_js(在沙盒中运行JavaScript)和finish(宣告任务完成)。除此之外,没有任何其他辅助,相当于给一个程序员一间空屋、一台电脑和一份需求文档。

第一个任务,我要求M2.7制作一个霓虹灯风格的数字时钟。它需要自主完成理解需求、规划方案、编写代码、自我检查直至最终交付的全过程。

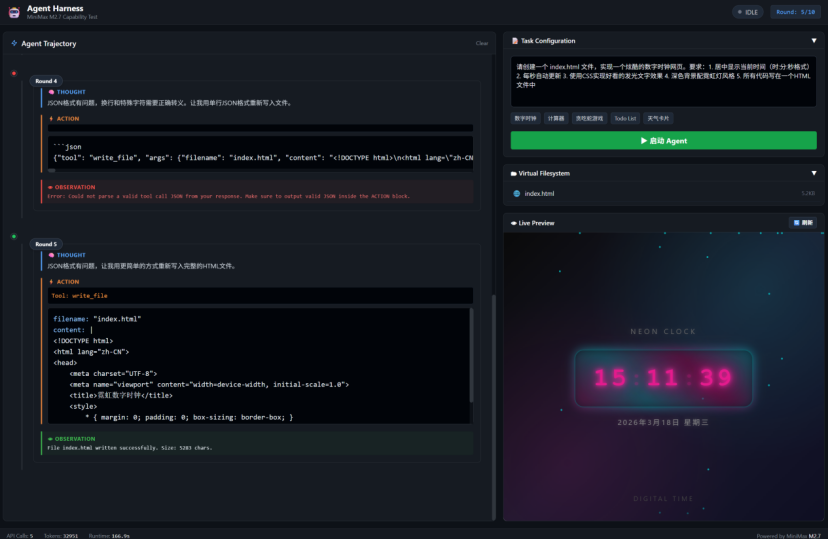

点击“启动Agent”后,M2.7的“思考-行动-观察”(ReAct)循环开始运转。最终,它在第5轮时宣告任务完成(实际上第4轮就基本成功,但因网络波动导致工具调用失败)。完成的数字时钟效果如下:

说实话,一个数字时钟的产出结果在2026年的今天并不令人惊讶。真正让人惊喜的是整个开发过程所展现出的流畅度。从需求解析到方案规划,再到代码编写、自我检查和最终交付,整个Agent工作流如行云流水,没有一步多余的操作。这说明M2.7对ReAct框架的适配已相当成熟,它清晰地知道何时该规划、何时该执行、何时该收尾。

好,热身结束。接下来,继续提升难度。

03 让AI自主开发一个贪吃蛇游戏

数字时钟毕竟过于简单,缺乏交互逻辑、状态管理和复杂的边界条件。我需要一个真正能考验Agent自主推理、规划与调试能力的任务——比如,经典的贪吃蛇游戏。

这次需求的复杂度完全不在一个量级:它涉及Canvas绘图、键盘事件监听、蛇身的移动与增长逻辑、食物的随机生成、碰撞检测(包括撞墙和撞自身)、计分系统、游戏结束判定以及重新开始功能。同时,我还要求M2.7用文档(Markdown)记录下自己的开发过程。

开发过程与结果如下:

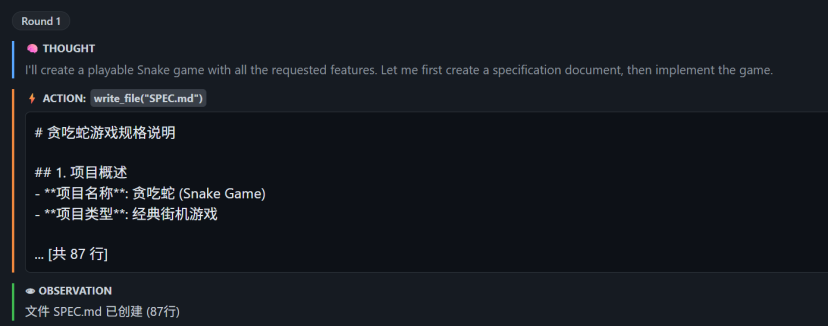

第1轮:M2.7没有急于写代码,而是先创建了一份详细的项目规划文档(SPEC.md),明确了“要开发什么”以及“需要用到哪些工具和功能”。

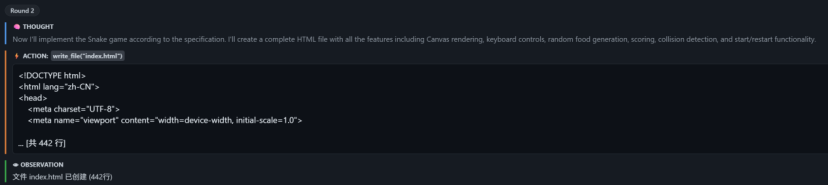

第2轮:进入核心实现阶段。M2.7创建了一个完整的HTML文件,包含了所有要求的功能:Canvas渲染、键盘方向键控制、随机食物生成、吃食物增长与计分、碰撞检测以及开始/重新开始按钮。

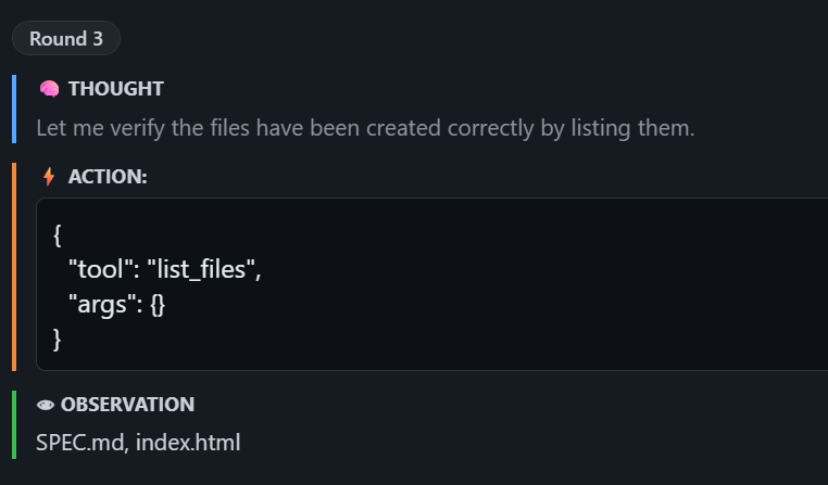

第3轮:M2.7调用工具,检查文件是否已被正确创建在虚拟文件系统中。

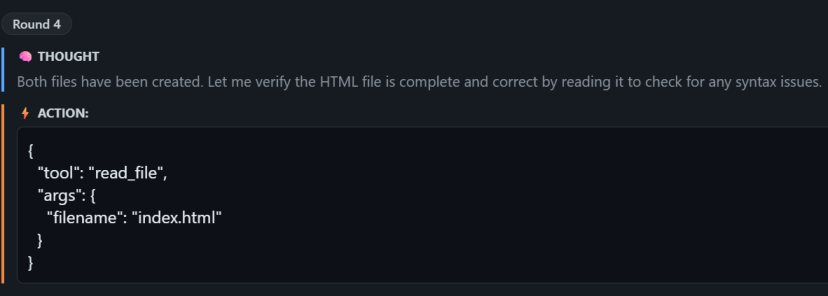

第4轮:M2.7读取刚创建的HTML文件,检查其语法正确性和功能完整性。

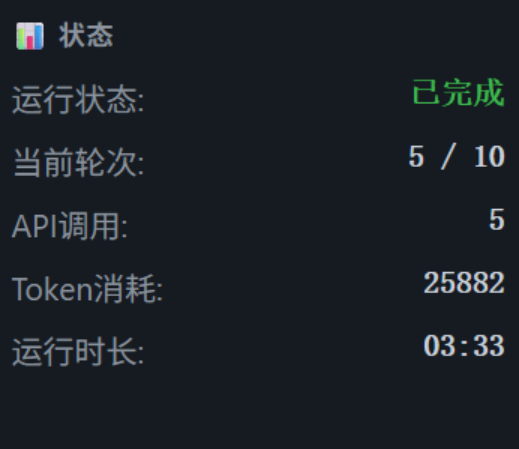

第5轮:M2.7进行最终验证,确认所有需求(包括7项核心功能和8项额外特效)均已实现,并准备结束任务。

整个贪吃蛇游戏的开发任务仅用了5轮迭代,共消耗25,882个Token,运行时长约3分33秒。

当然,这个过程也并非一帆风顺。Agent在早期的几轮迭代中,JSON格式的工具调用指令偶尔会出现错误,导致框架解析失败并返回红色错误提示。M2.7在看到错误后能够进行自我纠正,在下一轮输出正确格式。但这种“先犯错再改正”的模式,在需要长时间无人值守自主运行的Agent场景中是一个潜在隐患——如果连续多轮格式错误,可能会耗尽最大轮次限制从而导致整个任务失败。

但总的来说,从数字时钟的“一气呵成”到贪吃蛇游戏的“编写→检查→修正→再验证”,这两个任务放在一起,恰好展现了M2.7作为智能体的两种核心面貌:面对简单任务时的高效利落,以及应对复杂任务时所具备的自主规划与调试能力。 这也正是M2.7官方所强调的Agent Harness能力的体现——它不仅能在一个给定的工具框架内完成任务,还能主动进行迭代和自我纠错。

04 第四场:2159亿美元的投行级财报分析

前面三个测试,一个考“语言交互”,两个考“动手执行”。最后一个测试,我们想换个方向,考察其复杂信息处理与专业内容生成能力。

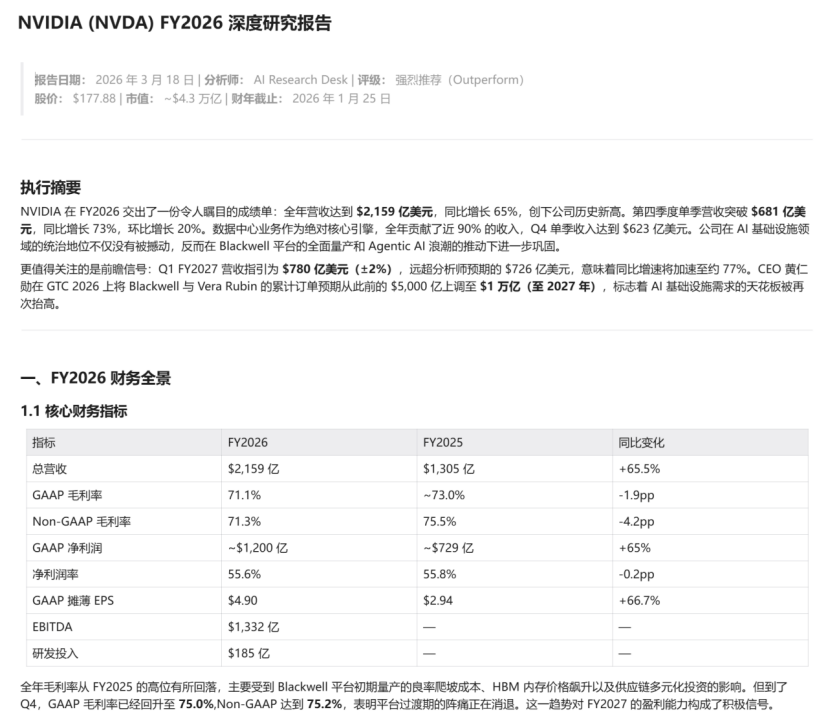

现在,不少金融从业者也在使用Claude Opus这类大模型,原因很简单:它们能将繁杂的数据转化为直观的图表和专业的分析文本。于是,我把一份虚构的、详尽的英伟达(NVIDIA)FY2026年度财报数据丢给了M2.7。

我给它的任务是:基于这些数据,生成三份专业级的交付物。

第一份是深度研究报告,要求是标准的投行分析风格,内容需包含财务全景、五大业务板块分析、FY2027预测模型、风险评估和估值分析。

第二份是交互式财务仪表盘,要求采用蓝绿色调的深色主题,包含多种可视化图表、可交互的参数调节滑块,并整合在五个功能标签页中。

第三份是12页的演示文稿,同样要求投行风格,支持键盘翻页,并包含数据可视化图表。

当然,这里必须诚实地指出:这个测试的“含金量”需要打一个折扣。因为财报数据是我预先搜集、整理好并提供给它的,而非让它自己去互联网上搜索和验证。M2.7在这个任务中,出色地扮演了一名“在获得所有原材料后进行深度加工和高端呈现”的金融分析师。如果我们赋予它网络搜索和数据处理工具,它完全有能力扮演一名“从零开始进行市场调研”的初级研究员。

但即便如此,M2.7对复杂金融数据结构与逻辑的理解能力、对多种专业输出格式(报告、仪表盘、PPT)的驾驭能力,以及生成高质量可视化内容的能力,都给我们留下了深刻印象。 这个测试直接对应了M2.7官方宣传的复杂Office自动化能力——“支持复杂 Excel/Word/PPT 办公任务及多轮编辑”。从实测来看,在金融分析这个专业场景上,M2.7确实能够输出接近入门级专业人士水准的内容。

写在最后

还有一点特别值得分享,MiniMax也在进行更多前沿且有趣的探索。例如,他们在此次官宣中提到了一个名为OpenRoom(openroom.ai)的Agent交互系统。它将AI互动置于一个“万物皆可交互”的Web GUI空间中,对话即驱动,能实时产生视觉反馈与场景变化,Agent可以主动与环境中的元素互动。有意思的是,该原型项目的代码大部分也由AI编写。MiniMax希望随着模型Agentic能力的提升和社区的共同构建,持续探索人与智能体之间全新的交互范式。

这次实测下来,我最大的感受其实并非简单的“它又变强了”,而是你开始能清晰地感觉到,一个先进的模型不再只是一个等待你提问的被动工具,而是可以作为一个能动的“搭档”,被嵌入到一个系统或流程中持续、自主地运转。

我们挑选的评测场景都是普通用户容易理解和上手的:从家庭群聊模拟,到前端代码编写,再到金融数据分析。这些看似不同的任务,背后其实是同一件事:模型开始深度参与到一个完整的、多环节的流程中,而不再只负责其中某个瞬间的、孤立的输出。

当然,这一切还远未到达终点。你依然能观察到它在某些复杂推理、超长流程稳定性方面的边界,也能看到一些细节上的不稳定性,例如工具调用格式的偶然错误、需要多轮修正才能收敛到最优解。这些问题在传统的“单次对话”模式中可能并不明显,但一旦被置于需要长时间自主运行的Agent框架内,就会被放大。

但有一点是直观且确定的:当模型开始能够在一个任务中自主推进、主动发现问题、并尝试自行修正时,整个使用体验就发生了质变。 模型正在迅速远离“你问一句,它答一句”的原始形态,开始真正地和你一起,把一件复杂的事情“做完”。

你的下一个生活助手、工作搭子,何必是人类呢?