最近与不少企业的架构师、CTO和数字化负责人交流时,大家不约而同地聊到一个问题:打算如何将AI真正下发到员工手中使用?

交流一圈下来,一个现象很有趣——很多人对这件事的理解,还停留在“给个账号”或者“装个软件”的层面。但对于那些已经将AI融入业务流程思考的同仁来说,隐隐的担忧已经浮现。

随着能够自主执行任务的Claw智能体日益成熟,越来越多的企业开始严肃地思考一个问题:AI助手,到底该怎么安全、高效地分发给员工使用?

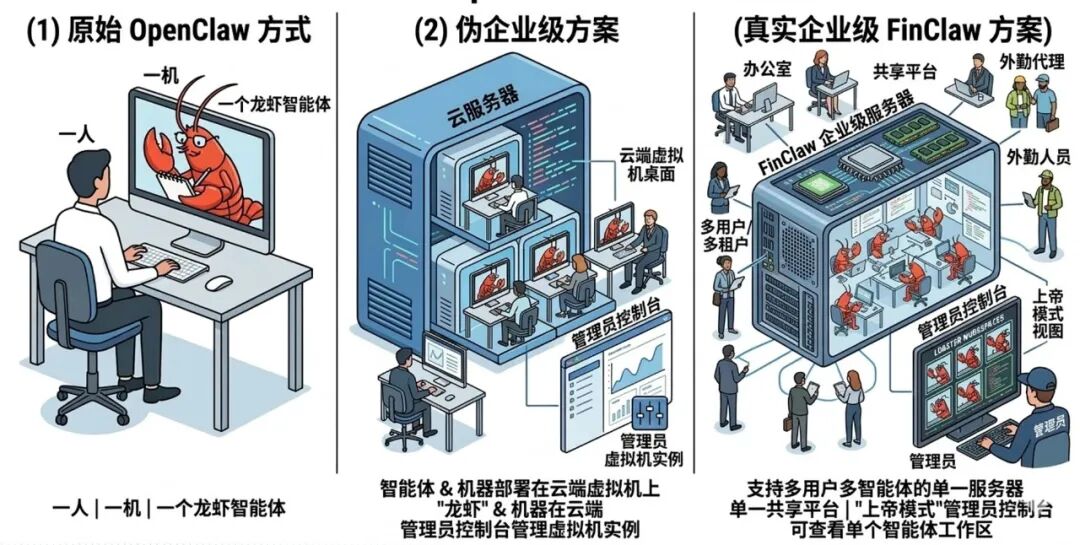

是给每个人配一台电脑,各自运行独立的AI环境?还是在一个统一的共享平台上,让所有员工共用一套经过治理的基础设施?

这两种路径,表面上都能让员工用上AI,但在实际的企业运营中,它们带来的管理复杂度、安全风险和成本压力,可谓天差地别。

路径一:一人一机,各自为战

假设公司有200名员工。IT部门给每人发了一台专用电脑,让大家自行下载OpenClaw,自行配置环境、安装插件、连接数据源。看起来人人都有了AI助手,但很快,现实的问题就会接踵而来。

运维团队将最先崩溃。

200台电脑,意味着200个独立的AI运行环境。软件需要升级?你得在200台电脑上挨个操作一遍。模型需要更新?200次手动配置。工具包需要打安全补丁?200次重新部署。运维人员很可能陷入“不是在修电脑,就是在去修电脑路上”的无尽循环。

安全部门的头会更疼。

企业必须控制AI能访问哪些内部数据、调用哪些服务、执行哪些脚本。但在这种分散模式下,你几乎无法知晓每台电脑上的AI正在做什么。

员工可能无意中将客户数据传给了外部API,可能安装了来源不明的恶意插件,甚至可能让AI直接操作关键内部系统。每台员工电脑,都可能成为一个缺乏监控的“安全后门”。

财务部门看着账单只能摇头。

每台电脑都需要配置CPU、GPU和内存,但这些昂贵的计算资源在大部分时间可能处于闲置状态。整体的算力利用率可能低至20%。更严峻的是,当公司规模从200人扩张到500人时,你不是在扩容,而是在“重复造轮子”——再次采购300台电脑。

这条路,本质上是 “个人软件时代”的思维:每人安装自己的软件,各自运行,各自维护。它适合开发者个人探索,也适合小团队进行技术验证。但当AI需要真正进入并支撑核心业务流程时,这条路径就走不通了。

路径二:一企一平台,统一调度

那么,如果我们换一个解决方案呢?

同样是200名员工,但这次,他们不再需要每人一台专用电脑。

IT部门只需要在数据中心或云端,部署一套基于chatkit-middleware的 云原生平台。所有员工的AI助手,都运行在同一个服务器集群上。每个人拥有独立、隔离的工作空间,但底层的计算、存储和网络资源由平台统一调度和管理。

运维团队终于可以喘口气了。

所有的AI实例共享同一套基础环境。升级核心模型?一次操作即可全局生效。更新工具包或打安全补丁?整个平台同步完成。管理200个AI助手,变得像管理一个单一系统那样高效,而非面对200个孤岛。

安全部门能睡个安稳觉了。

管理员在统一的管理控制台上,通过策略配置就能定义所有AI智能体的行为边界:

- 哪些工具允许使用,哪些被禁止;

- 哪些内部数据源可以访问,哪些必须隔离;

- 哪些脚本被允许运行,哪些会被直接阻断;

- 哪些外部API可以连接,哪些必须经过审批。

一次配置,自动作用于整个平台。每个员工的AI都在预设的“安全沙箱”内活动,极大降低了越界风险。

财务部门看着成本报表露出了笑容。

计算资源是动态调度、按需分配的。上午销售部门集中进行客户数据分析,算力优先倾斜给他们;下午研发部门进行模型训练,资源再灵活切换。企业不再需要为每位员工冗余配置硬件,只需根据平台的整体负载,弹性地增加或减少服务器节点。当公司从200人扩张到500人时,可能只需要增加少量服务器,成本呈线性增长,而非指数级飙升。

这条路,是 “云平台时代”的思维:统一部署、统一治理、统一扩展。它让AI从一种“个人工具”真正转变为了“企业级基础设施”。

多场景对比:两种模式,员工使用AI的三种画面

如果只看技术架构图,这两种模式的区别可能只是“单机 vs. 集群”。但在真实的业务场景中,它们的差异直接决定了:你部署的AI到底能不能顺畅地用起来,并产生业务价值。

场景一:市场部需要AI自动生成每周分析报告。

在个人工作站模式下,IT需要确保每个人的电脑都安装了正确的报告插件、连接了公司的数据中台、并配置了统一的提示词模板。如果有人电脑故障,他的报告就会中断;如果有人出差未携带电脑,任务就会停滞。

在云原生平台模式下,市场总监只需在管理后台创建一个“周报生成”自动化任务,勾选需要参与的全体员工。AI会自动从数据中台拉取数据,生成报告,并推送到每个人的工作台。全程无需员工手动干预,打开手机即可确认结果。

场景二:销售部需要用AI分析大量客户通话录音。

在个人工作站模式下,IT需要将数千条录音文件分发给每位销售,各自用本地的AI进行转写、分析和总结。不仅处理效率低下,而且敏感的录音文件分散在众多电脑上,数据安全和一致性都是巨大挑战。

在云原生平台模式下,销售总监只需将录音文件批量上传至平台。平台会自动调度资源,分发给多个AI实例并行处理,所有分析结果在完成脱敏后,统一汇总并存入企业知识库。整个团队看到的是同一份权威的分析结论,而非20个不同版本。

场景三:合规部门需要对AI的所有操作进行审计。

在个人工作站模式下,审计人员需要挨个检查每台电脑的日志——前提是员工开启了日志记录功能。这几乎是一项不可能完成的任务,最终很可能“查无对证”。

在云原生平台模式下,管理员打开统一的审计中心面板,所有AI助手的执行记录一目了然:何人、何时、调用了何种工具、访问了哪些数据、输出了什么结果。所有记录不可篡改,全程可追溯,满足严格的合规要求。

从“AI工具”到“AI生产力”

Claw这类自主智能体的出现,正在重塑企业对AI能力的期待。过去,AI更像一个“问答机”,有问有答,用完即走。现在,它正在成为一个可以长期运行、持续协作的智能体。它能帮你监控数据、执行业务流程、撰写报告、进行分析,就像一个不知疲倦的“数字员工”,交代一次任务就能持续跟进。

但要支撑起这样一支“数字劳动力”队伍,企业必须选对底层的基础设施。如果选择“一人一机”的分散模式,你得到的只是一个偶尔使用的“实验性工具”,你不敢依赖它,更不敢将其托付给核心业务。如果选择云原生平台模式,你拥有的则是一支“数字员工团队”,7x24小时在线,随时响应,并且全程可管、可控、可审计,能够真正深度参与到业务运转中。

未来几年,会有越来越多的企业认识到:AI智能体不是一个个孤立的应用,而是一种新型的企业基础设施。它就像电力,不应该要求每个员工自备发电机,而应该由企业建设统一的“电网”,让员工可以按需、安全、便捷地取用。

而云原生的AI智能体平台,正是构建这套“企业AI电网”的核心。对于企业技术决策者而言,这不仅是技术选型,更是关乎未来数字生产力的战略布局。想了解更多关于企业级智能体平台的前沿实践,欢迎在云栈社区与同行们一起探讨。