国产AI芯片厂商燧原科技近日以开源组织的身份正式入驻了国内代码托管平台Gitee,这对于关注国产算力生态的开发者来说,无疑是一个值得关注的技术动态。

燧原科技成立于2018年,总部位于上海张江,是国内少数同时具备高性能云端训练与推理能力的AI芯片企业。

成立以来,公司自研迭代了多代云端AI芯片架构,产品体系覆盖了从AI芯片、加速卡、智算系统到软件平台的完整链条。

作为算力平台“模力方舟”的深度生态合作伙伴,此次入驻Gitee标志着燧原科技在构建开源生态上迈出了实质性的一步。开发者现在可以直接访问其组织主页,一探其技术家底。

🔗 燧原科技 Gitee 组织链接:https://gitee.com/EnflameTechnology

已开源项目:聚焦大模型推理软件栈

燧原在Gitee上开源的内容,核心是围绕其自研的GCU(General Computing Unit)芯片构建的大模型推理软件栈。目前首批上线了4个关键项目:

- vllm-gcu:基于原生 vLLM 框架适配燧原GCU(S60)的大模型推理系统。该项目旨在让开发者能够在国产GCU硬件上直接复用成熟的vLLM生态能力,显著降低从传统CUDA生态迁移过来的成本和门槛。

- FFmpeg-GCU:这是一个基于燧原

topscodec编解码能力的FFmpeg插件。它的作用是将视频编解码这类计算密集型任务卸载到GCU硬件上进行加速,非常适用于视频理解、直播内容审核等需要对视频流进行高效前处理的人工智能应用场景。

- ModelZoo:由燧原开发和维护的模型合集。它涵盖了计算机视觉(CV)、自然语言处理(NLP)、推荐系统等多个领域的经典模型和SOTA(State-of-the-Art)模型,提供了在GCU上进行训练和推理的示例。这对于验证模型在特定硬件上的兼容性以及进行性能基准测试非常有帮助。

- candle-vllm-gcu:这是一个基于Rust语言Candle框架的GCU推理实现。它为那些偏好Rust技术栈,或者对部署体积、内存占用有严格要求的开发者,提供了一条区别于主流Python生态的、更轻量级的大模型推理路径。

软件栈全景:从驱动到平台的完整分层

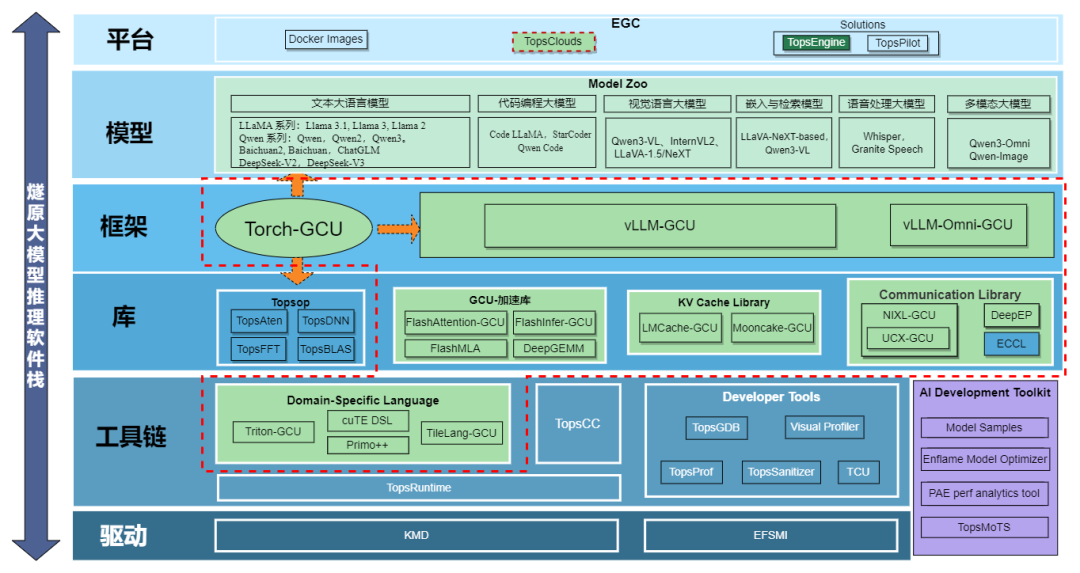

除了具体的开源仓库,燧原还公布了一张其“大模型推理软件栈”的完整架构图,让我们能清晰地看到其技术布局的全貌。整个栈被系统地分为六个层次:

- 驱动层:最底层,包含KMD、EFSMI等,负责最基础的硬件资源管理和监控。

- 工具链层:提供了Triton-GCU、TileLang-GCU等领域专用语言(DSL)和编译器,以及TopsGDB、TopsProf、Visual Profiler等开发调试工具。这一层是算子开发和性能深度调优的基石。

- 库层:这是计算加速的核心,聚集了各类高性能库。

- 计算库:如Topsop通用算子库、FlashAttention-GCU等。

- 通信库:如NIXL-GCU、UCX-GCU,用于多卡、多机间的高效通信。

- 专用库:如优化KV缓存的LMCache-GCU,这对大模型推理的吞吐量至关重要。

- 框架层:以Torch-GCU为核心,向上支撑vLLM-GCU和vLLM-Omni-GCU,使得PyTorch和vLLM等主流AI框架能够近乎透明地调用GCU的算力。

- 模型层:由Model Zoo具体体现,覆盖了文本大模型、代码模型、多模态模型、语音模型等几乎所有主流的大模型类型,为上层应用提供了丰富的模型选择。

- 平台层:最上层,提供开箱即用的Docker镜像、TopsClouds云服务以及TopsEngine、TopsPilot等解决方案,方便企业级部署和应用。

一个重要的细节是,在架构图中,部分组件被标注为绿色,这代表它们是燧原未来计划开源的项目。这意味着,当前开源的4个仓库只是一个开始,未来可能会有更多底层的加速库、通信库乃至开发工具链代码进入开源体系,这对于构建一个健壮的国产AI芯片开发生态至关重要。

国产算力生态:开源是构建信任的起点

对于正在调研和评估国产AI芯片方案的开发团队而言,燧原的这一步开源提供了极佳的低门槛技术验证入口。开发者不再只能阅读文档或等待SDK,而是可以直接克隆代码,在真实的GCU环境中进行编译、运行和测试,亲身感受其软件栈的成熟度和性能表现。

开源代码是技术自信的体现,也是与开发者社区建立信任的桥梁。随着更多关键组件的开放,国产算力的软硬件协同优化将变得更加透明和高效。我们乐于见到这样的趋势,并欢迎开发者在云栈社区分享你在探索国产算力过程中的实践经验与见解。 |