当前大火的 OpenClaw,让越来越多的开发者意识到个人智能体带来的巨大生产力提升。然而,在实际部署和使用过程中,开发者们经常遇到两个棘手的难题:一是用户本地的敏感数据(如文档、密钥)会被上传至云端大模型,存在隐私泄露风险;二是执行任务时拼接的超长上下文会导致大量 Token 浪费,使得使用成本居高不下。

为了应对这些挑战,面壁智能联合多家机构,于近期正式发布并开源了 EdgeClaw 框架。这是一个基于 OpenClaw 开发的安全、高效端云协同智能体框架,其核心目标正是解决上述痛点。它通过创新的 三级安全协同 与 性价比感知协同 两大机制,在保障数据隐私的前提下,显著降低使用成本,为在 DGX Spark、Mac Mini 等桌面设备上部署智能体提供了更优的解决方案。

GitHub 项目地址:https://github.com/Openbmb/EdgeClaw

EdgeClaw:重新定义端侧角色,实现安全与效率的平衡

在传统的 AI Agent 架构中,端侧设备往往只扮演一个“提问者”的角色,所有数据和计算任务都被抛向云端。这种模式不仅导致了隐私泄露的隐患,也造成了云端算力的不必要消耗。

EdgeClaw 的设计哲学是让端侧“智能”起来。它通过三级安全协同机制,实现了本地数据的加密与安全隔离;同时,借助性价比感知协同机制,能够根据任务复杂度,智能地调度不同价位的云端模型。这两大机制运行在同一处理管线中,通过权重分配和短路策略协同工作,确保安全和成本优化两不误。

更重要的是,EdgeClaw 以 OpenClaw 插件的形式实现主要功能。这意味着开发者无需改动原有的业务逻辑代码,即可无缝接入 EdgeClaw 的能力,轻松实现“公开数据上云、敏感数据脱敏、私密数据落地”的智能数据流转策略。

核心技术剖析:三级安全协同机制

数据安全是智能体本地化部署的生命线。EdgeClaw 的一个核心创新是自研的三级安全协同机制。该机制通过在 OpenClaw 的执行流程中植入钩子(Hook),自动对每一条用户消息、工具调用参数和智能体输出进行敏感度分析,并将其划分为三个安全等级:

- S1:默认模式。信息被视为非敏感,可直接发送至云端大模型处理。

- S2:脱敏模式。信息包含敏感内容,系统会对其进行自动脱敏处理(例如,将真实姓名“王小二”替换为“员工A”),再将脱敏后的版本发往云端。

- S3:安全模式。信息涉及高度隐私或机密,将被强制隔离在本地,完全由预装在端侧的 MiniCPM 系列轻量模型进行离线处理,确保数据不出本地。

为了实现精准、高效的敏感信息识别,EdgeClaw 采用了基于规则检测器和本地 LLM 检测器的双引擎检测方案。两个引擎可以按需组合,通过配置文件灵活启用,以适应不同场景下的安全需求。

此外,EdgeClaw 还设计了一套“双轨记忆” 系统。云端模型只能看到经过脱敏处理的对话历史摘要,而包含完整、原始信息的记忆则被加密保存在本地,仅可由本地模型访问。这从根本上切断了隐私数据通过对话上下文泄露给第三方云服务的风险。

让每一分钱都花在刀刃上:性价比感知协同机制

在实际的 AI 编程助手工作流中,大部分请求其实都是查文件、看代码、简单问答等轻量级任务。如果全部使用最昂贵的高性能模型来处理,无疑会造成巨大的资源浪费。

EdgeClaw 的性价比感知协同机制正是为此而生。它利用部署在本地的轻量级模型充当“裁判官”(LLM-as-Judge),对用户发起的每一个请求进行复杂度分析,并将其分级,然后智能地路由到不同价位的云端模型上执行。

以上图为例,系统可以将任务分为 SIMPLE、MEDIUM、COMPLEX、REASONING 等不同等级,并为其配置不同成本的默认模型(如 gpt-4o-mini, gpt-4o 等)。在实际测试中,以典型的编程助手工作流为例,该机制可以将 60% – 80% 的请求路由到更经济的模型上,从而大幅降低整体使用成本。

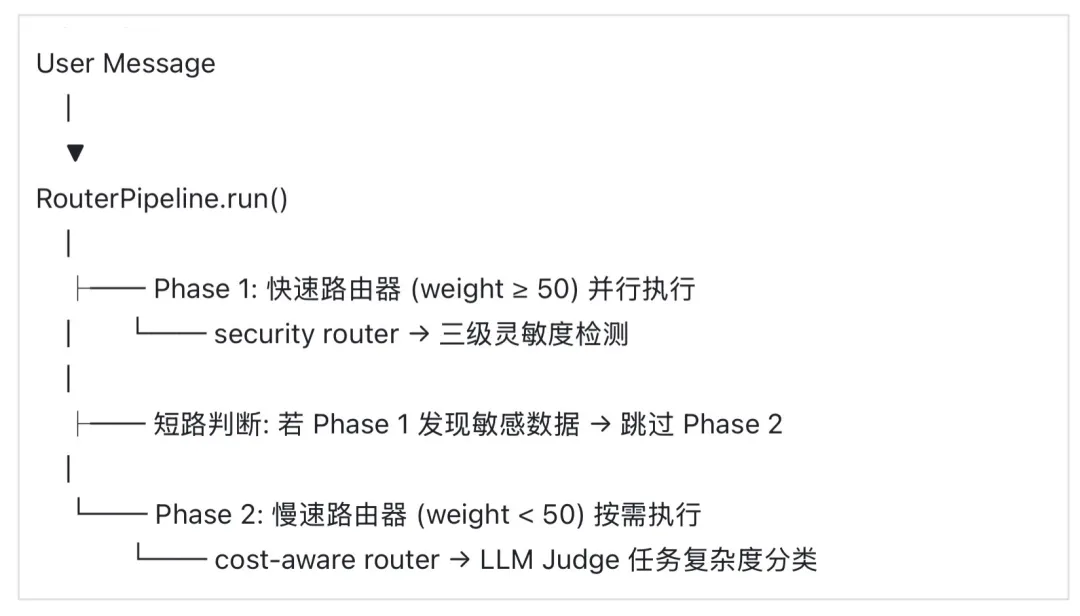

协同工作的核心:可组合路由管线

安全与成本优化并非各自为政。在 EdgeClaw 中,安全协同路由器和性价比感知协同路由器被集成在同一管线(Pipeline) 中协同工作。整个管线的设计遵循 “安全优先” 的原则:

- 第一阶段(快速路由):高权重的安全路由器并行执行,进行三级灵敏度检测。

- 短路判断:如果第一阶段发现敏感数据(S2或S3),则直接短路,跳过第二阶段的成本优化判断,立即按安全策略处理。

- 第二阶段(慢速路由):只有当请求被判定为安全(S1)后,才会启动成本感知路由器,对任务复杂度进行分析,以选择最具性价比的云端模型。

这种两阶段、权重重构的设计,确保了安全策略的绝对优先,同时避免了在敏感数据上浪费资源进行不必要的成本计算。

未来展望与开源计划

EdgeClaw 项目将持续迭代,目标进化为一个支持更广泛端侧设备部署的成熟软件系统。其未来的开发路线图主要包含四个方向:

- EdgeClaw Router:深化端云协同能力,支持更多种类的端侧硬件与本地模型,为用户提供更灵活多样的选择。

- EdgeClaw Memory:优化 OpenClaw 的记忆系统,实现面向长期、复杂任务的记忆机制,让智能体真正成为用户的得力长期助手。

- EdgeClaw SkillHub:构建专注于本地化任务的技能中心(Skill Hub),整合并内置高频使用的端侧技能,并对主流AI技能实现端侧模型替代,进一步提升效率与隐私性。

- EdgeClaw UI:开发更贴合端侧使用场景的前端界面,增加本地 GPU 利用率、本地 Token 消耗量等用户关心的性能监控指标。

EdgeClaw 始终聚焦于构建安全、高效的端云协同智能体解决方案,并将坚持开源。我们欢迎广大开发者与行业伙伴加入云栈社区的人工智能板块,共同探讨和贡献,一起打造真正“多、快、好、省”的下一代端侧 AI Agent 应用生态。