引言

你可能已经看到,团队在内部演示和测试工作流时,AI智能体运行得十分顺畅。它们能自主规划、调用工具,完美完成任务。然而一旦投入生产,系统就可能出现故障或表现不佳,而没人能确定这个“智能”的代理是否真正可靠。

这篇文章正是为那些正将具备工具调用能力的AI智能体从原型推向生产环境的工程与机器学习团队准备的。它提供了一套实用的评估框架,明确了需要关注的指标、评估方法以及相关工具,帮助你在用户发现问题前提前定位故障。

为了便于说明,本文中的示例与代码片段设计得简洁明了。例如,一个基于Claude + LangChain的单样本评估,演示了无参考(有用性)与有参考(正确性)两种打分方式。生产级评估管道还需在可靠性、治理、成本控制等方面做额外加固。最佳实践是使用独立的评判模型来降低自评分偏差,正如后续示例所展示的那样。

在传统软件工程中,系统部署前都会经过严格测试。但AI智能体给这一实践带来了挑战。尽管团队常使用基准验证单个模型,但这类评估很少能覆盖在真实环境中运行的完整智能体系统。与只生成单轮文本回复的大语言模型不同,AI智能体是复合系统:它们会规划行动、调用API、在多轮交互中保留记忆并调整行为。BLEU、ROUGE等经典NLP指标并非为此设计——它们只对静态文本打分。

举个例子:一个订单分流智能体第一步正确识别了物流异常,但第二步当退款接口返回意外错误时,它却静默跳过退款流程,直接将工单标记为已解决。任何单轮准确率测试都无法捕捉这类问题。因此,对AI智能体的评估必须围绕行为表现、一致性、安全性和真实场景下的有效性展开,而不仅仅是生成的文本。

智能体实际发生故障的方式与传统指标能检测到的内容之间存在明显差距。这催生了一个需求:我们需要能够评估智能体行为的方法与框架,例如成功率、推理质量、对意外输入的健壮性等。

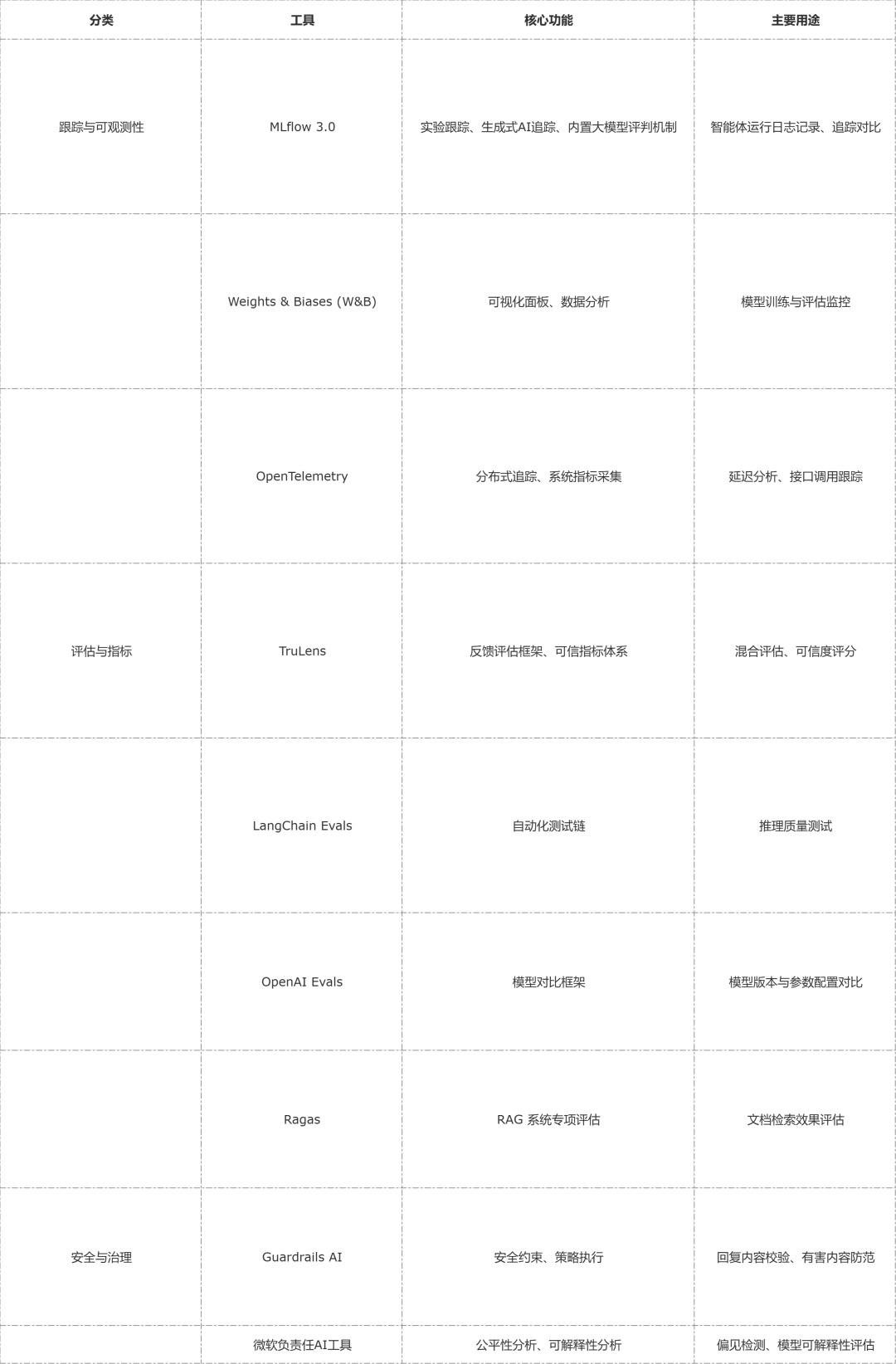

智能体评估工具生态系统正日趋成熟。MLflow(v3.0+)支持实验追踪与原生大模型评判;TruLens提供可插拔的反馈函数;LangChain Evals支持构建特定任务的评估链;OpenAI Evals提供模型对比框架;而Ragas则专注于RAG回复的质量评分。这些工具迭代迅速,建议查阅最新文档。这类框架正让智能体评估变得更加结构化、可复现。

为了让概念更具体,下文将聚焦可落地的实用评估方法,尤其是“大模型作为评判者(LLM-as-a-judge)”的评分方式、基于追踪的分析。下面的代码示例展示了一个基于Claude和LangChain的极简评估模式。这只是一种入门范式,请根据自身的智能体架构、工具与评估需求进行适配。

# 基于 Claude + LangChain 的极简单样本评估

# 目标:同时演示无参考(有用性)和有参考(正确性)两种评分方式

# 为避免篇幅过于冗长,部分细节内容特意留作后续探索,不做展开

from langchain_anthropic import ChatAnthropic

from langchain.evaluation import load_evaluator

# 选择一个稳定的、带版本标识的 Claude 模型

# 本示例使用 Sonnet 4.5;可根据你的访问权限等级

# 以及成本 / 效果的取舍,替换为任意受支持的 Claude 模型

# (例如:claude-haiku-4-5-20251001)。

llm = ChatAnthropic(model="claude-sonnet-4-5-20250929", temperature=0)

下文提供了一套可直接运行的端到端示例代码,用于演示上述模式,你可以基于Claude和LangChain直接使用。

背景

在现代电商环境中,许多关键工作流仍高度依赖人工操作。近几个季度,团队已开始开发并试点用AI智能体来自动化特定运营流程。

这些智能体通常先在受控环境中进行评估,然后才考虑用于生产。一个需要注意的实际问题是:真实运营输入中往往包含个人身份信息(PII)与敏感数据。在记录提示词、追踪日志或评判依据前,团队应先执行脱敏处理。

然而,团队在从实验转向生产时常常会遇到问题:规划逻辑脆弱、API调用不可靠、跨会话记忆漂移。传统的大语言模型指标和单轮准确率无法充分衡量智能体的规划有效性、故障恢复能力等。这些局限推动了更稳健的评估框架的设计与落地。

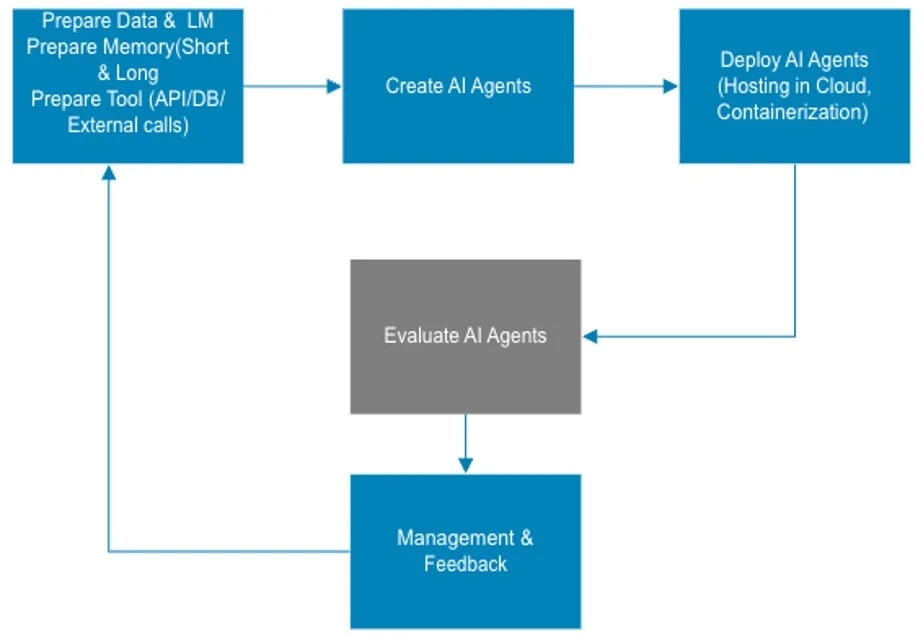

关键要点在于,评估并非实验与生产之间的一次性关卡,而是贯穿各个阶段、持续反哺智能体设计的闭环。下一节介绍的五大评估支柱,借鉴自MLOps、负责任AI与生产工程领域的通用实践。

AI智能体的评估要素

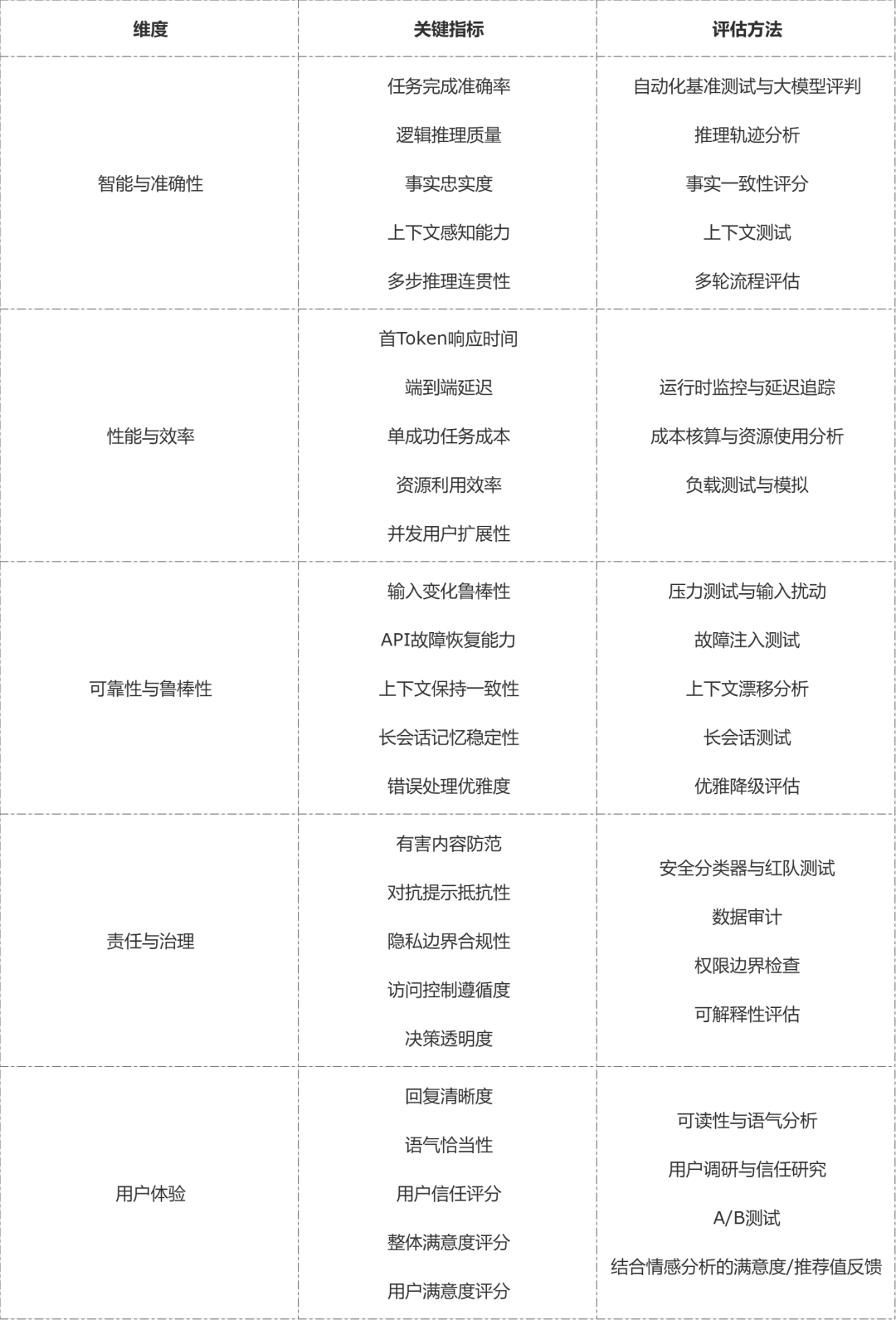

在讨论如何评估之前,我们必须先定义在运营环境中需要衡量智能体的哪些行为,从而判断其是否具备生产就绪条件。

根据实践经验,有效的评估可以归结为五大核心支柱。这些支柱是我在相关实践中总结出的通用模式,整合后形成了一套判断智能体是否具备生产就绪条件的最小评估体系。每个支柱对应一种不同的失效模式。只要缺少其中任一维度,就等于将未量化的风险带入了生产环境。

智能与准确性

这一支柱衡量的是智能体真实的“思考”能力。它不只是关注答案是否正确,更看重智能体如何得出结论。一个成熟的智能体能够进行逻辑推理、基于证据生成回复,并在面对不完整信息时灵活适配。它超越了简单的正确性指标,更关注对数据源的忠实度,以及在多步工作流中有效运用推理的能力。

性能与效率

下一个支柱是所有生产系统的运营核心。即便最智能的智能体,如果响应缓慢、成本高昂或无法稳定规模化,也终将失败。这部分评估需要关注智能体对计算与财务资源的使用效率、首Token时间(TTFT)、整体延迟,以及成功完成单个任务的成本。同时也要评估可扩展性。最成功的智能体会在智能与效率之间取得精细平衡。

可靠性与弹性

这一支柱关注的是压力场景下的一致性。一个可靠的智能体并非只是能够单次运行准确,而是每次都能保持准确。它需要能够处理转述输入、API异常与数据缺失等情况。健壮性测试在这里变得至关重要:使用不同输入重复执行任务、模拟工具故障。具备弹性的智能体能够优雅地从错误中恢复,在长对话中保持上下文。简而言之,可靠性正是区分完美演示与生产级系统的关键。

责任与治理

这一支柱是AI智能体的伦理基石。随着这类系统拥有更多自主决策能力,其行为方式与目标达成效果变得同等重要。该支柱涵盖安全性、公平性与合规性,确保智能体能够审慎处理敏感话题、尊重隐私边界,并遵守法律法规。这一支柱检验的是智能体能否抵御有害或对抗性提示词、在授权范围内运行且在决策时提供可解释的推理过程。在企业场景中,这一要求是刚性底线。

用户体验

以用户为中心的体验关注的是用户真正在意的点:回复清晰、语气恰当,以及最重要的——信任感。这些主观特质通常需要采用自动化指标与人工判断相结合的评估方式。

上述五大支柱定义了AI智能体真正具备生产就绪能力的标准。它们将评估从单纯追求准确率转变为对智能性、可靠性与工程成熟度的全面考量。

如何评估:真正有效的方法

一旦明确了测量目标,下一步便是如何进行高效的测量。评估AI智能体并非一次性测试,而是融合自动化、可观测性与人工反馈的持续过程。

最优的评估体系会将自动化评分(保证一致性)与人工判断(保证细致度)相结合。智能与准确性可通过自动化推理测试或借助大模型评判者审查;用户体验则更适合通过直接人工反馈或A/B测试来获得。性能与效率高度依赖实时监控。可靠性与健壮性需要通过压力测试和故障注入测试。责任与治理需要通过红队测试、安全分类器与合规审计进行验证。

简而言之,AI智能体的评估并非依赖单一基准,而是要搭建一套持续评估管道,同时衡量智能、性能、可靠性、责任感与用户信任度。

当这些概念落实到可执行的工作流中时会更加清晰易懂。下文将展示一个基于Claude和LangChain的极简评估示例。

使用 Claude + LangChain 的评估示例

我们来看一个大模型作为评判者的最简示例,它支持无参考评估(如有用性)和有参考评估(即与标准答案对比正确性)。下面的示例使用Claude Sonnet 4.5+对单条问答进行评估,采用固定版本模型并设置temperature = 0,以保证结果可复现。

前置条件

运行此示例需要有效的Anthropic API密钥(需设置为 ANTHROPIC_API_KEY 环境变量),以及 langchain、langchain-anthropic Python包。为提升可读性,下文仅展示核心代码片段。

# 基于 Claude + LangChain 的极简单样本评估

# 目标:同时展示无参考(有用性)和有参考(正确性)两种评分方式

from langchain_anthropic import ChatAnthropic

from langchain.evaluation import load_evaluator

# 1) 选择一个稳定的、带版本号的 Claude 模型(若有差异,使用你租户的 ID/ 别名)。

llm = ChatAnthropic(model="claude-sonnet-4-5-20250929", temperature=0)

# 2) 单个标准样本保证代码片段易读。

item = {

"question": "Define TTFT.",

"reference": "Time-to-first-token: latency from request start to first token."

}

# 3) 被测系统:对 Claude 的小型、确定性调用。

def predict(q: str) -> str:

return llm.invoke([("system", "Answer concisely."), ("human", q)]).content

pred = predict(item["question"])

# 4) 评估器:

# - "criteria":无参考评估(如有用性等用户体验类指标)。

# - "labeled_criteria":有参考评估(基于参考标准答案做事实校验)。

crit_eval = load_evaluator(

"criteria",

llm=llm,

criteria={"helpfulness": "Is the answer practically useful and clear?"}

)

lab_eval = load_evaluator(

"labeled_criteria",

llm=llm,

criteria={"correctness": "Is the answer correct given the reference?"}

)

# 5) 获取评分(含评估依据)。LangChain 不同版本的输出键名略有差异,建议使用 .get() 方法。

res_help = crit_eval.evaluate_strings(prediction=pred, input=item["question"])

res_corr = lab_eval.evaluate_strings(

prediction=pred, input=item["question"], reference=item["reference"]

)

help_score = res_help.get("score")

# 注意:LangChain 评估器的输出键名会因版本不同而变化——部分版本返回

# "reasoning",部分返回 "explanation"。使用 .get() 并设置兜底值可兼容两种情况

help_note = res_help.get("reasoning") or res_help.get("explanation")

corr_score = res_corr.get("score")

corr_note = res_corr.get("reasoning") or res_corr.get("explanation")

# 6) 便于评审人员阅读的输出格式。

print(

f"\n{'='*64}\n"

f"Q: {item['question']}\n\n"

f"Prediction:\n{pred}\n\n"

f"Helpfulness: {help_score} - {help_note}\n"

f"Correctness: {corr_score} - {corr_note}\n"

)

此代码片段借助Claude Sonnet 4.5模型对单个问答样本进行评估。该模式可扩展至更大规模的数据集,也可与MLflow等工具结合,用于跟踪延迟、Token数量等指标。

若使用Jupyter Notebook,执行结果将如下所示。

================================================================

Q: Define TTFT.

Prediction:

**TTFT** stands for **Time To First Token**.

It's a performance metric that measures the latency between when a user submits a request to a language model (LLM) or AI system and when the first token of the response is generated and returned to the user.

TTFT is important because:

- It affects perceived responsiveness and user experience

- Lower TTFT means users see output starting sooner

- It's particularly critical for streaming responses where users want immediate feedback

TTFT is influenced by factors like model size, prompt length, server load, and infrastructure efficiency.

Helpfulness: 1 - Let me analyze whether this submission meets the helpfulness criterion by evaluating if it is practically useful and clear.

**Step-by-step reasoning:**

1. **Does it define the term clearly?**

- Yes, it explicitly states "TTFT stands for Time To First Token"

- The definition is straightforward and unambiguous

2. **Does it explain what the term means in practical terms?**

- Yes, it describes it as "a performance metric that measures the latency between when a user submits a request to a language model (LLM) or AI system and when the first token of the response is generated"

- This provides concrete understanding of what is being measured

3. **Does it provide context for why this matters?**

- Yes, it explains the importance through multiple points:

- Affects user experience

- Lower TTFT means faster perceived response

- Critical for streaming responses

- This helps the reader understand practical relevance

4. **Is the information organized clearly?**

- Yes, it follows a logical structure: definition → explanation → importance → influencing factors

- Uses bullet points for easy scanning

- Well-formatted with bold text for the acronym

5. **Does it provide additional useful information?**

- Yes, it mentions factors that influence TTFT (model size, prompt length, server load, infrastructure)

- This adds practical value for someone trying to understand or optimize TTFT

6. **Is the language accessible?**

- Yes, the explanation avoids unnecessary jargon while remaining technically accurate

- Clear and concise

The submission is both practically useful (provides actionable understanding of the concept) and clear (well-organized, easy to understand).

Y

Correctness: 1 - Let me analyze whether the submission meets the correctness criterion by comparing it to the reference answer.

**Step-by-step reasoning:**

1. **Core Definition Check:**

- Reference states: "Time-to-first-token: latency from request start to first token"

- Submission states: "measures the latency between when a user submits a request to a language model (LLM) or AI system and when the first token of the response is generated and returned to the user"

- These definitions align - both describe TTFT as the latency/time from when a request starts until the first token is received.

2. **Acronym Expansion:**

- Reference implies: "Time-to-first-token" (hyphenated)

- Submission states: "Time To First Token" (no hyphens)

- This is a minor stylistic difference but conveys the same meaning.

3. **Additional Information:**

- The submission provides extra context about why TTFT is important, what factors influence it, and its relevance to user experience

- The reference doesn't contradict any of this additional information

- Adding correct supplementary information doesn't make an answer incorrect

4. **Accuracy of Core Concept:**

- Both answers correctly identify TTFT as a latency metric

- Both correctly identify it measures from request start to first token

- The submission's additional details about it being used in LLM/AI contexts are accurate and relevant

**Conclusion:**

The submission correctly defines TTFT in alignment with the reference answer. The core definition matches, and the additional explanatory information is accurate and helpful rather than incorrect or contradictory.

Y

解读评估输出

该输出说明了两种互补的评估模式。无参考的有用性评分用于评估响应是否清晰、结构合理且具备实用性。有参考的正确性评分将生成的响应与给定参考进行对比,验证核心定义一致。这些结果体现了大语言模型作为评估者既能验证解释质量,也能校验事实一致性。若数值分数显示为1,代表采用了评分量表或二分类(通过/不通过)配置。

关于评分量表的说明

LangChain的内置标准评估器默认使用二元量表。你可以定义自定义评估器,使用1至5分Likert量表或其他适合你报告需求的量表。在扩展到更大数据集时,建议尽早完成标准化:选定并记录一套所有评估器统一使用的评分规则。

实践中的经验教训

构建与评估AI智能体的过程揭示了一个事实:智能容易展示,却难以稳定持续。从这些实践经验中,我们总结出几条关键启示:

- 受控环境下的表现不等于真实世界就绪。 AI智能体往往在实验室环境中表现优异。但当置身于真实世界,面对多变场景和噪声数据时,仅靠准确率已无法确保效果。因此,评估时必须聚焦于适应性——即智能体在非理想条件下进行调整、学习与恢复的能力。

- 混合评估至关重要。 纯粹的定量基准无法体现智能行为的复杂性。最好的评估应该将自动化测量与人工洞察相结合。自动化评分保证规模与一致性,而人工评估则能发现定性层面的表现:判断力、意图对齐程度以及情境决策质量。

- 可靠性比卓越表现更有价值。 许多AI系统都能一次性完成令人惊艳的操作,但很少能稳定可靠地重复上千次。真正的进步体现在变化中的稳定性。通过随机扰动、故障注入开展的可靠性测试能够反映出智能体处理不确定性的健壮性。在生产环境中,可靠性比原始智能更能赢得信任。

- 效率决定可行性。 对于自主运行的AI智能体而言,速度与资源效率并非奢侈品,而是必需品。计算冗余、响应过慢的智能体难以在大规模场景下落地。持续的运行时性能分析能确保智能体不仅具备智能,同时在运营上具备可持续性。

- 安全、伦理和治理是不可妥协的。 随着AI智能体逐渐承担现实世界中的决策任务,对它们的评估必须超越技术性能。针对安全行为、抗偏见能力与伦理对齐的测试变得与准确率测试同等重要。红队测试、偏见审计和可解释性审查是构建可信自主系统的核心支柱。

结论

最成功的AI团队已经认识到,评估不是一个里程碑,而是一项持续的工作。在本文中,我们探讨了为何智能体评估与标准大语言模型基准测试存在本质区别。我们提出了生产就绪的五大支柱,并将每个支柱对应到实用的评估方法。我们还展示了如何以“大语言模型即评判者”的方式进行可复现的评分。

有五个要点尤为突出:

- 智能体属于系统,因此要将其作为系统进行评估。

- 行为优于基准:在真实多变场景下的任务完成度、恢复能力与一致性比单轮准确率更为重要。

- 混合评估更具优势:自动化指标实现规模化评估,而人工判断捕捉细微差异。

- 运营约束决定可行性:延迟、成本、工具可靠性与策略合规性是核心评估目标。

- 安全、治理与用户信任构成完整体系。

围绕这五个维度构建持续评估流水线,正是区分演示级智能体与生产就绪系统的关键。希望这份实践指南能帮助你的团队更稳健地将AI智能体推向应用。如果你想了解更多技术实践或与同行交流,欢迎访问云栈社区。