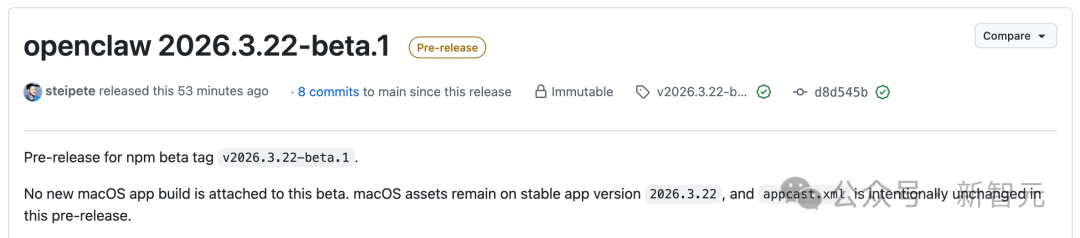

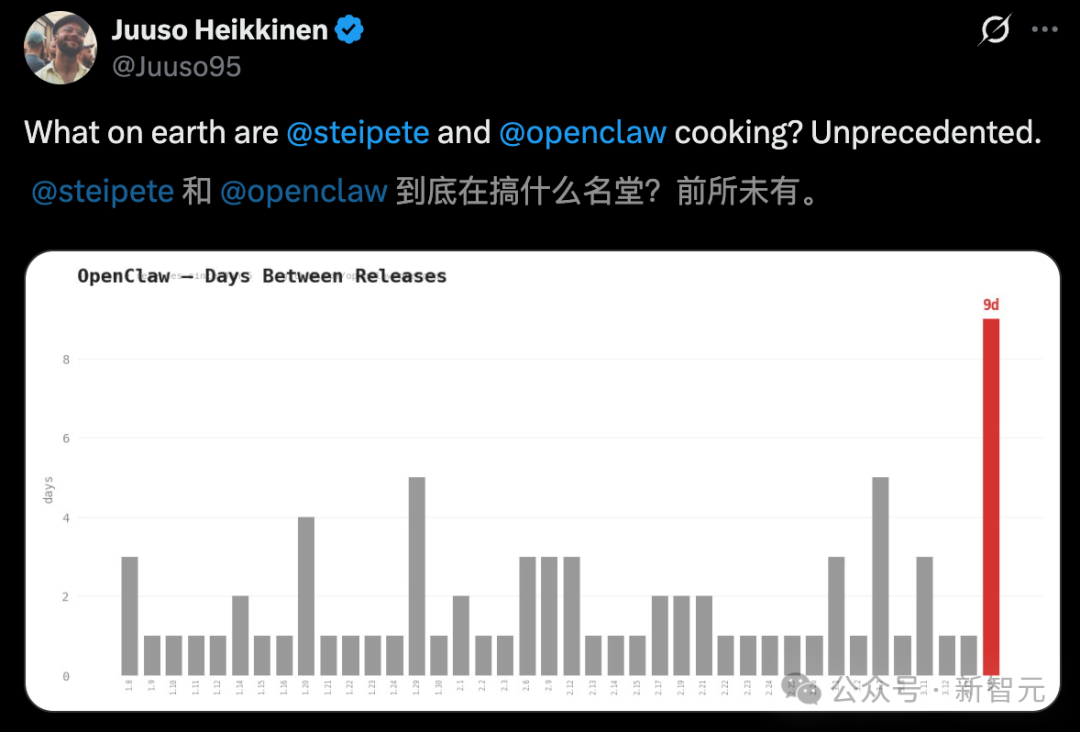

在连续9天没有更新后,开源AI智能体平台 OpenClaw 终于发布了其2026.3.22-beta.1预览版。此次更新并非简单的功能堆砌,而是对底层架构、安全体系和模型生态进行了一次深度手术。

社区用户对这次等待反应热烈。有开发者感叹“9天的等待终于结束了”,也有人表示新版本“感觉像是过了一个世纪”,迫不及待想要尝试。

项目维护者 Peter Steinberger 正式宣布了新测试版的上线。

这次 3.22 版本最引人注目的变化,是对插件系统进行了彻底的重构。全新的公开插件 SDK (openclaw/plugin-sdk/*) 上线,彻底废弃了旧有的扩展API。同时,OpenClaw 官方确认将 ClawHub 插件市场作为分发的首选渠道,显著提升了生态的纯净度。安全也是本次更新的重点,针对 Windows 用户,系统新增了多项拦截机制,对执行环境进行了加固。

新版本的 GitHub 发布地址为:https://github.com/openclaw/openclaw/releases/tag/v2026.3.22-beta.1

此外,OpenClaw 的默认模型配置也升级到了 GPT-5.4。UI 交互、长对话压缩机制、Android 端深色模式以及多平台通知逻辑也得到了精细化修复。新版一出,立即在社区引发了广泛讨论,许多开发者表示要立刻体验。

停更9天,OpenClaw新版引爆全网

这次更新远非小打小闹,而是一次深入底层架构的大修。早在预告阶段,OpenClaw 之父一张“龙虾镇场”的图片,就暗示了长达9天未更新的背后必有重大动作。

我们可以用几句话概括这次更新的核心:

- 插件系统换骨:旧 API 一刀切,新 SDK 全面接管,ClawHub 成官方首选分发渠道。

- 安全大修:Windows 凭证泄露、环境变量注入、Unicode 审批伪装等十多个漏洞被一次性封堵。

- 模型阵营扩军:GPT-5.4 默认上位,MiniMax M2.7 整合,Anthropic Vertex 正式接入。

- 体验逐帧打磨:Android 深色模式、飞书交互卡片、Telegram 话题自动命名、长对话压缩机制迭代。

插件系统大重构,旧时代正式翻篇

这次 3.22 版本最核心的变化在于,OpenClaw 的插件生态完成了“换骨”。旧的 openclaw/extension-api 被彻底移除,没有兼容层,也没有过渡期。取而代之的是全新的 openclaw/plugin-sdk/* 模块化接口。

这一改动相当彻底,所有仍在沿用旧 API 的第三方插件都需要进行迁移。官方甚至移除了旧有的 nano-banana-pro 图像生成技能包装器,统一使用 agents.defaults.imageGenerationModel 路径。

与此同时,插件安装的默认来源也发生了变化。以前执行 openclaw plugins install 会直接从 npm 拉取安装包。现在,ClawHub 成为了首选渠道——只有在 ClawHub 上找不到的包,才会回退到 npm 进行拉取。这样做是因为 npm 作为一个通用包管理器,包质量参差不齐;而 ClawHub 是 OpenClaw 官方维护的插件市场,审核更严格,来源更可控。这标志着插件生态的“净化运动”正式开启。

更值得关注的是“生态”兼容性的扩展。3.22 版本新增了对 Claude、Codex、Cursor 三大主流开发工具插件包的发现与安装支持,能够将外部插件包中的 Skills 自动映射到 OpenClaw 的技能体系中。这意味着,未来你在 Cursor 中使用的好用插件,有可能直接移植到 OpenClaw 中运行。这一步,让 OpenClaw 从一个相对封闭的工具框架,向一个能吸纳外部生态的开放平台迈出了果断的一步。

安全加固:这次补的全是要命的洞

如果说插件重构是面向未来的布局,那么安全修复就是对当下最紧迫问题的回应。3.22 版本一口气修复了十多项安全漏洞,其中几个相当关键。

第一个大洞:Windows 上的 SMB 凭证泄露。

此前,攻击者可以通过构造特殊的 file:// 或 UNC 路径,在媒体加载环节触发 Windows 自动发起 SMB 认证握手。此时,OpenClaw 以为自己正在加载一张图片,但实际上却可能将用户的 Windows 登录凭证发送出去。3.22 版本在核心媒体加载和沙盒附件路径中全面拦截了这类远程路径。

第二个:执行环境沙盒加固。

新版本直接封锁了 MAVEN_OPTS、SBT_OPTS、GRADLE_OPTS 等 JVM 注入路径,堵住了 GLIBC_TUNABLES 利用通道,还拦截了 .NET 的 DOTNET_ADDITIONAL_DEPS 依赖劫持。简单来说,主流构建工具链的环境变量注入攻击被一次性堵上了。

第三个:Unicode 零宽字符审批伪装。

此前有人发现,可以利用不可见的韩文填充码位(Hangul Filler)来伪装执行命令的审批提示,使操作者在审批时看不到真实的命令内容。3.22 版本在网关和 macOS 原生审批界面中全面转义了这类字符。

第四个:语音通话 Webhook 的预认证防护。

旧版本允许未认证的调用者以 1MB/30 秒的大缓冲窗口消耗服务器资源。新版本将预认证的 body 读取限制压缩到 64KB/5 秒,并限制了单 IP 的并发预认证请求数。

对于公网部署的用户而言,这一版更新不是“建议进行”,而是“必须进行”。

模型生态再扩张:GPT-5.4打头阵

在模型层面,3.22 版本也做了几个扎实的升级。默认的 OpenAI 模型正式切换到了 GPT-5.4,同时预置了 gpt-5.4-mini 和 gpt-5.4-nano 的前向兼容支持,确保新模型上线后能无缝接入。

在 MiniMax 方面,默认模型从 M2.5 升级到了 M2.7,并且合并了此前分离的 API 和 OAuth 两个插件入口,统一为单一的 minimax 插件,大幅降低了配置复杂度。

另一个亮点是 Anthropic Vertex 的正式接入。现在用户可以通过 Google Vertex AI 直接调用 Claude 模型,包括 GCP 认证和自动发现功能。对于已经在 Google Cloud 上开展业务的团队来说,这条路径的价值不言而喻。

此外,xAI 的 Grok 目录同步到了最新版本,Z.AI 的 GLM 也更新到了 4.5/4.6 系列,Mistral 的定价元数据终于不再显示误导性的“零成本”信息。OpenClaw 作为“模型路由器”的定位,正获得越来越多一线大模型厂商的认可。

多平台体验:每个细节都在打磨

这类更新虽然不“炸眼球”,但却是用户感知最强的部分。Android 端终于支持了跟随系统的深色模式,覆盖了从引导页、聊天页到语音页的全流程。Control UI 新增了“圆角滑块”,允许用户自定义界面的圆角程度。

Telegram 集成的改进不小,新增了 DM 论坛话题的自动重命名功能。在首条消息进入后,系统会使用 LLM 生成一个有意义的话题标签,取代原来无意义的 ID 串。同时,还支持了静默错误回复模式,机器人的报错信息可以选择不发出通知提示音。

飞书的升级同样值得一提。新增了结构化交互审批卡片和快捷操作启动卡片,支持了当前会话的 ACP 和子智能体绑定,还补全了推理流的渲染功能——AI 的思考过程会以 Markdown 引用块的形式实时显示在同一张卡片中。

在浏览器集成方面,旧的 Chrome 扩展中继路径被彻底移除,转而支持通过 userDataDir 直接连接 Brave、Edge 等 Chromium 内核的浏览器。沙盒系统也迎来了架构升级,新增了可插拔的后端支持,首批上线了 OpenShell 和 SSH 两个后端,使得沙盒管理不再与 Docker 单一方案绑定。

Agent引擎:压缩更聪明,调度更从容

在 Agent 层面,有几个值得单独提及的改进。长对话压缩机制进行了多轮迭代。新版本在压缩过程中会自动延长运行截止时间,避免大型会话压缩到一半因超时而被终止。压缩后还会自动修复孤立的 tool_result 块,防止历史记录中的残余数据影响后续的 Anthropic 请求。同时,空会话的压缩也不会再陷入死循环了。

默认的 Agent 超时时间从 600 秒大幅延长至了 48 小时。对于那些需要运行长任务的 ACP 会话,终于不用再被 10 分钟的默认限制所困扰。

还有一个非常贴心的新功能:/btw 命令。在对话过程中,你可以随时使用 /btw 插入一个“旁白问题”,AI 会快速回答,但这个问题和答案不会影响当前会话的上下文。这就像在和同事开会时,侧过身低声问一句题外话,问完后继续开会,互不干扰。

9天沉默,换来的是什么?

9天的等待,换来了一次重大版本更新。这种更新节奏说明,OpenClaw 团队已经度过了单纯“堆叠功能以冲击 GitHub Star 数”的阶段,开始认真打磨工程细节了。

从本次的升级点不难看出,OpenClaw 正朝着成为“可信赖的 AI 智能体平台”这一目标进行全面收拢。这些升级可能不会出现在炫酷的宣传海报上,但它们恰恰决定了谁敢于将 OpenClaw 引入生产环境。敢用,有时比好用更具挑战性。Peter Steinberger 及其身后的全球极客团队,显然已经深刻理解了这一点。每一次在GitHub上的代码提交,都是向这个目标迈出的坚实一步。

参考资料

对于持续关注 AI 与开源动态的开发者而言,OpenClaw 的这次架构级更新无疑提供了丰富的技术讨论素材。