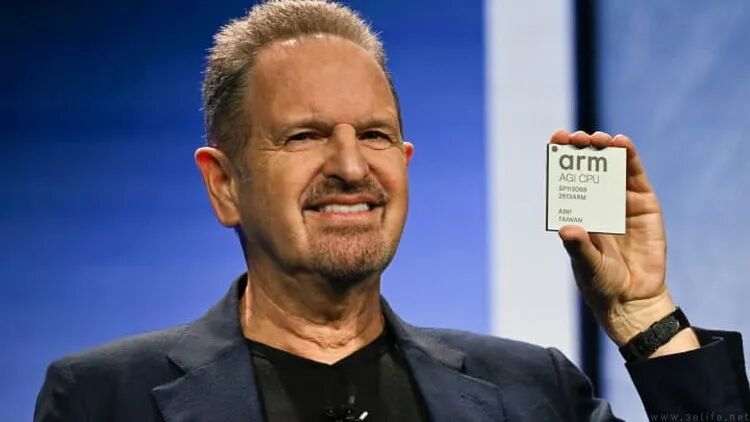

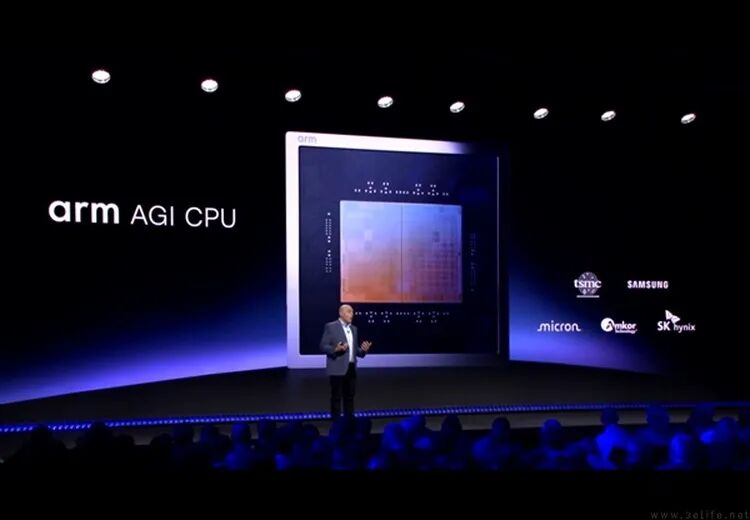

2026年3月24日,科技圈被一条重磅消息刷屏:Arm正式发布了其首款量产级实物芯片产品——Arm AGI CPU。这个举动,彻底打破了这家公司成立三十余年来只做架构和指令集授权的传统业务模式。

一款“Arm自有品牌处理器”的横空出世,不仅开拓了AI专用CPU的设计新思路,更引发了业界对Arm未来业务转型和整个生态系统布局的深度思考。

业界首款“AI专用CPU”,设计思路有何不同?

作为Arm亲自下场打造的首款实体CPU,Arm AGI从硬件设计到性能调校,每一个环节都围绕着AI应用所需的高并发、高负载场景进行优化。

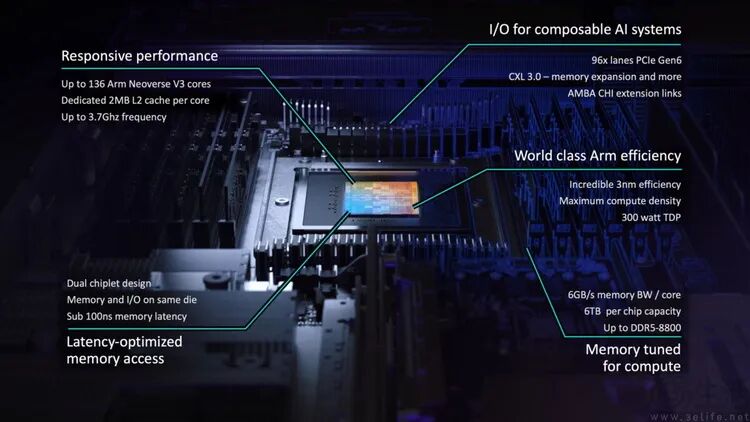

具体来看,它基于台积电的3nm先进制程打造,单颗芯片最高集成了136个Arm Neoverse V3核心,峰值主频达到3.7GHz,而其TDP(热设计功耗)仅为300W。这个参数组合本身就透露出与x86领域竞争对手截然不同的设计哲学。

如果与最新的x86服务器芯片对比,你会发现AGI几乎放弃了追求高主频带来的单线程响应速度,转而完全专注于长时间、高并发的稳态工作负载。

但更核心的差异在于其对内存系统的重构。传统服务器CPU在应对AI工作负载时,常面临一个结构性瓶颈:CPU核心规模与内存控制器的设计是解耦的。例如,某些96核或128核的至强处理器,其内存控制器规格是固定的。这导致在重负载下,核心数量越多,每个核心能分到的内存带宽反而可能越小,形成核心间争抢带宽的局面,最终表现为极高的内存延迟,并发计算效率大打折扣。

为了根治这一痛点,Arm AGI采用了核心数量与内存控制器规格直接绑定的策略。在其架构内部,每个核心被固定分配6GB/s的内存带宽,并且将内存访问延迟严格控制在100纳秒以内。

这种设计带来的直接好处是,无论面对数据中心的高密度部署需求,还是长时间稳定运行,Arm AGI都能保持极高的并发效率与能效比。由于单个处理器频率相对较低、发热量小,单机架能够部署的核心数量可以远超传统x86架构,理论上最高可达4.5万个以上,算力密度优势明显。

Arm亲自造芯,是在与客户“抢饭碗”吗?

在惊叹产品性能之余,Arm此番跨界推出CPU的举动,更触发了行业一个根本性质疑:作为上游的IP授权商,如今直接下场生产芯片,岂不是要与自己的客户正面竞争?

回顾Arm的发展史,其核心商业模式始终是提供CPU指令集或架构的IP授权,自身从不涉足实物芯片的研发与制造。下游的各类设备厂商基于Arm的授权完成芯片设计,再寻找代工厂进行流片和量产。即便是近年来力推的CSS(Compute Subsystem,计算子系统)方案,本质上也只是一个更完整、模块化的设计参考,生产环节的主动权依然掌握在客户手中。

然而,Arm AGI作为首款完全由Arm自主设计并推向市场的实物处理器,标志着Arm的角色发生了根本性转变——从“幕后架构师”走向了“台前芯片厂商”,直接踏入了下游合作伙伴的核心业务领域。这种颠覆性的转型,自然会让外界怀疑:Arm是否要打破原有的生态平衡,亲自下场分蛋糕?

态度坦诚的Arm与耐人寻味的客户反应

有意思的是,Arm在发布会上并未回避这个敏感问题,反而给出了相当直白的回应。Arm高管表示,当前全球AI算力市场正处于爆发式增长期,市场容量足够大,足以容纳各类参与者进行差异化布局,并非一场零和游戏。无论是Arm还是下游合作伙伴,都能在这个庞大市场中找到自己的盈利空间,实现共赢。

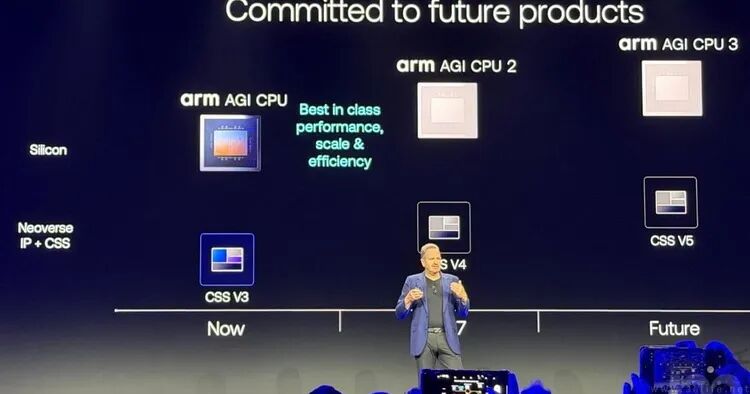

但Arm也同时公布了一项关键战略:未来全新的CPU架构将与Arm AGI系列处理器同步发布。这意味着,AGI产品线将永久占据Arm架构迭代的“首发席位”,成为全球首批搭载Arm最新技术的实体芯片,从而牢牢掌握技术迭代的先发优势。

Arm的潜台词很明确:“市场供不应求,我下场也不会真的抢走你们的饭碗。”那么,它的客户们买账吗?

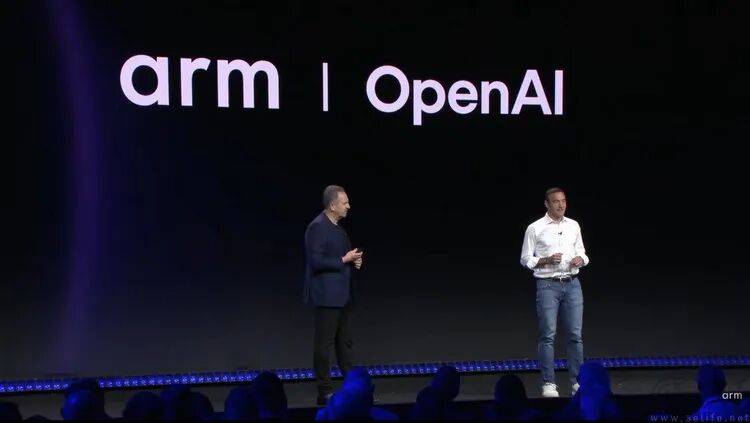

从发布会现场的情况看,答案出乎许多人的预料。包括Meta、英伟达、OpenAI在内的科技巨头纷纷为这款新CPU站台。英伟达创始人黄仁勋公开表示支持,Meta更是直接宣布成为Arm AGI的首批核心客户。现场没有任何反对的声音,合作伙伴们一致认可这款芯片的技术价值,认为它将有力推动生成式AI技术的大规模落地。这种集体支持的态度,与外界“同行是冤家”的预期形成了鲜明反差。

看似竞争,实则是一场巩固生态的“阳谋”

这种看似反常的集体支持背后,其实隐藏着Arm在AI时代进行生态布局的深层逻辑。

对于Meta、英伟达这样的头部大厂而言,它们与Arm的合作早已超越了简单的授权买卖关系。实际上,Arm的CPU架构设计长期吸纳了这些头部客户的深度参与。在联合调试与优化技术方案的过程中,头部厂商不仅提前洞悉了Arm的技术迭代方向,更成功地将自身的业务需求“内嵌”到了Arm的IP设计之中。

以Arm AGI为例,Meta就深度介入了其硬件设计与适配调校的全过程。这使得AGI虽然名义上是“公版”芯片,但其核心参数与性能逻辑,实则高度贴合Meta自身大模型训练和云端AIGC服务的特定需求。

因此,对Meta来说,Arm造芯非但不是威胁,反而让其能优先获得最新、最贴合自身需求的芯片,从而抢占算力先机。其他头部厂商很快也会意识到这一点:只要加大与Arm的联合研发力度,将自身需求融入AGI的后续产品路线图,就能获得同等的专属适配优势,同时制衡竞争对手。 这或许正是大厂们选择支持并深化与Arm合作的根本动力。

而对于中小型芯片设计公司或AI企业来说,Arm下场造芯更是带来了实打实的便利。过去,它们要么无力承担基于最新Arm架构进行自主研发的高昂成本和长周期,只能使用老旧方案;要么就只能从大厂那里采购“二道手”的芯片方案。如今,Arm直接提供成熟量产的CPU产品,意味着中小厂商无需经历复杂的设计和流片环节,就能直接采购到“与大厂同款”的先进算力硬件,大幅降低了进入高性能AI计算领域的门槛和周期。它们自然也没有理由反对。

综上所述,Arm看似跨界下场与客户竞争,实则是在用实物产品搭建一个更紧密、更深度的生态闭环。它将原本相对松散的架构授权合作,转化为利益深度绑定的“联合研发共同体”,从而倒逼所有核心客户进一步向自己的生态靠拢。

这场看似“抢市场”的业务转型,既是Arm巩固其生态领导者地位、抢占AI算力制高点的精心布局,也为全球半导体行业未来的生态合作模式提供了一个新的思考方向。想了解更多前沿技术动态与深度解读,欢迎访问 云栈社区 参与讨论。