在2026年4月下旬火热进行的中关村论坛上,昆仑万维旗下天工AI带来了其最新的技术成果与战略思考。

这家早在2022年便已宣布“All in AGI 与 AIGC”的公司,在此次高规格论坛上展示了为实现通用人工智能目标而构建的“武器库”。本届论坛以“科技创新与产业创新深度融合”为主题,吸引了全球产业界、学术界与投资界的广泛关注。

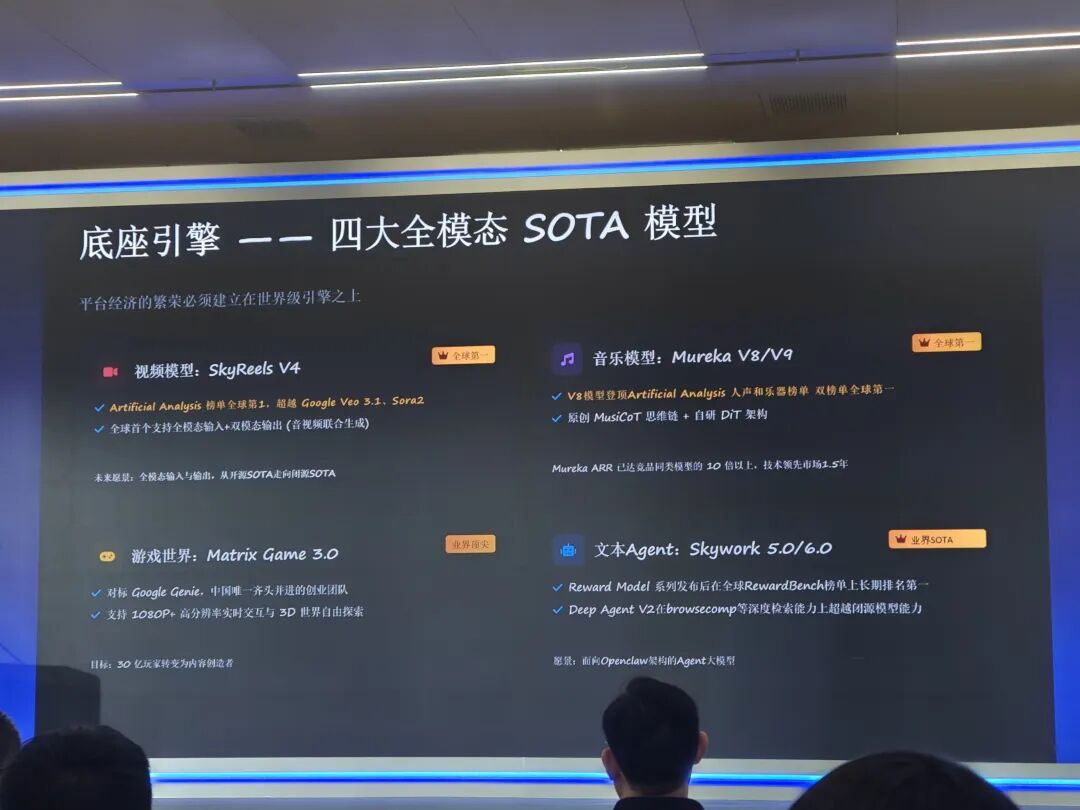

会上,天工AI集中发布了三款全新的人工智能模型:AI游戏世界模型Matrix-Game 3.0、AI视频大模型SkyReels V4以及AI音乐大模型Mureka V9。这三款模型不仅旨在强化AIGC的理解与生成能力,更标志着AI在物理世界建模与仿真方向上的实质性推进。

这三款大模型的性能表现已进入全球第一梯队,在多项基准测试中成绩斐然。

- SkyReels V4在Artificial Analysis基准测试中,同时斩获了“带音频文生视频”和“带音频图生视频”两个榜单的全球第一,并在“图生视频(不带音频)”榜单中位居全球第二(截至2026年3月18日数据)。

- Mureka V9在与Suno V5等竞品的对比中,于音乐旋律性、表现力、编曲等主观评价指标上实现了全面超越。

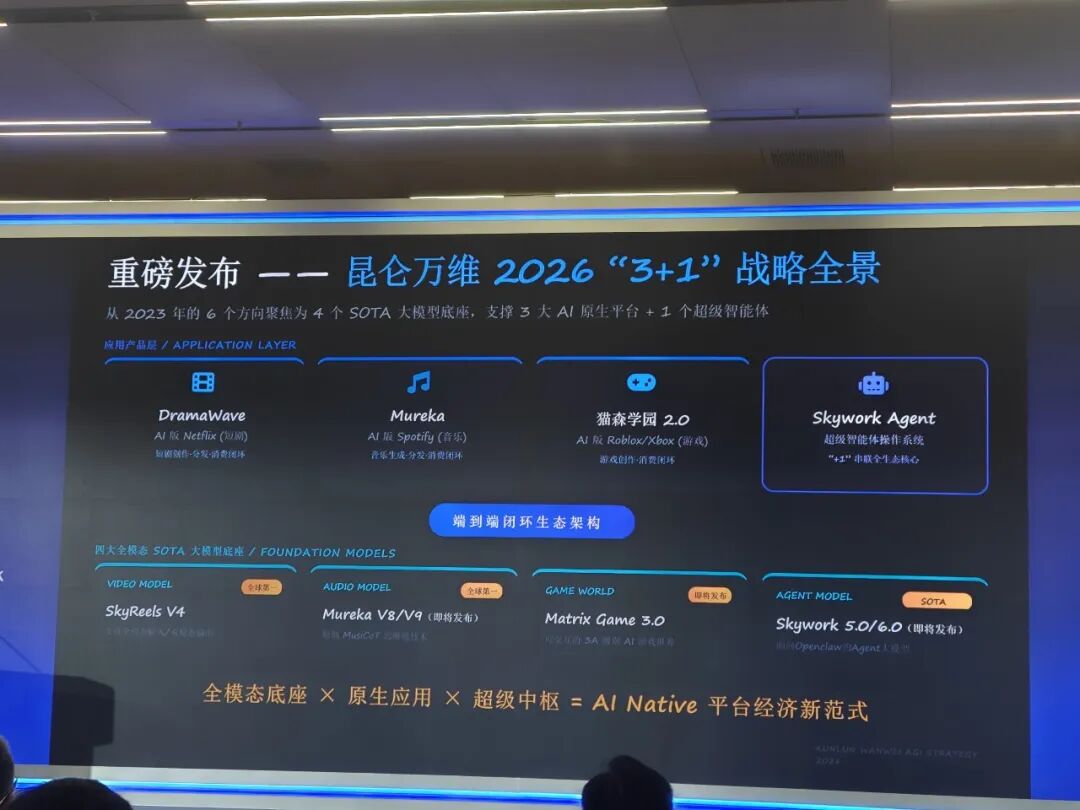

除了三大模型,昆仑万维正式对外公布了其 2026 AGI战略,清晰勾勒出实现“让每个人更好地塑造和表达自我”这一使命的路径。战略释放出一个明确信号:未来三年,AI发展将从全模态能力突破阶段,进入平台化构建的新时期。

在该战略设想中,除了底层的全模态基础模型和中间层的超级智能体,公司还将向上拓展应用层,探索包括短剧平台 DramaWave、音乐创作分发平台 Mureka 以及互动娱乐游戏世界 猫森学园 在内的丰富产品形态。

当底层模型、智能调度与上层应用实现协同运转时,AI将不再是孤立的工具,而会演变为一个可以持续自主运行的系统。随着这套体系逐步完善,AI原生的平台经济将走向落地,每位创作者有望获得媲美专业公司的全栈生产力。

世界模型补齐关键短板:记得住、跑得久、跑得快

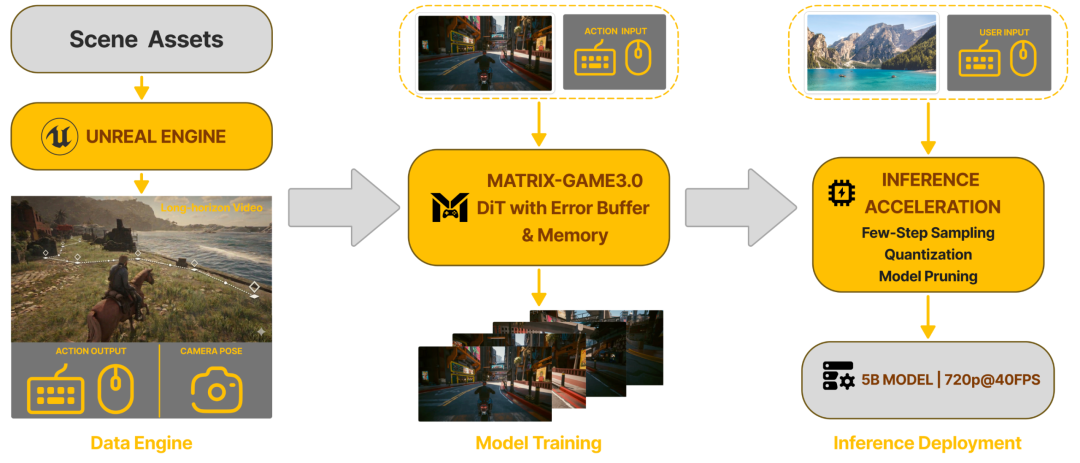

自开源Matrix-Game 1.0以来,昆仑万维对交互式世界模型的探索持续深入。此次发布的Matrix-Game 3.0,旨在解决世界模型普遍存在的三大短板:记不住(记忆)、跑不久(长时程)和跑不动(实时+高分辨率),其核心在于贯通数据、记忆与实时生成三大环节。

首先在数据层面,该模型构建了可无限扩展的数据引擎。数据形态从传统视频升级为包含视频、位姿、动作、提示词的多模态对齐数据;生产方式采用Unreal Engine合成数据与真实3A游戏采集双管线;工程上实现了从探索、采集到标注的全流程自动化。

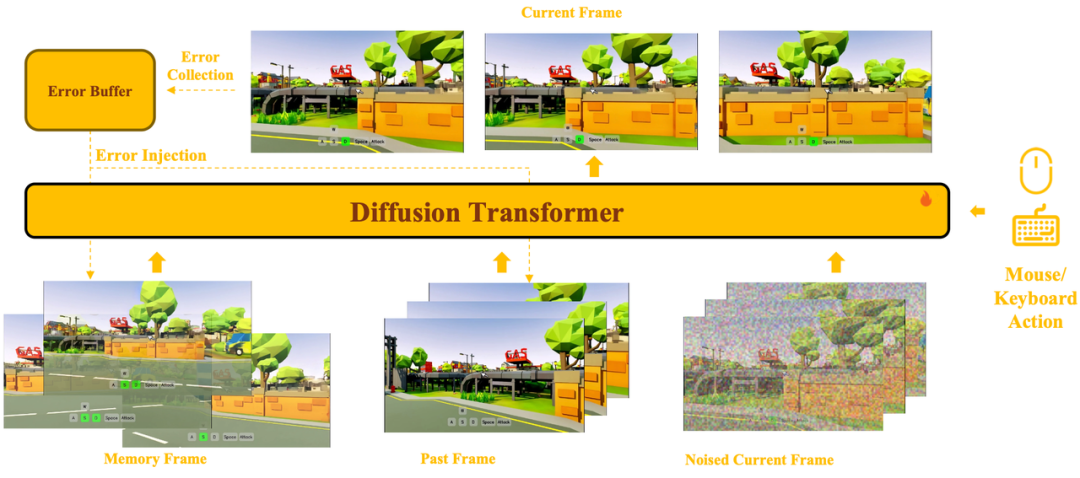

其次在模型架构层面,建立了一套算力效率与记忆能力的协同机制。它重构了视频生成范式,重点解决了“控制信号注入”和“长时序抗漂移”两大难题。

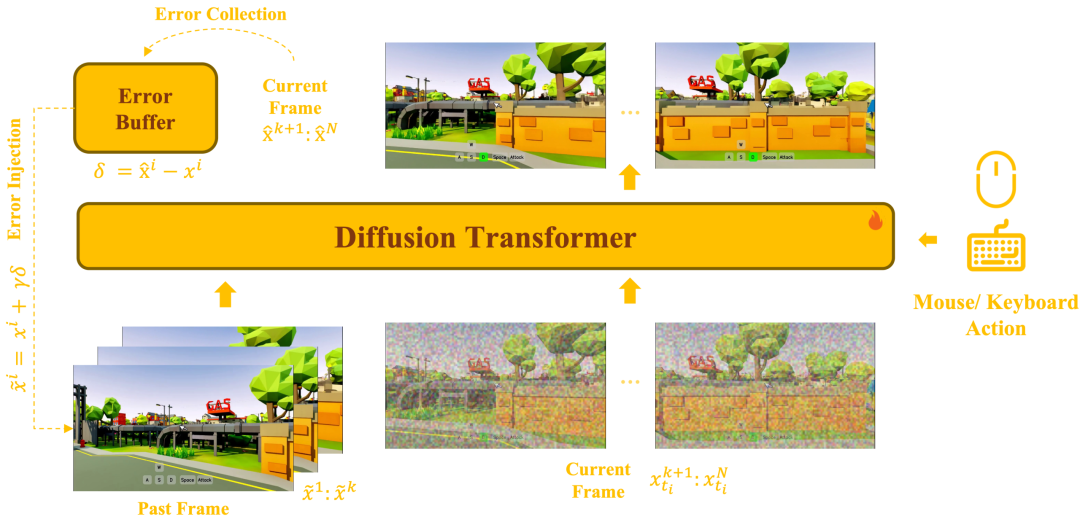

在控制层面,模型将用户动作显式引入:鼠标信号通过Self-Attention直接作用于当前视觉生成,确保即时交互的准确性;键盘动作通过Cross-Attention注入,负责引导整体运动趋势,保障长序列行为的稳定性。

在长时序稳定性层面,引入了Error Buffer机制,显式建模生成帧与真实帧之间的误差,并将其作为条件回注模型进行训练,使模型获得抗误差累积的能力,有效避免了内容随时间推移发生崩坏。

在记忆层面,通过统一的DiT框架,对长期记忆、局部历史帧及当前预测目标进行联合建模,实现了跨时间段的信息利用与生成连续性。

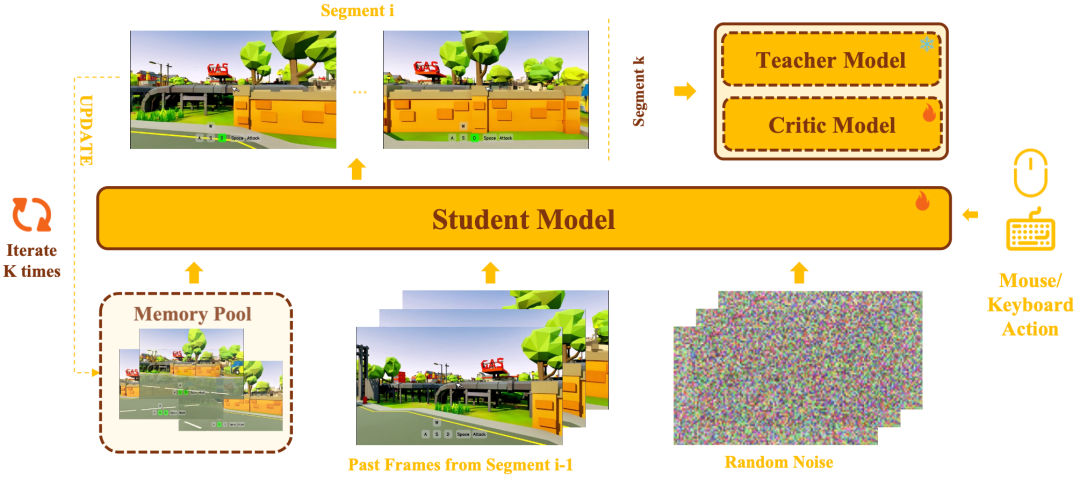

最后在推理部署层面,通过采用具备长期记忆和抗误差能力的教师模型进行蒸馏,并结合多段式联合训练,强化了模型的长时序连续推理能力。同时,借助模型量化与VAE decoder蒸馏等优化手段,成功将模型压缩至约5B规模,并在720p分辨率下实现了实时生成。规模更大的MoE-28B模型,其生成时长已可推进至分钟级别。

目前,昆仑万维已开放了Matrix-Game 3.0的代码与模型权重,开发者可以在开源实战平台进行探索:

AI视频走向原生一体生成:告别音画拼接

SkyReels V4此前已在社区引发热议,其在Artificial Analysis榜单上超越Sora 2、Veo 3.1等强劲对手的表现,获得了高度认可。

作为系列最新版本,SkyReels V4进化为 “全模态音视频联合生成、修复与编辑”的大一统模型,让AI视频具备了基础的叙事能力。这一突破源于其在多个层面的系统性升级。

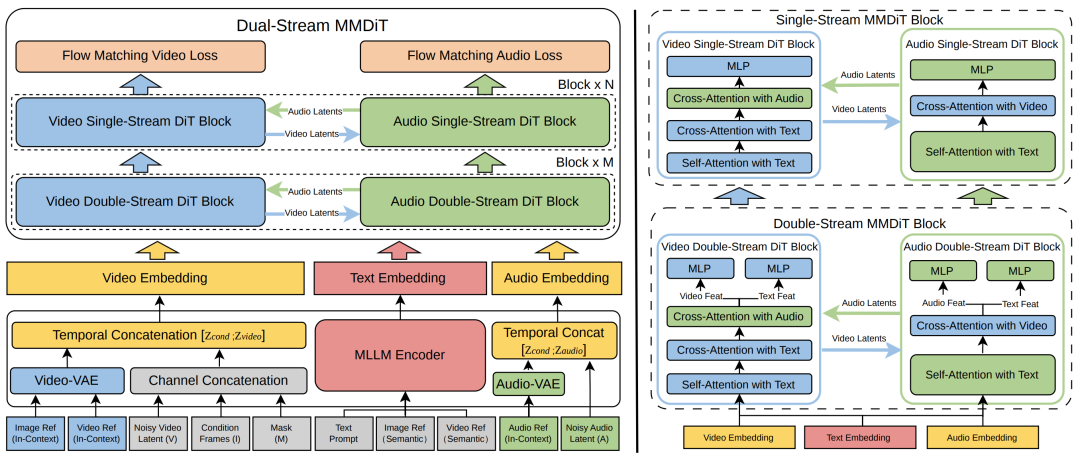

首先是底层架构的重写。模型采用了原生音画一体的双流MMDiT(多模态扩散变换器)架构,替代了传统的“先画面、后音频”串行流程,将音视频置于同一语义空间中联合建模。通过对称双分支设计,并共享文本编码器,模型实现了口型、动作与声音的精确同步,真正做到了从多模态拼接走向原生一体生成。

其次,实现了生成、编辑与修复的能力大一统。模型支持首尾帧、多帧、多图、运动等多种参考方式,能够完成元素增删、风格迁移等精细编辑。其核心是将生成、编辑与修复收敛到同一套掩码补绘框架下,并引入参考图像/视频作为上下文,从而稳定锁定角色特征与场景风格,确保跨帧一致性。

再者,结合强化学习与工程优化实现增质提效。模型引入了全模态语义Reward体系对生成结果进行实时校正,并采用阶梯式课程学习来逐步建立稳定的叙事能力。为降低计算开销,采用了“低分辨率全序列+高分辨率关键帧”的联合生成策略,并结合超分与帧插值恢复画质,最终将计算成本降低约3倍,实现了1080P分辨率、32FPS帧率、15秒时长的影院级内容生成。

最后,数据体系的重构是高效运作的基石。SkyReels-V4构建了覆盖图像、视频、音频的统一数据体系,通过“真实+合成”双管线保证数据规模与质量,为全模态生成提供了稳定的数据基础。

从生成到创作:让“好听”变成一种可控能力

昆仑万维的音乐大模型Mureka持续带来惊喜。其前代Mureka V8已在Artificial Analysis的人声与乐器榜单上双双登顶。最新发布的Mureka V9,则围绕音乐创作的核心环节进行了全方位优化。

- 表达更到位:歌词、情绪与段落推进能更精准对齐。

- 成品感更强:混音、音色与空间感更统一,听感接近高完成度作品。

- 人声更克制:表达干净,不过度介入。

- 反馈更快:从输入到输出的链路更顺畅,试错成本降低。

- 结果不易撞车:旋律与编排的重复感下降,同一方向下能产生更多变化。

这些提升建立在 MusiCoT(Music Chain-of-Thought)技术底座的持续优化之上。模型开始以更接近真实创作流程的方式组织音乐:理解段落结构、把握表达重点,并决定每一段的呈现方式。这使得音乐不再仅是用于聆听的内容,而开始成为一种表达自我的语言。

Mureka V9更深层的目标是将“好听”从偶然结果转变为可稳定产出的能力。其方法是将“好听”拆解为歌词落点、情绪贴合度、结构旋律顺畅度等多个维度,进行逐步校准与优化,使整个创作过程变得可复用、可积累。

由此,创作方式发生了根本变化:AI音乐不再是“一次生成定稿”,而变成了一个可以反复尝试、局部调整、持续迭代的过程。创作者的角色也更多地转向审美决策与版本管理。Mureka V9正从一个音乐生成工具,向一个创作平台演进,致力于成为连接创作、消费与分发的AI时代“Spotify”。

“3+1”战略:昆仑万维的AGI路径图

将三大模型置于一起观察,可以发现它们共同补齐了一套更完整的AGI能力结构:Matrix-Game 3.0聚焦“世界如何被建模与交互”,SkyReels V4解决“内容如何被规模化生成”,Mureka V9关注“情感与表达如何被精准控制”。

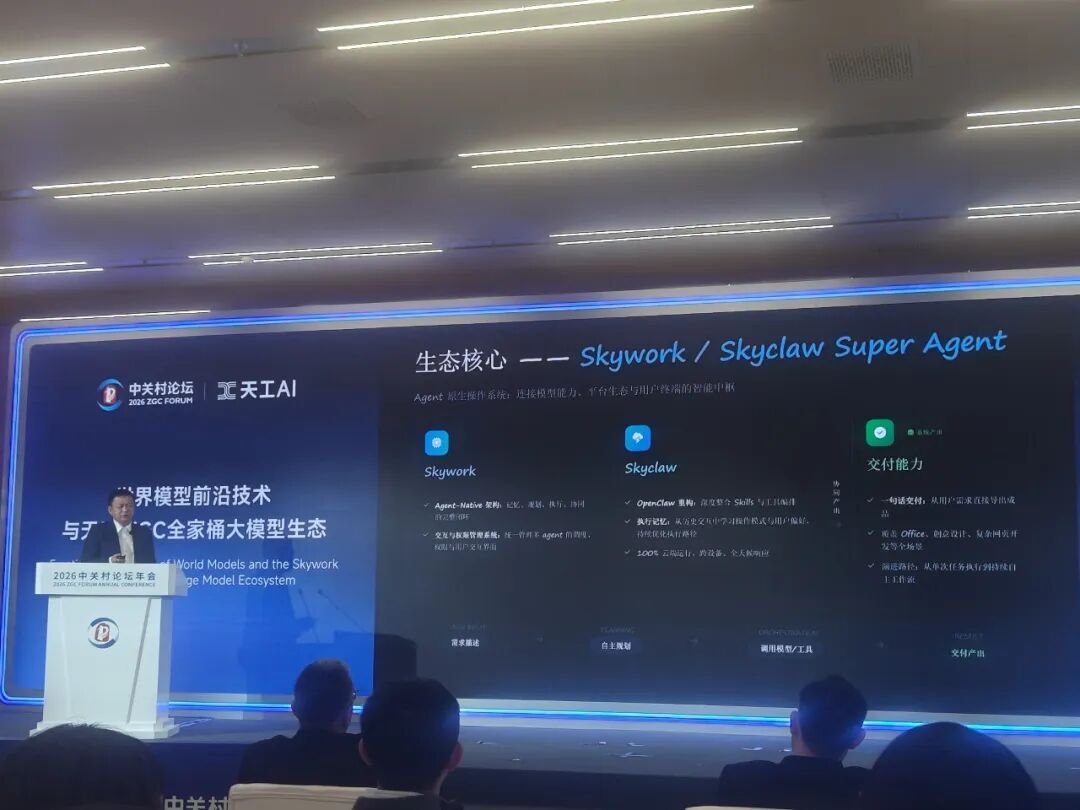

昆仑万维的2026 AGI战略,正是在这些能力之上给出了清晰的实施路径,可概括为 “3+1”布局。其中,“3”指游戏、视频、音乐三大场景大模型,持续突破多模态能力边界;“1”则指天工超级智能体(Skywork Super Agents),负责对所有AI能力进行统一调度与串联。

天工超级智能体于去年发布,具备跨任务一体化执行、以Deep Research为核心的信息处理以及多Agent分工协作的能力。随着OpenClaw架构的流行,Skywork推出了SkyClaw,打造云端AI原生助理,并上线了首批官方Skills,将能力封装为可直接调用的工具。这补上了“能力如何被高效调用”的关键一环。

与此同时,昆仑万维正在构建一个围绕“平台 + 超级智能体 + 开发者 + 创作者”的开放生态协同体系。一方面,通过统一入口对外开放多模态能力,降低开发与创作门槛;另一方面,通过与产业伙伴合作,将AI能力落地到具体场景,完成从技术到应用的转化。当技术能力、智能调度与商业场景形成闭环,AGI的未来图景便更加清晰可期。

技术的快速迭代离不开强大的智能 & 数据 & 云基础设施支撑。昆仑万维此次集中发布,不仅展示了其在多模态AI领域的硬实力,也为整个行业向平台化、生态化发展提供了重要的路径参考。对于关注前沿技术的开发者而言,这些开源模型和清晰的战略方向,无疑是深入研究和参与下一代AI应用构建的宝贵资源。